Python Q-learning 算法详解与应用案例

目录

- Python Q-learning 算法详解与应用案例

- 引言

- 一、Q-learning 的基本原理

- 1.1 强化学习基础

- 1.2 Q值及其更新

- 1.3 Q-learning 的特性

- 二、Python 中 Q-learning 的面向对象实现

- 2.1 `QTable` 类的实现

- 2.2 `Environment` 类的实现

- 2.3 `Agent` 类的实现

- 三、案例分析

- 3.1 简单环境中的 Q-learning

- 3.1.1 环境设置

- 3.1.2 结果分析

- 3.2 游戏中的 Q-learning

- 3.2.1 环境设置

- 3.2.2 训练智能体

- 四、Q-learning 的优缺点

- 4.1 优点

- 4.2 缺点

- 五、总结

Python Q-learning 算法详解与应用案例

引言

Q-learning 是一种基于值的强化学习算法,旨在通过与环境的交互学习最优策略。它能够有效地解决许多决策问题,如游戏、机器人控制和资源管理等。本文将深入探讨 Q-learning 的原理,提供 Python 中的面向对象实现,并通过多个案例展示 Q-learning 的实际应用。

一、Q-learning 的基本原理

1.1 强化学习基础

在强化学习中,智能体(agent)通过与环境(environment)交互学习最佳策略。智能体在每个时刻根据当前状态选择行动,获得奖励,并转移到下一个状态。目标是最大化累积奖励。

1.2 Q值及其更新

Q-learning 的核心是 Q 值,它表示在给定状态下采取某个行动的预期回报。Q 值的更新公式为:

Q ( s , a ) ← Q ( s , a ) + α [ r + γ max a ′ Q ( s ′ , a ′ ) − Q ( s , a ) ] Q(s, a) \leftarrow Q(s, a) + \alpha [r + \gamma \max_{a'} Q(s', a') - Q(s, a)] Q(s,a)←Q(s,a)+α[r+γa′maxQ(s′,a′)−Q(s,a)]

其中:

- s s s:当前状态

- a a a:当前行动

- r r r:获得的即时奖励

- s ′ s' s′:下一个状态

- α \alpha α:学习率

- γ \gamma γ:折扣因子

1.3 Q-learning 的特性

- 无模型学习:不需要环境的完整模型,通过探索学习最优策略。

- 离线学习:可以在完成训练后进行策略评估和改进。

二、Python 中 Q-learning 的面向对象实现

在 Python 中,我们将使用面向对象的方式实现 Q-learning。主要包含以下类和方法:

QTable类:用于存储 Q 值表及其更新。Environment类:用于定义环境和状态转移。Agent类:实现 Q-learning 算法的核心逻辑。

2.1 QTable 类的实现

QTable 类用于维护状态-行动值(Q 值)表。

import numpy as npclass QTable:def __init__(self, state_size, action_size):"""Q表类:param state_size: 状态空间大小:param action_size: 动作空间大小"""self.q_table = np.zeros((state_size, action_size))def update(self, state, action, value):"""更新 Q 值:param state: 当前状态:param action: 当前动作:param value: 新的 Q 值"""self.q_table[state, action] = valuedef get_q_value(self, state, action):"""获取 Q 值:param state: 当前状态:param action: 当前动作:return: Q 值"""return self.q_table[state, action]def get_best_action(self, state):"""获取最佳动作:param state: 当前状态:return: 最佳动作"""return np.argmax(self.q_table[state])

2.2 Environment 类的实现

Environment 类用于定义环境的状态和转移逻辑。

class Environment:def __init__(self, state_size, action_size):"""环境类:param state_size: 状态空间大小:param action_size: 动作空间大小"""self.state_size = state_sizeself.action_size = action_sizedef step(self, state, action):"""执行动作并返回下一个状态和奖励:param state: 当前状态:param action: 当前动作:return: 下一个状态和奖励"""# 示例环境逻辑if state == 0:if action == 0:return 1, 1 # 状态1,奖励1else:return 0, -1 # 状态0,奖励-1elif state == 1:if action == 0:return 1, -1 # 状态1,奖励-1else:return 2, 1 # 状态2,奖励1return state, 0 # 默认返回当前状态

2.3 Agent 类的实现

Agent 类实现了 Q-learning 算法的核心逻辑。

class Agent:def __init__(self, state_size, action_size, alpha=0.1, gamma=0.9, epsilon=0.1):"""智能体类:param state_size: 状态空间大小:param action_size: 动作空间大小:param alpha: 学习率:param gamma: 折扣因子:param epsilon: 探索率"""self.q_table = QTable(state_size, action_size)self.alpha = alphaself.gamma = gammaself.epsilon = epsilondef choose_action(self, state):"""选择动作(基于 ε-greedy 策略):param state: 当前状态:return: 选择的动作"""if np.random.rand() < self.epsilon:return np.random.choice(self.q_table.q_table.shape[1]) # 随机选择return self.q_table.get_best_action(state) # 选择最佳动作def learn(self, state, action, reward, next_state):"""学习并更新 Q 值:param state: 当前状态:param action: 当前动作:param reward: 获得的奖励:param next_state: 下一个状态"""current_q = self.q_table.get_q_value(state, action)max_future_q = np.max(self.q_table.q_table[next_state]) # 未来 Q 值new_q = current_q + self.alpha * (reward + self.gamma * max_future_q - current_q)self.q_table.update(state, action, new_q)

三、案例分析

3.1 简单环境中的 Q-learning

在这个案例中,我们将模拟一个简单的环境,让智能体通过 Q-learning 学习最佳策略。

3.1.1 环境设置

假设我们的环境有三个状态(0, 1, 2),并且智能体在这些状态之间进行移动。

state_size = 3

action_size = 2

environment = Environment(state_size, action_size)

agent = Agent(state_size, action_size)# 训练参数

num_episodes = 1000for episode in range(num_episodes):state = 0 # 初始状态while state != 2: # 状态2为终止状态action = agent.choose_action(state) # 选择动作next_state, reward = environment.step(state, action) # 执行动作agent.learn(state, action, reward, next_state) # 学习更新 Q 值state = next_state # 转移到下一个状态# 输出学习结果

print("学习后的 Q 值表:")

print(agent.q_table.q_table)

3.1.2 结果分析

在训练结束后,输出的 Q 值表将显示每个状态下各个动作的期望回报。智能体应能够学习到最佳策略,最大化其获得的奖励。

3.2 游戏中的 Q-learning

在这个案例中,我们将应用 Q-learning 来解决一个更复杂的问题,如“迷宫”游戏。

3.2.1 环境设置

创建一个简单的迷宫环境。

class MazeEnvironment(Environment):def __init__(self):super().__init__(state_size=6, action_size=4)self.maze = np.array([[0, 0, 0, 1, 0, 0],[0, 1, 0, 1, 0, 0],[0, 1, 0, 0, 0, 0],[0, 0, 0, 1, 1, 0],[0, 0, 0, 0, 1, 0],[0, 0, 0, 0, 0, 0]])self.start = (0, 0)self.goal = (5, 5)def step(self, state, action):x, y = stateif action == 0 and x > 0: # 上x -= 1elif action == 1 and x < 5: # 下x += 1elif action == 2 and y > 0: # 左y -= 1elif action == 3 and y < 5: # 右y += 1if (x, y) == self.goal:return (x, y), 1 # 达到目标elif self.maze[x, y] == 1:return (state), -1 # 碰到墙壁,返回当前状态return (x, y), 0 # 正常移动,奖励0

3.2.2 训练智能体

我们将使用 Q-learning 训练智能体在迷宫中找到最优路径。

maze_env = MazeEnvironment()

maze_agent = Agent(state_size=36, action_size=4)# 训练参数

num_episodes = 5000for episode in range(num_episodes):state = maze_env.start # 初始状态while state != maze_env.goal: # 目标状态action = maze_agent.choose_action(state[0] * 6 + state[1]) # 选择动作next_state, reward = maze_env.step(state, action) # 执行动作maze_agent.learn(state[0] * 6 + state[1], action, reward, next_state[0] * 6 + next_state[1]) # 学习state = next_state # 转移状态# 输出学习后的 Q 值表

print("学习后的 Q 值表:")

print(maze_agent.q_table.q_table)

四、Q-learning 的优缺点

4.1 优点

- 简单易实现:Q-learning 算法简单,易于理解和实现。

- 无模型学习:不需要环境的完整模型,适用性广泛。

- 有效性强:在许多实际问题中表现良好,尤其是离散空间的问题。

4.2 缺点

- 收敛速度慢:在复杂问题中,收敛可能很慢。

- 维数灾难:状态和动作空间较大时,Q 值表会变得庞大,导致计算和存储困难。

- 需要大量探索:在初期探索阶段,需要进行大量随机探索,影响学习效率。

五、总结

本文详细介绍了 Q-learning 的基本原理,提供了 Python 中的面向对象实现,并通过简单环境和迷宫游戏的案例展示了其应用。Q-learning 是一种强大的强化学习工具,在多种领域有广泛的应用潜力。希望本文能为读者理解和应用 Q-learning 提供帮助。

相关文章:

Python Q-learning 算法详解与应用案例

目录 Python Q-learning 算法详解与应用案例引言一、Q-learning 的基本原理1.1 强化学习基础1.2 Q值及其更新1.3 Q-learning 的特性 二、Python 中 Q-learning 的面向对象实现2.1 QTable 类的实现2.2 Environment 类的实现2.3 Agent 类的实现 三、案例分析3.1 简单环境中的 Q-l…...

解决:如何在opencv中得到与matlab立体标定一样的矫正图?(python版opencv)

目的:采用一样的标定参数,matlab中和opencv中的立体矫正图像是一样的吗?不一样的话怎么让它们一样? 结论:不一样。后文为解决方案。 原因:注意matlab的标定结果在matlab中的用法和在opencv中的用法不一样&a…...

:路由与处理器)

gin入门教程(4):路由与处理器

路由与处理器 在 Gin 框架中,路由和处理器是核心组成部分,负责将 HTTP 请求映射到相应的处理逻辑。 1. 定义路由 在 cmd/main.go 中,您可以定义不同的路由,例如: r.GET("/ping", func(c *gin.Context) {…...

【python+Redis】hash修改

文章目录 前请详解一、关于Update1. 语法2. 代码示例 二、完整代码 前请详解 Redis库数据 keyvalue1{“id”: 1, “name”: “xxx”, “age”: “18”, “sex”: “\u7537”}2{“id”: 2, “name”: “xxx”, “age”: “18”, “sex”: “\u5973”}3{“id”: 3, “name”: “…...

MAVlink协议 部分通用消息集解析

文章目录 MAVLink是一种非常轻量级的消息传输协议, 用于地面控制终端(地面站)与无人机之间 (以及机载无人机组件之间) 进行通信, 为一种设计用于资源受限系统及带宽受限链路的二进制遥测协议。 HEARTBEAT 检测信号消息显示系统或组件存在并正…...

c++实现跳表

原理 跳表(Skip List) 是一种随机化数据结构,用于高效查找、插入和删除,尤其适用于有序数据集合。相比链表,跳表通过多层索引结构加速查找,期望时间复杂度接近 O(logn)。跳表的主要思想是: …...

新探索研究生英语读写教程pdf答案(基础级)

《新探索研究生英语读写教程》的设计和编写充分考虑国内研究生人才培养目标和研究生公共英语的教学需求, 教学内容符合研究生认知水平, 学术特征突出;教学设计紧密围绕学术阅读、学术写作和学术研究能力培养;教学资源立体多元&…...

管道与共享内存

一,命名管道 管道的限制就是他只能在有血缘关系(父子进程)的进程中,允许互相访问,这是有局限性的,所以我们想在毫无关系的进程中允许他们相互访问,这就是命名管道的定义。 总结:命名…...

ES 自定义排序方式

es默认score是根据query的相关度进行打分的,具体打分机制可以参见:官方文档。如果召回时既希望有相关性又能根据其他信息进行排序。 例如小红书搜索的时候,可能既希望有召回相关度又能根据热度信息(如果喜欢、收藏等等参数去进行召…...

在vue中,编写一个li标签同时使用v-for和v-if,谁的优先级更高

在 Vue 中,v-if 和 v-for 是两个常用的指令,但它们的优先级不同。当二者一起使用时,v-for 的优先级高于 v-if。这意味着,v-for 会先执行,即使列表中的某些元素不满足 v-if 条件,它们仍会被遍历和渲染。 由…...

Java 后端开发面试题及其答案

以下是一些常见的 Java 后端开发面试题及其答案,涵盖了 Java 基础、面向对象、并发、多线程、框架等多个方面: 1. Java 中的基本数据类型有哪些? 答案: Java 中的基本数据类型有 8 种: int:32 位整数lon…...

C++,STL 045(24.10.24)

内容 1.对set容器的大小进行操作。 2.set容器的交换操作。 运行代码 #include <iostream> #include <set>using namespace std;void printSet(set<int> &s) {for (set<int>::iterator it s.begin(); it ! s.end(); it){cout << *it <…...

二叉树习题其五【力扣】【算法学习day.12】

前言 书接上篇文章二叉树习题其四,这篇文章我们将基础拓展 ###我做这类文档一个重要的目的还是给正在学习的大家提供方向(例如想要掌握基础用法,该刷哪些题?)我的解析也不会做的非常详细,只会提供思路和一…...

【数据库】Mysql的锁类型

Mysql中的锁机制主要是为了保证数据的一致性和完整性,在并发的情况下起着至关重要的作用。其中锁的类型主要是分为以下几种: 按照粒度分类 全局锁:对于整个数据库实例进行枷锁,加锁后整个实例就处于只读的状态。局锁通常用于需要…...

自媒体短视频制作素材下载网站推荐,让创作更简单

随着自媒体行业的火爆,视频质量要求也越来越高。想要找到无版权的高清视频素材并不容易,但别担心!今天为大家整理了5个国内外高质量的素材网站,让你轻松获取自媒体短视频素材,快收藏起来吧! 蛙学网 蛙学网是…...

Altium Designer 入门基础教程(五)

本文章继续接着《Altium Designer 入门基础教程(四)》的内容往下介绍: 七、AD画板的整个流程步骤 I.集成库的制作 AD元件库有2种:1、原理图元件库SCH.LIB 2、印刷电路板(PCB)元件库 PCB.LIB 印刷电路…...

Java题集练习3

Java题集练习3 1 什么时候用instanceof instanceOf关键字主要用于判断一个对象是否为某个类的子类或是接口的实例,通常用于类型转换和运行时类型判断的场景,比如继承和多态中。比如,创建一个Animal类及其子类Cat和Cat子类Hat,可…...

【部署篇】Haproxy-01安装部署(源码方式安装)

一、HAProxy概述 HAProxy是一款免费、快速且可靠的代理软件,提供高可用性、负载均衡,支持TCP和HTTP应用代理,HAProxy凭借其卓越的性能和灵活性,成为众多知名网站和系统的首选代理软件。 核心特点: 高性能…...

开拓鸿蒙测试新境界,龙测科技引领自动化测试未来

在当今科技舞台上,鸿蒙 OS 以非凡先进性强势登场,打破传统操作系统格局,为软件测试领域带来全新机遇与艰巨挑战。 一、鸿蒙 OS 的辉煌崛起 (一)壮丽发展历程与卓越市场地位 鸿蒙 OS 的发展如波澜壮阔的史诗。2023 年…...

Java项目-基于springboot框架的自习室预订系统项目实战(附源码+文档)

作者:计算机学长阿伟 开发技术:SpringBoot、SSM、Vue、MySQL、ElementUI等,“文末源码”。 开发运行环境 开发语言:Java数据库:MySQL技术:SpringBoot、Vue、Mybaits Plus、ELementUI工具:IDEA/…...

OpenLayers 可视化之热力图

注:当前使用的是 ol 5.3.0 版本,天地图使用的key请到天地图官网申请,并替换为自己的key 热力图(Heatmap)又叫热点图,是一种通过特殊高亮显示事物密度分布、变化趋势的数据可视化技术。采用颜色的深浅来显示…...

鱼香ros docker配置镜像报错:https://registry-1.docker.io/v2/

使用鱼香ros一件安装docker时的https://registry-1.docker.io/v2/问题 一键安装指令 wget http://fishros.com/install -O fishros && . fishros出现问题:docker pull 失败 网络不同,需要使用镜像源 按照如下步骤操作 sudo vi /etc/docker/dae…...

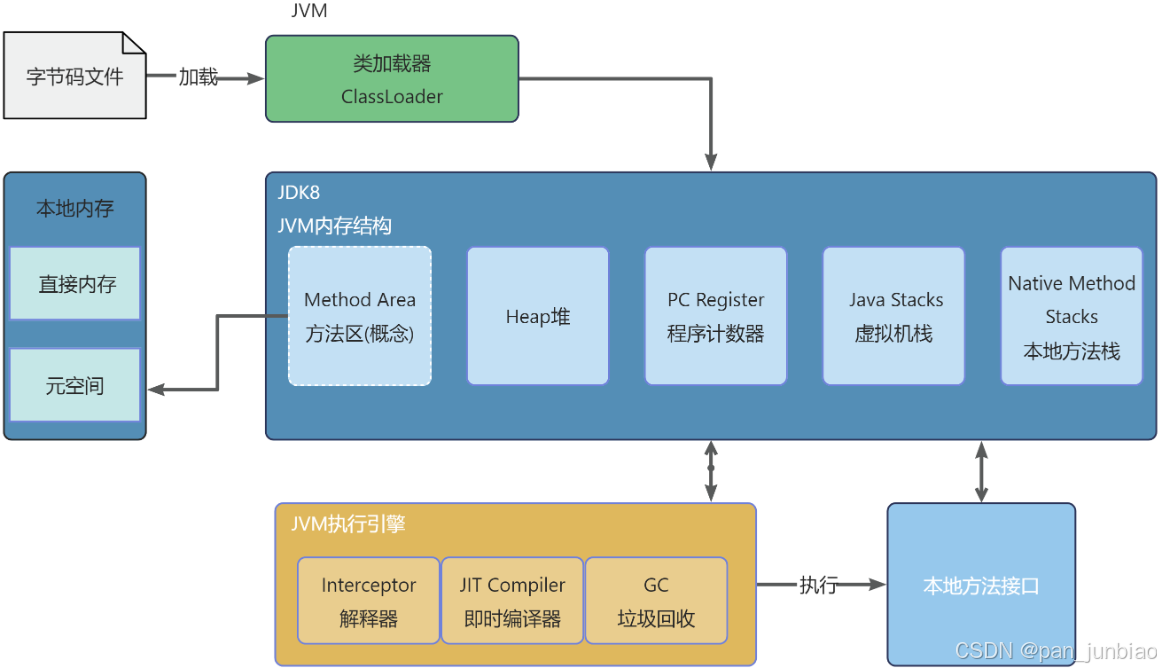

JVM虚拟机:内存结构、垃圾回收、性能优化

1、JVM虚拟机的简介 Java 虚拟机(Java Virtual Machine 简称:JVM)是运行所有 Java 程序的抽象计算机,是 Java 语言的运行环境,实现了 Java 程序的跨平台特性。JVM 屏蔽了与具体操作系统平台相关的信息,使得 Java 程序只需生成在 JVM 上运行的目标代码(字节码),就可以…...

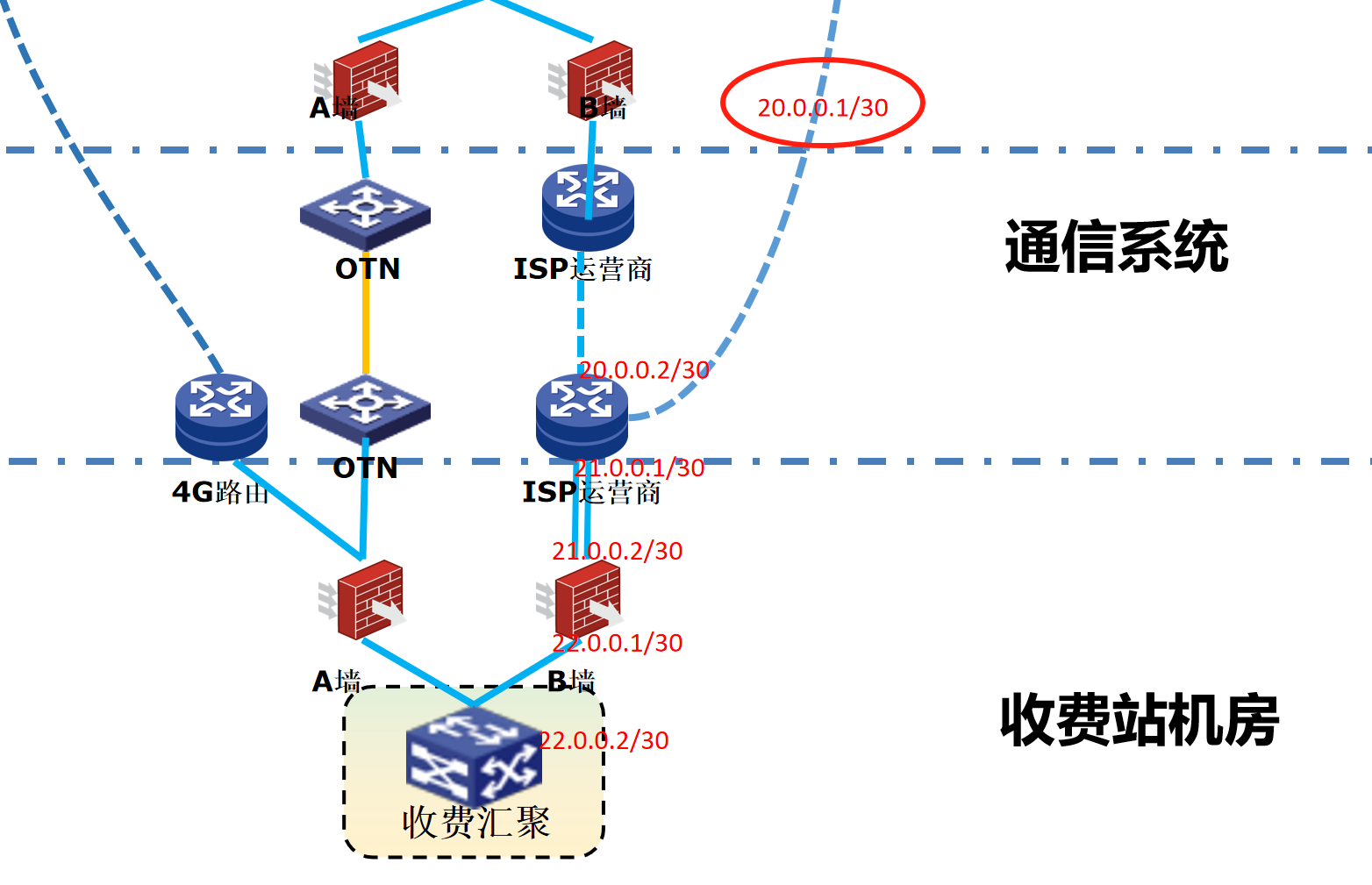

浪潮交换机配置track检测实现高速公路收费网络主备切换NQA

浪潮交换机track配置 项目背景高速网络拓扑网络情况分析通信线路收费网络路由 收费汇聚交换机相应配置收费汇聚track配置 项目背景 在实施省内一条高速公路时遇到的需求,本次涉及的主要是收费汇聚交换机的配置,浪潮网络设备在高速项目很少,通…...

与常用工具深度洞察App瓶颈)

iOS性能调优实战:借助克魔(KeyMob)与常用工具深度洞察App瓶颈

在日常iOS开发过程中,性能问题往往是最令人头疼的一类Bug。尤其是在App上线前的压测阶段或是处理用户反馈的高发期,开发者往往需要面对卡顿、崩溃、能耗异常、日志混乱等一系列问题。这些问题表面上看似偶发,但背后往往隐藏着系统资源调度不当…...

【Go语言基础【13】】函数、闭包、方法

文章目录 零、概述一、函数基础1、函数基础概念2、参数传递机制3、返回值特性3.1. 多返回值3.2. 命名返回值3.3. 错误处理 二、函数类型与高阶函数1. 函数类型定义2. 高阶函数(函数作为参数、返回值) 三、匿名函数与闭包1. 匿名函数(Lambda函…...

嵌入式学习笔记DAY33(网络编程——TCP)

一、网络架构 C/S (client/server 客户端/服务器):由客户端和服务器端两个部分组成。客户端通常是用户使用的应用程序,负责提供用户界面和交互逻辑 ,接收用户输入,向服务器发送请求,并展示服务…...

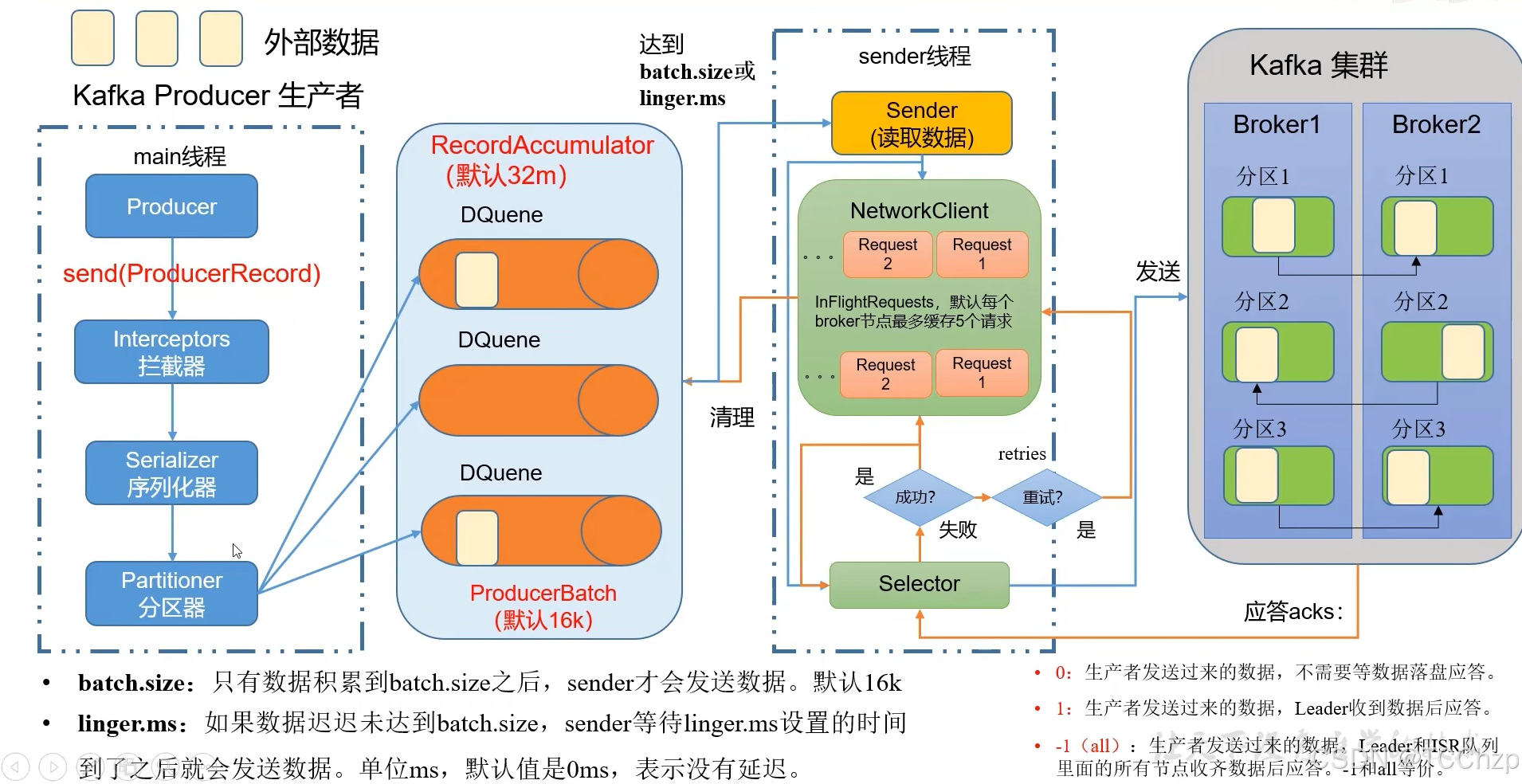

Kafka入门-生产者

生产者 生产者发送流程: 延迟时间为0ms时,也就意味着每当有数据就会直接发送 异步发送API 异步发送和同步发送的不同在于:异步发送不需要等待结果,同步发送必须等待结果才能进行下一步发送。 普通异步发送 首先导入所需的k…...

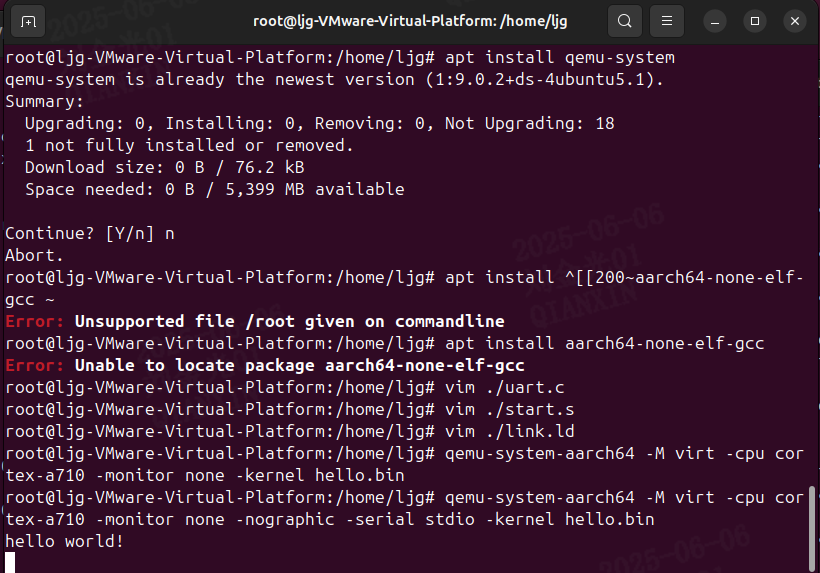

Qemu arm操作系统开发环境

使用qemu虚拟arm硬件比较合适。 步骤如下: 安装qemu apt install qemu-system安装aarch64-none-elf-gcc 需要手动下载,下载地址:https://developer.arm.com/-/media/Files/downloads/gnu/13.2.rel1/binrel/arm-gnu-toolchain-13.2.rel1-x…...

Python爬虫实战:研究Restkit库相关技术

1. 引言 1.1 研究背景与意义 在当今信息爆炸的时代,互联网上存在着海量的有价值数据。如何高效地采集这些数据并将其应用于实际业务中,成为了许多企业和开发者关注的焦点。网络爬虫技术作为一种自动化的数据采集工具,可以帮助我们从网页中提取所需的信息。而 RESTful API …...