K8S群集调度

K8S群集调度

- 一、调度约束

- 1.概述

- 2.Pod 启动典型创建过程(工作机制 )

- 3.调度过程

- 4.Predicate 的常见的算法

- 5.常见的优先级选项

- 6.指定调度节点:

- 二、亲和性

- 1.节点亲和性

- 2.Pod 亲和性

- 3.键值运算关系

- 4.示例

- 5.Pod亲和性与反亲和性

- 6.使用 Pod 反亲和性调度

- 三、污点(Taint) 和 容忍(Tolerations)

- 1.污点(Taint)

- 2.容忍(Tolerations)

- 3.维护操作

- 4.Pod启动阶段(相位 phase)

- 5.phase 的可能状态有:

- 6.故障排除步骤

- 四、总结

- 1.list-watch

- 2.scheduler

- 3.pod 调度到指定节点的方法

- 4.节点亲和性和反亲和性

- 5.相关标签命令

- 6.污点和容忍

- 7.Pod启动阶段(相位) 5个状态

- 8.排除故障方法

一、调度约束

1.概述

(1)Kubernetes 是通过 List-Watch的机制进行每个组件的协作,保持数据同步的,每个组件之间的设计实现了解耦。

(2)用户是通过 kubectl 根据配置文件,向 APIServer 发送命令,在 Node 节点上面建立 Pod 和 Container。

(3)APIServer 经过 API 调用,权限控制,调用资源和存储资源的过程,实际上还没有真正开始部署应用。这里 需要 Controller、Manager、Scheduler 和 kubelet 的协助才能完成整个部署过程。

(4)在 Kubernetes 中,所有部署的信息都会写到 etcd 中保存。实际上 etcd 在存储部署信息的时候,会发送 Create 事件给 APIServer,而 APIServer 会通过监听(Watch)etcd 发过来的事件。其他组件也会监听(Watch)APIServer 发出来的事件。

2.Pod 启动典型创建过程(工作机制 )

(1)这里有三个 List-Watch,分别是 Controller Manager(运行在 Master),Scheduler(运行在 Master),kubelet(运行在 Node)。 他们在进程已启动就会监听(Watch)APIServer 发出来的事件。

(2)用户通过 kubectl 或其他 API 客户端提交请求给 APIServer 来建立一个 Pod 对象副本。

(3)APIServer 尝试着将 Pod 对象的相关元信息存入 etcd 中,待写入操作执行完成,APIServer 即会返回确认信息至客户端。

(4)当 etcd 接受创建 Pod 信息以后,会发送一个 Create 事件给 APIServer。

(5)由于 Controller Manager 一直在监听(Watch,通过https的6443端口)APIServer 中的事件。此时 APIServer 接受到了 Create 事件,又会发送给 Controller Manager。

(6)Controller Manager 在接到 Create 事件以后,调用其中的 Replication Controller 来保证 Node 上面需要创建的副本数量。一旦副本数量少于 RC 中定义的数量,RC 会自动创建副本。总之它是保证副本数量的 Controller(PS:扩容缩容的担当)。

(7)在 Controller Manager 创建 Pod 副本以后,APIServer 会在 etcd 中记录这个 Pod 的详细信息。例如 Pod 的副本数,Container 的内容是什么。

(8)同样的 etcd 会将创建 Pod 的信息通过事件发送给 APIServer。

(9)由于 Scheduler 在监听(Watch)APIServer,并且它在系统中起到了“承上启下”的作用,“承上”是指它负责接收创建的 Pod 事件,为其安排 Node;“启下”是指安置工作完成后,Node 上的 kubelet 进程会接管后继工作,负责 Pod 生命周期中的“下半生”。 换句话说,Scheduler 的作用是将待调度的 Pod 按照调度算法和策略绑定到集群中 Node 上。

(10)Scheduler 调度完毕以后会更新 Pod 的信息,此时的信息更加丰富了。除了知道 Pod 的副本数量,副本内容。还知道部署到哪个 Node 上面了。并将上面的 Pod 信息更新至 API Server,由 APIServer 更新至 etcd 中,保存起来。

(11)etcd 将更新成功的事件发送给 APIServer,APIServer 也开始反映此 Pod 对象的调度结果。

(12)kubelet 是在 Node 上面运行的进程,它也通过 List-Watch 的方式监听(Watch,通过https的6443端口)APIServer 发送的 Pod 更新的事件。kubelet 会尝试在当前节点上调用 Docker 启动容器,并将 Pod 以及容器的结果状态回送至 APIServer。

(13)APIServer 将 Pod 状态信息存入 etcd 中。在 etcd 确认写入操作成功完成后,APIServer将确认信息发送至相关的 kubelet,事件将通过它被接受。

#注意:在创建 Pod 的工作就已经完成了后,为什么 kubelet 还要一直监听呢?原因很简单,假设这个时候 kubectl 发命令,要扩充 Pod 副本数量,那么上面的流程又会触发一遍,kubelet 会根据最新的 Pod 的部署情况调整 Node 的资源。又或者 Pod 副本数量没有发生变化,但是其中的镜像文件升级了,kubelet 也会自动获取最新的镜像文件并且加载。

3.调度过程

Scheduler 是 kubernetes 的调度器,主要的任务是把定义的 pod 分配到集群的节点上。其主要考虑的问题如下:

(1)公平:如何保证每个节点都能被分配资源

(2)资源高效利用:集群所有资源最大化被使用

(3)效率:调度的性能要好,能够尽快地对大批量的 pod 完成调度工作

(4)灵活:允许用户根据自己的需求控制调度的逻辑

Sheduler 是作为单独的程序运行的,启动之后会一直监听 APIServer,获取 spec.nodeName 为空的 pod,对每个 pod 都会创建一个 binding,表明该 pod 应该放到哪个节点上。

调度分为几个部分:首先是过滤掉不满足条件的节点,这个过程称为预算策略(predicate);然后对通过的节点按照优先级排序,这个是优选策略(priorities);最后从中选择优先级最高的节点。如果中间任何一步骤有错误,就直接返回错误。

4.Predicate 的常见的算法

(1)PodFitsResources:节点上剩余的资源是否大于 pod 请求的资源odeName,检查节点名称是否和 NodeName 匹配。。

(2)PodFitsHost:如果 pod 指定了 N

(3)PodFitsHostPorts:节点上已经使用的 port 是否和 pod 申请的 port 冲突。

(4)PodSelectorMatches:过滤掉和 pod 指定的 label 不匹配的节点。

(5)NoDiskConflict:已经 mount 的 volume 和 pod 指定的 volume 不冲突,除非它们都是只读。

如果在 predicate 过程中没有合适的节点,pod 会一直在 pending 状态,不断重试调度,直到有节点满足条件。 经过这个步骤,如果有多个节点满足条件,就继续 priorities 过程:按照优先级大小对节点排序。

5.常见的优先级选项

(1)LeastRequestedPriority:通过计算CPU和Memory的使用率来决定权重,使用率越低权重越高。也就是说,这个优先级指标倾向于资源使用比例更低的节点。

(2)BalancedResourceAllocation:节点上 CPU 和 Memory 使用率越接近,权重越高。这个一般和上面的一起使用,不单独使用。比

如 node01 的 CPU 和 Memory 使用率 20:60,node02 的 CPU 和 Memory 使用率 50:50,虽然 node01 的总使用率比 node02 低,但

node02 的 CPU 和 Memory 使用率更接近,从而调度时会优选 node02。

(3)ImageLocalityPriority:倾向于已经有要使用镜像的节点,镜像总大小值越大,权重越高。

通过算法对所有的优先级项目和权重进行计算,得出最终的结果。

6.指定调度节点:

(1)pod.spec.nodeName 将 Pod 直接调度到指定的 Node 节点上,会跳过 Scheduler 的调度策略,该匹配规则是强制匹配

vim myapp.yaml

apiVersion: apps/v1

kind: Deployment

metadata:name: myapp

spec:replicas: 3selector:matchLabels:app: myapptemplate:metadata:labels:app: myappspec:nodeName: node01containers:- name: myappimage: soscscs/myapp:v1ports:- containerPort: 80kubectl apply -f myapp.yamlkubectl get pods -o wide

(2)查看详细事件(发现未经过 scheduler 调度分配)

kubectl describe pod myapp-699655c7fd-5z8bmpod.spec.nodeSelector:通过 kubernetes 的 label-selector 机制选择节点,由调度器调度策略匹配 label,然后调度 Pod 到目标节点,该匹配规则属于强制约束

(3)获取标签帮助

kubectl label --help

(4)需要获取 node 上的 NAME 名称

kubectl get node

(5)给对应的 node 设置标签分别为 exo=a 和 exo=b

kubectl label nodes node01 exo=a

kubectl label nodes node02 exo=b

(6)查看标签

kubectl get nodes --show-labels

(7)修改成 nodeSelector 调度方式

vim myapp1.yaml

apiVersion: apps/v1

kind: Deployment

metadata:name: myapp1

spec:replicas: 3selector:matchLabels:app: myapp1template:metadata:labels:app: myapp1spec:nodeSelector:exo: acontainers:- name: myapp1image: soscscs/myapp:v1ports:- containerPort: 80kubectl apply -f myapp1.yaml kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

10.244.1.39 node01 <none> <none>

myapp1 1/1 Running 1 24h 10.244.1.31 node01 <none> <none>

myapp1-88c6cf56f-b9644 1/1 Running 0 18s 10.244.1.43 node01 <none> <none>

myapp1-88c6cf56f-m578k 0/1 ContainerCreating 0 18s <none> node02 <none> <none>

myapp1-88c6cf56f-q8q8g 1/1 Running 0 18s 10.244.1.42 node01 <none> <none>

myapp2

(8)查看详细事件(通过事件可以发现要先经过 scheduler 调度分配)

kubectl describe pod myapp1-88c6cf56f-b9644

(9)修改一个 label 的值,需要加上 --overwrite 参数

kubectl label nodes node02 exo=a --overwrite

(10)删除一个 label,只需在命令行最后指定 label 的 key 名并与一个减号相连即可:

kubectl label nodes node02 exo-

(11)指定标签查询 node 节点

kubectl get node -l exo=a

二、亲和性

https://kubernetes.io/zh/docs/concepts/scheduling-eviction/assign-pod-node/

1.节点亲和性

pod.spec.nodeAffinity

preferredDuringSchedulingIgnoredDuringExecution:软策略

requiredDuringSchedulingIgnoredDuringExecution:硬策略

2.Pod 亲和性

pod.spec.affinity.podAffinity/podAntiAffinity

preferredDuringSchedulingIgnoredDuringExecution:软策略

requiredDuringSchedulingIgnoredDuringExecution:硬策略

3.键值运算关系

(1)In:label 的值在某个列表中 pending

(2)NotIn:label 的值不在某个列表中

(3)Gt:label 的值大于某个值

(4)Lt:label 的值小于某个值

(5)Exists:某个 label 存在

(6)DoesNotExist:某个 label 不存在

kubectl get nodes --show-labelsrequiredDuringSchedulingIgnoredDuringExecution:硬策略

mkdir /opt/affinity

cd /opt/affinity4.示例

vim pod1.yaml

apiVersion: v1

kind: Pod

metadata:name: affinitylabels:app: node-affinity-pod

spec:containers:- name: with-node-affinityimage: soscscs/myapp:v1affinity:nodeAffinity:requiredDuringSchedulingIgnoredDuringExecution:nodeSelectorTerms:- matchExpressions:- key: kubernetes.io/hostname #指定node的标签operator: NotIn #设置Pod安装到kubernetes.io/hostname的标签值不在values列表中的node上values:- node02kubectl apply -f pod1.yamlkubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

affinity 1/1 Running 0 13s 10.244.1.44 node01 <none> <none>kubectl delete pod --all && kubectl apply -f pod1.yaml && kubectl get pods -o wide#如果硬策略不满足条件,Pod 状态一直会处于 Pending 状态。

(2)preferredDuringSchedulingIgnoredDuringExecution:软策略

vim pod2.yaml

apiVersion: v1

kind: Pod

metadata:name: affinitylabels:app: node-affinity-pod

spec:containers:- name: with-node-affinityimage: soscscs/myapp:v1affinity:nodeAffinity:preferredDuringSchedulingIgnoredDuringExecution:- weight: 1 #如果有多个软策略选项的话,权重越大,优先级越高preference:matchExpressions:- key: kubernetes.io/hostnameoperator: Invalues:- node03kubectl apply -f pod2.yamlkubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

affinity 1/1 Running 0 5s 10.244.1.53 node02 <none> <none>

(3)把values:的值改成node01,则会优先在node01上创建Pod

kubectl delete pod --all && kubectl apply -f pod2.yaml && kubectl get pods -o wide

(4)如果把硬策略和软策略合在一起使用,则要先满足硬策略之后才会满足软策略

apiVersion: v1

kind: Pod

metadata:name: affinitylabels:app: node-affinity-pod

spec:containers:- name: with-node-affinityimage: soscscs/myapp:v1affinity:nodeAffinity:requiredDuringSchedulingIgnoredDuringExecution: #先满足硬策略,排除有kubernetes.io/hostname=node02标签的节点nodeSelectorTerms:- matchExpressions:- key: kubernetes.io/hostnameoperator: NotInvalues:- node02preferredDuringSchedulingIgnoredDuringExecution: #再满足软策略,优先选择有kgc=a标签的节点- weight: 1preference:matchExpressions:- key: kgcoperator: Invalues:- a

5.Pod亲和性与反亲和性

| 调度策略 | 匹配标签 | 操作符 | 拓扑域支持 | 调度目标 |

|---|---|---|---|---|

| nodeAffinity | 主机 | In, NotIn, Exists,DoesNotExist, Gt, Lt | 否 | 指定主机 |

| podAffinity | pod | In, NotIn, Exists,DoesNotExist | 是 | Pod与指定Pod同一拓扑域 |

| podAntiAffinity | pod | In, NotIn, Exists,DoesNotExist | 是 | Pod与指定Pod不在同一拓扑域 |

kubectl label nodes node01 exo=a

kubectl label nodes node02 exo=a

(1)创建一个标签为 app=myapp01 的 Pod

vim pod3.yaml

apiVersion: v1

kind: Pod

metadata:name: myapp01labels:app: myapp01

spec:containers:- name: with-node-affinityimage: soscscs/myapp:v1kubectl apply -f pod3.yamlkubectl get pods --show-labels -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES LABELS

myapp01 1/1 Running 0 37s 10.244.2.29 node01 <none> <none> app=myapp01

(2)使用 Pod 亲和性调度,创建多个 Pod 资源

vim pod4.yaml

apiVersion: v1

kind: Pod

metadata:name: myapp02labels:app: myapp02

spec:containers:- name: myapp02image: soscscs/myapp:v1affinity:podAffinity:requiredDuringSchedulingIgnoredDuringExecution:- labelSelector:matchExpressions:- key: appoperator: Invalues:- myapp01topologyKey: exo

#仅当节点和至少一个已运行且有键为“app”且值为“myapp01”的标签 的 Pod 处于同一拓扑域时,才可以将该 Pod 调度到节点上。 (更确切的说,如果节点 N 具有带有键 kgc 和某个值 V 的标签,则 Pod 有资格在节点 N 上运行,以便集群中至少有一个具有键 kgc 和值为 V 的节点正在运行具有键“app”和值 “myapp01”的标签的 pod。)

#topologyKey 是节点标签的键。如果两个节点使用此键标记并且具有相同的标签值,则调度器会将这两个节点视为处于同一拓扑域中。 调度器试图在每个拓扑域中放置数量均衡的 Pod。

#如果 kgc 对应的值不一样就是不同的拓扑域。比如 Pod1 在 kgc=a 的 Node 上,Pod2 在 kgc=b 的 Node 上,Pod3 在 kgc=a 的 Node 上,则 Pod2 和 Pod1、Pod3 不在同一个拓扑域,而Pod1 和 Pod3在同一个拓扑域。kubectl apply -f pod4.yamlkubectl get pods --show-labels -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES LABELS

affinity 1/1 Running 0 13m 10.244.2.28 node02 <none> <none> app=node-affinity-pod

myapp-699655c7fd-2qlhh 1/1 Running 0 14m 10.244.1.54 node01 <none> <none> app=myapp,pod-template-hash=699655c7fd

myapp-699655c7fd-68wzn 1/1 Running 0 14m 10.244.1.55 node01 <none> <none> app=myapp,pod-template-hash=699655c7fd

myapp-699655c7fd-r6bs5 1/1 Running 0 14m 10.244.1.56 node01 <none> <none> app=myapp,pod-template-hash=699655c7fd

myapp01 1/1 Running 0 10m 10.244.2.29 node02 <none> <none> app=myapp01

myapp02 0/1 Pending 0 49s <none> <none> <none> <none> app=myapp02

myapp1-88c6cf56f-qjn6b 1/1 Running 0 14m 10.244.1.58 node01 <none> <none> app=myapp1,pod-template-hash=88c6cf56f

myapp1-88c6cf56f-qpl6x 1/1 Running 0 14m 10.244.1.57 node01 <none> <none> app=myapp1,pod-template-hash=88c6cf56f

myapp1-88c6cf56f-sb9wz 1/1 Running 0 14m 10.244.1.59 node01 <none> <none> app=myapp1,pod-template-hash=88c6cf56f

nginx-deployment-9448647c5-bmjzx 1/1 Running 0 14m 10.244.2.27 node02 <none> <none> app=nginx-deployment,pod-template-hash=9448647c5

nginx-deployment-9448647c5-dhfhs 1/1 Running 0 14m 10.244.2.25 node02 <none> <none> app=nginx-deployment,pod-template-hash=9448647c5

nginx-deployment-9448647c5-hwhbv 1/1 Running 0 14m 10.244.2.26 node02 <none> <none> app=nginx-deployment,pod-template-hash=9448647c56.使用 Pod 反亲和性调度

(1)示例1

vim pod5.yaml

apiVersion: v1

kind: Pod

metadata:name: myapp10labels:app: myapp10

spec:containers:- name: myapp10image: soscscs/myapp:v1affinity:podAntiAffinity:preferredDuringSchedulingIgnoredDuringExecution:- weight: 100podAffinityTerm:labelSelector:matchExpressions:- key: appoperator: Invalues:- myapp01topologyKey: kubernetes.io/hostname#如果节点处于 Pod 所在的同一拓扑域且具有键“app”和值“myapp01”的标签, 则该 pod 不应将其调度到该节点上。 (如果 topologyKey 为 kubernetes.io/hostname,则意味着当节点和具有键 “app”和值“myapp01”的 Pod 处于相同的拓扑域,Pod 不能被调度到该节点上。)kubectl apply -f pod5.yamlkubectl get pods --show-labels -o wide

(2)示例2

vim pod6.yaml

apiVersion: v1

kind: Pod

metadata:name: myapp20labels:app: myapp20

spec:containers:- name: myapp20image: soscscs/myapp:v1affinity:podAntiAffinity:requiredDuringSchedulingIgnoredDuringExecution:- labelSelector:matchExpressions:- key: appoperator: Invalues:- myapp01topologyKey: exo//由于指定 Pod 所在的 node01 节点上具有带有键 kgc 和标签值 a 的标签,node02 也有这个kgc=a的标签,所以 node01 和 node02 是在一个拓扑域中,反亲和要求新 Pod 与指定 Pod 不在同一拓扑域,所以新 Pod 没有可用的 node 节点,即为 Pending 状态。

kubectl get pod --show-labels -owide

myapp01 1/1 Running 0 31m 10.244.2.29 node02 <none> <none> app=myapp01

myapp02 0/1 Pending 0 21m <none> <none> <none> <none> app=myapp02

myapp1-88c6cf56f-qjn6b 1/1 Running 0 34m 10.244.1.58 node01 <none> <none> app=myapp1,pod-template-hash=88c6cf56f

myapp1-88c6cf56f-qpl6x 1/1 Running 0 34m 10.244.1.57 node01 <none> <none> app=myapp1,pod-template-hash=88c6cf56f

myapp1-88c6cf56f-sb9wz 1/1 Running 0 34m 10.244.1.59 node01 <none> <none> app=myapp1,pod-template-hash=88c6cf56f

myapp10 1/1 Running 0 9m31s 10.244.1.60 node01 <none> <none> app=myapp10

myapp20 1/1 Running 0 49s 10.244.2.30 node02 <none> <none> app=myapp20三、污点(Taint) 和 容忍(Tolerations)

1.污点(Taint)

(1)节点亲和性,是Pod的一种属性(偏好或硬性要求),它使Pod被吸引到一类特定的节点。Taint 则相反,它使节点能够排斥一类特定的 Pod。

(2)Taint 和 Toleration 相互配合,可以用来避免 Pod 被分配到不合适的节点上。每个节点上都可以应用一个或多个 taint ,这表示对于那些不能容忍这些 taint 的 Pod,是不会被该节点接受的。如果将 toleration 应用于 Pod 上,则表示这些 Pod 可以(但不一定)被调度到具有匹配 taint 的节点上。

(3)使用 kubectl taint 命令可以给某个 Node 节点设置污点,Node 被设置上污点之后就和 Pod 之间存在了一种相斥的关系,可以让 Node 拒绝 Pod 的调度执行,甚至将 Node 已经存在的 Pod 驱逐出去。

(4)污点的组成格式如下:

key=value:effect 每个污点有一个 key 和 value 作为污点的标签,其中 value 可以为空,effect 描述污点的作用。

(5)当前 taint effect 支持如下三个选项:

- NoSchedule:表示 k8s 将不会将 Pod 调度到具有该污点的 Node 上

- PreferNoSchedule:表示 k8s 将尽量避免将 Pod 调度到具有该污点的 Node 上

- NoExecute:表示 k8s 将不会将 Pod 调度到具有该污点的 Node 上,同时会将 Node 上已经存在的 Pod 驱逐出去

kubectl get nodes

NAME STATUS ROLES AGE VERSION

master Ready master 11d v1.20.11

node01 Ready <none> 11d v1.20.11

node02 Ready <none> 11d v1.20.11

(2)master 就是因为有 NoSchedule 污点,k8s 才不会将 Pod 调度到 master 节点上

kubectl describe node master

......

Taints: node-role.kubernetes.io/master:NoSchedule#设置污点

kubectl taint node node01 key1=value1:NoSchedule#节点说明中,查找 Taints 字段

kubectl describe node node-name #去除污点

kubectl taint node node01 key1:NoSchedule-kubectl get pods -o wide

AME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

affinity 1/1 Running 0 36m 10.244.2.28 node02 <none> <none>

myapp-699655c7fd-2qlhh 1/1 Running 0 36m 10.244.1.54 node01 <none> <none>

myapp-699655c7fd-68wzn 1/1 Running 0 36m 10.244.1.55 node01 <none> <none>

myapp-699655c7fd-r6bs5 1/1 Running 0 36m 10.244.1.56 node01 <none> <none>

myapp01 1/1 Running 0 32m 10.244.2.29 node02 <none> <none>

myapp02 0/1 Pending 0 23m <none> <none> <none> <none>

myapp1-88c6cf56f-qjn6b 1/1 Running 0 36m 10.244.1.58 node01 <none> <none>

myapp1-88c6cf56f-qpl6x 1/1 Running 0 36m 10.244.1.57 node01 <none> <none>

myapp1-88c6cf56f-sb9wz 1/1 Running 0 36m 10.244.1.59 node01 <none> <none>

myapp10 1/1 Running 0 11m 10.244.1.60 node01 <none> <none>

myapp20 1/1 Running 0 2m43s 10.244.2.30 node02 <none> <none>

nginx-deployment-9448647c5-bmjzx 1/1 Running 0 36m 10.244.2.27 node02 <none> <none>

nginx-deployment-9448647c5-dhfhs 1/1 Running 0 36m 10.244.2.25 node02 <none> <none>

nginx-deployment-9448647c5-hwhbv 1/1 Running 0 36m 10.244.2.26 node02 <none> <none>kubectl taint node node02 check=mycheck:NoExecute

(3)查看 Pod 状态,会发现 node02 上的 Pod 已经被全部驱逐(注:如果是 Deployment 或者 StatefulSet 资源类型,为了维持副本数

量则会在别的 Node 上再创建新的 Pod)

kubectl get pods -o wide

2.容忍(Tolerations)

(1)概述:设置了污点的 Node 将根据 taint 的 effect:NoSchedule、PreferNoSchedule、NoExecute 和 Pod 之间产生互斥的关系,Pod 将在一定程度上不会被调度到 Node 上。但我们可以在 Pod 上设置容忍(Tolerations),意思是设置了容忍的 Pod 将可以容忍污点的存在,可以被调度到存在污点的 Node 上。

kubectl taint node node01 check=mycheck:NoExecutevim pod3.yaml

apiVersion: v1

kind: Pod

metadata:name: myapp01labels:app: myapp01

spec:containers:- name: with-node-affinityimage: soscscs/myapp:v1tolerations:- key: "check"operator: "Equal"value: "mycheck"effect: "NoExecute"tolerationSeconds: 3600kubectl apply -f pod3.yaml

#其中的 key、vaule、effect 都要与 Node 上设置的 taint 保持一致

#operator 的值为 Exists 将会忽略 value 值,即存在即可

#tolerationSeconds 用于描述当 Pod 需要被驱逐时可以在 Node 上继续保留运行的时间

(2)在两个 Node 上都设置了污点后,此时 Pod 将无法创建成功

kubectl get pods -o wide

(3)修改

vim pod3.yaml

apiVersion: v1

kind: Pod

metadata:name: myapp01labels:app: myapp01

spec:containers:- name: with-node-affinityimage: soscscs/myapp:v1tolerations:- key: "check"operator: "Equal"value: "mycheck"effect: "NoExecute"tolerationSeconds: 3600

#其中的 key、vaule、effect 都要与 Node 上设置的 taint 保持一致

#operator 的值为 Exists 将会忽略 value 值,即存在即可

#tolerationSeconds 用于描述当 Pod 需要被驱逐时可以在 Node 上继续保留运行的时间kubectl apply -f pod3.yaml

(4)在设置了容忍之后,Pod 创建成功

kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

myapp01 1/1 Running 0 10m 10.244.1.5 node01 <none> <none>

(5)其它注意事项

① 当不指定 key 值时,表示容忍所有的污点 key

tolerations:

operator: “Exists”

② 当不指定 effect 值时,表示容忍所有的污点作用

tolerations:

key: “key”

operator: “Exists”

③ 有多个 Master 存在时,防止资源浪费,可以如下设置

kubectl taint node Master-Name node-role.kubernetes.io/master=:PreferNoSchedule

(6)如果某个 Node 更新升级系统组件,为了防止业务长时间中断,可以先在该 Node 设置 NoExecute 污点,把该 Node 上的 Pod 都驱逐出去

kubectl taint node node01 check=mycheck:NoExecute

(7)此时如果别的 Node 资源不够用,可临时给 Master 设置 PreferNoSchedule 污点,让 Pod 可在 Master 上临时创建

kubectl taint node master node-role.kubernetes.io/master=:PreferNoSchedule

(8)待所有 Node 的更新操作都完成后,再去除污点

kubectl taint node node01 check=mycheck:NoExecute-

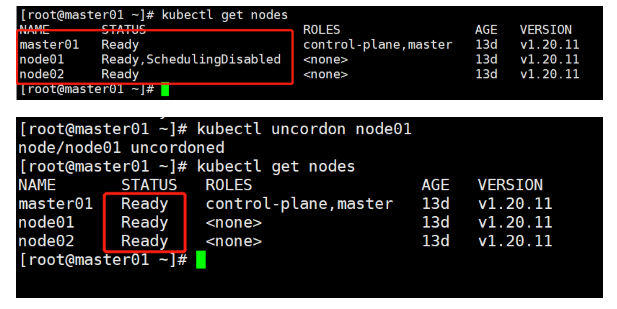

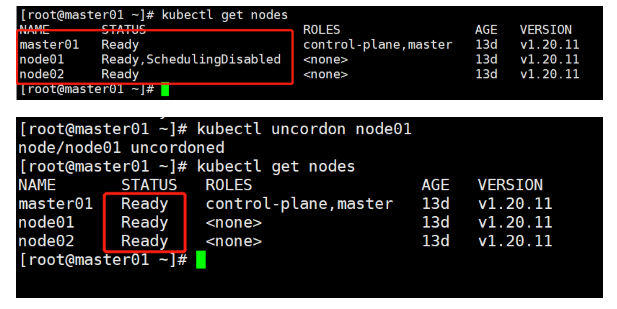

3.维护操作

(1)cordon 和 drain

##对节点执行维护操作:

kubectl get nodes

(2)将 Node 标记为不可调度的状态,这样就不会让新创建的 Pod 在此 Node 上运行

kubectl cordon <NODE_NAME> #该node将会变为SchedulingDisabled状态//kubectl drain 可以让 Node 节点开始释放所有 pod,并且不接收新的 pod 进程。drain 本意排水,意思是将出问题的 Node 下的 Pod 转移到其它 Node 下运行

kubectl drain <NODE_NAME> --ignore-daemonsets --delete-local-data --force--ignore-daemonsets:无视 DaemonSet 管理下的 Pod。

--delete-local-data:如果有 mount local volume 的 pod,会强制杀掉该 pod。

--force:强制释放不是控制器管理的 Pod,例如 kube-proxy。注:执行 drain 命令,会自动做了两件事情:

(1)设定此 node 为不可调度状态(cordon)

(2)evict(驱逐)了 Pod//kubectl uncordon 将 Node 标记为可调度的状态

kubectl uncordon <NODE_NAME>

4.Pod启动阶段(相位 phase)

Pod 创建完之后,一直到持久运行起来,中间有很多步骤,也就有很多出错的可能,因此会有很多不同的状态。

一般来说,pod 这个过程包含以下几个步骤:

(1)调度到某台 node 上。kubernetes 根据一定的优先级算法选择一台 node 节点将其作为 Pod 运行的 node

(2)拉取镜像

(3)挂载存储配置等

(4)运行起来。如果有健康检查,会根据检查的结果来设置其状态。

5.phase 的可能状态有:

(1)Pending:表示APIServer创建了Pod资源对象并已经存入了etcd中,但是它并未被调度完成(比如还没有调度到某台node上),或者仍然处于从仓库下载镜像的过程中。

(2)Running:Pod已经被调度到某节点之上,并且Pod中所有容器都已经被kubelet创建。至少有一个容器正在运行,或者正处于启动或者重启状态(也就是说Running状态下的Pod不一定能被正常访问)。

(3)Succeeded:有些pod不是长久运行的,比如job、cronjob,一段时间后Pod中的所有容器都被成功终止,并且不会再重启。需要反馈任务执行的结果。

(4)Failed:Pod中的所有容器都已终止了,并且至少有一个容器是因为失败终止。也就是说,容器以非0状态退出或者被系统终止,比如 command 写的有问题。

(5)Unknown:表示无法读取 Pod 状态,通常是 kube-controller-manager 无法与 Pod 通信。

6.故障排除步骤

(1)查看Pod事件

kubectl describe TYPE NAME_PREFIX

(2)查看Pod日志(Failed状态下)

kubectl logs <POD_NAME> [-c Container_NAME]

(3)进入Pod(状态为running,但是服务没有提供)

kubectl exec –it <POD_NAME> bash

(4)查看集群信息

kubectl get nodes

(5)发现集群状态正常

kubectl cluster-info

(6)查看kubelet日志发现

journalctl -xefu kubelet

四、总结

1.list-watch

controller-manager,scheduler,kubelet监听apiserver 发出的事件,apiserver 监听 etcd 发出的事件,

2.scheduler

预选策略:通过调度算法过滤掉不满足的节点

优选策略:通过优先级选项给满足调度条件的节点进行优先级和权重排序,选择优先级最高的节点

3.pod 调度到指定节点的方法

配置文件中指定nodename

nodeSelector

4.节点亲和性和反亲和性

节点亲和性 硬策略 (必要条件) 软策略(优先级)

pod亲和性 和满足标签的条件的pod 在同一个拓步域

pod反亲和性 和满足标签的条件的pod 不在同一个拓步域

5.相关标签命令

kubectl get <资源类型> <资源名称> --show-labels

kubectl get <资源类型> -l <标签 key> [=<标签 value>]

kubectl label <资源类型> <资源名称> key-value

kubectl label <资源类型> <资源名称> key=vaule --overrwite

kubect1 label <资源光型> <资源名称> key-

6.污点和容忍

(1)设置和取消

kubectl taint node <节点名称> key=value:effect

effect:NoSchedule PeferNoSchedule Noexecute

kubectl taint node <节点名称> key:effect-

(2)调度

kubectl cordon <节点名称>不可调度

kubectl drain <节点名称> 不可调度+驱逐

7.Pod启动阶段(相位) 5个状态

(1)pendding:pod已创建且写入etcd,但是未完成调度或者仍处于镜像拉取过程中

(2)running:正常状态

(3)Succeeded:短期 (非长久运行的) Pod的正常退出

(4)failed:短期 (非长久运行的) pod 异常退出

(5)unkown:controller-manager 无法与pod 正常通信

8.排除故障方法

(1)kubectl describe

(2)kubectl logs

(3)kubectI exec -it

(4)kubectl cluster-info

(5)journalctl -u 服务进程名 (比如kubelet)

相关文章:

K8S群集调度

K8S群集调度 一、调度约束1.概述2.Pod 启动典型创建过程(工作机制 )3.调度过程4.Predicate 的常见的算法5.常见的优先级选项6.指定调度节点: 二、亲和性1.节点亲和性2.Pod 亲和性3.键值运算关系4.示例5.Pod亲和性与反亲和性6.使用 Pod 反亲和…...

完美解决Echarts X坐标轴下方文字最后一个字体加粗颜色加深的问题

之前用Echarts画图的时候,X坐标轴最后一个字存在自动加粗的问题。也是在网上找过解决办法没有找到,后面自己研究明白了后,在某篇文章下评论了如何解决。但是好像大家没有看评论的习惯,所以单独拿出来一篇文章,希望能给…...

WebGL 计算平行光、环境光下的漫反射光颜色

目录 光照原理 光源类型 平行光 点光源 环境光 反射类型 漫反射 漫反射光颜色 计算公式 环境反射 环境反射光颜色 表面的反射光颜色(漫反射和环境反射同时存在时)计算公式 平行光下的漫反射 根据光线和法线方向计算入射角θ(以便…...

解决SpringMVC在JSP页面取不到ModelAndView中数据

版权声明 本文原创作者:谷哥的小弟作者博客地址:http://blog.csdn.net/lfdfhl 问题描述 ModelAndView携带数据跳转到指定JSP页面后在该页面通过EL表达式取不到原本存放在ModelAndView中的数据。 问题原因 在IDEA中创建Maven工程时web.xml中默认的约束…...

Spring 6.0 新特性

文章目录 Spring的发展历史AOTGraalVMSpringBoot实战AOTRuntimeHints案例分析RuntimeHintsRegistrar SpringBoot中AOT核心代码 Spring的发展历史 AOT Spring 6.0的新特性Ahead of Time(AOT)编译是一种技术,可以提前将Spring应用程序编译成原…...

计算机竞赛 深度学习+opencv+python实现昆虫识别 -图像识别 昆虫识别

文章目录 0 前言1 课题背景2 具体实现3 数据收集和处理3 卷积神经网络2.1卷积层2.2 池化层2.3 激活函数:2.4 全连接层2.5 使用tensorflow中keras模块实现卷积神经网络 4 MobileNetV2网络5 损失函数softmax 交叉熵5.1 softmax函数5.2 交叉熵损失函数 6 优化器SGD7 学…...

软件过程能力成熟度评估——CSMM认证

CSMM认证又称为“软件过程能力过程成熟度评估”,由中国电子技术标准化研究院联合五十余家产学研用相关方结合我国实际,自主制定的团体标准,于2021年6月8号发布,目的是为了帮助国内软件企业对自身的软件能力进行评估和判断…...

学内核之二十一:系统调用栈结构分析

目录 一 构建分析环境 二 栈的位置 三 栈开头8字节 四 寄存器环境 五 R4和R5 六 如何确定系统调用的具体函数 一 构建分析环境 为了分析方便,做了如下测试环境: 内核实现一个简单的创建字符设备的驱动 应用层实现一个c程序,操作为打开内…...

互联网3.0 数字原生——数物虚实多维细粒度泛在融合

随着计算机、宽带网、通信技术的飞速发展,互联网技术和软硬件系统也不断演进,催生了一场前所未有的数字化革命。从Web1.0到Web3.0,以及虚拟现实、人工智能和数字孪生等领域的崛起,每一步都勾画出了一个崭新的数字未来,…...

实现AIGC更好的数据存力,这家科技巨头为我们指明了方向

存力即数据存储能力 蕴藏着巨大的发展机会 【全球存储观察 | 热点关注】 2023年,全球被ChatGPT的热潮席卷,拥抱AIGC的创新赛道成为众多企业的新选择。 全球存储观察分析指出,影响AIGC发展的三大因素也日益凸显,即算…...

企业如何在抖音上搞到TOB潜在精准客户流量?

我们都知道,现在互联网上流量都被集中了几个大的平台里。而抖音,一定是绕不开那个!图片在公众号:白杨SEO上去看。 抖音,在很多人的传统印象里,还只是一个娱乐短视频APP,用来打发时间而已。事实…...

JeecgBoot v3.5.5 版本发布,性能大升级版本—开源免费的低代码开发平台

项目介绍 JeecgBoot是一款企业级的低代码平台!前后端分离架构 SpringBoot2.x,SpringCloud,Ant Design&Vue3,Mybatis-plus,Shiro,JWT 支持微服务。强大的代码生成器让前后端代码一键生成! JeecgBoot引领…...

:CF444E)

与树上边权、连通块、二分块相关的问题(抓住各连通块之间的联系,考虑增量):CF444E

https://www.luogu.com.cn/problem/CF444E 首先肯定二分 然后是棵树,所以考虑按顺序枚举边权 然后肯定会有连通块和并查集 考虑现在场上有多个连通块,我们只保留大于 m i d mid mid 的边 则每个连通块都必须往外连边 一个很朴素的思路是判定每个连…...

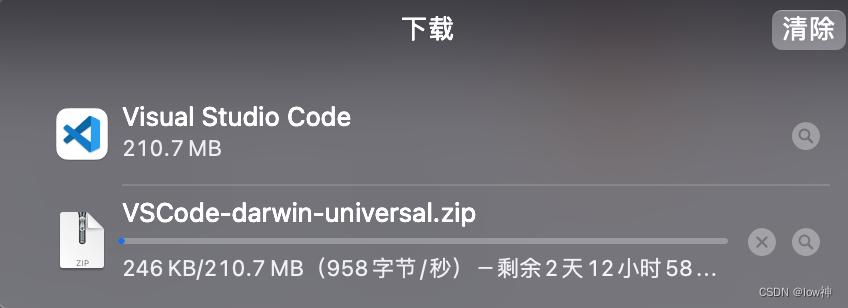

解决VSCode下载速度很慢

这是VSCode的官网: Visual Studio Code - Code Editing. Redefined 按照官网的下载链接,速度实在是感人! 解决办法也很简单,把链接换为CDN加速的链接 把下载链接中的az764295.vo.msecnd.net 替换为👉 vscode.cdn.azu…...

悬赏算命测算源码可以用二维码收款 可以直接拿来运营

首发悬赏算命测算源码可以用二维码收款 可以直接拿来运营吸金!用户可以通过发布悬赏赏金算命,也可以通过升级发布测算任务来吸金 测试环境:php5.6apache2.4mysq5.6 安装教程: 测试环境:php5.6apache2.4mysq5.6 安装&…...

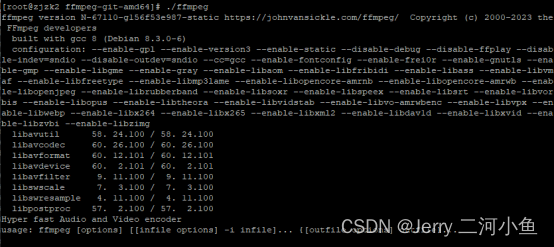

在Linux中安装nginx-1.20.1+php-7.4.28(增加扩展)

NginxPHP安装在公网IP为x.x.x.x的服务器上 需要下载安装的软件版本:nginx-1.20.1php-7.4.28 需要增加的PHP扩展如下: 在编译安装php-7.4.28时加上的pcntl; 单独下载安装的Wxwork_finance_sdk;(在编译安装php-7.4.2…...

使用vue-cli搭建SPA项目

一.SPA项目的构建 前提 nodeJS环境已经搭建完毕 node -v npm -v 什么是SPA项目 SPA(Single Page Application)项目是一种使用单页面架构的Web应用项目。在SPA项目中,整个应用程序只有一个HTML页面,通过动态加载数据和更新DOM来实…...

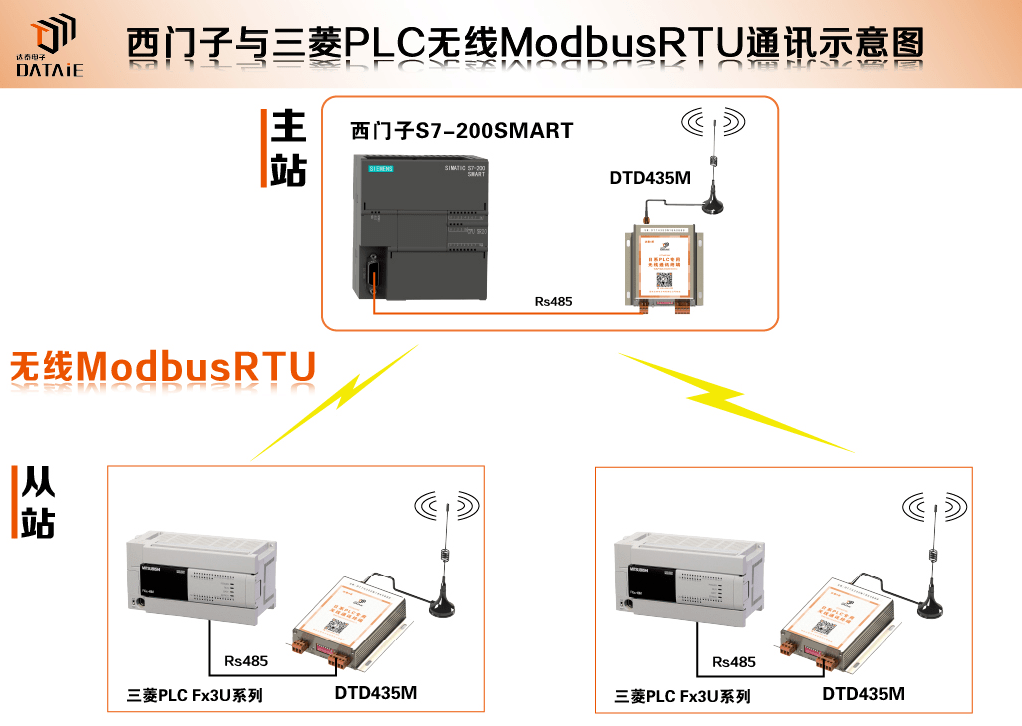

PLC串口通讯和通讯接口知识汇总

在使用PLC的时候会接触到很多的通讯协议以及通讯接口,最基本的PLC串口通讯和基本的通讯接口你都了解吗? 一、什么是串口通讯? 串口是一种接口标准,是计算机上一种非常通用设备通信的协议。它规定了接口的电气标准,没…...

Vue基础入门---详细简介

一,对Vue的概念 1.1 什么是Vue ? 一种流行的JavaScript前端框架,用于构建交互式的Web应用程序。它以简洁、灵活和高效的特性而受到广泛欢迎。Vue采用了一种响应式的数据绑定机制,使得数据的变化能够自动更新相关的DOM元素&#x…...

Qt重写QTreeWidget实现拖拽

介绍 此文章记录QTreeWidget的重写进度,暂时停滞使用,重写了QTreeWidget的拖拽功能,和绘制功能,自定义了数据结构,增加复制,粘贴,删除,准备实现动态刷新数据支持千万数据动态刷新&a…...

)

用Python+OpenCV手把手实现Prewitt边缘检测(附完整代码与效果对比图)

用PythonOpenCV手把手实现Prewitt边缘检测(附完整代码与效果对比图) 边缘检测是计算机视觉中最基础也最关键的预处理步骤之一。想象一下,当你需要让计算机"看清"一张照片中的物体轮廓时,边缘检测算法就是它的"视觉…...

基于Arduino的模块化DIY智能时钟:从RTC到RGB LED的完整实现

1. 项目概述:打造一台高度可定制的DIY RGB LED时钟如果你和我一样,对市面上千篇一律的电子钟感到审美疲劳,同时又对Arduino和电子DIY充满热情,那么这个项目可能就是为你准备的。我们不是在简单地组装一个套件,而是在亲…...

2026年,本地精准营销高性价比服务商来袭,你还不了解一下?

在本地商业竞争日益激烈的2026年,实体店面临着诸多挑战,引流难、成本高、复购率低等问题困扰着众多商家。而中粤(广州)信息科技有限公司作为本地精准营销的高性价比服务商,正以其独特的优势和卓越的服务,为…...

Vue3 图片标框功能实现方案

基于 Vue3 组合式 API 的图片标框(画框、标注、选框)完整实现,核心逻辑封装在 GetBoxes 组件里,复制就能用 一、功能说明 ✅ 在图片上鼠标拖拽画矩形框 ✅ 实时显示框坐标(x, y, width, height) ✅ 支持多…...

账务台账数据

银行里说的 “账务台账数据”,本质就是按会计规则把每笔业务逐笔、分户、分科目记下来的完整明细流水 余额 辅助信息,核心是 “可逐笔追溯、可对账、可审计” 的一套明细数据。下面用通俗、具体的方式拆开说:一、银行 “账务台账” 到底是什…...

)

YOLOv8晶圆体缺识别检测系统(项目源码+YOLO数据集+模型权重+UI界面+python+深度学习+环境配置)

摘要 晶圆制造过程中的缺陷检测是保证芯片良率的关键环节。本文基于YOLOv8目标检测算法,构建了一套针对晶圆表面9类典型缺陷的自动检测系统。所识别的缺陷类型包括:Center、Donut、Edge-Loc、Edge-Ring、Loc、Near-full、None、Random、Scratch。模型在…...

基于雷达与光敏传感器的低功耗智能窗防设备设计与实现

1. 项目概述:一个基于雷达与光敏的智能窗防设备几年前,我因为一次短暂的出差,家里空置了几天,回来后就一直琢磨着怎么给家里的窗户加点“动静”。市面上的智能安防摄像头固然好,但要么需要复杂的布线,要么云…...

Java项目中如何提升整体系统性能?

性能优化可以说是我们程序员的必修课,如果你想要跳出CRUD的苦海,成为一个更“高级”的程序员的话,性能优化这一关你是无论无何都要去面对的。为了提升系统性能,开发人员可以从系统的各个角度和层次对系统进行优化。除了最常见的代…...

DIY智能USB充电器:基于电流检测与双稳态继电器的零功耗节能方案

1. 项目概述:打造一款智能、节能的USB手机充电器作为一名电子爱好者,我经常折腾各种电源项目。市面上很多手机充电器,包括一些原装货,都存在一个通病:手机充满电后,充电器依然插在插座上,内部电…...

)

Sora 2 GIF导出速度提升300%?20年多媒体架构师亲授GPU加速转码链路(CUDA 12.4 + cuVID硬编实测)

更多请点击: https://kaifayun.com 第一章:Sora 2 GIF导出方法概览 Sora 2 并非 OpenAI 官方发布的模型,当前(截至2024年)并无名为“Sora 2”的公开产品。因此,所谓“Sora 2 GIF导出”实为社区对视频生成工…...