大数据框架之Hive:第6章 查询

第6章 查询

6.1 基础语法

1)官网地址

https://cwiki.apache.org/confluence/display/Hive/LanguageManual+Select

2)查询语句语法:

SELECT [ALL | DISTINCT] select_expr, select_expr, ...FROM table_reference -- 从什么表查[WHERE where_condition] -- 过滤[GROUP BY col_list] -- 分组查询[HAVING col_list] -- 分组后过滤[ORDER BY col_list] -- 排序[CLUSTER BY col_list| [DISTRIBUTE BY col_list] [SORT BY col_list]][LIMIT number] -- 限制输出的行数

6.2 基本查询(Select…From)

6.2.1 数据准备

(0)原始数据

①在/opt/module/hive/datas/路径上创建dept.txt文件,并赋值如下内容:

部门编号 部门名称 部门位置id

[atguigu@hadoop102 datas]# vim dept.txt10 行政部 1700

20 财务部 1800

30 教学部 1900

40 销售部 1700

②在/opt/module/hive/datas/路径上创建emp.txt文件,并赋值如下内容:

员工编号 姓名 岗位 薪资 部门

[atguigu@hadoop102 datas]# vim emp.txt7369 张三 研发 800.00 30

7499 李四 财务 1600.00 20

7521 王五 行政 1250.00 10

7566 赵六 销售 2975.00 40

7654 侯七 研发 1250.00 30

7698 马八 研发 2850.00 30

7782 金九 \N 2450.0 30

7788 银十 行政 3000.00 10

7839 小芳 销售 5000.00 40

7844 小明 销售 1500.00 40

7876 小李 行政 1100.00 10

7900 小元 讲师 950.00 30

7902 小海 行政 3000.00 10

7934 小红明 讲师 1300.00 30

(1)创建部门表

hive (default)>

create table if not exists dept(deptno int, -- 部门编号dname string, -- 部门名称loc int -- 部门位置

)

row format delimited fields terminated by '\t';

(2)创建员工表

hive (default)>

create table if not exists emp(empno int, -- 员工编号ename string, -- 员工姓名job string, -- 员工岗位(大数据工程师、前端工程师、java工程师)sal double, -- 员工薪资deptno int -- 部门编号

)

row format delimited fields terminated by '\t';

(3)导入数据

hive (default)>

load data local inpath '/opt/module/hive/datas/dept.txt' into table dept;

load data local inpath '/opt/module/hive/datas/emp.txt' into table emp;

6.2.2 全表和特定列查询

1)全表查询

hive (default)> select * from emp;

2)选择特定列查询

hive (default)> select empno, ename from emp;

注意:

(1)SQL 语言大小写不敏感。

(2)SQL 可以写在一行或者多行。

(3)关键字不能被缩写也不能分行。

(4)各子句一般要分行写。

(5)使用缩进提高语句的可读性。

6.2.3 列别名

1)重命名一个列

2)便于计算

3)紧跟列名,也可以在列名和别名之间加入关键字‘AS’

4)案例实操

查询名称和部门。

hive (default)>

select ename AS name, deptno dn

from emp;

6.2.4 Limit语句

典型的查询会返回多行数据。limit子句用于限制返回的行数。

hive (default)> select * from emp limit 5;

hive (default)> select * from emp limit 2,3; -- 表示从第2行开始,向下抓取3行

6.2.5 Where语句

1)使用where子句,将不满足条件的行过滤掉

2)where子句紧随from子句

3)案例实操

查询出薪水大于1000的所有员工。

hive (default)> select * from emp where sal > 1000;

注意:where子句中不能使用字段别名。

6.2.6 关系运算函数

1)基本语法

如下操作符主要用于where和having语句中。

| 操作符 | 支持的数据类型 | 描述 |

|---|---|---|

| A=B | 基本数据类型 | 如果A等于B则返回true,反之返回false |

| A<=>B | 基本数据类型 | 如果A和B都为null或者都不为null,则返回true,如果只有一边为null,返回false |

| A<>B, A!=B | 基本数据类型 | A或者B为null则返回null;如果A不等于B,则返回true,反之返回false |

| A<B | 基本数据类型 | A或者B为null,则返回null;如果A小于B,则返回true,反之返回false |

| A<=B | 基本数据类型 | A或者B为null,则返回null;如果A小于等于B,则返回true,反之返回false |

| A>B | 基本数据类型 | A或者B为null,则返回null;如果A大于B,则返回true,反之返回false |

| A>=B | 基本数据类型 | A或者B为null,则返回null;如果A大于等于B,则返回true,反之返回false |

| A [not] between B and C | 基本数据类型 | 如果A,B或者C任一为null,则结果为null。如果A的值大于等于B而且小于或等于C,则结果为true,反之为false。如果使用not关键字则可达到相反的效果。 |

| A is null | 所有数据类型 | 如果A等于null,则返回true,反之返回false |

| A is not null | 所有数据类型 | 如果A不等于null,则返回true,反之返回false |

| in(数值1,数值2) | 所有数据类型 | 使用 in运算显示列表中的值 |

| A [not] like B | string 类型 | B是一个SQL下的简单正则表达式,也叫通配符模式,如果A与其匹配的话,则返回true;反之返回false。B的表达式说明如下:‘x%’表示A必须以字母‘x’开头,‘%x’表示A必须以字母‘x’结尾,而‘%x%’表示A包含有字母‘x’,可以位于开头,结尾或者字符串中间。如果使用not关键字则可达到相反的效果。 |

| A rlike B, A regexp B | string 类型 | B是基于java的正则表达式,如果A与其匹配,则返回true;反之返回false。匹配使用的是JDK中的正则表达式接口实现的,因为正则也依据其中的规则。例如,正则表达式必须和整个字符串A相匹配,而不是只需与其字符串匹配。 |

6.2.7 逻辑运算函数

1)基本语法(and/or/not)

| 操作符 | 含义 |

|---|---|

| and | 逻辑并 |

| or | 逻辑或 |

| not | 逻辑否 |

2)案例实操

(1)查询薪水大于1000,部门是30

hive (default)>

select *

from emp

where sal > 1000 and deptno = 30;

(2)查询薪水大于1000,或者部门是30

hive (default)>

select *

from emp

where sal>1000 or deptno=30;

(3)查询除了20部门和30部门以外的员工信息

hive (default)>

select *

from emp

where deptno not in(30, 20);

6.2.8 聚合函数

1)语法

count(*),表示统计所有行数,包含null值;

count(某列),表示该列一共有多少行,不包含null值;

max(),求最大值,不包含null,除非所有值都是null;

min(),求最小值,不包含null,除非所有值都是null;

sum(),求和,不包含null。

avg(),求平均值,不包含null。

2)案例实操

(1)求总行数(count)

hive (default)> select count(*) cnt from emp;

**注:**设置为本地模式,测试会快。set mapreduce.framework.name=local;

注:count(*)和count(empno)的区别:count(empno)的时候,如果empno为null的时候不会统计在内

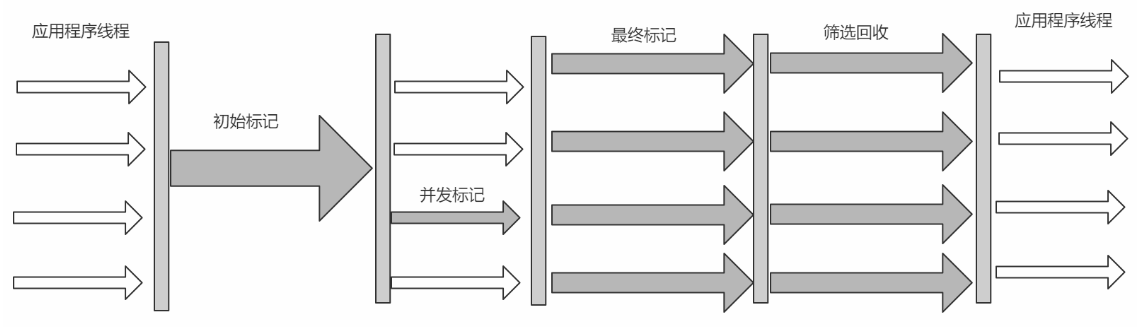

hive sql执行过程:

(2)求工资的最大值(max)

hive (default)> select max(sal) max_sal from emp;

注:max不统计sal为null的值

hive sql执行过程:

(3)求工资的最小值(min)

hive (default)> select min(sal) min_sal from emp;

注:min不统计sal为null的值

hive sql执行过程:

(4)求工资的总和(sum)

hive (default)> select sum(sal) sum_sal from emp;

注:sum不统计sal为null的值

hive sql执行过程:

(5)求工资的平均值(avg)

hive (default)> select avg(sal) avg_sal from emp;

注:avg不统计sal为null的值

hive sql执行过程:

6.3 分组

6.3.1 Group By语句

Group By语句通常会和聚合函数一起使用,按照一个或者多个列队结果进行分组,然后对每个组执行聚合操作。

1)案例实操:

(1)计算emp表每个部门的平均工资。

hive (default)>

select t.deptno, avg(t.sal) avg_sal

from emp t

group by t.deptno;

hive sql执行过程:

(2)计算emp每个部门中每个岗位的最高薪水。

hive (default)>

select t.deptno, t.job, max(t.sal) max_sal

from emp t

group by t.deptno, t.job;

hive sql执行过程:

6.3.2 Having语句

1)having与where不同点

(1)where后面不能写分组聚合函数,而having后面可以使用分组聚合函数。

(2)having只用于group by分组统计语句。

2)案例实操

(1)求每个部门的平均薪水大于2000的部门

①求每个部门的平均工资。

hive (default)>

select deptno, avg(sal)

from emp

group by deptno;

hive sql执行过程:

②求每个部门的平均薪水大于2000的部门。

hive (default)>

select deptno, avg(sal) avg_sal

from emp

group by deptno

having avg_sal > 2000;

hive sql执行过程:

6.4 Join语句

6.4.1 等值Join

Hive支持通常的sql join语句,但是只支持等值连接,不支持非等值连接(2.x版本之前)。

1)案例实操

(1)根据员工表和部门表中的部门编号相等,查询员工编号、员工名称和部门名称。

hive (default)>

select e.empno, e.ename, d.dname

from emp e

join dept d

on e.deptno = d.deptno;

hive sql执行过程:

6.4.2 表的别名

1)好处

(1)使用别名可以简化查询。

(2)区分字段的来源。

2)案例实操

合并员工表和部门表。

hive (default)>

select e.*,d.*

from emp e

join dept d

on e.deptno = d.deptno;

6.4.3 内连接

内连接:只有进行连接的两个表中都存在与连接条件相匹配的数据才会被保留下来。

hive (default)>

select e.empno, e.ename, d.deptno

from emp e

join dept d

on e.deptno = d.deptno;

6.4.4 左外连接

左外连接:join操作符左边表中符合where子句的所有记录将会被返回。

hive (default)>

select e.empno, e.ename, d.deptno

from emp e

left join dept d

on e.deptno = d.deptno;

6.4.5 右外连接

右外连接:join操作符右边表中符合where子句的所有记录将会被返回。

hive (default)>

select e.empno, e.ename, d.deptno

from emp e

right join dept d

on e.deptno = d.deptno;

6.4.6 满外连接

满外连接:将会返回所有表中符合where语句条件的所有记录。如果任一表的指定字段没有符合条件的值的话,那么就使用null值替代。

hive (default)>

select e.empno, e.ename, d.deptno

from emp e

full join dept d

on e.deptno = d.deptno;

6.4.7 多表连接

注意:连接n个表,至少需要n-1个连接条件。例如:连接三个表,至少需要两个连接条件。

数据准备,在/opt/module/hive/datas/下:vim location.txt

部门位置id 部门位置

[atguigu@hadoop102 datas]# vim location.txt1700 北京

1800 上海

1900 深圳

1)创建位置表

hive (default)>

create table if not exists location(loc int, -- 部门位置idloc_name string -- 部门位置

)

row format delimited fields terminated by '\t';

2)导入数据

hive (default)> load data local inpath '/opt/module/hive/datas/location.txt' into table location;

3)多表连接查询

hive (default)>

select e.ename, d.dname, l.loc_name

from emp e

join dept d

on d.deptno = e.deptno

join location l

on d.loc = l.loc;

大多数情况下,Hive会对每对join连接对象启动一个MapReduce任务。本例中会首先启动一个MapReduce job对表e和表d进行连接操作,然后会再启动一个MapReduce job将第一个MapReduce job的输出和表l进行连接操作。

注意:为什么不是表d和表l先进行连接操作呢?这是因为Hive总是按照从左到右的顺序执行的。

6.4.8 笛卡尔集

1)笛卡尔集会在下面条件下产生

(1)省略连接条件

(2)连接条件无效

(3)所有表中的所有行互相连接

2)案例实操

hive (default)>

select empno, dname

from emp, dept;hive (default)>

select empno, dname

from emp join dept

where 1=1;hive (default)>

select empno, dname

from emp join dept;

hive sql执行过程:

6.4.9 联合(union & union all)

1)union&union all上下拼接

union和union all都是上下拼接sql的结果,这点是和join有区别的,join是左右关联,union和union all是上下拼接。union去重,union all不去重。

union和union all在上下拼接sql结果时有两个要求:

(1)两个sql的结果,列的个数必须相同

(2)两个sql的结果,上下所对应列的类型必须一致

2)案例实操

将员工表30部门的员工信息和40部门的员工信息,利用union进行拼接显示。

hive (default)>

select *

from emp

where deptno=30

union

select *

from emp

where deptno=40;

6.5 排序

6.5.1 全局排序(Order By)

Order By:全局排序,只有一个Reduce。

1)使用Order By子句排序

asc(ascend):升序(默认)

desc(descend):降序

2)Order By子句在select语句的结尾

3)基础案例实操

(1)查询员工信息按工资升序排列

hive (default)>

select *

from emp

order by sal;

hive sql执行过程:

(2)查询员工信息按工资降序排列

hive (default)>

select *

from emp

order by sal desc;

4)按照别名排序案例实操

按照员工薪水的2倍排序。

hive (default)>

select ename, sal * 2 twosal

from emp

order by twosal;

hive sql执行过程:

5)多个列排序案例实操

按照部门和工资升序排序。

hive (default)>

select ename, deptno, sal

from emp

order by deptno, sal;

hive sql执行过程:

6.5.2 每个Reduce内部排序(Sort By)

Sort By:对于大规模的数据集order by的效率非常低。在很多情况下,并不需要全局排序,此时可以使用Sort by。

Sort by为每个reduce产生一个排序文件。每个Reduce内部进行排序,对全局结果集来说不是排序。

1)设置reduce个数

hive (default)> set mapreduce.job.reduces=3;

2)查看设置reduce个数

hive (default)> set mapreduce.job.reduces;

3)根据部门编号降序查看员工信息

hive (default)>

select *

from emp

sort by deptno desc;

hive sql执行过程:

4)将查询结果导入到文件中(按照部门编号降序排序)

hive (default)> insert overwrite local directory '/opt/module/hive/datas/sortby-result'select * from emp sort by deptno desc;

6.5.3 分区(Distribute By)

Distribute By:在有些情况下,我们需要控制某个特定行应该到哪个Reducer,通常是为了进行后续的聚集操作。distribute by子句可以做这件事。distribute by类似MapReduce中partition(自定义分区),进行分区,结合sort by使用。

对于distribute by进行测试,一定要分配多reduce进行处理,否则无法看到distribute by的效果。

1)案例实操:

(1)先按照部门编号分区,再按照员工编号薪资排序

hive (default)> set mapreduce.job.reduces=3;

hive (default)>

insert overwrite local directory

'/opt/module/hive/datas/distribute-result'

select *

from emp

distribute by deptno

sort by sal desc;

注意:

- distribute by的分区规则是根据分区字段的hash码与reduce的个数进行相除后,余数相同的分到一个区。

- Hive要求distribute by语句要写在sort by语句之前。

- 演示完以后job.reduces的值要设置回-1,否则下面分区or分桶表load跑MapReduce的时候会报错。

hive sql执行过程:

6.5.4 分区排序(Cluster By)

当distribute by和sort by字段相同时,可以使用cluster by方式。

cluster by除了具有distribute by的功能外还兼具sort by的功能。但是排序只能是升序排序,不能指定排序规则为asc或者desc。

(1)以下两种写法等价

hive (default)>

select *

from emp

cluster by deptno;hive (default)>

select *

from emp

distribute by deptno

sort by deptno;

注意:按照部门编号分区,不一定就是固定死的数值,可以是20号和30号部门分到一个分区里面去。

hive sql执行过程:

相关文章:

大数据框架之Hive:第6章 查询

第6章 查询 6.1 基础语法 1)官网地址 https://cwiki.apache.org/confluence/display/Hive/LanguageManualSelect 2)查询语句语法: SELECT [ALL | DISTINCT] select_expr, select_expr, ...FROM table_reference -- 从什么表查[WHE…...

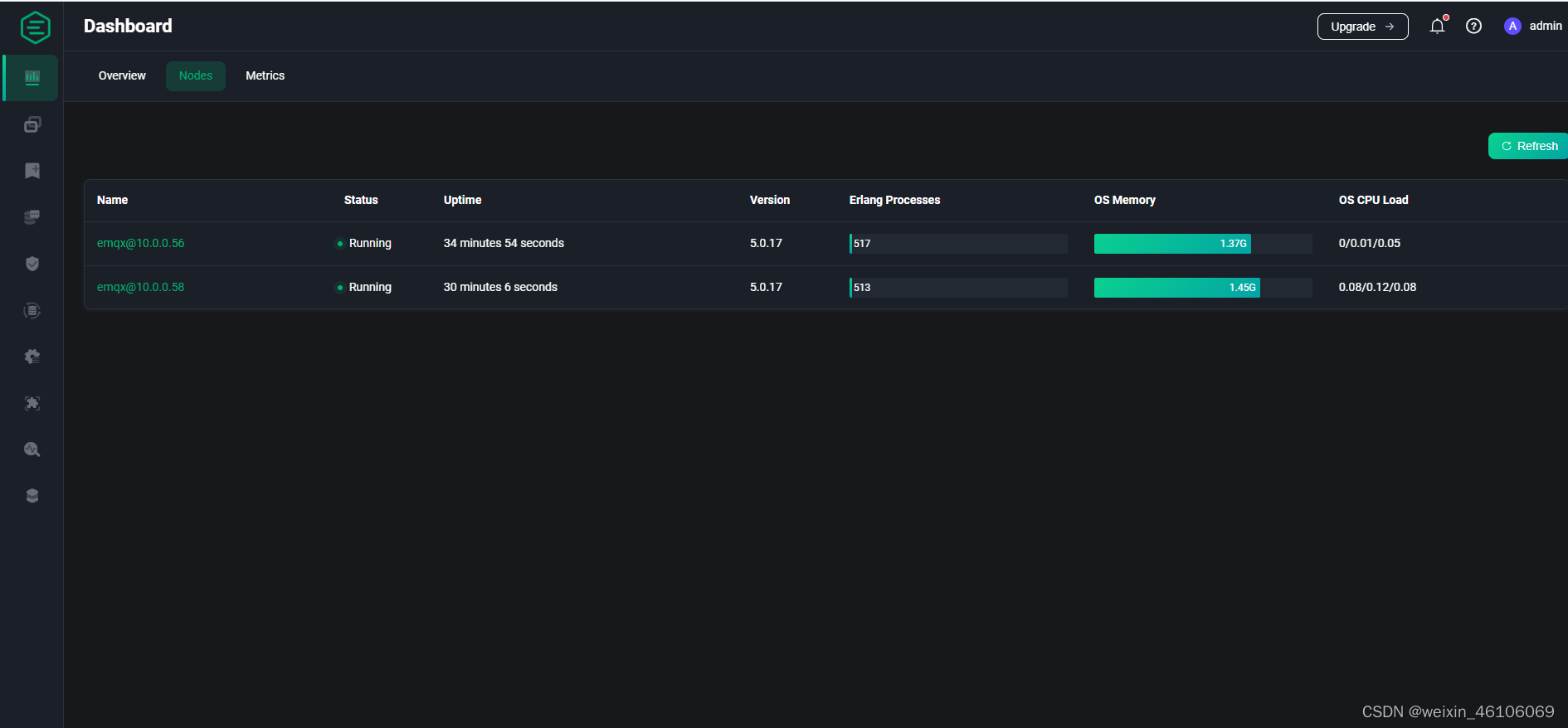

CentOS 8搭建EMQX集群

概览 EMQX (opens new window)是一款大规模可弹性伸缩的云原生分布式物联网 MQTT (opens new window)消息服务器。 EMQ X 设计目标是实现高可靠,并支持承载海量物联网终端的MQTT连接,支持在海量物联网设备间低延时消息路由: 1. 稳定承载大规模的 MQTT 客…...

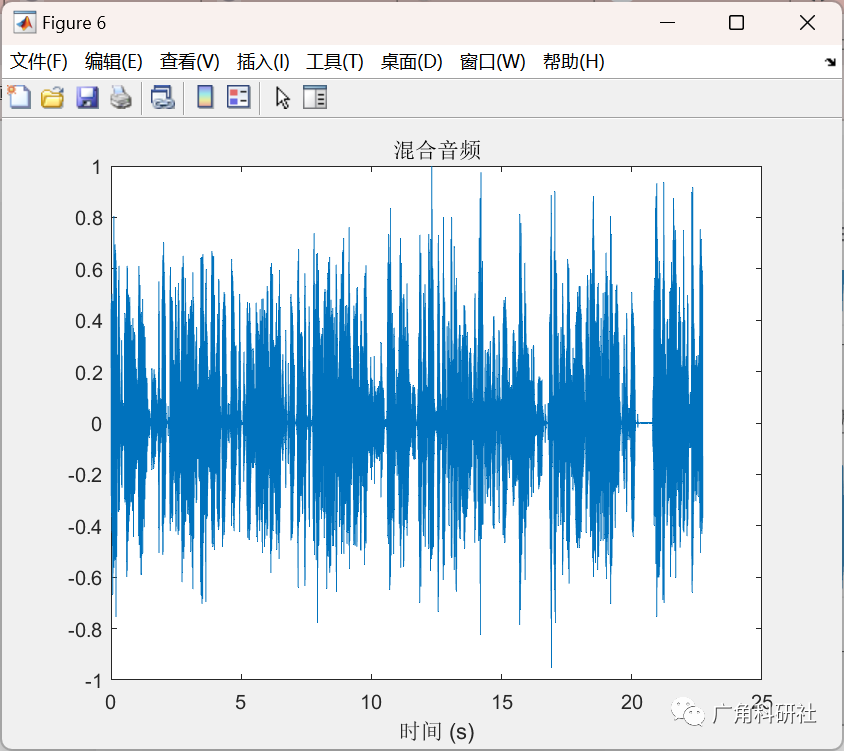

基于神经网络的自监督学习方法音频分离器(Matlab代码实现)

目录 💥1 概述 📚2 运行结果 🎉3 参考文献 👨💻4 Matlab代码 💥1 概述 神经网络的输入是混合(男性女性)音频的振幅谱。神经网络的输出目标是男性说话者理想的软掩模。损失函数…...

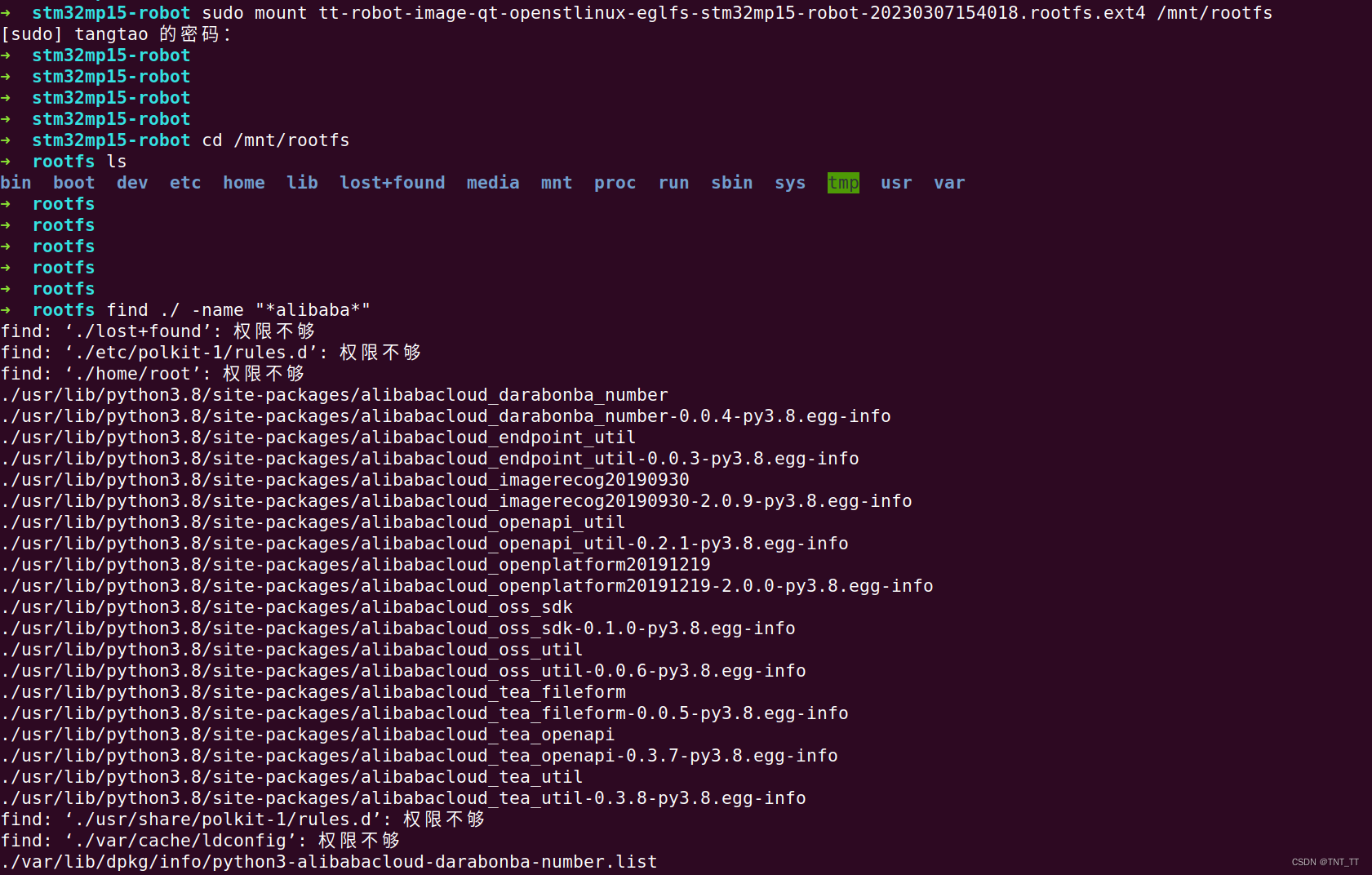

yocto 如何添加python module

yocto 如何添加python module 最近在使用阿里云的图像识别SDK,在ubuntu主机上使用pip install alibabacloud_imagerecog20190930 安装modules以后就可以运行demo程序了,于是打算将SDK移植到嵌入式板子上面,然后在板子上跑一下demo。但是发现…...

[深入理解SSD系列综述 2.1.2] SLC、MLC、TLC、QLC、PLC NAND_固态硬盘闪存颗粒类型

闪存最小物理单位是 Cell, 一个Cell 是一个晶体管。 闪存是通过晶体管储存电子来表示信息的。在晶体管上加入了浮动栅贮存电子。数据是0或1取决于在硅底板上形成的浮动栅中是否有电子。有电子为0,无电子为1. SSD 根据闪存颗粒区分,固态硬盘有SLC、MLC、TLC、QLC、PLC 五种类型…...

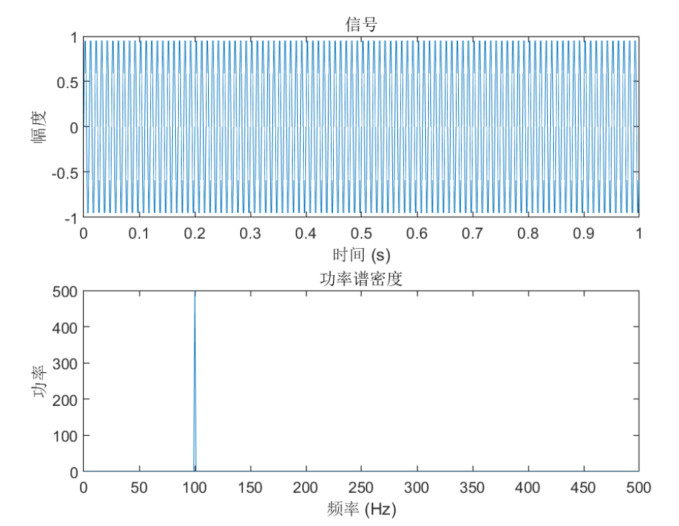

Matlab实现FFT变换

Matlab实现FFT变换 文章目录Matlab实现FFT变换原理实现手算验证简单fft变换和频谱求取功率谱结论在信号处理中,快速傅里叶变换(FFT)是一种非常常见的频域分析方法。本文将介绍如何使用Matlab实现FFT变换,并通过Matlab代码演示实际…...

JVM调优面试题——垃圾回收专题

文章目录1、如何确定一个对象是垃圾?1.1、引用计数法1.2、可达性分析2、对象被判定为不可达对象之后就“死”了吗?3、都有哪些垃圾收集算法?3.1、 标记-清除(Mark-Sweep)3.2、标记-复制(Mark-Copying)3.3、标记-整理(Mark-Compact)3.4、分代收…...

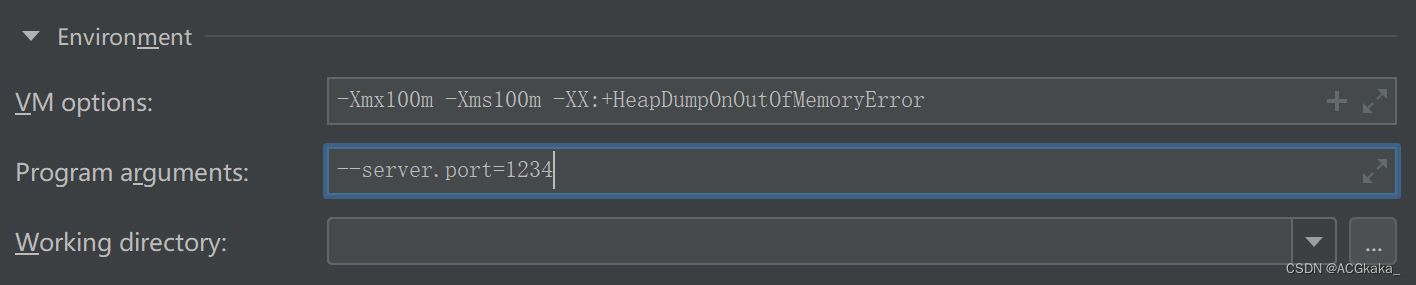

java启动命令中-D和--的区别

目录一、java -D 添加参数二、java -- 添加参数在 SpringBoot 项目中,启动时,通过 -D 或 -- 添加参数,都可以直接覆盖 yml 或 properties 配置文件中的同名配置,如果不存在则相当于添加了一个配置。 一、java -D 添加参数 java -D…...

QML Popup详解

1.简介 弹出式用户界面控件,它可以与Window或ApplicationWindow一起使用,默认不可见。 常用属性介绍,一些公用的基础属性就不作介绍,可以查看我前面写的文章。 closePolicy : enumeration :此属性决定弹出窗口关闭的…...

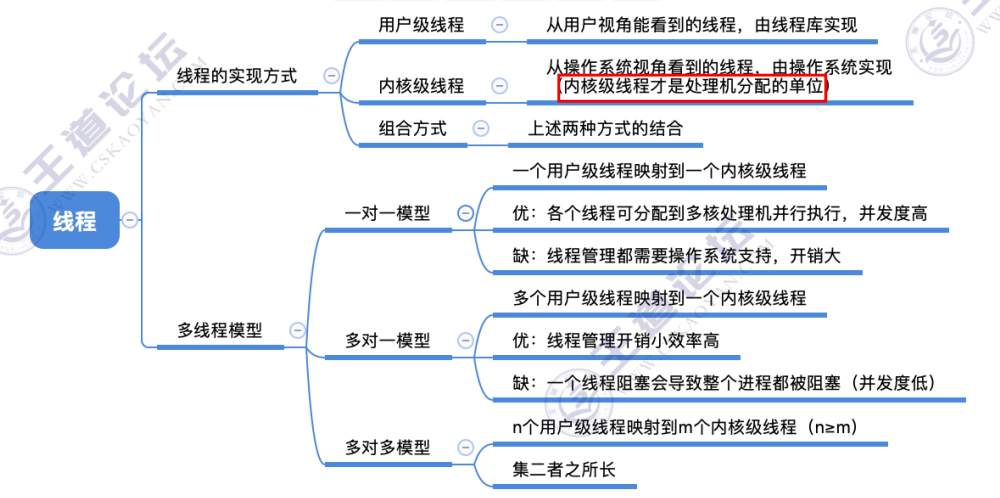

[2.1.6]进程管理——线程的实现方式和多线程模型

文章目录第二章 进程管理线程的实现方式和多线程模型一、线程的实现方式(一)用户级线程(二)内核级线程二、多线程模型(一)一对一模型(二)多对一模型(三)多对多…...

小白做什么兼职项目赚钱?宝妈拍短视频赚钱的方法

很多宝妈在家带孩子之余想做兼职赚点小钱,依靠互联网无疑是比较方便的途径,在刷单、微商等网上兼职成为过去式以后,很多宝妈选择了短视频创业。 宝妈怎么拍短视频? 宝妈因为要照顾宝宝还要兼顾家务,空闲的时间比较琐碎…...

第十四届蓝桥杯第三期模拟赛 C/C++ B组 原题与详解

文章目录 一、填空题 1、1 找最小全字母十六进制数 1、1、1 题目描述 1、1、2 题解关键思路与解答 1、2 给列命名 1、2、1 题目描述 1、2、2 题解关键思路与解答 1、3 日期相等 1、3、1 题目描述 1、3、2 题解关键思路与解答 1、4 乘积方案数 1、4、1 题目描述 1、4、2 题解关…...

Linux中断操作

一、thread_irq在内核中, 除了可以通过request_irq() 、 devm_request_irq()申请中断以外, 还可以通过以下二个函数申请( 它们比request_irq和devm_request_irq多了一个参数thread_fn)。 用这两个API申请中断的时候, 内核会为相应的中断号分配…...

看看CabloyJS是如何异步加载并执行go wasm模块的

介绍 CabloyJS提供了一个内置模块a-wasmgo,将go wasm模块的异步加载运行机制进行了封装,使我们可以非常方便的在CabloyJS项目中引入go wasm,从而支持更多的业务场景开发 下面,我们以测试模块test-party为例,演示引入…...

嵌入式C语言九大数据结构操作方式详解

在C语言的开发过程中,灵活使用数据结构,对提高编程效率有极大的帮助。 目录 1 数组 2 链表 3 跳表 4 栈 5 队列 6 树 7 堆 8 散列表 9 图 10 总结 数据结构想必大家都不会陌生,对于一个成熟的程序员而言,熟悉和掌握数据…...

【C++学习】栈 | 队列 | 优先级队列 | 反向迭代器

🐱作者:一只大喵咪1201 🐱专栏:《C学习》 🔥格言:你只管努力,剩下的交给时间! 栈 | 队列 | 优先级队列 | 反向迭代器😼容器适配器🙈什么是适配器ὤ…...

Python—看我分析下已经退市的 可转债 都有什么特点

分析 需求分析 可转债退市原因的种类与占比是多少 强赎与非强赎导致的退市可转债 存续时间 维度占比 强赎与非强赎导致的退市可转债 发行资金 规模占比 强赎与非强赎导致的退市可转债 各个评级 的占比 强赎与非强赎导致的退市可转债 各个行业(一级行业…...

【第八课】空间数据基础与处理——数据结构转化

一、前言 数据结构即指数据组织的形式,是适合于计算机存储、管理和处理的数据逻辑结构。对空间数据则是地理实体的空间排列方式和相互关系的抽象描述。它是对数据的一种理解和解释,不说明数据结构的数据是毫无用处的,不仅用户无法理解,计算机程序也不能正确地处理,对同样一组数…...

MATLAB绘制三Y轴坐标图:补充坐标轴及字体设置

三轴坐标图 1 函数 MATLAB绘制三轴图函数可见MATLAB帮助-multiplotyyy 基础图形绘制是很简单,但坐标轴及字体设置该如何实现呢? 本文以以下几个例子为例,希望可以解决在利用MATLAB绘制三轴坐标图时常见的疑惑。 2 案例 2.1 案例1…...

springboot项目中Quartz

下面内容大家可在自己创建的 springboot项目中 玩1 定时清理垃圾图片定时任务组件Quartz,可以根据我们设定的周期,定时执行目标任务计划1.1 Quartz介绍(了解)Quartz是Job scheduling(作业调度)领域的一个开源项目&…...

PPT|230页| 制造集团企业供应链端到端的数字化解决方案:从需求到结算的全链路业务闭环构建

制造业采购供应链管理是企业运营的核心环节,供应链协同管理在供应链上下游企业之间建立紧密的合作关系,通过信息共享、资源整合、业务协同等方式,实现供应链的全面管理和优化,提高供应链的效率和透明度,降低供应链的成…...

Python爬虫实战:研究feedparser库相关技术

1. 引言 1.1 研究背景与意义 在当今信息爆炸的时代,互联网上存在着海量的信息资源。RSS(Really Simple Syndication)作为一种标准化的信息聚合技术,被广泛用于网站内容的发布和订阅。通过 RSS,用户可以方便地获取网站更新的内容,而无需频繁访问各个网站。 然而,互联网…...

使用Matplotlib创建炫酷的3D散点图:数据可视化的新维度

文章目录 基础实现代码代码解析进阶技巧1. 自定义点的大小和颜色2. 添加图例和样式美化3. 真实数据应用示例实用技巧与注意事项完整示例(带样式)应用场景在数据科学和可视化领域,三维图形能为我们提供更丰富的数据洞察。本文将手把手教你如何使用Python的Matplotlib库创建引…...

JVM 内存结构 详解

内存结构 运行时数据区: Java虚拟机在运行Java程序过程中管理的内存区域。 程序计数器: 线程私有,程序控制流的指示器,分支、循环、跳转、异常处理、线程恢复等基础功能都依赖这个计数器完成。 每个线程都有一个程序计数…...

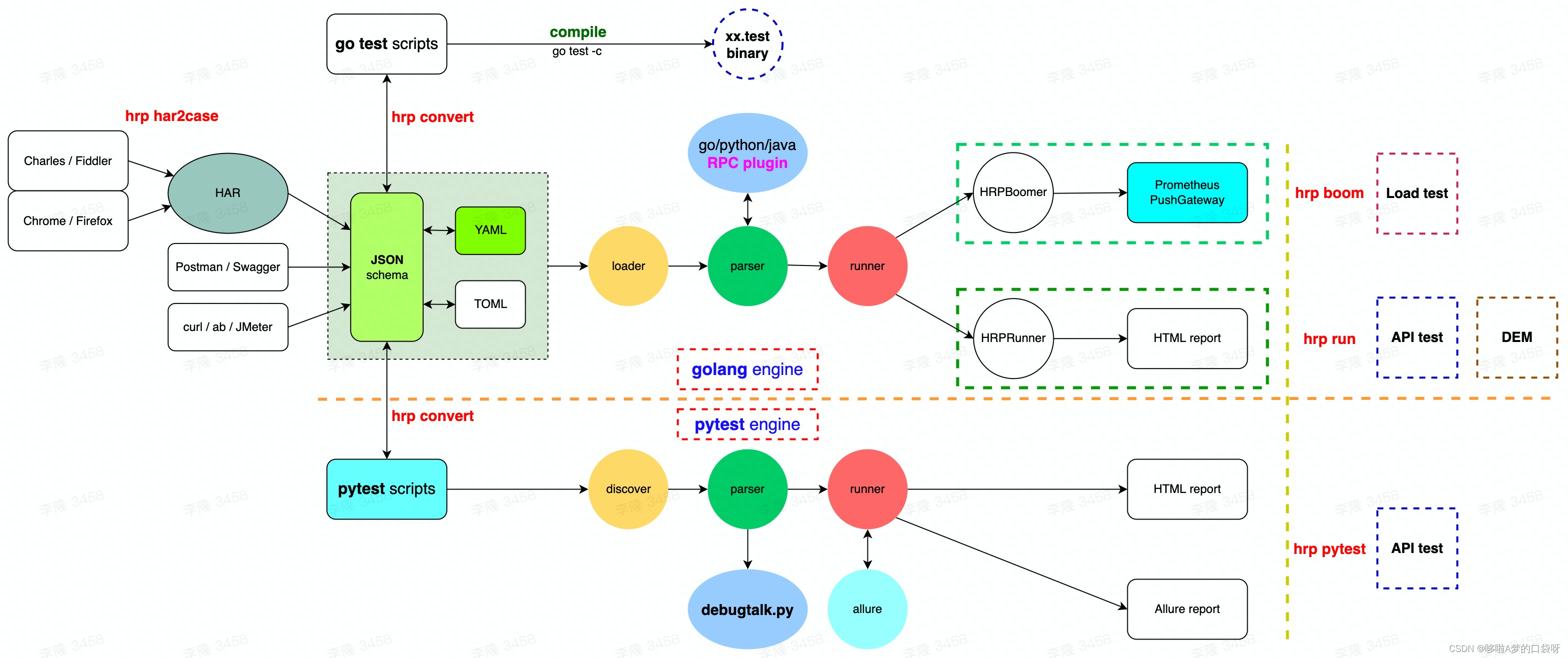

接口自动化测试:HttpRunner基础

相关文档 HttpRunner V3.x中文文档 HttpRunner 用户指南 使用HttpRunner 3.x实现接口自动化测试 HttpRunner介绍 HttpRunner 是一个开源的 API 测试工具,支持 HTTP(S)/HTTP2/WebSocket/RPC 等网络协议,涵盖接口测试、性能测试、数字体验监测等测试类型…...

怎么让Comfyui导出的图像不包含工作流信息,

为了数据安全,让Comfyui导出的图像不包含工作流信息,导出的图像就不会拖到comfyui中加载出来工作流。 ComfyUI的目录下node.py 直接移除 pnginfo(推荐) 在 save_images 方法中,删除或注释掉所有与 metadata …...

人工智能--安全大模型训练计划:基于Fine-tuning + LLM Agent

安全大模型训练计划:基于Fine-tuning LLM Agent 1. 构建高质量安全数据集 目标:为安全大模型创建高质量、去偏、符合伦理的训练数据集,涵盖安全相关任务(如有害内容检测、隐私保护、道德推理等)。 1.1 数据收集 描…...

Kafka主题运维全指南:从基础配置到故障处理

#作者:张桐瑞 文章目录 主题日常管理1. 修改主题分区。2. 修改主题级别参数。3. 变更副本数。4. 修改主题限速。5.主题分区迁移。6. 常见主题错误处理常见错误1:主题删除失败。常见错误2:__consumer_offsets占用太多的磁盘。 主题日常管理 …...

ZYNQ学习记录FPGA(一)ZYNQ简介

一、知识准备 1.一些术语,缩写和概念: 1)ZYNQ全称:ZYNQ7000 All Pgrammable SoC 2)SoC:system on chips(片上系统),对比集成电路的SoB(system on board) 3)ARM:处理器…...

在golang中如何将已安装的依赖降级处理,比如:将 go-ansible/v2@v2.2.0 更换为 go-ansible/@v1.1.7

在 Go 项目中降级 go-ansible 从 v2.2.0 到 v1.1.7 具体步骤: 第一步: 修改 go.mod 文件 // 原 v2 版本声明 require github.com/apenella/go-ansible/v2 v2.2.0 替换为: // 改为 v…...