【机器学习(四)】分类和回归任务-梯度提升决策树(GBDT)-Sentosa_DSML社区版

文章目录

- 一、算法概念

- 一、算法原理

- (一) GBDT 及负梯度拟合原理

- (二) GBDT 回归和分类

- 1、GBDT回归

- 1、GBDT分类

- 二元分类

- 多元分类

- (三)损失函数

- 1、回归问题的损失函数

- 2. 分类问题的损失函数:

- 三、GBDT的优缺点

- (一)优点

- (二)缺点

- 四、GBDT分类任务实现对比

- (一)数据加载

- 1、Python代码

- 2、Sentosa_DSML社区版

- (二)样本分区

- 1、Python代码

- 2、Sentosa_DSML社区版

- (三)模型训练

- 1、Python代码

- 2、Sentosa_DSML社区版

- (二)模型评估

- 1、Python代码

- 2、Sentosa_DSML社区版

- (二)模型可视化

- 1、Python代码

- 2、Sentosa_DSML社区版

- 五、GBDT回归任务实现对比

- (一)数据加载、样本分区和特征标准化

- 1、Python代码

- 2、Sentosa_DSML社区版

- (二)模型训练

- 1、Python代码

- 2、Sentosa_DSML社区版

- (三)模型评估

- 1、Python代码

- 2、Sentosa_DSML社区版

- (四)模型可视化

- 1、Python代码

- 2、Sentosa_DSML社区版

- 六、总结

一、算法概念

什么是梯度提升决策树?

梯度提升决策树(Gradient Boosting Decison Tree)是集成学习中Boosting家族的一员。

集成学习(ensemble learning)是一种通过组合多个基学习器(模型)来提高整体预测性能的方法。它通过集成多个学习器形成一个强学习器,从而提高模型的泛化能力和准确性。集成学习的核心思想是利用不同模型的组合弥补单一模型的缺点。集成学习可以分为两大类,一类是序列化方法:个体学习器之间存在强依赖关系,必须串行生成,例如boosting;一类是并行化方法:个体学习器之间不存在强依赖关系、可以同时生成,例如bagging(也称为bootstrap聚合)。

Boosting类算法中最著名的代表是Adaboost算法,Adaboost的原理是,通过前一轮弱学习器的错误率来更新训练样本的权重,不断迭代提升模型性能。

GBDT与传统的Adaboost算法有显著不同,GBDT同样通过迭代来提升模型的表现,但它采用的是前向分布算法(Forward Stagewise Algorithm),且其弱学习器被限定为CART回归树。此外,GBDT的迭代思想和Adaboost也有所区别。GBDT算法流程如下:

一、算法原理

(一) GBDT 及负梯度拟合原理

GBDT(Gradient Boosting Decision Tree)是一种利用多个决策树来解决分类和回归问题的集成学习算法。核心思想是通过前一轮模型的残差来构建新的决策树。为了提高拟合效果,Friedman 提出了用损失函数的负梯度来近似残差,从而拟合一个新的CART回归树,负梯度的表示公式为:

r t , i = − [ ∂ L ( y i , f ( x i ) ) ∂ f ( x i ) ] f ( x ) = f t − 1 ( x ) r_{t,i} = -\left[\frac{\partial L(y_i, f(x_i))}{\partial f(x_i)}\right]_{f(x) = f_{t-1}(x)} rt,i=−[∂f(xi)∂L(yi,f(xi))]f(x)=ft−1(x)

其中, r t , i r_{t,i} rt,i表示的是第𝑡轮中,第 𝑖个样本的损失函数的负梯度,𝐿是损失函数,𝑓(𝑥)是模型的预测值。

在每一轮迭代中,我们首先用样本 ( x i , r t , i ) (x_i,r_{t,i}) (xi,rt,i)来拟合一棵 CART 回归树。这里 r t , i r_{t,i} rt,i表示的是第 𝑡 轮的负梯度,代表了样本的误差。回归树的每个叶节点会包含一定范围的输入数据,称为叶节点区域 R t , j R_{t,j} Rt,j,而叶节点的数量用 J表示。

每个叶节点输出一个常数值 c t , j c_{t,j} ct,j,它通过最小化损失函数来获得。目标是找到一个 𝑐,使得该节点中的所有样本的损失函数最小化,公式如下所示:

c t , j = arg min c ∑ x i ∈ R t , j L ( y i , f t − 1 ( x i ) + c ) c_{t,j} = \arg\min_c \sum_{x_i \in R_{t,j}} L(y_i, f_{t-1}(x_i) + c) ct,j=argcminxi∈Rt,j∑L(yi,ft−1(xi)+c)

接下来, h t ( x ) h_t(x) ht(x)表示为每个叶节点的输出值 c t , j c_{t,j} ct,j的加权和,我们就得到了本轮的决策树拟合函数如下:

h t ( x ) = ∑ j = 1 J c t , j I ( x ∈ R t , j ) h_t(x) = \sum_{j=1}^{J} c_{t,j} I(x \in R_{t,j}) ht(x)=j=1∑Jct,jI(x∈Rt,j)

其中, I ( x ∈ R t , j ) I(x \in R_{t,j}) I(x∈Rt,j)是一个指示函数,表示样本 𝑥是否属于该叶节点区域 R t , j R_{t,j} Rt,j中。

在每一轮中强学习器是基学习器的更新,通过将当前轮次的决策树的输出叠加到之前的模型上来逐步优化,本轮最终得到的强学习器的表达式如下:

f t ( x ) = f t − 1 ( x ) + ∑ j = 1 J c t , j I ( x ∈ R t , j ) f_t(x) = f_{t-1}(x) + \sum_{j=1}^{J} c_{t,j} I(x \in R_{t,j}) ft(x)=ft−1(x)+j=1∑Jct,jI(x∈Rt,j)

无论是分类问题还是回归问题,这种方法都可以通过选择不同的损失函数(例如平方误差或对数损失)来表示模型误差。通过拟合负梯度,模型能够逐步修正误差,从而提高预测精度。

(二) GBDT 回归和分类

1、GBDT回归

接下来, 可以总结梯度提升决策树(GBDT)的回归算法步骤

输入训练集样本 T = { ( x , y 1 ) , ( x 2 , y 2 ) , … ( x m , y m ) } T=\left\{\left(x, y_1\right),\left(x_2, y_2\right), \ldots\left(x_m, y_m\right)\right\} T={(x,y1),(x2,y2),…(xm,ym)} ,其中, x i x_i xi是特征, y i y_i yi是目标变量

首先,初始化弱学习器在开始时,找到一个常数模型 f 0 ( x ) f_0(x) f0(x) ,通过最小化损失函数 𝐿来获得初始的预测值。这一步可以通过以下公式表示:

f 0 ( x ) = arg min ⏟ c ∑ i = 1 m L ( y i , c ) f_0(x)=\underbrace{\arg \min }_c \sum_{i=1}^m L\left(y_i, c\right) f0(x)=c argmini=1∑mL(yi,c)

其中,最大迭代次数为 T ,损失函数为 L, 𝑐是一个常数,用来最小化训练集中所有样本的损失函数。

然后,对迭代轮数 t = 1 , 2 , . . . , T … t=1,2, ...,T\ldots t=1,2,...,T… ,执行以下步骤:

第一步:对样本 i = 1 , 2 , … m \mathrm{i}=1,2, \ldots \mathrm{m} i=1,2,…m ,计算负梯度,即损失函数关于当前模型预测值的导数,表达误差。具体公式如下:

r t i = − [ ∂ L ( y i , f ( x i ) ) ) ∂ f ( x i ) ] f ( x ) = f t − 1 ( x ) r_{t i}=-\left[\frac{\left.\partial L\left(y_i, f\left(x_i\right)\right)\right)}{\partial f\left(x_i\right)}\right]_{f(x)=f_{t-1}(x)} rti=−[∂f(xi)∂L(yi,f(xi)))]f(x)=ft−1(x)

表示第 𝑡 轮迭代时,第 𝑖个样本的负梯度。

第二步:通过样本 x i , r t , i x_i,r_{t,i} xi,rt,i拟合一棵 CART 回归树,找到数据的模式并生成叶子节点。

第三步: 对于回归树的每个叶子节点区域j = 1 , 2 , . =1,2, . =1,2,.. ,计算最佳拟合值,这个值是通过最小化损失函数 𝐿得到的:

c t j = arg min ⏟ c ∑ x i ∈ R t j L ( y i , f t − 1 ( x i ) + c ) c_{t j}=\underbrace{\arg \min }_c \sum_{x_i \in R_{t j}} L\left(y_i, f_{t-1}\left(x_i\right)+c\right) ctj=c argminxi∈Rtj∑L(yi,ft−1(xi)+c)

第四步:更新强学习器,用当前的回归树不断更新强学习器。公式表达如下所示:

f t ( x ) = f t − 1 ( x ) + ∑ j = 1 J c t j I ( x ∈ R t , j ) f_t(x)=f_{t-1}(x)+\sum_{j=1}^J c_{t j} I\left(x \in R_{t ,j}\right) ft(x)=ft−1(x)+j=1∑JctjI(x∈Rt,j)

其中, 当样本 𝑥位于区域 R t , j R_{t, j} Rt,j 时,输出值为 1,否则为 0。这样,新的强学习器通过叠加每一棵回归树的输出来逐步提高预测精度。

最后,经过 𝑇轮迭代后,我们可以得到强学习树 f ( x ) f(x) f(x) ,表达式如下所示:

f ( x ) = f T ( x ) = f 0 ( x ) + ∑ t = 1 T ∑ j = 1 J c t , j I ( x ∈ R t , j ) f(x)=f_T(x)=f_0(x)+\sum_{t=1}^T \sum_{j=1}^J c_{t,j} I(x \in R_{t,j}) f(x)=fT(x)=f0(x)+t=1∑Tj=1∑Jct,jI(x∈Rt,j)

1、GBDT分类

GBDT 的分类算法在思想上与 GBDT 的回归算法类似,但由于分类问题的输出是离散的类别值,而不是连续值,不能像回归那样直接通过输出值来拟合误差。因此,在分类问题中,GBDT 需要采用特殊的处理方法来解决误差拟合的问题,一般有两种处理方式:

1、使用指数损失函数:

在这种情况下,GBDT 的分类算法会退化为 Adaboost 算法。这是因为指数损失函数和 Adaboost 使用的误差度量方式非常相似,因此 GBDT 在这种情境下的更新方式与 Adaboost 类似。

2、使用对数似然损失函数:

这是更常见的做法,尤其在现代的 GBDT 分类任务中。对数似然损失函数的核心思想是通过样本的预测概率和真实类别之间的差异来拟合损失,而不是直接拟合类别值。

对数似然损失函数的应用类似于逻辑回归中的方法,即使用模型的输出来表示每个类别的预测概率,并计算这种概率与真实类别的匹配度。

二元分类

在二元分类中,目标是将数据点分类为两个类别之一。GBDT 会输出一个值 p(x),表示样本属于某一类别的概率。通过最小化负对数似然损失(即逻辑回归中的损失函数)来调整模型,从而提高分类准确性。

对于二元分类,使用的损失函数为负对数似然损失:

L ( y , p ( x ) ) = − [ y log ( p ( x ) ) + ( 1 − y ) log ( 1 − p ( x ) ) ] L(y, p(x))=-[y \log (p(x))+(1-y) \log (1-p(x))] L(y,p(x))=−[ylog(p(x))+(1−y)log(1−p(x))]

其中 p(x) 是模型对样本属于类别 1 的预测概率,y 是样本的真实标签,取值为 0 或 1。

对于多元分类(即分类类别大于 2 的情况),GBDT 使用类似于 softmax 的损失函数。softmax 函数将模型的输出映射为多个类别的概率分布,然后最小化负对数似然损失来进行优化。

多元分类

多元分类中的损失函数为:

L ( y , p ( x ) ) = − ∑ k = 1 K y k log ( p k ( x ) ) L(y, p(x))=-\sum_{k=1}^K y_k \log \left(p_k(x)\right) L(y,p(x))=−k=1∑Kyklog(pk(x))

其中,K 是类别总数, y K y_K yK表示样本在类别 k 中的标签值(为 0 或 1)。

GBDT 的分类算法通过对数似然损失函数来拟合概率值,从而解决分类任务中的误差优化问题。与回归不同,分类中的输出不是直接拟合类别值,而是通过拟合预测概率来实现。这种方式既适用于二元分类,也适用于多元分类任务。

(三)损失函数

在 GBDT(梯度提升决策树)中,损失函数的选择至关重要,因为它直接决定了模型的优化目标。不同的任务类型(回归、分类等)会使用不同的损失函数。以下是 GBDT 中常用的损失函数:

1、回归问题的损失函数

平方损失函数 (Mean Squared Error, MSE):常用于回归问题,度量模型输出与真实值之间的差异。

定义:

L ( y , y ^ ) = 1 2 ( y − y ^ ) 2 L(y, \hat{y})=\frac{1}{2}(y-\hat{y})^2 L(y,y^)=21(y−y^)2

绝对值损失函数 (Mean Absolute Error, MAE):也是常见的回归损失函数,使用绝对值误差来度量模型的预测性能。

定义:

L ( y , y ^ ) = ∣ y − y ^ ∣ L(y, \hat{y})=|y-\hat{y}| L(y,y^)=∣y−y^∣

Huber 损失函数:Huber 损失结合了平方损失和绝对值损失的优点,对于离群点有较好的鲁棒性。

定义:

L ( y , y ^ ) = { 1 2 ( y − y ^ ) 2 if ∣ y − y ^ ∣ ≤ δ δ ⋅ ( ∣ y − y ^ ∣ − 1 2 δ ) if ∣ y − y ^ ∣ > δ L(y, \hat{y})= \begin{cases}\frac{1}{2}(y-\hat{y})^2 & \text { if }|y-\hat{y}| \leq \delta \\ \delta \cdot\left(|y-\hat{y}|-\frac{1}{2} \delta\right) & \text { if }|y-\hat{y}|>\delta\end{cases} L(y,y^)={21(y−y^)2δ⋅(∣y−y^∣−21δ) if ∣y−y^∣≤δ if ∣y−y^∣>δ

分位数损失函数 (Quantile Loss):适用于分位数回归,可以预测不同分位数的结果。

定义:

L ( y , y ^ ) = { α ( y − y ^ ) if y ≥ y ^ ( 1 − α ) ( y ^ − y ) if y < y ^ L(y, \hat{y})= \begin{cases}\alpha(y-\hat{y}) & \text { if } y \geq \hat{y} \\ (1-\alpha)(\hat{y}-y) & \text { if } y<\hat{y}\end{cases} L(y,y^)={α(y−y^)(1−α)(y^−y) if y≥y^ if y<y^

2. 分类问题的损失函数:

对数似然损失函数 (Logarithmic Loss / Log Loss):主要用于二元分类问题(类似于逻辑回归),通过最小化预测概率与真实类别之间的差异来优化模型。

定义:

L ( y , p ( x ) ) = − [ y log ( p ( x ) ) + ( 1 − y ) log ( 1 − p ( x ) ) ] L(y, p(x))=-[y \log (p(x))+(1-y) \log (1-p(x))] L(y,p(x))=−[ylog(p(x))+(1−y)log(1−p(x))]

多分类对数损失函数 (Multinomial Log-Loss):用于多分类问题,类似于对数似然损失,但适用于多于两个类别的情况。

定义:

L ( y , p ( x ) ) = − ∑ k = 1 K y k log ( p k ( x ) ) L(y, p(x))=-\sum_{k=1}^K y_k \log \left(p_k(x)\right) L(y,p(x))=−k=1∑Kyklog(pk(x))

指数损失函数 (Exponential Loss):用于分类问题,尤其是 Adaboost 算法,GBDT 可以通过使用指数损失函数退化为 Adaboost。

定义:

L ( y , y ^ ) = exp ( − y y ^ ) L(y, \hat{y})=\exp (-y \hat{y}) L(y,y^)=exp(−yy^)

三、GBDT的优缺点

GBDT(梯度提升决策树)算法虽然概念不复杂,但要真正掌握它,必须对集成学习的基本原理、决策树的工作机制以及不同损失函数有深入理解。目前,性能较为优异的 GBDT 库有 XGBoost,而 scikit-learn 也提供了 GBDT 的实现。

(一)优点

- 处理多类型数据的灵活性:GBDT 可以同时处理连续值和离散值,适应多种场景。

- 高准确率且相对少的调参:即使花费较少的时间在调参上,GBDT也能在预测准确率上有较好表现,尤其是相对于 SVM。

- 对异常值的鲁棒性:通过使用健壮的损失函数,如 Huber损失函数和分位数损失函数,GBDT 对异常数据有很强的鲁棒性。

(二)缺点

- 难以并行化训练:由于 GBDT 中的弱学习器(决策树)存在依赖关系,导致训练时难以并行化。不过,部分并行化可以通过使用自采样的 SGBT方法来实现。

- 训练时间较长:由于迭代的特性和逐步拟合的过程,GBDT 的训练速度相比一些其他算法较慢。

四、GBDT分类任务实现对比

主要根据模型搭建的流程,对比传统代码方式和利用Sentosa_DSML社区版完成机器学习算法时的区别。

(一)数据加载

1、Python代码

from sklearn.datasets import load_iris# 加载数据集

iris = load_iris()

X = iris.data # 特征

y = iris.target # 标签

2、Sentosa_DSML社区版

利用文本读入算子对数据进行读取。

(二)样本分区

1、Python代码

from sklearn.model_selection import train_test_split# 将数据集划分为训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

2、Sentosa_DSML社区版

利用样本分区算子对数据集进行划分。

利用类型算子设置数据的特征列和标签列

(三)模型训练

1、Python代码

from sklearn.ensemble import GradientBoostingClassifier# 创建 Gradient Boosting 分类器

gbdt_classifier = GradientBoostingClassifier(n_estimators=100, learning_rate=0.1, max_depth=3, random_state=42)# 训练 GBDT 模型

gbdt_classifier.fit(X_train, y_train)# 进行预测

y_pred = gbdt_classifier.predict(X_test)

2、Sentosa_DSML社区版

连接模型算子并选择模型参数

执行得到模型的训练结果

(二)模型评估

1、Python代码

from sklearn.metrics import accuracy_score, precision_score, recall_score, f1_score, confusion_matrix

import matplotlib.pyplot as plt

import seaborn as sns

import numpy as np# 评估模型

accuracy = accuracy_score(y_test, y_pred)

precision = precision_score(y_test, y_pred, average='weighted')

recall = recall_score(y_test, y_pred, average='weighted')

f1 = f1_score(y_test, y_pred, average='weighted')# 打印评估结果

print(f"GBDT 模型的准确率: {accuracy:.2f}")

print(f"加权精度 (Weighted Precision): {precision:.2f}")

print(f"加权召回率 (Weighted Recall): {recall:.2f}")

print(f"F1 值 (Weighted F1 Score): {f1:.2f}")# 生成混淆矩阵

cm = confusion_matrix(y_test, y_pred)

plt.figure(figsize=(8, 6))

sns.heatmap(cm, annot=True, fmt='d', cmap='Blues', xticklabels=iris.target_names, yticklabels=iris.target_names)

plt.xlabel('Predicted')

plt.ylabel('Actual')

plt.title('Confusion Matrix')

plt.show()

2、Sentosa_DSML社区版

连接评估算子对模型进行评估

得到训练集和测试集的评估结果

连接混淆矩阵算子计算模型混淆矩阵

得到训练集和测试集的混淆矩阵结果

(二)模型可视化

1、Python代码

# 计算特征重要性并进行排序

importances = gbdt_classifier.feature_importances_

indices = np.argsort(importances)[::-1] # 按特征重要性降序排列索引# 绘制特征重要性柱状图

plt.figure(figsize=(10, 6))

plt.title("Feature Importances")

plt.bar(range(X.shape[1]), importances[indices], align="center")

plt.xticks(range(X.shape[1]), [iris.feature_names[i] for i in indices], rotation=45) # 使用特征名称

plt.tight_layout()

plt.show()# 决策树的可视化

# 获取 GBDT 模型的其中一棵决策树

estimator = gbdt_classifier.estimators_[0, 0] # 获取第一轮的第一棵树

plt.figure(figsize=(20, 10))

tree.plot_tree(estimator, feature_names=iris.feature_names, class_names=iris.target_names, filled=True, rounded=True)

plt.title('Decision Tree Visualization (First Tree in GBDT)')

plt.show()

2、Sentosa_DSML社区版

右键查看模型信息即可得到模型特征重要性,决策树可视化等结果:

特征重要性、混淆矩阵、GBDT 模型的决策树划分和其中一棵决策树结果如下所示:

五、GBDT回归任务实现对比

(一)数据加载、样本分区和特征标准化

1、Python代码

import pandas as pd

import matplotlib.pyplot as plt

import seaborn as sns

from sklearn.preprocessing import LabelEncoder

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import StandardScaler

from sklearn.ensemble import GradientBoostingRegressor

from sklearn.metrics import r2_score, mean_absolute_error, mean_squared_error

from sklearn import tree# 读取数据集

df = pd.read_csv("D:/sentosa_ML/Sentosa_DSML/mlServer/TestData/winequality.csv")# 将数据集划分为特征和标签

X = df.drop("quality", axis=1) # 特征,假设标签是 "quality"

Y = df["quality"] # 标签# 划分训练集和测试集

X_train, X_test, Y_train, Y_test = train_test_split(X, Y, test_size=0.2, random_state=42)# 标准化特征

sc_x = StandardScaler()

X_train = sc_x.fit_transform(X_train)

X_test = sc_x.transform(X_test)

2、Sentosa_DSML社区版

利用文本算子读入数据

连接样本分区算子,划分训练集和测试集

连接类型算子将“quality”列设为标签列。

连接标准化算子进行特征标准化

(二)模型训练

1、Python代码

# 训练梯度提升决策树回归器

gbdt_regressor = GradientBoostingRegressor(n_estimators=500, learning_rate=0.1, max_depth=10, random_state=42)

gbdt_regressor.fit(X_train, Y_train)# 预测测试集上的标签

y_pred = gbdt_regressor.predict(X_test)2、Sentosa_DSML社区版

在标准化结束后,选择梯度决策树回归算子,进行参数配置后,点击执行。

完后执行之后,我们可以得到梯度提升决策树模型。

(三)模型评估

1、Python代码

# 计算评估指标

r2 = r2_score(Y_test, y_pred)

mae = mean_absolute_error(Y_test, y_pred)

mse = mean_squared_error(Y_test, y_pred)

rmse = np.sqrt(mse)

mape = np.mean(np.abs((Y_test - y_pred) / Y_test)) * 100

smape = 100 / len(Y_test) * np.sum(2 * np.abs(Y_test - y_pred) / (np.abs(Y_test) + np.abs(y_pred)))# 打印评估结果

print(f"R²: {r2}")

print(f"MAE: {mae}")

print(f"MSE: {mse}")

print(f"RMSE: {rmse}")

print(f"MAPE: {mape}%")

print(f"SMAPE: {smape}%")

2、Sentosa_DSML社区版

连接评估算子对模型进行评估

训练集评估结果

测试集评估结果

(四)模型可视化

1、Python代码

# 可视化特征重要性

importances = gbdt_regressor.feature_importances_

indices = np.argsort(importances)[::-1]plt.figure(figsize=(10, 6))

plt.title("Feature Importances")

plt.bar(range(X.shape[1]), importances[indices], align="center")

plt.xticks(range(X.shape[1]), X.columns[indices], rotation=45)

plt.tight_layout()

plt.show()

2、Sentosa_DSML社区版

右键查看模型信息即可得到模型特征重要性,决策树可视化等结果:

六、总结

相比传统代码方式,利用Sentosa_DSML社区版完成机器学习算法的流程更加高效和自动化,传统方式需要手动编写大量代码来处理数据清洗、特征工程、模型训练与评估,而在Sentosa_DSML社区版中,这些步骤可以通过可视化界面、预构建模块和自动化流程来简化,有效的降低了技术门槛,非专业开发者也能通过拖拽和配置的方式开发应用,减少了对专业开发人员的依赖。

Sentosa_DSML社区版提供了易于配置的算子流,减少了编写和调试代码的时间,并提升了模型开发和部署的效率,由于应用的结构更清晰,维护和更新变得更加容易,且平台通常会提供版本控制和更新功能,使得应用的持续改进更为便捷。

为了非商业用途的科研学者、研究人员及开发者提供学习、交流及实践机器学习技术,推出了一款轻量化且完全免费的Sentosa_DSML社区版。以轻量化一键安装、平台免费使用、视频教学和社区论坛服务为主要特点,能够与其他数据科学家和机器学习爱好者交流心得,分享经验和解决问题。文章最后附上官网链接,感兴趣工具的可以直接下载使用

https://sentosa.znv.com/

Sentosa_DSML算子流开发视频

相关文章:

【机器学习(四)】分类和回归任务-梯度提升决策树(GBDT)-Sentosa_DSML社区版

文章目录 一、算法概念一、算法原理(一) GBDT 及负梯度拟合原理(二) GBDT 回归和分类1、GBDT回归1、GBDT分类二元分类多元分类 (三)损失函数1、回归问题的损失函数2. 分类问题的损失函数: 三、G…...

Mini-Omni 语言模型在流式传输中边思考边听说应用

引入简介 Mini-Omni 是一个开源的多模态大语言模型,能够在思考的同时进行听觉和语言交流。它具有实时端到端语音输入和流媒体音频输出的对话能力。 语言模型的最新进展取得了显著突破。GPT-4o 作为一个新的里程碑,实现了与人类的实时对话,展示了接近人类的自然流畅度。为了…...

vue devtools的使用

vue devtools的使用 Vue Devtools 是一个强大的浏览器扩展,旨在帮助你调试和开发 Vue.js 应用。它支持 Chrome 和 Firefox 浏览器,并提供了一些工具和功能,可以让你更轻松地查看和调试 Vue 应用的状态和行为。以下是如何安装和使用 Vue Devtools 的详细指南。 安装 Vue De…...

无人机培训:无人机维护保养技术详解

随着无人机技术的飞速发展,其在航拍、农业、救援、环境监测等领域的应用日益广泛。然而,要确保无人机安全、高效地执行任务,定期的维护保养至关重要。本文将深入解析无人机维护保养的核心技术,涵盖基础构造理解、清洁与防尘、电机…...

Mac 创建 Python 虚拟环境

在 macOS 上,您可以使用以下步骤使用 virtualenv 创建虚拟环境: 首先,确保您已经安装了 Python 和 virtualenv。您可以在终端中运行以下命令来检查它们是否已安装: python --version virtualenv --version如果这些命令没有找到&am…...

安卓玩机工具-----无需root权限 卸载 禁用 删除当前机型app应用 ADB玩机工具

ADB玩机工具 ADB AppControl是很实用的安卓手机应用管理工具,无需root权限,通过usb连接电脑后,可以很方便的进行应用程序安装与卸载,还支持提取手机应用apk文件到电脑上,此外还有手机系统垃圾清理、上传文件等…...

中国科技统计年鉴1991-2020年

(数据收集)中国科技统计年鉴1991-2020年.Excel格式资源-CSDN文库https://download.csdn.net/download/2401_84585615/89475658 《中国科技统计年鉴》是由国家统计局社会科技和文化产业统计司与科学技术部战略规划司共同编辑的官方统计资料书,…...

OpenAI / GPT-4o:Python 返回结构化 / JSON 输出

在调用 OpenAI(比如:GPT-4o)接口时,希望返回的结果是能够在后续任务中自动化处理的结构化 / JSON 输出。GPT 版本:gpt-4o-2024-08-06,提供了这样的功能。 目标:从非结构化输入到结构化数据&…...

通信工程学习:什么是EDFA掺铒光纤放大器

EDFA:掺铒光纤放大器 EDFA,即掺铒光纤放大器(Erbium-Doped Fiber Amplifier),是一种在光纤通信中广泛使用的光放大器件。以下是对EDFA的详细解释: 一、定义与基本原理 EDFA是在石英光纤中掺入少量的稀土元…...

机器学习与深度学习的区别

随着人工智能技术的迅猛发展,机器学习(Machine Learning, ML)和深度学习(Deep Learning, DL)这两个术语越来越频繁地出现在人们的视野中。尽管它们之间有着紧密的联系,但实际上二者存在显著的区别。本文旨在…...

标准库标头 <barrier>(C++20)学习

此头文件是线程支持库的一部分。 类模板 std::barrier 提供一种线程协调机制,阻塞已知大小的线程组直至该组中的所有线程到达该屏障。不同于 std::latch,屏障是可重用的:一旦到达的线程组被解除阻塞,即可重用同一屏障。与 std::l…...

如何测量一个(传输网络)系统的容量

Little 定律就能反算系统容量,但我这篇文章要正着算。 假想一个理发店场景。李大爷拥有一家占地 50 平米的理发店,经理到店里理发如果已经有经理在理发,就要拿个券等待,请问李大爷需要印多少等待券? 这是个系统容量问…...

【MySQL】MySQL和Workbench版本兼容问题

1、安装MySQL WorkBench 最新版本下载:https://dev.mysql.com/downloads/workbench/ 历史版本下载:https://downloads.mysql.com/archives/workbench/ 2、问题描述 本人在Windows下安装了一个旧版本的MySQL(5.1),同…...

---后台搜索Cache优化)

项目实战 ---- 商用落地视频搜索系统(10)---后台搜索Cache优化

目录 背景 技术实现策略 视频预处理阶段的cache技术 视频搜索阶段的cache技术 技术实现 预处理阶段cache策略实现 逻辑 代码 运行结果 问题及注意点 搜索阶段cache策略实现 系统配置层面 逻辑 低版本 GPU CPU 本项目的配置 高版本 描述 go ahead 策略 cac…...

)

客户端(服务器下载文件)

一、客户端代码 客户端代码 //实现TCP客户端通信 #include<stdio.h> #include<unistd.h> #include<sys/stat.h> #include<sys/types.h> #include<sys/socket.h> #include<string.h> #include<netinet/ip.h> #include<netinet/in…...

)

P1544 三倍经验 (记忆化搜索)

三倍经验 题目描述 数字金字塔由 n n n 行整数组成,第 i ( 1 ≤ i ≤ n ) i(1\le i\le n) i(1≤i≤n) 行有 i i i 个数字,一个示例如下。 73 98 1 02 7 4 4 4 5 2 6 5现在你在金字塔的顶部(第一行)&…...

【在Python中创建简单界面计算器】

在Python中创建带有简单界面的计算器,我们可以继续使用Tkinter库,这是一个非常流行且易于使用的GUI库。下面是一个简单的计算器实现,它支持加、减、乘、除四种基本运算。 首先,确保你的Python环境中已经安装了Tkinter。Tkinter通…...

【四范式】浅谈NLP发展的四个范式

自然语言处理(Natural Language Processing,NLP)是计算机科学,人工智能,语言学关于计算机和人类自然语言之间的相互作用的领域,是计算机科学领域与人工智能领域中的一个重要方向。NLP发展到今天已经进入到了…...

--- 数据结构 优先级队列 --- java

之前提高到队列是一种先进先出的结构,但是在某些情况下操作的数据具有优先级,那么对他先进行操作,这时队列就不能满足需求了,因为队列只能操作对头的元素,而具有优先级的数据不一定是在对头,这样就需要优先…...

鸿萌数据恢复服务:如何恢复 Mac 系统中被擦除的文件?

天津鸿萌科贸发展有限公司从事数据安全服务二十余年,致力于为各领域客户提供专业的数据备份、数据恢复解决方案与服务,并针对企业面临的数据安全风险,提供专业的相关数据安全培训。 公司是多款国际主流数据恢复软件的授权代理商,为…...

国防科技大学计算机基础课程笔记02信息编码

1.机内码和国标码 国标码就是我们非常熟悉的这个GB2312,但是因为都是16进制,因此这个了16进制的数据既可以翻译成为这个机器码,也可以翻译成为这个国标码,所以这个时候很容易会出现这个歧义的情况; 因此,我们的这个国…...

SkyWalking 10.2.0 SWCK 配置过程

SkyWalking 10.2.0 & SWCK 配置过程 skywalking oap-server & ui 使用Docker安装在K8S集群以外,K8S集群中的微服务使用initContainer按命名空间将skywalking-java-agent注入到业务容器中。 SWCK有整套的解决方案,全安装在K8S群集中。 具体可参…...

51c自动驾驶~合集58

我自己的原文哦~ https://blog.51cto.com/whaosoft/13967107 #CCA-Attention 全局池化局部保留,CCA-Attention为LLM长文本建模带来突破性进展 琶洲实验室、华南理工大学联合推出关键上下文感知注意力机制(CCA-Attention),…...

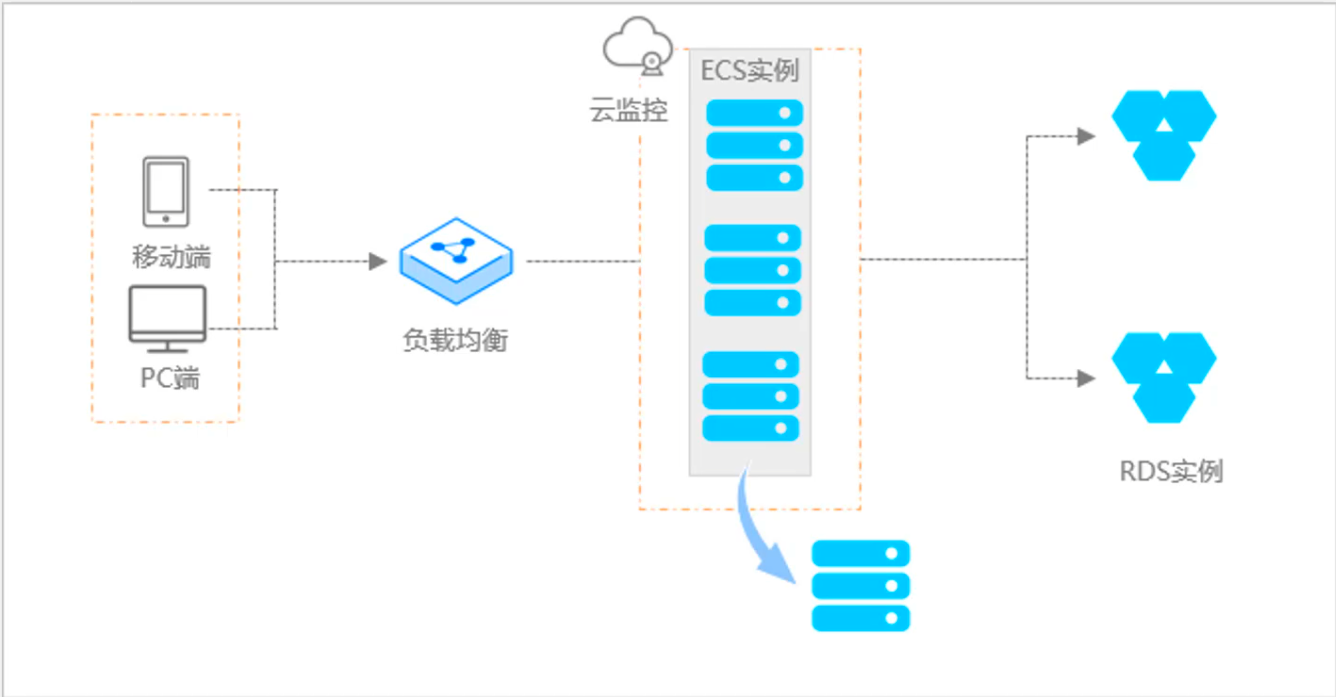

阿里云ACP云计算备考笔记 (5)——弹性伸缩

目录 第一章 概述 第二章 弹性伸缩简介 1、弹性伸缩 2、垂直伸缩 3、优势 4、应用场景 ① 无规律的业务量波动 ② 有规律的业务量波动 ③ 无明显业务量波动 ④ 混合型业务 ⑤ 消息通知 ⑥ 生命周期挂钩 ⑦ 自定义方式 ⑧ 滚的升级 5、使用限制 第三章 主要定义 …...

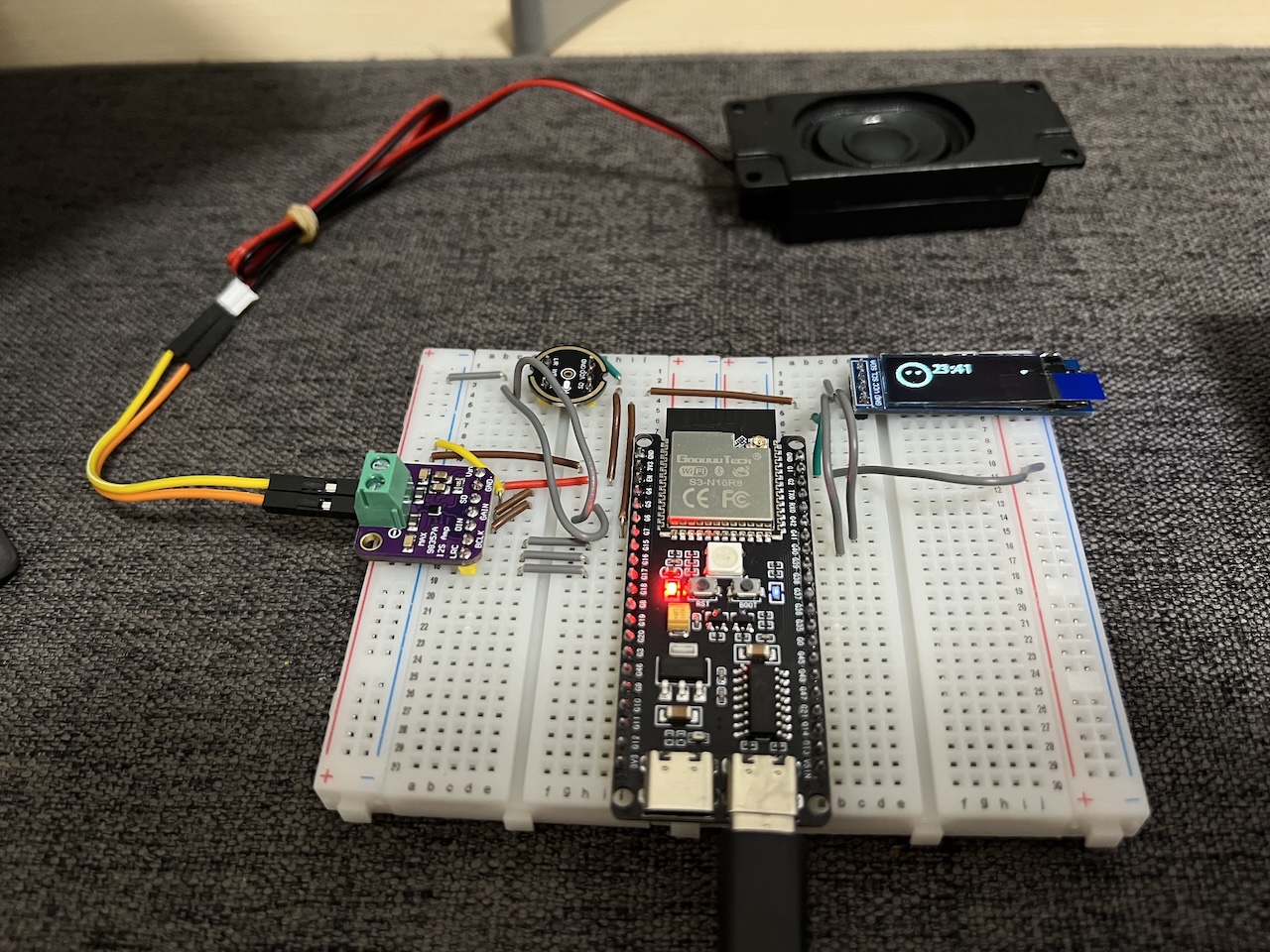

DIY|Mac 搭建 ESP-IDF 开发环境及编译小智 AI

前一阵子在百度 AI 开发者大会上,看到基于小智 AI DIY 玩具的演示,感觉有点意思,想着自己也来试试。 如果只是想烧录现成的固件,乐鑫官方除了提供了 Windows 版本的 Flash 下载工具 之外,还提供了基于网页版的 ESP LA…...

Java 加密常用的各种算法及其选择

在数字化时代,数据安全至关重要,Java 作为广泛应用的编程语言,提供了丰富的加密算法来保障数据的保密性、完整性和真实性。了解这些常用加密算法及其适用场景,有助于开发者在不同的业务需求中做出正确的选择。 一、对称加密算法…...

Rust 异步编程

Rust 异步编程 引言 Rust 是一种系统编程语言,以其高性能、安全性以及零成本抽象而著称。在多核处理器成为主流的今天,异步编程成为了一种提高应用性能、优化资源利用的有效手段。本文将深入探讨 Rust 异步编程的核心概念、常用库以及最佳实践。 异步编程基础 什么是异步…...

鱼香ros docker配置镜像报错:https://registry-1.docker.io/v2/

使用鱼香ros一件安装docker时的https://registry-1.docker.io/v2/问题 一键安装指令 wget http://fishros.com/install -O fishros && . fishros出现问题:docker pull 失败 网络不同,需要使用镜像源 按照如下步骤操作 sudo vi /etc/docker/dae…...

CMake控制VS2022项目文件分组

我们可以通过 CMake 控制源文件的组织结构,使它们在 VS 解决方案资源管理器中以“组”(Filter)的形式进行分类展示。 🎯 目标 通过 CMake 脚本将 .cpp、.h 等源文件分组显示在 Visual Studio 2022 的解决方案资源管理器中。 ✅ 支持的方法汇总(共4种) 方法描述是否推荐…...

无人机侦测与反制技术的进展与应用

国家电网无人机侦测与反制技术的进展与应用 引言 随着无人机(无人驾驶飞行器,UAV)技术的快速发展,其在商业、娱乐和军事领域的广泛应用带来了新的安全挑战。特别是对于关键基础设施如电力系统,无人机的“黑飞”&…...