循环神经网络RNN完全解析:从基础理论到PyTorch实战

目录

- 一、循环神经网络全解

- 1.1 什么是循环神经网络

- 网络结构

- 工作原理

- 数学模型

- RNN的优缺点

- 总结

- 1.2 循环神经网络的工作原理

- RNN的时间展开

- 数学表述

- 信息流动

- 实现示例

- 梯度问题:梯度消失和爆炸

- 总结

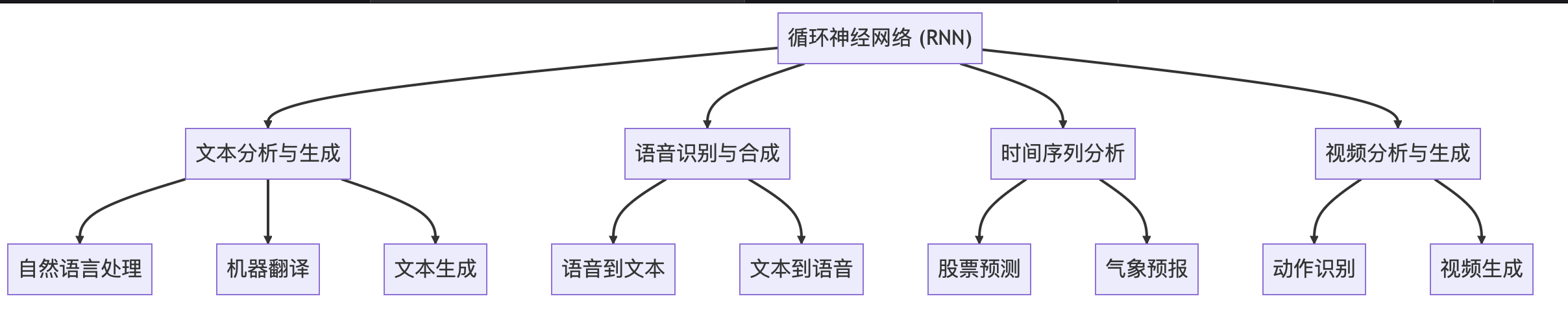

- 1.3 循环神经网络的应用场景

- 文本分析与生成

- 1.3.1 自然语言处理

- 1.3.2 机器翻译

- 1.3.3 文本生成

- 语音识别与合成

- 1.3.4 语音到文本

- 1.3.5 文本到语音

- 时间序列分析

- 1.3.6 股票预测

- 1.3.7 气象预报

- 视频分析与生成

- 1.3.8 动作识别

- 1.3.9 视频生成

- 总结

- 循环神经网络的主要变体

- 2.1 长短时记忆网络(LSTM)

- LSTM的结构

- 2.1.1 遗忘门

- 2.1.2 输入门

- 2.1.3 单元状态

- 2.1.4 输出门

- 数学表述

- LSTM的实现示例

- LSTM的优势和挑战

- 总结

- 2.2 门控循环单元(GRU)

- GRU的结构

- 2.2.1 重置门

- 2.2.2 更新门

- 2.2.3 新的记忆内容

- 数学表述

- GRU的实现示例

- GRU的优势和挑战

- 总结

- 2.3 双向循环神经网络(Bi-RNN)

- Bi-RNN的结构

- 2.3.1 正向层

- 2.3.2 反向层

- 信息合并

- Bi-RNN的实现示例

- Bi-RNN的应用

- Bi-RNN与其他RNN结构的结合

- 总结

- 三、从代码实现循环神经网络

- 3.1 环境准备和数据预处理

- 3.1.1 环境准备

- 3.1.2 数据预处理

- 总结

- 3.2 使用PyTorch构建RNN模型

- 3.2.1 定义RNN结构

- 3.2.2 初始化模型

- 3.2.3 训练模型

- 3.2.4 模型评估和保存

- 总结

- 三、从代码实现循环神经网络

- 3.3 训练和评估模型

- 3.3.1 训练模型

- 3.3.1.1 训练循环

- 3.3.1.2 监控训练进度

- 3.3.2 评估模型

- 3.3.2.1 验证集评估

- 3.3.2.2 测试集评估

- 3.3.2.3 模型指标

- 3.3.3 超参数调优

- 总结

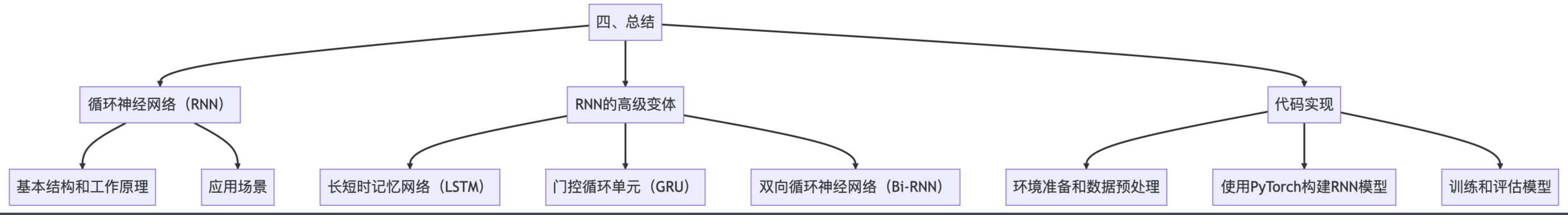

- 四、总结

- 4.1 循环神经网络(RNN)

- 4.2 RNN的高级变体

- 4.3 代码实现

- 4.4 结语

在本文中,我们深入探讨了循环神经网络(RNN)及其高级变体,包括长短时记忆网络(LSTM)、门控循环单元(GRU)和双向循环神经网络(Bi-RNN)。文章详细介绍了RNN的基本概念、工作原理和应用场景,同时提供了使用PyTorch构建、训练和评估RNN模型的完整代码指南。

作者 TechLead,拥有10+年互联网服务架构、AI产品研发经验、团队管理经验,同济本复旦硕,复旦机器人智能实验室成员,阿里云认证的资深架构师,项目管理专业人士,上亿营收AI产品研发负责人。

一、循环神经网络全解

1.1 什么是循环神经网络

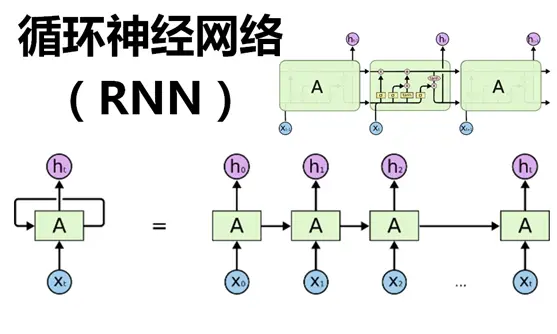

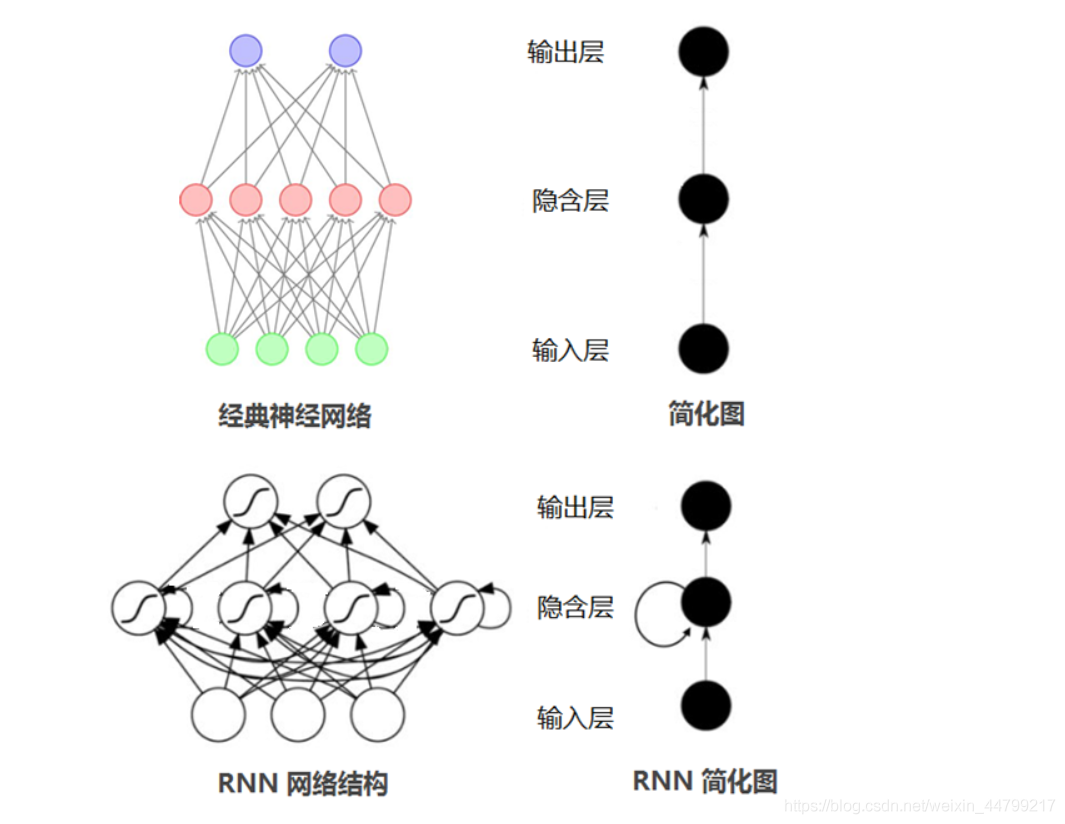

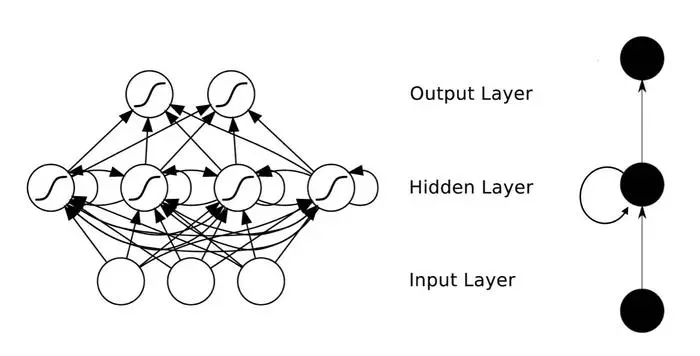

循环神经网络(Recurrent Neural Network, RNN)是一类具有内部环状连接的人工神经网络,用于处理序列数据。其最大特点是网络中存在着环,使得信息能在网络中进行循环,实现对序列信息的存储和处理。

网络结构

RNN的基本结构如下:

# 一个简单的RNN结构示例

class SimpleRNN(nn.Module):def __init__(self, input_size, hidden_size):super(SimpleRNN, self).__init__()self.rnn = nn.RNN(input_size, hidden_size, batch_first=True)def forward(self, x):out, _ = self.rnn(x)return out

工作原理

-

输入层:RNN能够接受一个输入序列(例如文字、股票价格、语音信号等)并将其传递到隐藏层。

-

隐藏层:隐藏层之间存在循环连接,使得网络能够维护一个“记忆”状态,这一状态包含了过去的信息。这使得RNN能够理解序列中的上下文信息。

-

输出层:RNN可以有一个或多个输出,例如在序列生成任务中,每个时间步都会有一个输出。

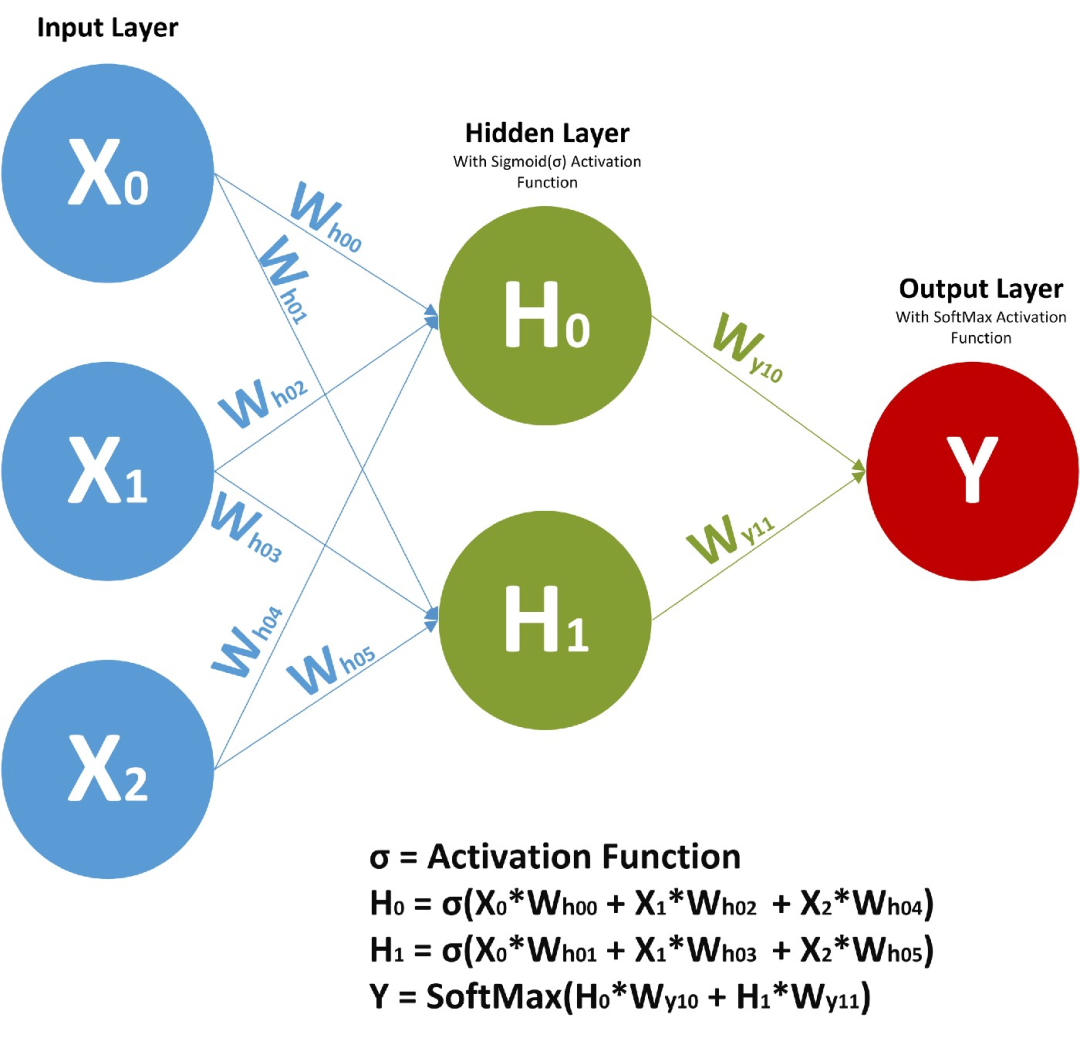

数学模型

RNN的工作原理可以通过以下数学方程表示:

- 输入到隐藏层的转换:[ h_t = \tanh(W_{ih} \cdot x_t + b_{ih} + W_{hh} \cdot h_{t-1} + b_{hh}) ]

- 隐藏层到输出层的转换:[ y_t = W_{ho} \cdot h_t + b_o ]

其中,( h_t ) 表示在时间 ( t ) 的隐藏层状态,( x_t ) 表示在时间 ( t ) 的输入,( y_t ) 表示在时间 ( t ) 的输出。

RNN的优缺点

优点:

- 能够处理不同长度的序列数据。

- 能够捕捉序列中的时间依赖关系。

缺点:

- 对长序列的记忆能力较弱,可能出现梯度消失或梯度爆炸问题。

- 训练可能相对复杂和时间消耗大。

总结

循环神经网络是一种强大的模型,特别适合于处理具有时间依赖性的序列数据。然而,标准RNN通常难以学习长序列中的依赖关系,因此有了更多复杂的变体如LSTM和GRU,来解决这些问题。不过,RNN的基本理念和结构仍然是深度学习中序列处理的核心组成部分。

1.2 循环神经网络的工作原理

循环神经网络(RNN)的工作原理是通过网络中的环状连接捕获序列中的时间依赖关系。下面我们将详细解释其工作机制。

RNN的时间展开

RNN的一个重要特点是可以通过时间展开来理解。这意味着,虽然网络结构在每个时间步看起来相同,但我们可以将其展开为一系列的网络层,每一层对应于序列中的一个特定时间步。

数学表述

RNN可以通过下列数学方程描述:

- 隐藏层状态:[ h_t = \sigma(W_{hh} \cdot h_{t-1} + W_{ih} \cdot x_t + b_h) ]

- 输出层状态:[ y_t = W_{ho} \cdot h_t + b_o ]

其中,( \sigma ) 是一个激活函数(如tanh或ReLU),( h_t ) 是当前隐藏状态,( x_t ) 是当前输入,( y_t ) 是当前输出。权重和偏置分别由( W_{hh}, W_{ih}, W_{ho} ) 和 ( b_h, b_o ) 表示。

信息流动

-

输入到隐藏:每个时间步,RNN从输入层接收一个新的输入,并将其与之前的隐藏状态结合起来,以生成新的隐藏状态。

-

隐藏到隐藏:隐藏层之间的循环连接使得信息可以在时间步之间传播,从而捕捉序列中的依赖关系。

-

隐藏到输出:每个时间步的隐藏状态都会传递到输出层,以生成对应的输出。

实现示例

# RNN的PyTorch实现

import torch.nn as nnclass SimpleRNN(nn.Module):def __init__(self, input_size, hidden_size, output_size):super(SimpleRNN, self).__init__()self.rnn = nn.RNN(input_size, hidden_size, batch_first=True)self.fc = nn.Linear(hidden_size, output_size)def forward(self, x, h_0):out, h_n = self.rnn(x, h_0) # 运用RNN层out = self.fc(out) # 运用全连接层return out

梯度问题:梯度消失和爆炸

由于RNN的循环结构,在训练中可能会出现梯度消失或梯度爆炸的问题。长序列可能会导致训练过程中的梯度变得非常小(消失)或非常大(爆炸),从而影响模型的学习效率。

总结

循环神经网络的工作原理强调了序列数据的时间依赖关系。通过时间展开和信息的连续流动,RNN能够理解和处理序列中的复杂模式。不过,RNN的训练可能受到梯度消失或爆炸的挑战,需要采用适当的技术和结构来克服。

1.3 循环神经网络的应用场景

循环神经网络(RNN)因其在捕获序列数据中的时序依赖性方面的优势,在许多应用场景中都得到了广泛的使用。以下是一些主要应用领域的概述:

文本分析与生成

1.3.1 自然语言处理

RNN可用于词性标注、命名实体识别、句子解析等任务。通过捕获文本中的上下文关系,RNN能够理解并处理语言的复杂结构。

1.3.2 机器翻译

RNN能够理解和生成不同语言的句子结构,使其在机器翻译方面特别有效。

1.3.3 文本生成

利用RNN进行文本生成,如生成诗歌、故事等,实现了机器的创造性写作。

语音识别与合成

1.3.4 语音到文本

RNN可以用于将语音信号转换为文字,即语音识别(Speech to Text),理解声音中的时序依赖关系。

1.3.5 文本到语音

RNN也用于文本到语音(Text to Speech)的转换,生成流畅自然的语音。

时间序列分析

1.3.6 股票预测

通过分析历史股票价格和交易量等数据的时间序列,RNN可以用于预测未来的股票走势。

1.3.7 气象预报

RNN通过分析气象数据的时间序列,可以预测未来的天气情况。

视频分析与生成

1.3.8 动作识别

RNN能够分析视频中的时序信息,用于识别人物动作和行为模式等。

1.3.9 视频生成

RNN还可以用于视频内容的生成,如生成具有连续逻辑的动画片段。

总结

RNN的这些应用场景共同反映了其在理解和处理具有时序依赖关系的序列数据方面的强大能力。无论是自然语言处理、语音识别、时间序列分析,还是视频内容分析,RNN都已成为实现这些任务的重要工具。其在捕获长期依赖、理解复杂结构和生成连续序列方面的特性,使其成为深度学习中处理序列问题的首选方法。

循环神经网络的主要变体

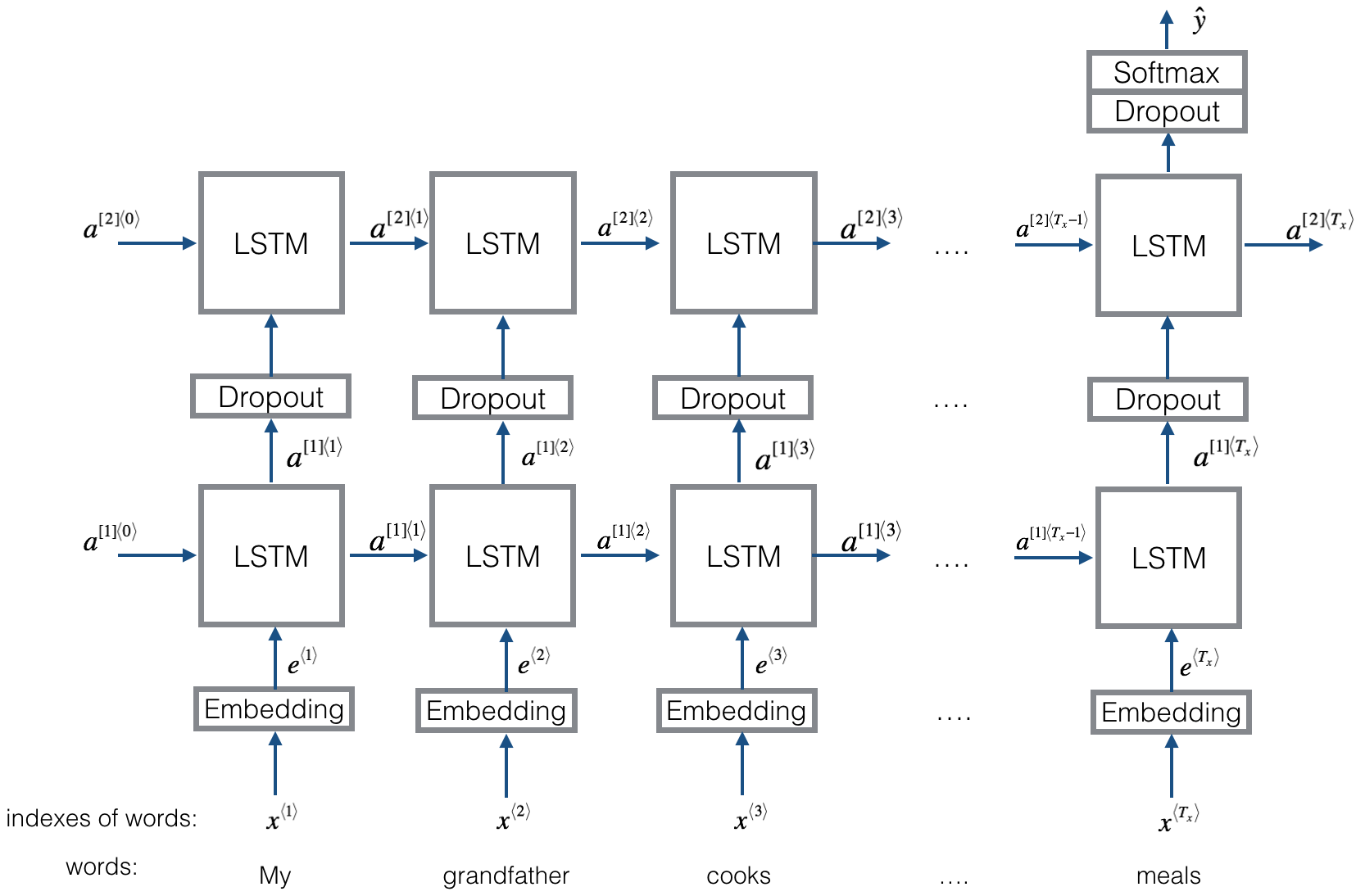

2.1 长短时记忆网络(LSTM)

长短时记忆网络(Long Short-Term Memory,LSTM)是一种特殊的RNN结构,由Hochreiter和Schmidhuber在1997年提出。LSTM旨在解决传统RNN在训练长序列时遇到的梯度消失问题。

LSTM的结构

LSTM的核心是其复杂的记忆单元结构,包括以下组件:

2.1.1 遗忘门

控制哪些信息从单元状态中被丢弃。

2.1.2 输入门

控制新信息的哪些部分要存储在单元状态中。

2.1.3 单元状态

储存过去的信息,通过遗忘门和输入门的调节进行更新。

2.1.4 输出门

控制单元状态的哪些部分要读取和输出。

数学表述

LSTM的工作过程可以通过以下方程表示:

-

遗忘门:

[ f_t = \sigma(W_f \cdot [h_{t-1}, x_t] + b_f) ] -

输入门:

[ i_t = \sigma(W_i \cdot [h_{t-1}, x_t] + b_i) ] -

候选单元状态:

[ \tilde{C}t = \text{tanh}(W_C \cdot [h{t-1}, x_t] + b_C) ] -

更新单元状态:

[ C_t = f_t \cdot C_{t-1} + i_t \cdot \tilde{C}_t ] -

输出门:

[ o_t = \sigma(W_o \cdot [h_{t-1}, x_t] + b_o) ] -

隐藏状态:

[ h_t = o_t \cdot \text{tanh}(C_t) ]

其中,( \sigma ) 表示sigmoid激活函数。

LSTM的实现示例

# LSTM的PyTorch实现

import torch.nn as nnclass LSTM(nn.Module):def __init__(self, input_size, hidden_size, output_size):super(LSTM, self).__init__()self.lstm = nn.LSTM(input_size, hidden_size, batch_first=True)self.fc = nn.Linear(hidden_size, output_size)def forward(self, x, (h_0, c_0)):out, (h_n, c_n) = self.lstm(x, (h_0, c_0)) # 运用LSTM层out = self.fc(out) # 运用全连接层return out

LSTM的优势和挑战

LSTM通过引入复杂的门控机制解决了梯度消失的问题,使其能够捕获更长的序列依赖关系。然而,LSTM的复杂结构也使其在计算和参数方面相对昂贵。

总结

长短时记忆网络(LSTM)是循环神经网络的重要扩展,具有捕获长序列依赖关系的能力。通过引入门控机制,LSTM可以精细控制信息的流动,既能记住长期的依赖信息,也能忘记无关的细节。这些特性使LSTM在许多序列处理任务中都得到了广泛的应用。

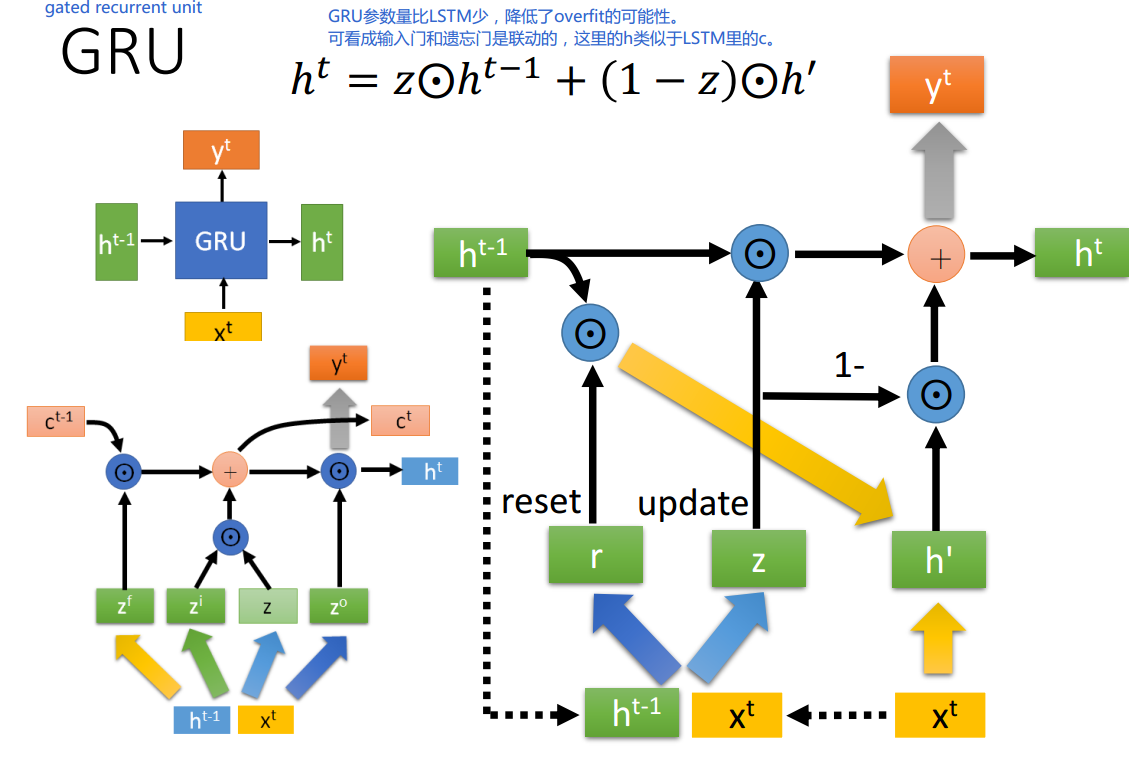

2.2 门控循环单元(GRU)

门控循环单元(Gated Recurrent Unit,GRU)是一种特殊的RNN结构,由Cho等人于2014年提出。GRU与LSTM相似,但其结构更简单,计算效率更高。

GRU的结构

GRU通过将忘记和输入门合并,减少了LSTM的复杂性。GRU的结构主要由以下组件构成:

2.2.1 重置门

控制过去的隐藏状态的哪些信息应该被忽略。

2.2.2 更新门

控制隐藏状态的哪些部分应该被更新。

2.2.3 新的记忆内容

计算新的候选隐藏状态,可能会与当前隐藏状态结合。

数学表述

GRU的工作过程可以通过以下方程表示:

-

重置门:

[ r_t = \sigma(W_r \cdot [h_{t-1}, x_t] + b_r) ] -

更新门:

[ z_t = \sigma(W_z \cdot [h_{t-1}, x_t] + b_z) ] -

新的记忆内容:

[ \tilde{h}t = \text{tanh}(W \cdot [r_t \odot h{t-1}, x_t] + b) ] -

最终隐藏状态:

[ h_t = (1 - z_t) \cdot h_{t-1} + z_t \cdot \tilde{h}_t ]

其中,( \sigma ) 表示sigmoid激活函数,( \odot ) 表示逐元素乘法。

GRU的实现示例

# GRU的PyTorch实现

import torch.nn as nnclass GRU(nn.Module):def __init__(self, input_size, hidden_size, output_size):super(GRU, self).__init__()self.gru = nn.GRU(input_size, hidden_size, batch_first=True)self.fc = nn.Linear(hidden_size, output_size)def forward(self, x, h_0):out, h_n = self.gru(x, h_0) # 运用GRU层out = self.fc(out) # 运用全连接层return out

GRU的优势和挑战

GRU提供了与LSTM类似的性能,但结构更简单,因此在计算和参数方面相对更有效率。然而,这种简化可能会在某些任务中牺牲一些表现力。

总结

门控循环单元(GRU)是一种有效的RNN结构,旨在捕获序列数据中的时序依赖关系。与LSTM相比,GRU具有更高的计算效率,同时仍保持了良好的性能。其在许多序列处理任务中的应用,如自然语言处理、语音识别等,进一步证明了其作为一种重要的深度学习工具的地位。

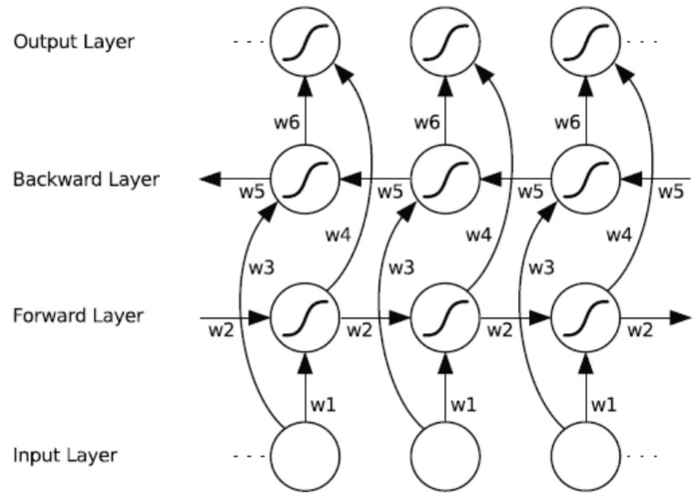

2.3 双向循环神经网络(Bi-RNN)

双向循环神经网络(Bidirectional Recurrent Neural Network,Bi-RNN)是一种能够捕获序列数据前后依赖关系的RNN架构。通过结合正向和反向的信息流,Bi-RNN可以更全面地理解序列中的模式。

Bi-RNN的结构

Bi-RNN由两个独立的RNN层组成,一个正向层和一个反向层。这两个层分别处理输入序列的正向和反向版本。

2.3.1 正向层

处理输入序列从第一个元素到最后一个元素。

2.3.2 反向层

处理输入序列从最后一个元素到第一个元素。

信息合并

正向和反向层的隐藏状态通常通过连接或其他合并方式结合在一起,以形成最终的隐藏状态。

Bi-RNN的实现示例

以下代码展示了使用PyTorch构建Bi-RNN的方法:

# Bi-RNN的PyTorch实现

import torch.nn as nnclass BiRNN(nn.Module):def __init__(self, input_size, hidden_size, output_size):super(BiRNN, self).__init__()self.rnn = nn.RNN(input_size, hidden_size, batch_first=True, bidirectional=True)self.fc = nn.Linear(hidden_size * 2, output_size)def forward(self, x):out, _ = self.rnn(x) # 运用双向RNN层out = self.fc(out) # 运用全连接层return out

Bi-RNN的应用

Bi-RNN在许多涉及序列分析的任务中非常有效,例如:

- 自然语言处理:通过捕获上下文信息,增强了对句子结构的理解。

- 语音识别:通过分析语音信号的前后依赖关系,提高了识别准确性。

Bi-RNN与其他RNN结构的结合

Bi-RNN可以与其他RNN结构(例如LSTM和GRU)相结合,进一步增强其能力。

总结

双向循环神经网络(Bi-RNN)通过同时分析序列的前向和反向信息,实现了对序列数据更深入的理解。其在诸如自然语言处理和语音识别等复杂任务中的成功应用,显示了Bi-RNN作为一种强大的深度学习模型的潜力和灵活性。

三、从代码实现循环神经网络

3.1 环境准备和数据预处理

为了成功实现循环神经网络,需要首先准备开发环境,并对数据进行适当的预处理。下面将详细介绍每个阶段的步骤。

3.1.1 环境准备

环境准备主要包括选择合适的编程语言、深度学习框架、硬件环境等。

- 编程语言:Python是深度学习中广泛使用的语言,有丰富的库和社区支持。

- 深度学习框架:PyTorch是一种流行的开源框架,具有强大的灵活性和易用性。

- 硬件要求:GPU加速通常可以显著提高训练速度。

# 安装PyTorch

!pip install torch torchvision

3.1.2 数据预处理

数据预处理是机器学习项目中的关键步骤,可以显著影响模型的性能。

- 数据加载:首先加载所需的数据集。

- 数据清洗:删除或替换缺失、重复或错误的值。

- 文本分词:如果是NLP任务,需要对文本进行分词处理。

- 序列填充:确保输入序列具有相同的长度。

- 归一化:对特征进行标准化处理。

- 数据分割:将数据分为训练集、验证集和测试集。

以下是数据预处理的示例代码:

# 用于数据预处理的PyTorch代码

from torch.utils.data import DataLoader

from torchvision import transforms# 定义转换

transform = transforms.Compose([transforms.ToTensor(),transforms.Normalize(mean=[0.5], std=[0.5]),

])# 加载数据集

train_dataset = CustomDataset(transform=transform)

train_loader = DataLoader(train_dataset, batch_size=32, shuffle=True)

总结

环境准备和数据预处理是循环神经网络实现过程中的基础阶段。选择合适的工具和硬件,并对数据进行适当的清洗和转换,是确保项目成功的关键。与此同时,使用合适的数据预处理技术可以显著提高模型的性能和稳定性。通过本节的介绍,读者应能够理解并实现循环神经网络所需的环境准备和数据预处理步骤。

3.2 使用PyTorch构建RNN模型

PyTorch是一种流行的深度学习框架,广泛用于构建和训练神经网络模型。在本节中,我们将介绍如何使用PyTorch构建基本的RNN模型。

3.2.1 定义RNN结构

RNN模型由输入层、隐藏层和输出层组成。以下是构建RNN的代码示例:

import torch.nn as nnclass SimpleRNN(nn.Module):def __init__(self, input_size, hidden_size, output_size):super(SimpleRNN, self).__init__()self.rnn = nn.RNN(input_size, hidden_size, batch_first=True)self.fc = nn.Linear(hidden_size, output_size)def forward(self, x):out, _ = self.rnn(x)out = self.fc(out)return out

这里,input_size表示输入特征的数量,hidden_size表示隐藏层神经元的数量,output_size表示输出层神经元的数量。

3.2.2 初始化模型

初始化模型涉及设置其参数和选择优化器与损失函数。

model = SimpleRNN(input_size=10, hidden_size=20, output_size=1)

optimizer = torch.optim.Adam(model.parameters(), lr=0.001)

criterion = nn.MSELoss()

3.2.3 训练模型

训练模型包括以下步骤:

- 前向传播:通过模型传递输入数据并计算输出。

- 计算损失:使用预测输出和实际目标计算损失。

- 反向传播:根据损失计算梯度。

- 优化器步骤:更新模型权重。

# 训练循环示例

for epoch in range(epochs):for batch in train_loader:inputs, targets = batchoutputs = model(inputs)loss = criterion(outputs, targets)optimizer.zero_grad()loss.backward()optimizer.step()

3.2.4 模型评估和保存

通过在验证集或测试集上评估模型,您可以了解其泛化性能。一旦满意,可以保存模型供以后使用。

# 保存模型

torch.save(model.state_dict(), 'model.pth')

总结

使用PyTorch构建RNN模型涉及多个步骤,包括定义模型结构、初始化、训练和评估。本节通过详细的代码示例和解释为读者提供了一个全面的指南,可以用来构建自己的RNN模型。在理解了基本的RNN之后,读者还可以进一步探索更复杂的变体,如LSTM、GRU和双向RNN。

三、从代码实现循环神经网络

3.3 训练和评估模型

训练和评估模型是深度学习工作流程的核心部分。本节将详细介绍如何使用PyTorch进行RNN模型的训练和评估。

3.3.1 训练模型

3.3.1.1 训练循环

训练循环是重复的过程,包括前向传播、损失计算、反向传播和优化权重。以下是典型的训练循环代码:

for epoch in range(epochs):for batch in train_loader:inputs, targets = batchoutputs = model(inputs)loss = criterion(outputs, targets)optimizer.zero_grad()loss.backward()optimizer.step()print(f'Epoch {epoch + 1}/{epochs}, Loss: {loss.item()}')

3.3.1.2 监控训练进度

通常使用验证集监控模型的训练进度,并使用如TensorBoard等工具可视化训练和验证损失。

3.3.2 评估模型

3.3.2.1 验证集评估

在验证集上评估模型可以了解模型在未见过的数据上的性能。

model.eval()

with torch.no_grad():for batch in val_loader:inputs, targets = batchoutputs = model(inputs)val_loss += criterion(outputs, targets).item()

print(f'Validation Loss: {val_loss/len(val_loader)}')

3.3.2.2 测试集评估

在测试集上的评估为您提供了模型在实际应用场景下可能的性能。

3.3.2.3 模型指标

除了损失外,还可以计算其他重要指标,例如准确率、精确度、召回率等。

3.3.3 超参数调优

超参数调优涉及使用诸如Grid Search或Random Search的技术来找到最佳超参数组合。

总结

训练和评估模型是深度学习项目的核心阶段。本节详细介绍了如何使用PyTorch进行训练循环、监控训练进度、评估模型、计算性能指标以及超参数调优。通过了解这些关键概念和技术,读者可以有效地训练和评估RNN模型,为实际应用做好准备。

四、总结

在本系列博客中,我们详细探讨了循环神经网络(RNN)的各个方面。以下是重要内容的总结:

4.1 循环神经网络(RNN)

我们介绍了RNN的基本结构和工作原理,以及它如何捕捉序列数据中的时间依赖关系。然后,我们深入了解了各种RNN的应用场景,涵盖了自然语言处理、时间序列分析等领域。

4.2 RNN的高级变体

- 长短时记忆网络(LSTM):解决了RNN长序列训练中的梯度消失和爆炸问题。

- 门控循环单元(GRU):与LSTM相似,但结构更简单。

- 双向循环神经网络(Bi-RNN):通过同时考虑过去和未来的信息,增强了序列建模的能力。

4.3 代码实现

- 环境准备和数据预处理:介绍了如何准备数据和环境。

- 使用PyTorch构建RNN模型:详细解释了如何使用PyTorch构建和训练RNN模型。

- 训练和评估模型:描述了完整的训练和评估流程,包括超参数调优和模型性能评估。

4.4 结语

通过深入了解RNN及其变体、理解它们的工作原理、掌握使用PyTorch进行实现的技巧,读者可以充分利用RNN在复杂序列数据分析方面的强大功能。这种知识不仅可用于当前的项目,还为未来的研究和开发工作奠定了坚实的基础。循环神经网络是深度学习中的一个重要分支,通过不断探索和学习,我们可以继续推动这一领域的创新和进展。

作者 TechLead,拥有10+年互联网服务架构、AI产品研发经验、团队管理经验,同济本复旦硕,复旦机器人智能实验室成员,阿里云认证的资深架构师,项目管理专业人士,上亿营收AI产品研发负责人。

相关文章:

循环神经网络RNN完全解析:从基础理论到PyTorch实战

目录 一、循环神经网络全解1.1 什么是循环神经网络网络结构工作原理数学模型RNN的优缺点总结 1.2 循环神经网络的工作原理RNN的时间展开数学表述信息流动实现示例梯度问题:梯度消失和爆炸总结 1.3 循环神经网络的应用场景文本分析与生成1.3.1 自然语言处理1.3.2 机器…...

【SA8295P 源码分析】52 - 答疑之 QNX 创建镜像、Android修改CMDLINE

【SA8295P 源码分析】52 - 答疑之 QNX 创建镜像、Android修改CMDLINE 一、QNX 侧创建 img 镜像二、QNX 侧指定只编译某一个版本三、Android定制修改selinux权限,user版本采用enforcing,userdebug版本permissive系列文章汇总见:《【SA8295P 源码分析】00 - 系列文章链接汇总》…...

网络安全法律

立法的必要性:网络渗透,网络入侵,网络诈骗,网上钓鱼侵犯知识产权,宣传恐怖主义,极端主义等伤害共鸣利益的行为越发猖狂 信息系统运维安全管理规定(范文)| 资料 过程: 14-16 草案初…...

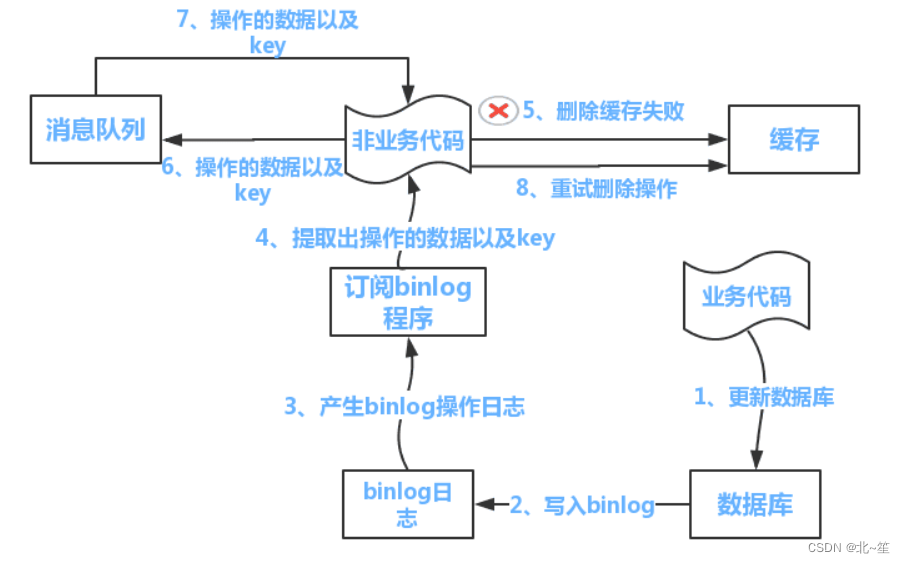

Redis缓存问题(穿透, 击穿, 雪崩, 污染, 一致性)

目录 1.什么是Redis缓存问题? 2.缓存穿透 3.缓存击穿 4.缓存雪崩 5.缓存污染(或满了) 5.1 最大缓存设置多大 5.2 缓存淘汰策略 6.数据库和缓存一致性 6.1 4种相关模式 6.2 方案:队列重试机制 6.3 方案:异步更新缓…...

网络时代拟态环境的复杂化

信息在网络上的制作、编码、传播机制和传统媒介有本质的区别,即传播者和 受传者的角色交叉,而且互联网本身可看作另一个有别于现实环境的虚拟世界,因 此网络媒介所营造出的拟态环境在一定程度上独立于传统大众传播的拟态环境。 一个是传统…...

湘潭大学 湘大 XTU OJ 1055 整数分类 题解(非常详细)

链接 整数分类 题目 Description 按照下面方法对整数x进行分类:如果x是一个个位数,则x属于x类;否则将x的各位上的数码累加,得到一个新的x,依次迭代,可以得到x的所属类。比如说24,246&#…...

什么是视频的编码和解码

这段描述中,视频解码能力和视频编码能力指的是不同的处理过程。视频解码是将压缩过的视频数据解开并还原为可播放的视频流,而视频编码是将原始视频数据压缩成更小的尺寸,以减少存储空间和传输带宽。在这个上下文中,解码能力和编码…...

LeetCode 2681. Power of Heroes【排序,数学,贡献法】2060

本文属于「征服LeetCode」系列文章之一,这一系列正式开始于2021/08/12。由于LeetCode上部分题目有锁,本系列将至少持续到刷完所有无锁题之日为止;由于LeetCode还在不断地创建新题,本系列的终止日期可能是永远。在这一系列刷题文章…...

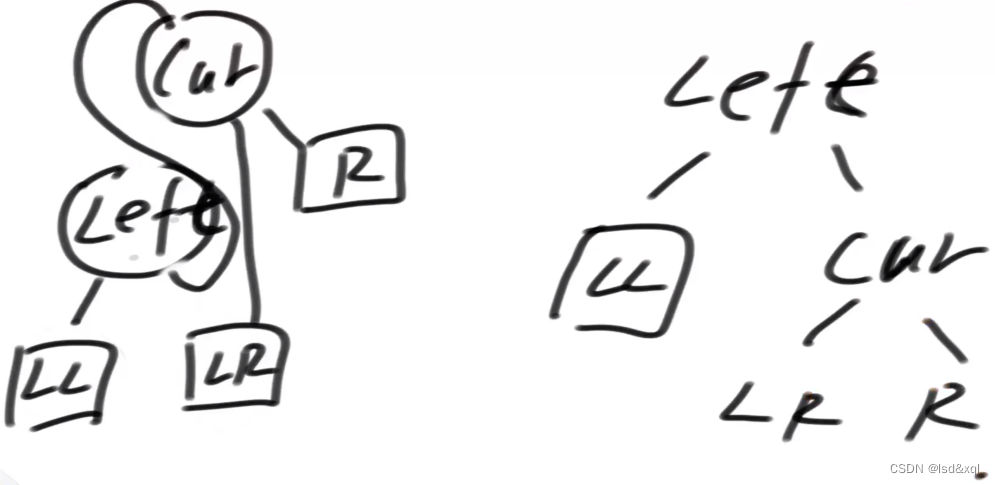

AVL树的讲解

算法拾遗三十八AVL树 AVL树AVL树平衡性AVL树加入节点AVL删除节点AVL树代码 AVL树 AVL树具有最严苛的平衡性,(增、删、改、查)时间复杂度为O(logN),AVL树任何一个节点,左树的高度和右树的高度差…...

Unity 之 Input类

文章目录 总述具体介绍 总述 Input 类是 Unity 中用于处理用户输入的重要工具,它允许您获取来自键盘、鼠标、触摸屏和控制器等设备的输入数据。通过 Input 类,您可以轻松地检测按键、鼠标点击、鼠标移动、触摸、控制器按钮等用户输入事件。以下是关于 I…...

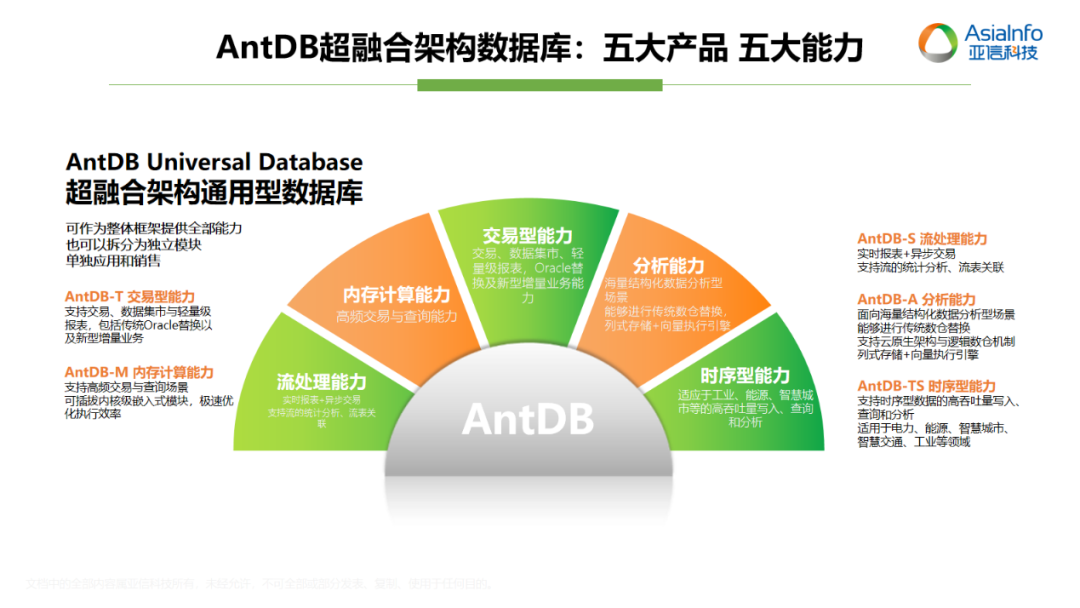

亚信科技AntDB数据库连年入选《中国DBMS市场指南》代表厂商

近日,全球权威ICT研究与顾问咨询公司Gartner发布了2023年《Market Guide for DBMS, China》(即“中国DBMS市场指南”),该指南从市场份额、技术创新、研发投入等维度对DBMS供应商进行了调研。亚信科技是领先的数智化全栈能力提供商…...

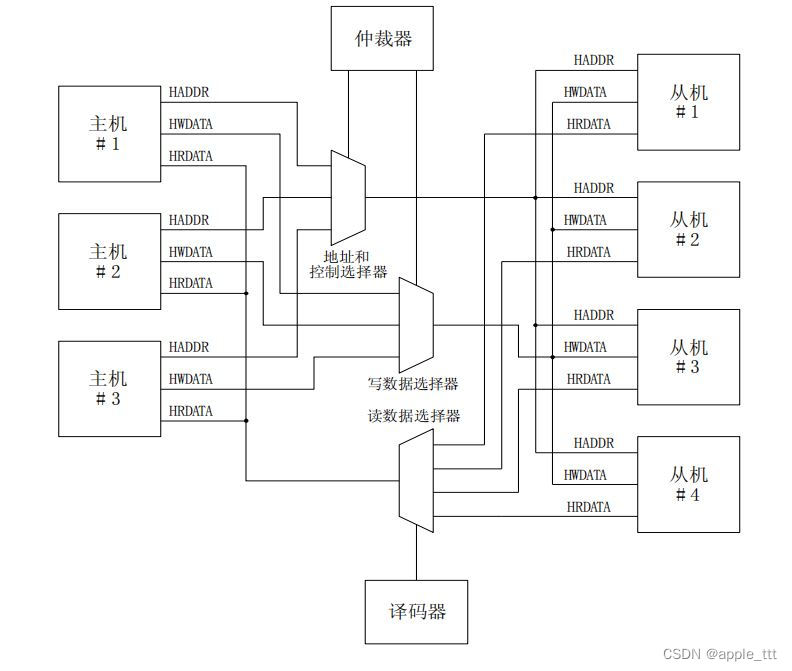

AMBA总线协议(3)——AHB(一)

目录 一、前言 二、什么是AHB总线 1、概述 2、一个典型的基于AHB总线的微处理器架构 3、基本的 AHB 传送特性 三、AMBA AHB总线互联 四、小结 一、前言 在之前的文章中我们初步的了解了一下AMBA总线中AHB,APB,AXI的信号线及其功能,从本文开始我们…...

Git commit与pull的先后顺序

Git commit与pull的先后顺序_git先pull再commit_Mordor Java Girl的博客-CSDN博客 编辑yucoang2020.04.21 回复 28 先pull再commit的话, 你的commit也就不再纯粹了. 这一个commit不再是"你所编辑的xxx功能, 而是"别人所编辑的你所编辑的xxx". 我认为提交历…...

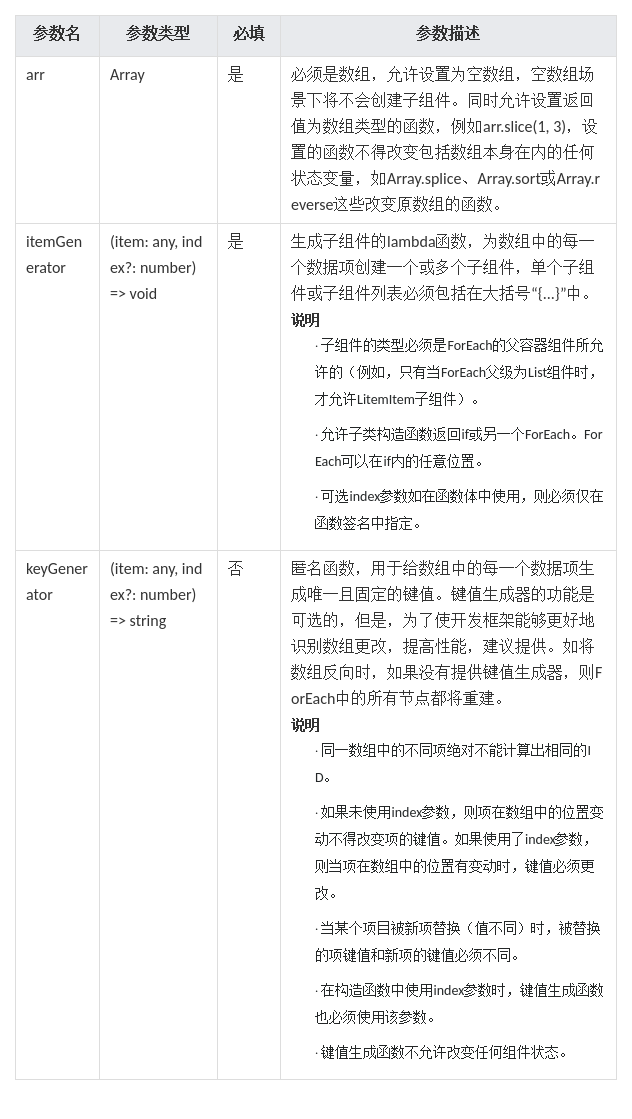

HarmonyOS/OpenHarmony应用开发-ArkTS语言渲染控制ForEach循环渲染

ForEach基于数组类型数据执行循环渲染。说明,从API version 9开始,该接口支持在ArkTS卡片中使用。 一、接口描述 ForEach(arr: any[], itemGenerator: (item: any, index?: number) > void,keyGenerator?: (item: any, index?: number) > stri…...

Powered by Paraverse | 平行云助力彼真科技打造演出“新物种”

01 怎么看待虚拟演出 彼真科技 我们怎么看待虚拟演出? 虚拟演出给音乐人或者音乐行业带来了哪些新的机会?通过呈现一场高标准的虚拟演出,我们的能力延伸点在哪里? 先说一下我们认知里的虚拟演出的本质: 音乐演出是一…...

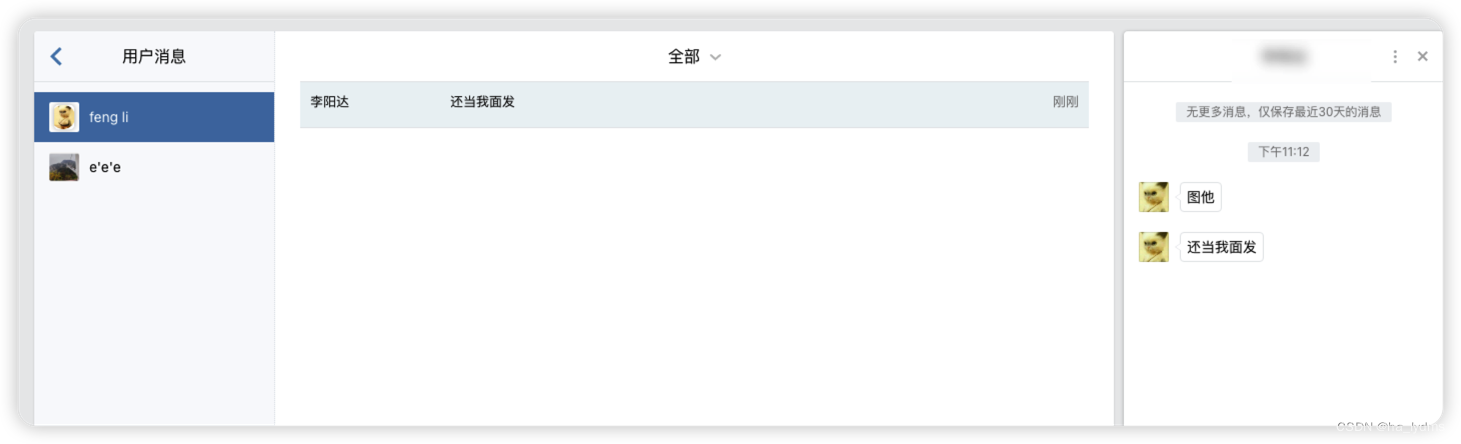

企微配置回调服务

1、企微配置可信域名 2、企微获取成员userID 3、企微获取用户敏感数据 4、企微配置回调服务 文章目录 一、简介1、概述2、相关文档地址 二、企微配置消息服务器1、配置消息接收参数2、参数解析3、参数拼接规则 三、代码编写—使用已有库1、代码下载2、代码修改3、服务代码编写 …...

机器人远程控制软件设计

机器人远程控制软件设计 That’s all....

:React中的虚拟DOM是什么?)

面试题-React(二):React中的虚拟DOM是什么?

一、什么是虚拟DOM? 虚拟DOM是React的核心概念之一,它是一个轻量级的JavaScript对象树,用于表示真实DOM的状态。在React中,当数据发生变化时,首先会在虚拟DOM上执行DOM更新,而不是直接操作真实DOM。然后&a…...

分布式链路追踪——Dapper, a Large-Scale Distributed Systems Tracing Infrastructure

要解决的问题 如何记录请求经过多个分布式服务的信息,以便分析问题所在?如何保证这些信息得到完整的追踪?如何尽可能不影响服务性能? 追踪 当用户请求到达前端A,将会发送rpc请求给中间层B、C;B可以立刻作…...

【IEEE会议】第二届IEEE云计算、大数据应用与软件工程国际学术会议 (CBASE2023)

第二届IEEE云计算、大数据应用与软件工程国际学术会议 (CBASE2023) 随着大数据时代的到来,对数据获取的随时性和对计算的需求也在逐渐增长。为推动大数据时代的云计算与软件工程的发展,促进该领域学术交流,在CBASE 2022成功举办的…...

AI-调查研究-01-正念冥想有用吗?对健康的影响及科学指南

点一下关注吧!!!非常感谢!!持续更新!!! 🚀 AI篇持续更新中!(长期更新) 目前2025年06月05日更新到: AI炼丹日志-28 - Aud…...

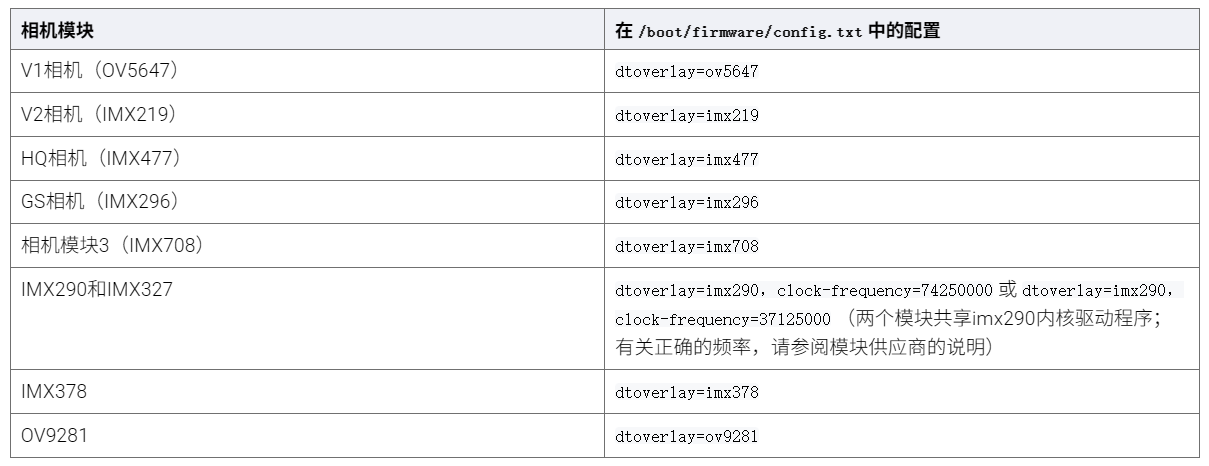

树莓派超全系列教程文档--(61)树莓派摄像头高级使用方法

树莓派摄像头高级使用方法 配置通过调谐文件来调整相机行为 使用多个摄像头安装 libcam 和 rpicam-apps依赖关系开发包 文章来源: http://raspberry.dns8844.cn/documentation 原文网址 配置 大多数用例自动工作,无需更改相机配置。但是,一…...

以下是对华为 HarmonyOS NETX 5属性动画(ArkTS)文档的结构化整理,通过层级标题、表格和代码块提升可读性:

一、属性动画概述NETX 作用:实现组件通用属性的渐变过渡效果,提升用户体验。支持属性:width、height、backgroundColor、opacity、scale、rotate、translate等。注意事项: 布局类属性(如宽高)变化时&#…...

)

【位运算】消失的两个数字(hard)

消失的两个数字(hard) 题⽬描述:解法(位运算):Java 算法代码:更简便代码 题⽬链接:⾯试题 17.19. 消失的两个数字 题⽬描述: 给定⼀个数组,包含从 1 到 N 所有…...

系统设计 --- MongoDB亿级数据查询优化策略

系统设计 --- MongoDB亿级数据查询分表策略 背景Solution --- 分表 背景 使用audit log实现Audi Trail功能 Audit Trail范围: 六个月数据量: 每秒5-7条audi log,共计7千万 – 1亿条数据需要实现全文检索按照时间倒序因为license问题,不能使用ELK只能使用…...

【Go】3、Go语言进阶与依赖管理

前言 本系列文章参考自稀土掘金上的 【字节内部课】公开课,做自我学习总结整理。 Go语言并发编程 Go语言原生支持并发编程,它的核心机制是 Goroutine 协程、Channel 通道,并基于CSP(Communicating Sequential Processes࿰…...

C# 求圆面积的程序(Program to find area of a circle)

给定半径r,求圆的面积。圆的面积应精确到小数点后5位。 例子: 输入:r 5 输出:78.53982 解释:由于面积 PI * r * r 3.14159265358979323846 * 5 * 5 78.53982,因为我们只保留小数点后 5 位数字。 输…...

c++第七天 继承与派生2

这一篇文章主要内容是 派生类构造函数与析构函数 在派生类中重写基类成员 以及多继承 第一部分:派生类构造函数与析构函数 当创建一个派生类对象时,基类成员是如何初始化的? 1.当派生类对象创建的时候,基类成员的初始化顺序 …...

Spring AI Chat Memory 实战指南:Local 与 JDBC 存储集成

一个面向 Java 开发者的 Sring-Ai 示例工程项目,该项目是一个 Spring AI 快速入门的样例工程项目,旨在通过一些小的案例展示 Spring AI 框架的核心功能和使用方法。 项目采用模块化设计,每个模块都专注于特定的功能领域,便于学习和…...

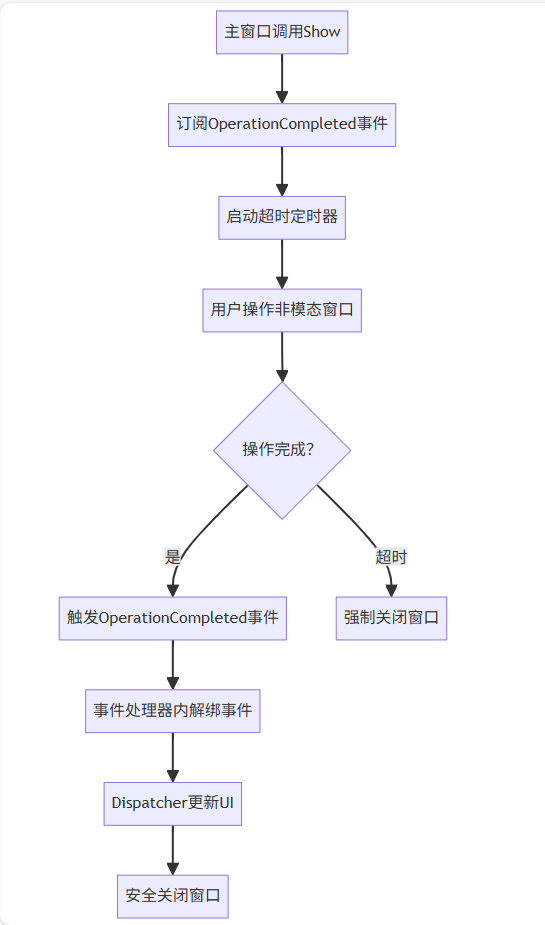

WPF八大法则:告别模态窗口卡顿

⚙️ 核心问题:阻塞式模态窗口的缺陷 原始代码中ShowDialog()会阻塞UI线程,导致后续逻辑无法执行: var result modalWindow.ShowDialog(); // 线程阻塞 ProcessResult(result); // 必须等待窗口关闭根本问题:…...