高级运维学习(八)Ceph 概述与部署

ceph概述

-

ceph可以实现的存储方式:

- 块存储:提供像普通硬盘一样的存储,为使用者提供“硬盘”

- 文件系统存储:类似于NFS的共享方式,为使用者提供共享文件夹

- 对象存储:像百度云盘一样,需要使用单独的客户端

-

Ceph存储集群至少需要一个Ceph监视器、Ceph管理器和Ceph OSD(对象存储守护程序)。运行Ceph文件系统客户端时,需要Ceph元数据服务器。

- 监视器:Ceph Monitor(ceph-mon)维护集群状态图,包括监视器图、管理器图、OSD图、MDS图和CRUSH图。这些映射是Ceph守护进程相互协调所需的关键集群状态。监视器还负责管理守护程序和客户端之间的身份验证。为了冗余和高可用性,通常至少需要三台Monitor。

- 管理器:Ceph Manager(ceph-mgr)负责跟踪ceph集群的运行时指标和当前状态,包括存储利用率、当前性能指标和系统负载。Ceph Manager守护进程还托管基于python的模块来管理和公开Ceph集群信息,包括基于web的Ceph仪表板和REST API。高可用性通常需要至少两台Manager。

- Ceph OSD:ceph-osd存储数据,处理数据复制、恢复、重新平衡,并通过检查其他Ceph OSD守护进程的心跳来为Ceph监视器和管理器提供一些监视信息。为了实现冗余和高可用性,通常至少需要三个Ceph OSD。

- MDS:ceph-mds代表Ceph文件系统存储元数据(即,Ceph块设备和Ceph对象存储不使用MDS)。Ceph元数据服务器允许POSIX文件系统用户执行基本命令(如ls、find等)。)而不会给Ceph存储集群带来巨大的负担。

- RGW:Rados Gateway,是一个提供对象存储功能的组件,可以通过RESTful接口向外部应用程序提供可扩展和高可用的存储服务。

-

Ceph将数据作为对象存储在逻辑存储池中。使用CRUSH算法,Ceph计算哪个归置组(PG)应该包含该对象,以及哪个OSD应该存储该归置组。CRUSH算法支持Ceph存储集群动态扩展、重新平衡和恢复。

-

部署ceph集群需要python3、podman或docker、时间服务(如chrony)、lvm2

部署Ceph

节点准备

- ceph1、ceph2、ceph3内存至少需要2GB

| 主机名 | IP地址 |

|---|---|

| ceph1 | 192.168.88.11/24 |

| ceph2 | 192.168.88.12/24 |

| ceph3 | 192.168.88.13/24 |

| client1 | 192.168.88.10/24 |

- 关机,为ceph1-ceph3各额外再添加3块20GB的硬盘

cephadm

-

Cephadm使用容器和systemd安装和管理Ceph集群,并与CLI(命令行)和dashboard GUI紧密集成。

-

cephadm与新的编排API完全集成,并完全支持新的CLI和仪表板功能来管理集群部署。

-

cephadm需要容器支持(podman或docker)和Python 3。

-

cephadm是一个用于管理Ceph集群的实用程序。可以使用它:

- 将Ceph容器添加到集群中

- 从群集中删除一个Ceph容器

- 更新Ceph容器

准备基础环境

- 在pubserver上配置ansible环境

[root@pubserver ~]# mkdir ceph

[root@pubserver ~]# cd ceph

[root@pubserver ceph]# vim ansible.cfg

[defaults]

inventory = inventory

host_key_checking = false[root@pubserver ceph]# vim inventory

[ceph] # 定义ceph组

ceph1 ansible_host=192.168.88.11

ceph2 ansible_host=192.168.88.12

ceph3 ansible_host=192.168.88.13[clients] # 定义客户端组

client1 ansible_host=192.168.88.10[all:vars]

ansible_ssh_user=root

ansible_ssh_pass=a[root@pubserver ceph]# mkdir files/

[root@pubserver ceph]# vim files/local88.repo

[BaseOS]

name = BaseOS

baseurl = ftp://192.168.88.240/dvd/BaseOS

enabled = 1

gpgcheck = 0[AppStream]

name = AppStream

baseurl = ftp://192.168.88.240/dvd/AppStream

enabled = 1

gpgcheck = 0[rpms]

name = rpms

baseurl = ftp://192.168.88.240/rpms

enabled = 1

gpgcheck = 0# 配置yum

[root@pubserver ceph]# vim 01-upload-repo.yml

---

- name: config repos.dhosts: alltasks:- name: delete repos.dfile:path: /etc/yum.repos.dstate: absent- name: create repos.dfile:path: /etc/yum.repos.dstate: directorymode: '0755'- name: upload local88copy:src: files/local88.repodest: /etc/yum.repos.d/

[root@pubserver ceph]# ansible-playbook 01-upload-repo.yml - 配置名称解析

# 配置三台主机实现名称解析,解析的名字务必与主机实际名字一致

[root@pubserver ceph]# vim 02-modify-hosts.yml

---

- name: add nameshosts: cephtasks:- name: add blockblockinfile: # 类似于lineinfile模块,可在目标文件中加多行path: /etc/hostsblock: |192.168.88.11 ceph1192.168.88.12 ceph2192.168.88.13 ceph3192.168.88.240 quay.io

[root@pubserver ceph]# ansible-playbook 02-modify-hosts.yml

# 查看结果,以ceph1为例

[root@ceph1 ~]# tail -6 /etc/hosts

# BEGIN ANSIBLE MANAGED BLOCK

192.168.88.11 ceph1

192.168.88.12 ceph2

192.168.88.13 ceph3

192.168.88.240 quay.io

# END ANSIBLE MANAGED BLOCK- 配置pubserver为NTP服务器

# 1. 查看pubserver自己的时区,如果时区不正确需要改正

[root@pubserver ~]# timedatectl

[root@pubserver ~]# timedatectl set-timezone Asia/Shanghai

# 2. 查看时间,如果时间不正确,需要调整时间

[root@pubserver ~]# date

[root@pubserver ~]# date -s "年-月-日 时:分:秒"

# 3. 配置chronyd服务

[root@pubserver ~]# yum install -y chrony

[root@pubserver ~]# vim /etc/chrony.conf # 打开23、26行的注释

...略...24 # Allow NTP client access from local network.25 allow 192.168.0.0/16 # 为192.168开头的客户端提供时间服务26 27 # Serve time even if not synchronized to a time source.28 local stratum 10 # 即使自己没有时间源,也为客户端提供时间服务

...略...

[root@pubserver ~]# systemctl enable chronyd --now

[root@pubserver ~]# ss -ulnp | grep :123 # ntp使用udp 123端口- 配置ceph1-ceph3使用pubserver提供的时间服务

[root@pubserver ceph]# vim 03-config-ntp.yml

---

- name: config ntphosts: cephtasks:- name: install chrony # 安装chronyyum:name: chronystate: present- name: modify config # 替换以pool开头的行lineinfile:path: /etc/chrony.confregexp: '^pool'line: "pool 192.168.88.240 iburst"notify: restart ntp # 如果该任务的状态是CHANGED,则执行restart ntp任务handlers:- name: restart ntp # 只有notify通知时,才执行重启任务service:name: chronydstate: restartedenabled: yes

[root@pubserver ceph]# ansible-playbook 03-config-ntp.yml# 以ceph1为例,查看结果

[root@ceph1 ~]# chronyc sources -v.-- Source mode '^' = server, '=' = peer, '#' = local clock./ .- Source state '*' = current best, '+' = combined, '-' = not combined,

| / 'x' = may be in error, '~' = too variable, '?' = unusable.

|| .- xxxx [ yyyy ] +/- zzzz

|| Reachability register (octal) -. | xxxx = adjusted offset,

|| Log2(Polling interval) --. | | yyyy = measured offset,

|| \ | | zzzz = estimated error.

|| | | \

MS Name/IP address Stratum Poll Reach LastRx Last sample

===============================================================================

^* 192.168.88.240 10 6 37 4 -8731ns[-6313us] +/- 7118us- 准备容器仓库服务器

# 1. 将真机/linux-soft/s2/zzg/ceph_soft/ceph-server/docker-distribution-2.6.2-2.git48294d9.el7.x86_64.rpm拷贝到pubserver的/root目录并安装

[root@pubserver ~]# yum install -y docker-distribution-2.6.2-2.git48294d9.el7.x86_64.rpm

# 2. 启动服务

[root@pubserver ~]# systemctl enable docker-distribution --now- 安装软件包,并导入镜像

# 1. 在ceph集群节点上安装软件包

[root@pubserver ceph]# vim 04-install-ceph.yml

---

- name: install pkghosts: cephtasks:- name: install pkg # 安装软件包yum:name: python39,podman,lvm2state: present

[root@pubserver ceph]# ansible-playbook 04-install-ceph.yml # 2. 将真机/linux-soft/s2/zzg/ceph_soft/ceph-server目录拷贝到ceph各节点,并导入镜像

[root@ceph1 ~]# cd ceph-server/

[root@ceph1 ceph-server]# for c in *.tar

> do

> podman load -i $c

> done

[root@ceph2 ~]# cd ceph_soft/

[root@ceph2 ceph-server]# for c in *.tar

> do

> podman load -i $c

> done

[root@ceph3 ~]# cd ceph_soft/

[root@ceph3 ceph-server]# for c in *.tar

> do

> podman load -i $c

> done# 3. 查看执行结果

[root@ceph1 ceph-server]# podman images

REPOSITORY TAG IMAGE ID CREATED SIZE

quay.io/ceph/ceph v17 cc65afd6173a 7 weeks ago 1.4 GB

quay.io/ceph/ceph-grafana 8.3.5 dad864ee21e9 8 months ago 571 MB

quay.io/prometheus/prometheus v2.33.4 514e6a882f6e 9 months ago 205 MB

quay.io/prometheus/node-exporter v1.3.1 1dbe0e931976 12 months ago 22.3 MB

quay.io/prometheus/alertmanager v0.23.0 ba2b418f427c 15 months ago 58.9 MB# 4. 配置ceph1-ceph3使用pubserver作为仓库服务器

[root@pubserver ceph]# vim 05-config-registry.yml

---

- name: config registryhosts: cephtasks:- name: modify configblockinfile:path: /etc/containers/registries.confblock: |[[registry]]location = "quay.io:5000" # 指定服务器地址insecure = true # 允许使用http协议

[root@pubserver ceph]# ansible-playbook 05-config-registry.yml # 5. 以ceph1为例,查看执行结果

[root@ceph1 ceph_soft]# tail -5 /etc/containers/registries.conf

# BEGIN ANSIBLE MANAGED BLOCK

[[registry]]

location = "quay.io:5000"

insecure = true

# END ANSIBLE MANAGED BLOCK# 5. 修改镜像名称,以便可以将其推送到自建镜像服务器

[root@ceph1 ceph-server]# podman tag quay.io/ceph/ceph:v17 quay.io:5000/ceph/ceph:v17

[root@ceph1 ceph-server]# podman tag quay.io/ceph/ceph-grafana:8.3.5 quay.io:5000/ceph/ceph-grafana:8.3.5

[root@ceph1 ceph-server]# podman tag quay.io/prometheus/prometheus:v2.33.4 quay.io:5000/prometheus/prometheus:v2.33.4

[root@ceph1 ceph-server]# podman tag quay.io/prometheus/node-exporter:v1.3.1 quay.io:5000/prometheus/node-exporter:v1.3.1

[root@ceph1 ceph-server]# podman tag quay.io/prometheus/alertmanager:v0.23.0 quay.io:5000/prometheus/alertmanager:v0.23.0# 6. 将镜像推送到镜像服务器,以便其他节点可以通过服务器下载镜像

[root@ceph1 ceph-server]# podman push quay.io:5000/ceph/ceph:v17

[root@ceph1 ceph-server]# podman push quay.io:5000/ceph/ceph-grafana:8.3.5

[root@ceph1 ceph-server]# podman push quay.io:5000/prometheus/prometheus:v2.33.4

[root@ceph1 ceph-server]# podman push quay.io:5000/prometheus/node-exporter:v1.3.1

[root@ceph1 ceph-server]# podman push quay.io:5000/prometheus/alertmanager:v0.23.0 - 完成此步骤,给ceph1-ceph3打快照

安装ceph

- 所有Ceph集群都需要至少一个监视器Monitor,以及至少与存储在集群上的对象副本一样多的OSD。引导初始监视器是部署Ceph存储集群的第一步。

- Monitor部署还为整个集群设置了重要的标准,例如池的副本数量、每个OSD的放置组数量、心跳间隔、是否需要身份验证等。这些值中的大部分是默认设置的。

- 创建集群

# 1. 在ceph1上初始化集ceph集群。

# 集群初始化完成后,将自动生成ssh免密密钥,存放在/etc/ceph/目录下

[root@ceph1 ceph-server]# ./cephadm bootstrap --mon-ip 192.168.88.11 --initial-dashboard-password=123456 --dashboard-password-noupdate

# 2. ceph将会以容器化的方式部署,查看生成了6个容器。

[root@ceph1 ceph-server]# podman ps# 3. 拷贝密钥文件至其他节点

[root@ceph1 ceph-server]# ssh-copy-id -f -i /etc/ceph/ceph.pub ceph2

[root@ceph1 ceph-server]# ssh-copy-id -f -i /etc/ceph/ceph.pub ceph3# 4. 进入管理容器,查看ceph状态

[root@ceph1 ceph-server]# ./cephadm shell # 进入管理容器

[ceph: root@ceph1 /]# ceph -s # 查看ceph状态cluster:id: 1ddfccf2-77b4-11ed-8941-000c2953b002health: HEALTH_WARNOSD count 0 < osd_pool_default_size 3services:mon: 1 daemons, quorum ceph1 (age 11m)mgr: ceph1.vnoivz(active, since 10m)osd: 0 osds: 0 up, 0 indata:pools: 0 pools, 0 pgsobjects: 0 objects, 0 Busage: 0 B used, 0 B / 0 B availpgs: # 5. 查看相关容器状态,显示所有容器均已启动

[ceph: root@ceph1 /]# ceph orch ls

NAME PORTS RUNNING REFRESHED AGE PLACEMENT

alertmanager ?:9093,9094 1/1 91s ago 3m count:1

crash 1/3 91s ago 4m *

grafana ?:3000 1/1 91s ago 4m count:1

mgr 1/2 91s ago 4m count:2

mon 1/5 91s ago 4m count:5

node-exporter ?:9100 1/3 91s ago 4m *

prometheus ?:9095 1/1 91s ago 4m count:1 # 6. 查看集群中现有主机

[ceph: root@ceph1 /]# ceph orch host ls

HOST ADDR LABELS STATUS

ceph1 192.168.88.11 _admin

1 hosts in cluster# 7. 向集群中添加其他主机

[ceph: root@ceph1 /]# ceph orch host add ceph2 192.168.88.12

[ceph: root@ceph1 /]# ceph orch host add ceph3 192.168.88.13

# 注:删除错误的主机命令为:ceph orch host rm 主机名 --force# 8. 查看集群中主机

[ceph: root@ceph1 /]# ceph orch host ls

HOST ADDR LABELS STATUS

ceph1 192.168.88.11 _admin

ceph2 192.168.88.12

ceph3 192.168.88.13

3 hosts in cluster# 9. 扩容MON节点。一共有3台MON,位于ceph1-ceph3

[ceph: root@ceph1 /]# ceph orch apply mon --placement="3 ceph1 ceph2 ceph3" # 10. 查看mon状态

[ceph: root@ceph1 /]# ceph -scluster:id: a4b69ab4-79dd-11ed-ae7b-000c2953b002health: HEALTH_WARNOSD count 0 < osd_pool_default_size 3services:mon: 3 daemons, quorum ceph1,ceph3,ceph2 (age 2m)mgr: ceph1.gmqorm(active, since 15m), standbys: ceph3.giqaphosd: 0 osds: 0 up, 0 indata:pools: 0 pools, 0 pgsobjects: 0 objects, 0 Busage: 0 B used, 0 B / 0 B availpgs: [ceph: root@ceph1 /]# ceph mon stat

e3: 3 mons at {ceph1=[v2:192.168.88.11:3300/0,v1:192.168.88.11:6789/0],ceph2=[v2:192.168.88.12:3300/0,v1:192.168.88.12:6789/0],ceph3=[v2:192.168.88.13:3300/0,v1:192.168.88.13:6789/0]}, election epoch 14, leader 0 ceph1, quorum 0,1,2 ceph1,ceph3,ceph2# 11. ceph2和ceph3上也将会出现相关容器

[root@ceph2 ~]# podman ps

[root@ceph3 ~]# podman ps- 添加OSD硬盘

[ceph: root@ceph1 /]# ceph orch daemon add osd ceph1:/dev/vdb

[ceph: root@ceph1 /]# ceph orch daemon add osd ceph1:/dev/vdc

[ceph: root@ceph1 /]# ceph orch daemon add osd ceph1:/dev/vdd

[ceph: root@ceph1 /]# ceph orch daemon add osd ceph2:/dev/vdb

[ceph: root@ceph1 /]# ceph orch daemon add osd ceph2:/dev/vdc

[ceph: root@ceph1 /]# ceph orch daemon add osd ceph2:/dev/vdd

[ceph: root@ceph1 /]# ceph orch daemon add osd ceph3:/dev/vdb

[ceph: root@ceph1 /]# ceph orch daemon add osd ceph3:/dev/vdc

[ceph: root@ceph1 /]# ceph orch daemon add osd ceph3:/dev/vdd# 2. 在节点上查询容器信息,将会发现又有新的osd容器出现

[root@ceph1 ~]# podman ps# 3. 此时ceph的状态将会是HEALTH_OK,ceph集群搭建完成。

[ceph: root@ceph1 /]# ceph -scluster:id: a4b69ab4-79dd-11ed-ae7b-000c2953b002health: HEALTH_OKservices:mon: 3 daemons, quorum ceph1,ceph3,ceph2 (age 2m)mgr: ceph1.gmqorm(active, since 2h), standbys: ceph3.giqaphosd: 9 osds: 9 up (since 35s), 9 in (since 59s)data:pools: 1 pools, 1 pgsobjects: 2 objects, 449 KiBusage: 186 MiB used, 180 GiB / 180 GiB availpgs: 1 active+clean故障排除:

查看服务状态:

[ceph: root@ceph1 /]# ceph orch ps如果有error(比如node-exporter.ceph2),则把相应的服务删除:

[ceph: root@ceph1 /]# ceph orch daemon rm node-expoter.ceph2然后重新配置:

[ceph: root@ceph1 /]# ceph orch daemon reconfig node-exporter.ceph2

# 或

[ceph: root@ceph1 /]# ceph orch daemon redeploy node-exporter.ceph2如果是mgr这样的服务出故障,删除后,部署的命令是:

[ceph: root@ceph1 /]# ceph orch daemon reconfig mgr ceph2

# 或

[ceph: root@ceph1 /]# ceph orch daemon redeploy mgr ceph2相关文章:

Ceph 概述与部署)

高级运维学习(八)Ceph 概述与部署

ceph概述 ceph可以实现的存储方式: 块存储:提供像普通硬盘一样的存储,为使用者提供“硬盘”文件系统存储:类似于NFS的共享方式,为使用者提供共享文件夹对象存储:像百度云盘一样,需要使用单独的客…...

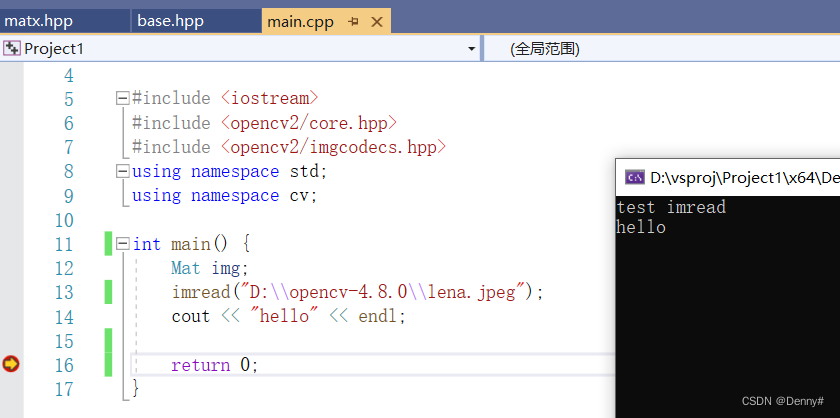

【图像处理】VS编译opencv源码,并调用编译生成的库

背景 有些时候我们需要修改opencv相关源码, 这里介绍怎么编译修改并调用修改后的库文件。 步骤 1、下载相关源码工具: 下载opencv4.8源码并解压 https://down.chinaz.com/soft/40730.htm 下载VS2019,社区版免费 https://visualstudio.micro…...

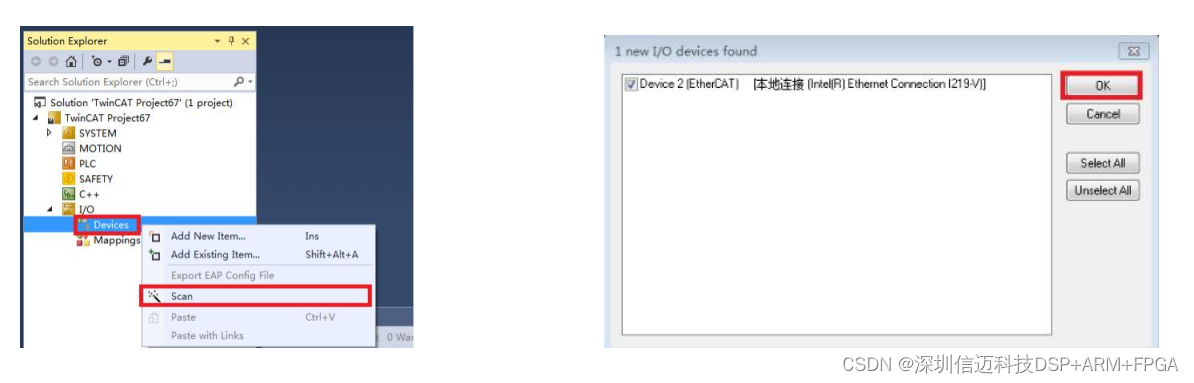

STM32 EtherCAT 总线型(1 拖 4)步进电机解决方案

第 1 章 概述 技术特点 支持标准 100M/s 带宽全双工 EtherCAT 总线网络接口及 CoE 通信协议一 进一出(RJ45 接口),支持多组动态 PDO 分组和对象字典的自动映射,支持站 号 ID 的自动设置与保存,支持 SDO 的…...

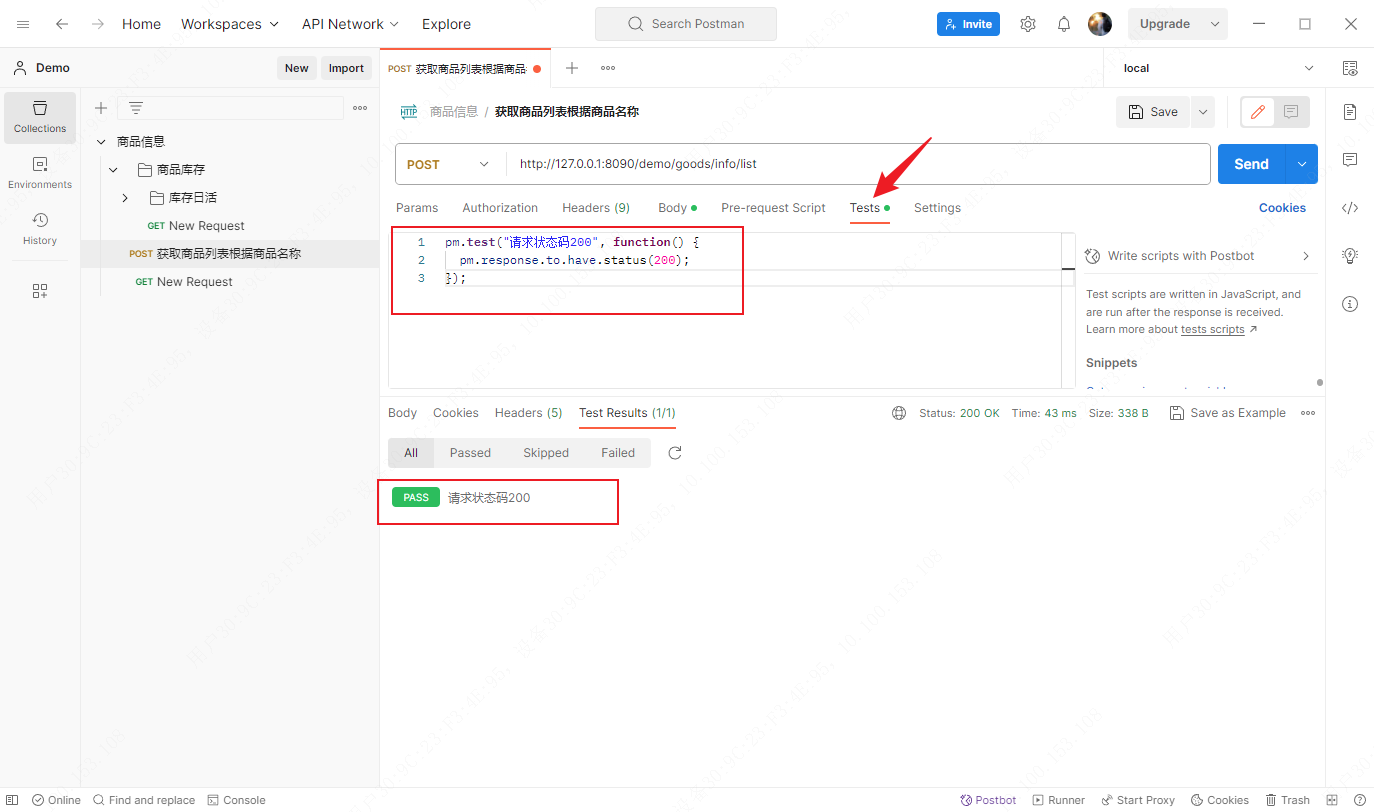

Postman应用——测试脚本Test Script

文章目录 Test Script脚本CollectionFolderRequest 解析响应体断言测试 测试脚本可以在Collection、Folder和Request的Pre-request script 和 Test script中编写,测试脚本可以检测请求响应的各个方面,包括正文、状态代码、头、cookie、响应时间等&#x…...

JS的网络状态以及强网弱网详解

文章目录 1. online 和 offline 事件2. navigator.onLine2.1 什么是 navigator.connection?2.2 如何使用 navigator.connection?2.3 总结 1. online 和 offline 事件 online 和 offline 事件是浏览器自带的两个事件,可以通过添加事件监听器来…...

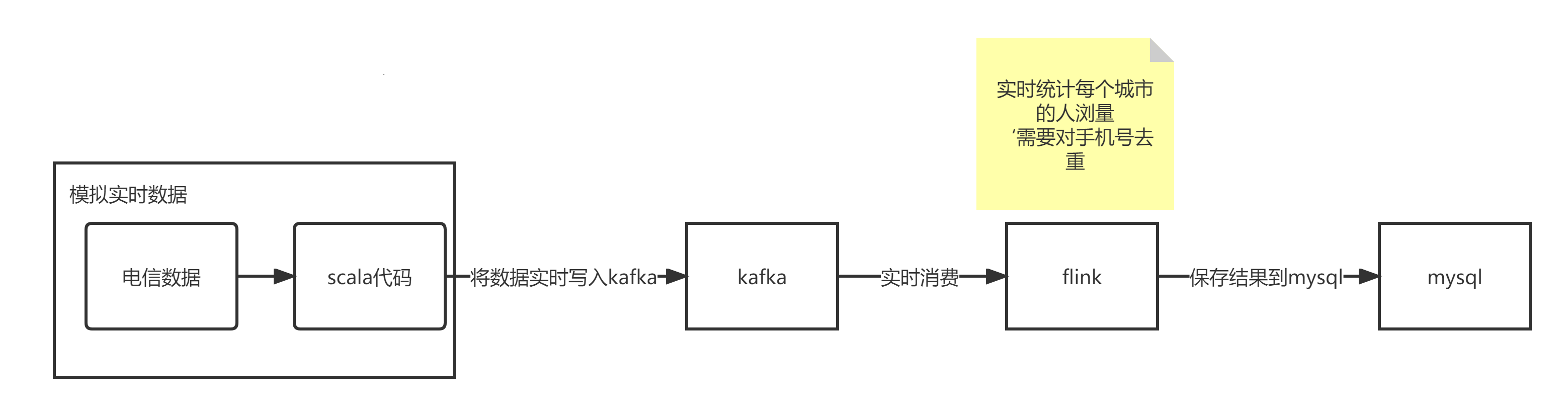

大数据-kafka学习笔记

Kafka Kafka 是一个分布式的基于发布/订阅模式的消息队列(Message Queue),主要应用于大数据实时处理领域。 Kafka可以用作Flink应用程序的数据源。Flink可以轻松地从一个或多个Kafka主题中消费数据流。这意味着您可以使用Kafka来捕获和传输…...

详述RPA项目管理流程,RPA项目管理流程是什么?

RPA(Robotic Process Automation,机器人流程自动化)是一种通过软件机器人模拟人类在计算机上执行重复性任务的技术。RPA可以帮助企业提高工作效率、降低成本、减少错误并提高客户满意度。然而,为了确保RPA项目的成功实施ÿ…...

爬虫 — Js 逆向

目录 一、概念1、爬虫2、反爬虫3、加密解密4、加密5、步骤 二、常用加密方式1、加密方式2、常见加密算法3、JS 中常见的算法4、MD5 算法4.1、MD5 加密网站4.2、特点 5、DES/AES 算法6、RSA 算法7、base64 算法 三、环境配置1、node.js 环境配置2、PyCharm 环境配置 一、概念 1…...

Python 网络爬取的时候使用那种框架

尽管现代的网站多采取前后端分离的方式进行开发了,但是对直接 API 的调用我们通常会有 token 的限制和可以调用频率的限制。 因此,在一些特定的网站上,我们可能还是需要使用网络爬虫的方式获得已经返回的 JSON 数据结构,甚至是处理…...

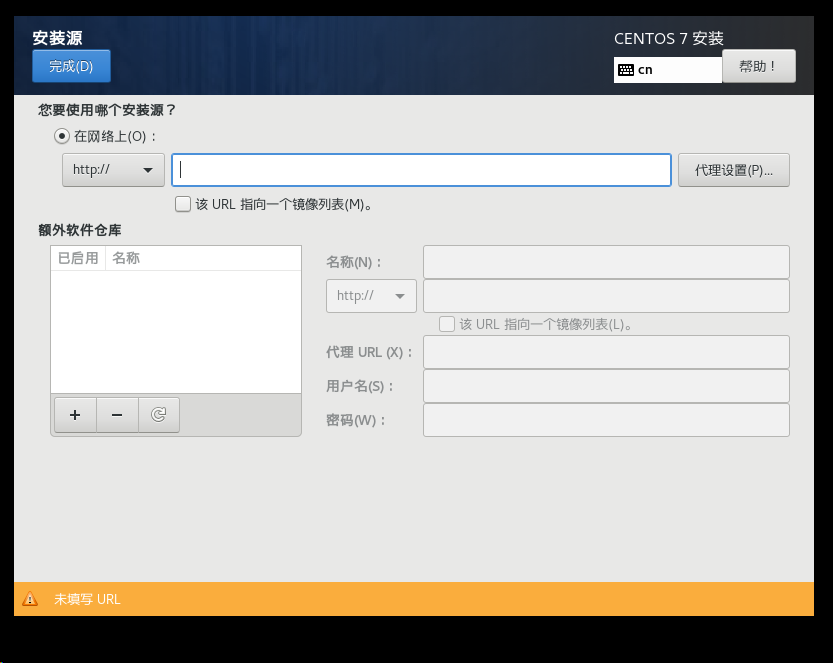

CentOS7安装源设置

此处的安装源地址需要填写:(适用于centos7) http://mirrors.aliyun.com/centos/7/os/x86_64/...

报错:module object has no attribute Pool)

pool = multiprocessing.Pool()报错:module object has no attribute Pool

pool multiprocessing.Pool()报错:module object has no attribute Pool,为什么? 我很抱歉,前面提供的回答是错误的。在Python的multiprocessing模块中,确实有一个名为Pool的类。如果你在使用multiprocessing.Pool()…...

Linux Shell 实现一键部署podman

podman 介绍 使用 Podman 管理容器、Pod 和映像。从本地环境中无缝使用容器和 Kubernetes,Podman 提供与 Docker 非常相似的功能,它不需要在你的系统上运行任何守护进程,并且它也可以在没有 root 权限的情况下运行。 Podman 可以管理和运行…...

Biome-BGC生态系统模型与Python融合技术

Biome-BGC是利用站点描述数据、气象数据和植被生理生态参数,模拟日尺度碳、水和氮通量的有效模型,其研究的空间尺度可以从点尺度扩展到陆地生态系统。 在Biome-BGC模型中,对于碳的生物量积累,采用光合酶促反应机理模型计算出每天…...

Matlab图像处理-区域描述

一旦一幅图像的目标区域被确定,我们往往用一套描述子来表示其特性。选择区域描述子的动机不单纯为了减少在区域中原始数据的数量,而且也应有利于区别带有不同特性的区域。因此,当目标区域有大小、旋转、平移等方面的变化时,针对这…...

openGauss学习笔记-69 openGauss 数据库管理-创建和管理普通表-更新表中数据

文章目录 openGauss学习笔记-69 openGauss 数据库管理-创建和管理普通表-更新表中数据 openGauss学习笔记-69 openGauss 数据库管理-创建和管理普通表-更新表中数据 修改已经存储在数据库中数据的行为叫做更新。用户可以更新单独一行、所有行或者指定的部分行。还可以独立更新…...

Flink RowData 与 Row 相互转化工具类

RowData与Row区别 (0)都代表了一条记录。都可以设置RowKind,和列数量Aritry。 (1)RowData 属于Table API,而Row属于Stream API (2)RowData 属于Table内部接口,对用户不友…...

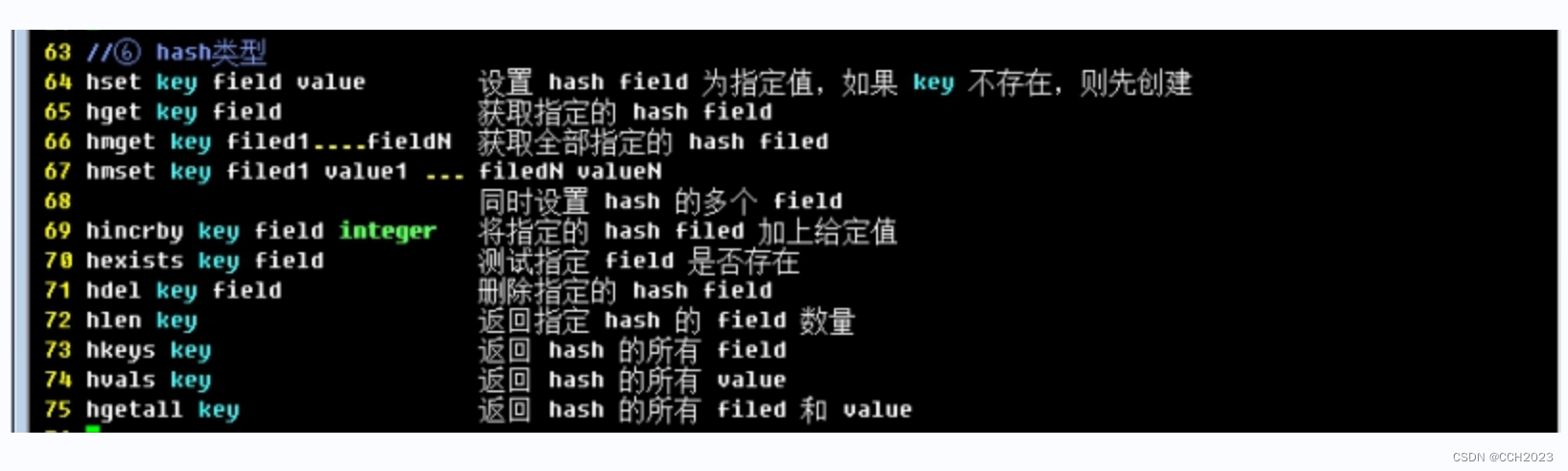

企业架构LNMP学习笔记48

数据结构类型操作: 数据结构:存储数据的方式 数据类型 算法:取数据的方式,代码就把数据进行组合,计算、存储、取出。 排序算法:冒泡排序、堆排序 二分。 key: key的命名规则不同于一般语言…...

docker部署neo4j

拉取镜像 docker pull neo4j:3.5.35-community查看镜像 [rootlocalhost data]# docker images REPOSITORY TAG IMAGE ID CREATED SIZE neo4j 3.5.35-community 3548ff943256 13 months ago 446MB创建容器并运行 docker run -d …...

融云观察:AI Agent 是不是游戏赛道的下一个「赛点」?

本周四 融云直播间,点击报名~ ChatGPT 的出现,不仅让会话成为了未来商业的基本形态,也把大家谈论 AI 的语境从科技产业转向了 AI 与全产业的整合。 关注【融云全球互联网通信云】了解更多 而目前最热衷于拥抱生成式 AI 的行业中,…...

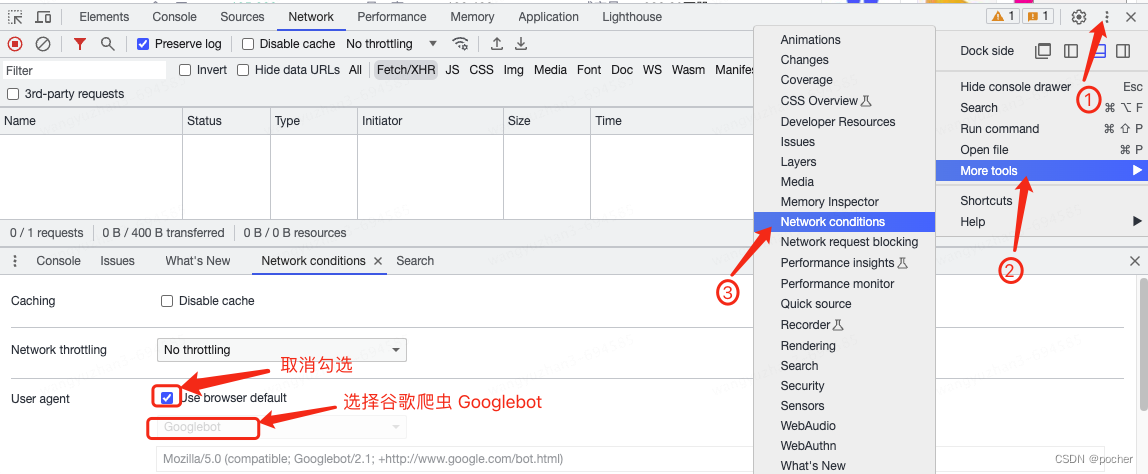

运用谷歌浏览器的开发者工具,模拟搜索引擎蜘蛛抓取网页

第一步:按压键盘上的F12键打开开发这工具,并点击右上角三个小黑点 第二步:选择More tools 第三步:选择Network conditions 第四步:找到User agent一列,取消复选框的勾选 第五步:选择谷歌爬虫…...

身份证OCR识别接口接入实战:Python/Java/PHP/C#四语言代码示例与踩坑指南

#身份证OCR, #OCR接口, #API接入, #Python示例, #Java示例, #PHP示例, #踩坑指南, #石榴智能, #实名认证, #图片识别 身份证OCR识别接口接入实战:Python/Java/PHP/C#四语言代码示例与踩坑指南 作者:石榴智能技术团队 一、前言 身份证OCR识别已经不是什…...

深圳实体门店有必要做GEO AI代运营吗

深圳实体门店有必要做GEO AI代运营吗一、开篇引言2026年深圳本地实体商业竞争进入白热化阶段,全城数百万家线下实体门店涵盖本地生活、家装工装、汽车服务、餐饮娱乐、教育培训等全品类,传统线下地推、门店自然客流、传统团购平台引流效果持续下滑&#…...

零基础轻松拿捏!魔珐星云青少年健康运动教学数字人搭建全流程指南

大家好!本次给大家分享一款面向青少年体育教育的AI创意实践项目——青少年健康运动教学智能数字交互系统。本项目聚焦青少年体质健康痛点,围绕体育教学智能化升级需求,打造集健康知识教学、运动动作陪练、健康知识考核、运动能力评测于一体的…...

基于LM22678的树莓派硬盘专用电源设计:解决供电不稳与电流冲击

1. 项目概述:为什么我们需要一个“专用”电源?如果你正在用树莓派搭配一块机械硬盘搭建一个家庭服务器或者个人云存储,可能已经遇到了一个不大不小的麻烦:供电不稳。树莓派官方推荐的5V/3A电源,单独带树莓派4B跑满负载…...

Vue3 图片标框功能实现方案

基于 Vue3 组合式 API 的图片标框(画框、标注、选框)完整实现,核心逻辑封装在 GetBoxes 组件里,复制就能用 一、功能说明 ✅ 在图片上鼠标拖拽画矩形框 ✅ 实时显示框坐标(x, y, width, height) ✅ 支持多…...

如何让Rhino 3D模型在Blender中保持完整数据:import_3dm插件深度解析

如何让Rhino 3D模型在Blender中保持完整数据:import_3dm插件深度解析 【免费下载链接】import_3dm Blender importer script for Rhinoceros 3D files 项目地址: https://gitcode.com/gh_mirrors/im/import_3dm 当建筑师需要在Blender中渲染Rhino设计的建筑模…...

基于雷达与光敏传感器的低功耗智能窗防设备设计与实现

1. 项目概述:一个基于雷达与光敏的智能窗防设备几年前,我因为一次短暂的出差,家里空置了几天,回来后就一直琢磨着怎么给家里的窗户加点“动静”。市面上的智能安防摄像头固然好,但要么需要复杂的布线,要么云…...

【python】ImportError: DLL load failed while importing QtWidgets: 找不到指定的程序。重新安装后搞定

文章目录前言一、PyQt6引用后报错二、使用步骤总结前言 想做个好看的界面,引用了PyQt6,却产生了新问题。 pip install pyqt6-tools,优先做这个动作进行修复。 一、PyQt6引用后报错 python里引用: from PyQt6.QtWidgets import…...

【审计专栏】【财务领域】 第四十九篇 人在企业中的核心资产和核心利益01

编号 类型 企业 (行业/企业产品/企业利益链/生态位与层级) 业务领域 企业性质 企业中人的角色/岗位/利益矩阵 人在企业中的核心资产/附属资产 资产的业务-财务数学模型及数字/数值 关联知识 1 核心经营性资产(如IP、数据、品牌) 行业:人工智能 产品:工业视觉检…...

LeaguePrank:5分钟打造个性化英雄联盟客户端,段位头像随心换!

LeaguePrank:5分钟打造个性化英雄联盟客户端,段位头像随心换! 【免费下载链接】LeaguePrank 项目地址: https://gitcode.com/gh_mirrors/le/LeaguePrank 厌倦了千篇一律的英雄联盟客户端界面?想向好友展示王者段位却还在白…...