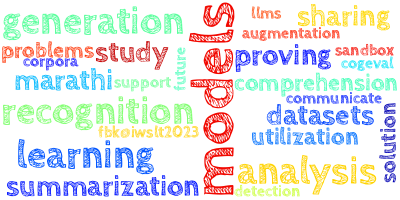

【AI视野·今日NLP 自然语言处理论文速览 第四十三期】Thu, 28 Sep 2023

AI视野·今日CS.NLP 自然语言处理论文速览

Thu, 28 Sep 2023

Totally 38 papers

👉上期速览✈更多精彩请移步主页

Daily Computation and Language Papers

| Cross-Modal Multi-Tasking for Speech-to-Text Translation via Hard Parameter Sharing Authors Brian Yan, Xuankai Chang, Antonios Anastasopoulos, Yuya Fujita, Shinji Watanabe 最近的端到端语音到文本翻译 ST 的工作提出了具有软参数共享的多任务方法,该方法通过辅助编码器利用机器翻译 MT 数据,将文本输入映射到最终的跨模式表示。在这项工作中,我们提出了一种具有硬参数共享的 ST MT 多任务框架,其中所有模型参数都跨模态共享。我们的方法通过预处理阶段减少语音文本模态差距,该预处理阶段将语音和文本输入转换为长度相似的两个离散标记序列,这允许模型仅使用联合词汇表不加区别地处理两种模态。通过 MuST C 上的实验,我们证明了我们的多任务框架在没有任何外部 MT 数据的情况下,将注意力编码器解码器、连接主义时间分类 CTC、传感器和联合 CTC 注意力模型平均提高了 0.5 BLEU。 |

| Lyra: Orchestrating Dual Correction in Automated Theorem Proving Authors Chuanyang Zheng, Haiming Wang, Enze Xie, Zhengying Liu, Jiankai Sun, Huajian Xin, Jianhao Shen, Zhenguo Li, Yu Li 大型语言模型法学硕士为形式定理证明领域的探索提供了一条有趣的途径。然而,它们的全部潜力,特别是在通过证明者错误消息减轻幻觉和改进方面,仍然是一个尚未彻底研究的领域。为了提高法学硕士在该领域的有效性,我们引入了 Lyra,这是一个新框架,它采用两种不同的校正机制:工具校正 TC 和猜想校正 CC。为了在形式证明的后处理中实现工具校正,我们利用先验知识来利用预定义的证明工具,例如 Sledgehammer 来指导更换不正确的工具。工具校正极大地有助于减轻幻觉,从而提高证明的整体准确性。此外,我们还引入了猜想校正,这是一种错误反馈机制,旨在与证明者交互,通过证明者错误消息来完善形式证明猜想。与之前的细化框架相比,所提出的猜想校正通过指令细化生成,但不收集配对生成、错误细化提示。我们的方法在 miniF2F 验证 48.0 55.3 和测试 45.5 51.2 上都实现了最先进的 SOTA 性能。我们还提出了 Lyra 解决的 3 个 IMO 问题。 |

| Exploring Speech Recognition, Translation, and Understanding with Discrete Speech Units: A Comparative Study Authors Xuankai Chang, Brian Yan, Kwanghee Choi, Jeeweon Jung, Yichen Lu, Soumi Maiti, Roshan Sharma, Jiatong Shi, Jinchuan Tian, Shinji Watanabe, Yuya Fujita, Takashi Maekaku, Pengcheng Guo, Yao Fei Cheng, Pavel Denisov, Kohei Saijo, Hsiu Hsuan Wang 语音信号通常以每秒数万次的速率采样,包含冗余,导致序列建模效率低下。高维语音特征(例如声谱图)通常用作后续模型的输入。然而,它们仍然可能是多余的。最近的研究提出使用源自自监督学习表示的离散语音单元,这显着压缩了语音数据的大小。应用去重、子字建模等多种方法可以进一步压缩语音序列长度。因此,训练时间显着减少,同时保持显着的性能。在这项研究中,我们对离散单元在端到端语音处理模型中的应用进行了全面、系统的探索。对 12 个自动语音识别、3 个语音翻译和 1 个口语理解语料库的实验表明,离散单元在几乎所有设置中都取得了相当好的结果。 |

| Large Language Model Routing with Benchmark Datasets Authors Tal Shnitzer, Anthony Ou, M rian Silva, Kate Soule, Yuekai Sun, Justin Solomon, Neil Thompson, Mikhail Yurochkin 开源大型语言模型法学硕士和用于比较它们的基准数据集的数量正在迅速增长。虽然某些模型在这些基准测试中占据主导地位,但通常没有一个模型可以在所有任务和用例中实现最佳准确性。在这项工作中,我们解决了从新任务的模型集合中选择最佳法学硕士的挑战。我们针对该问题提出了一种新的表述,其中基准数据集被重新用于学习用于此 LLM 选择的路由器模型,并且我们表明该问题可以简化为二元分类任务的集合。 |

| Question answering using deep learning in low resource Indian language Marathi Authors Dhiraj Amin, Sharvari Govilkar, Sagar Kulkarni 从问答系统中给定输入问题的文本中提取精确答案。马拉地语问答系统是在最近的研究中使用本体论、规则库和基于机器学习的方法创建的。最近,变压器模型和迁移学习方法被用来解决问题回答挑战。在本文中,我们研究了用于创建基于阅读理解的马拉地语问答系统的不同变压器模型。我们对不同的预训练马拉地语多语言和单语言模型进行了实验,例如印度语言的多语言表示 MuRIL、MahaBERT、来自 Transformers IndicBERT 的印度语双向编码器表示,并在基于马拉地语阅读理解的数据集上对其进行了微调。 |

| Experience and Evidence are the eyes of an excellent summarizer! Towards Knowledge Infused Multi-modal Clinical Conversation Summarization Authors Abhisek Tiwari, Anisha Saha, Sriparna Saha, Pushpak Bhattacharyya, Minakshi Dhar 随着远程医疗的进步,研究人员和医疗从业者正在携手开发各种技术来自动化各种医疗操作,例如诊断报告生成。在本文中,我们首先提出了一种多模式临床对话摘要生成任务,该任务采用临床医生与患者的交互文本和视觉信息,并生成简洁的对话概要。我们提出了一种知识注入、多模式、多任务医学领域识别和临床对话摘要生成 MM CliConSummation 框架。它利用适配器来注入知识和视觉特征,并使用门控机制统一融合的特征向量。此外,我们开发了一个多模式、多意图的临床对话总结语料库,带有意图、症状和摘要注释。大量的定量和定性实验得出了以下发现:a 视觉效果的重要意义;b 更精确且保留医学实体的摘要以及额外的知识注入;c 医疗部门识别和临床概要生成之间的相关性。 |

| ChatGPT-BCI: Word-Level Neural State Classification Using GPT, EEG, and Eye-Tracking Biomarkers in Semantic Inference Reading Comprehension Authors Yuhong Zhang, Qin Li, Sujal Nahata, Tasnia Jamal, Shih kuen Cheng, Gert Cauwenberghs, Tzyy Ping Jung 随着最近大型语言模型 LLM(例如生成预训练 Transformers GPT)的爆炸式增长,对人类和机器理解语义语言含义的能力的需求已经进入了一个新阶段。这需要跨学科研究来连接认知科学和自然语言处理 NLP 领域。这项试点研究旨在深入了解语义关系阅读理解任务期间个体的神经状态。我们建议联合分析法学硕士、眼睛注视和脑电图脑电图数据,以研究大脑在阅读过程中如何处理与关键词不同程度相关的单词。我们还使用特征工程方法来改进与注视相关的脑电图数据分类,同时参与者阅读与关键词相关性高或低的单词。此词级分类的最佳验证准确度在 12 个主题中超过 60。与推理关键字高度相关的单词在排除无注视单词时,每个单词的眼睛注视次数显着增加为 1.0584,而排除无注视单词时为 0.6576;在包含这些单词时,与推理关键字高度相关的单词为 1.5126,与 1.4026 相比。这项研究代表了首次尝试使用法学硕士知识在单词级别对大脑状态进行分类。 |

| HyPoradise: An Open Baseline for Generative Speech Recognition with Large Language Models Authors Chen Chen, Yuchen Hu, Chao Han Huck Yang, Sabato Macro Siniscalchi, Pin Yu Chen, Eng Siong Chng 深度神经网络的进步使得自动语音识别 ASR 系统能够在几个公开可用的干净语音数据集上达到人类的同等水平。然而,即使是最先进的 ASR 系统在遇到不利条件时也会经历性能下降,因为训练有素的声学模型对语音域的变化(例如背景噪声)很敏感。直观上,人类通过依靠他们的语言知识来解决这个问题,模糊的口语术语的含义通常是从上下文线索推断出来的,从而减少了对听觉系统的依赖。受这一观察的启发,我们引入了第一个开源基准测试,利用外部大语言模型 LLM 进行 ASR 纠错,其中 N 个最佳解码假设为真正的转录预测提供了信息元素。这种方法是传统语言模型重新评分策略的范式转变,传统语言模型重新评分策略只能选择一个候选假设作为输出转录。提议的基准包含一个新颖的数据集 HyPoadise HP ,包含超过 334,000 对 N 个最佳假设以及跨流行语音领域的相应准确转录。给定这个数据集,我们检查了三种基于法学硕士的纠错技术,具有不同数量的标记假设转录对,这显着降低了单词错误率 WER。实验证据表明,所提出的技术通过超越传统基于重排序的方法的上限实现了突破。更令人惊讶的是,具有合理提示和生成能力的LLM甚至可以纠正N个最佳列表中缺失的标记。 |

| Enhancing End-to-End Conversational Speech Translation Through Target Language Context Utilization Authors Amir Hussein, Brian Yan, Antonios Anastasopoulos, Shinji Watanabe, Sanjeev Khudanpur 事实证明,纳入较长的上下文有利于机器翻译,但在端到端语音翻译 E2E ST 中纳入上下文仍在研究中。为了弥补这一差距,我们在 E2E ST 中引入了目标语言上下文,增强了连贯性并克服了扩展音频片段的记忆限制。此外,我们提出上下文丢失以确保在上下文缺失的情况下的鲁棒性,并通过添加说话者信息进一步提高性能。我们提出的上下文 E2E ST 优于基于孤立话语的 E2E ST 方法。 |

| Conversational Feedback in Scripted versus Spontaneous Dialogues: A Comparative Analysis Authors Ildik Pil n, Laurent Pr vot, Hendrik Buschmeier, Pierre Lison 电影和电视字幕等脚本对话构成了会话 NLP 模型的广泛训练数据源。然而,这些对话的语言特征与自发互动语料库中观察到的明显不同。这种差异对于沟通反馈和基础现象(例如反向渠道、致谢或澄清请求)尤其明显。已知此类信号构成对话流的关键部分,对话参与者使用这些信号向彼此提供关于他们对正在进行的交互的感知的反馈。本文对字幕和自发对话中的这种交流反馈现象进行了定量分析。基于英语、法语、德语、匈牙利语、意大利语、日语、挪威语和中文的对话数据,我们提取了用神经对话行为标记器获得的词汇统计和分类输出。这项实证研究的两个主要发现是: 1 字幕中的对话反馈明显低于自发对话中的频率; 2 字幕中的负面反馈比例更高。 |

| Generative Speech Recognition Error Correction with Large Language Models Authors Chao Han Huck Yang, Yile Gu, Yi Chieh Liu, Shalini Ghosh, Ivan Bulyko, Andreas Stolcke 我们探索大型语言模型 LLM 充当 ASR 后处理器来执行重新评分和纠错的能力。我们的重点是指令提示,让法学硕士无需微调即可执行这些任务,为此我们评估了不同的提示方案,包括上下文学习中的零次和少量提示,以及一种结合指令和演示的新颖的任务激活提示 TAP 方法。使用预训练的首轮系统并对两个域外任务 ATIS 和 WSJ 的输出进行重新评分,我们表明仅通过使用冻结的 LLM 进行上下文学习进行重新评分所获得的结果与通过域调整的 LM 进行的重新评分具有竞争力。 |

| NLPBench: Evaluating Large Language Models on Solving NLP Problems Authors Linxin Song, Jieyu Zhang, Lechao Cheng, Pengyuan Zhou, Tianyi Zhou, Irene Li 大型语言模型的最新发展显示出法学硕士在增强自然语言处理 NLP 能力方面的前景。尽管取得了这些成功,但仍然缺乏专门针对法学硕士 NLP 问题解决能力的研究。为了填补这一领域的空白,我们提出了一个独特的基准测试数据集 NLPBench,其中包含 378 个大学级别的 NLP 问题,涵盖来自耶鲁大学之前期末考试的各种 NLP 主题。 NLPBench 包含有上下文的问题,其中多个子问题共享相同的公共信息,并且问题类型多样,包括选择题、简答题和数学。我们的评估以 GPT 3.5 4、PaLM 2 和 LLAMA 2 等 LLM 为中心,结合了思想链 CoT 和思想树 ToT 等高级提示策略。我们的研究表明,高级提示策略的有效性可能不一致,有时会损害 LLM 的表现,特别是在像 LLAMA 2 13b 这样的较小模型中。 |

| Developing automatic verbatim transcripts for international multilingual meetings: an end-to-end solution Authors Akshat Dewan, Michal Ziemski, Henri Meylan, Lorenzo Concina, Bruno Pouliquen 本文提出了一种端到端解决方案,用于创建全自动会议记录并将其机器翻译成各种语言。该工具是世界知识产权组织 WIPO 使用内部开发的语音转文本 S2T 和机器翻译 MT 组件开发的。除了描述数据收集和微调以形成高度定制和强大的系统之外,本文还描述了技术组件的架构和演变,并强调了用户方的业务影响和收益。 |

| Few-Shot Multi-Label Aspect Category Detection Utilizing Prototypical Network with Sentence-Level Weighting and Label Augmentation Authors Zeyu Wang, Mizuho Iwaihara 多标签方面类别检测旨在检测给定句子中出现的多个方面类别。由于方面类别检测通常受到数据集有限和数据稀疏的影响,因此具有注意机制的原型网络已应用于少量镜头方面类别检测。尽管如此,迄今为止使用的大多数原型网络都是通过取支持集中所有实例的平均值来计算原型的。这似乎忽略了多标签方面类别检测中实例之间的差异。此外,一些相关工作利用标签文本信息来增强注意力机制。然而,标签文本信息通常简短且有限,并且不够具体以辨别类别。在本文中,我们首先引入支持集注意力以及增强的标签信息,以减轻每个支持集实例的单词级别的噪声。此外,我们使用句子级注意力机制,为支持集中的每个实例赋予不同的权重,以便通过加权平均来计算原型。最后,计算出的原型进一步与查询实例结合使用来计算查询注意力,从而消除查询集中的噪声。 |

| Direct Models for Simultaneous Translation and Automatic Subtitling: FBK@IWSLT2023 Authors Sara Papi, Marco Gaido, Matteo Negri 本文介绍了 FBK 参与 IWSLT 2023 评估活动的同声翻译和自动字幕轨道的情况。我们提交的内容侧重于使用直接架构来同时执行两项任务,我们利用离线训练模型已经获得的知识,并直接应用一种策略来获得字幕任务的实时推理,我们采用了直接 ST 模型生成格式良好的字幕,并利用相同的架构来生成字幕与视听内容同步所需的时间戳。与 2021 年和 2022 年任务轮中排名靠前的系统相比,我们的英语德语 SimulST 系统显示出计算感知延迟降低,增益高达 3.5 BLEU。 |

| Teaching Text-to-Image Models to Communicate Authors Xiaowen Sun, Jiazhan Feng, Yuxuan Wang, Yuxuan Lai, Xingyu Shen, Dongyan Zhao 在文本到图像生成的研究中,各种作品已经被广泛研究。尽管现有模型在文本到图像生成方面表现良好,但直接使用它们在对话框中生成图像时存在重大挑战。在本文中,我们首先强调对话图像生成的一个新问题,即给定对话上下文,模型应该生成与指定对话一致的真实图像作为响应。为了解决这个问题,我们提出了一种有效的对话图像生成方法,无需任何中间翻译,最大限度地提取对话中包含的语义信息。考虑到对话结构的特点,我们在对话的每个句子之前放置段标记来区分不同的说话者。然后,我们将预先训练的文本微调为图像模型,使它们能够根据处理的对话上下文生成调节图像。经过微调后,我们的方法可以在多个指标上持续提高各种模型的性能。 |

| Dynamic Multi-Scale Context Aggregation for Conversational Aspect-Based Sentiment Quadruple Analysis Authors Yuqing Li, Wenyuan Zhang, Binbin Li, Siyu Jia, Zisen Qi, Xingbang Tan 基于对话方面的情感四元分析 DiaASQ 旨在提取对话中目标方面意见情感的四元。在 DiaASQ 中,四元组的元素经常跨越多个话语。这种情况使提取过程变得复杂,强调需要充分理解对话上下文和交互。然而,现有的工作独立地对每个话语进行编码,从而难以捕获长范围的对话上下文并忽略深层的话语依赖性。在这项工作中,我们提出了一种新颖的动态多尺度上下文聚合网络 DMCA 来应对这些挑战。具体来说,我们首先利用对话结构生成多尺度话语窗口以捕获丰富的上下文信息。之后,我们设计了一个动态分层聚合模块DHA来整合它们之间的渐进线索。此外,我们形成了多阶段损失策略来提高模型性能和泛化能力。 |

| ChatCounselor: A Large Language Models for Mental Health Support Authors June M. Liu, Donghao Li, He Cao, Tianhe Ren, Zeyi Liao, Jiamin Wu 本文介绍了 ChatCounselor,一种大型语言模型 LLM 解决方案,旨在提供心理健康支持。与一般的聊天机器人不同,ChatCounselor 的特点是它建立在咨询客户和专业心理学家之间的真实对话基础上,使其拥有心理学领域的专业知识和咨询技能。训练数据集 Psych8k 由 260 次深度访谈构建而成,每次访谈持续一小时。为了评估咨询反应的质量,设计了咨询工作台。利用 GPT 4 和基于心理咨询评估的七个指标精心设计的提示,该模型使用一组现实世界的咨询问题进行了评估。 |

| Graph Neural Prompting with Large Language Models Authors Yijun Tian, Huan Song, Zichen Wang, Haozhu Wang, Ziqing Hu, Fang Wang, Nitesh V. Chawla, Panpan Xu 大型语言模型法学硕士在各种语言建模任务中表现出了卓越的泛化能力和出色的表现。然而,它们在精确捕获和返回基础知识方面仍然表现出固有的局限性。虽然现有的工作已经探索利用知识图谱通过联合训练和定制模型架构来增强语言建模,但由于其大量参数和高计算成本,将其应用于法学硕士是有问题的。此外,如何利用预先训练的法学硕士并避免从头开始训练定制模型仍然是一个悬而未决的问题。在这项工作中,我们提出了图神经提示 GNP,这是一种新颖的即插即用方法,可以帮助经过预训练的法学硕士从知识图谱中学习有用的知识。 GNP 包含各种设计,包括标准图神经网络编码器、跨模态池模块、域投影仪和自监督链接预测目标。 |

| A Survey of Chain of Thought Reasoning: Advances, Frontiers and Future Authors Zheng Chu, Jingchang Chen, Qianglong Chen, Weijiang Yu, Tao He, Haotian Wang, Weihua Peng, Ming Liu, Bing Qin, Ting Liu 思维推理链是人类智能的基础认知过程,在人工智能和自然语言处理领域引起了广泛关注。然而,目前仍缺乏对这一领域的全面调查。为此,我们迈出了第一步,对这一研究领域进行了仔细、广泛的全面调查。我们用X of Thought来指代广义的思想链。具体来说,我们根据方法分类系统地组织了当前的研究,包括XoT构建、XoT结构变体和增强XoT。此外,我们还描述了 XoT 的前沿应用,包括规划、工具使用和精炼。此外,我们还应对挑战并讨论一些未来的方向,包括忠诚度、多模式和理论。 |

| Beyond the Chat: Executable and Verifiable Text-Editing with LLMs Authors Philippe Laban, Jesse Vig, Marti A. Hearst, Caiming Xiong, Chien Sheng Wu 由大型语言模型 LLM 提供支持的对话界面最近已成为在文档编辑过程中获取反馈的流行方式。然而,基于标准聊天的对话界面不支持他们建议的编辑更改的透明度和可验证性。为了让作者在使用法学硕士进行编辑时有更多的代理权,我们推出了 InkSync,这是一个编辑界面,建议直接在正在编辑的文档中进行可执行编辑。由于众所周知,LLM 会引入事实错误,因此 Inksync 还支持三阶段方法来减轻这种风险。当建议的编辑引入新信息时向作者发出警告,帮助作者通过外部搜索验证新信息的准确性,并允许审核员执行审核通过跟踪所有自动生成的内容来审核文档进行事后验证。 |

| joint prediction and denoising for large-scale multilingual self-supervised learning Authors William Chen, Jiatong Shi, Brian Yan, Dan Berrebbi, Wangyou Zhang, Yifan Peng, Xuankai Chang, Soumi Maiti, Shinji Watanabe 由于处理多种语言所需的费用和复杂性,多语言自监督学习 SSL 常常落后于最先进的 SOTA 方法。这进一步损害了 SSL 的可重复性,由于其资源占用,SSL 已经仅限于少数研究小组。我们证明,更强大的技术实际上可以带来更有效的预训练,从而向更多研究小组开放 SSL。我们提出了 WavLabLM,它将 WavLM 的联合预测和去噪扩展到 136 种语言的 40k 小时数据。为了构建 WavLabLM,我们设计了一种新颖的多阶段预训练方法,旨在解决多语言数据的语言不平衡问题。 WavLabLM 在 ML SUPERB 上以不到 10 个训练数据实现了与 XLS R 相当的性能,使得 SSL 可通过学术计算实现。我们证明,使用普通的 HuBERT Base 模型可以实现更高的效率,该模型只需 3 个数据、4 个 GPU 和有限的试验即可保持 XLS R 的 94 倍性能。 |

| Learning Using Generated Privileged Information by Text-to-Image Diffusion Models Authors Rafael Edy Menadil, Mariana Iuliana Georgescu, Radu Tudor Ionescu 使用特权信息学习是一种特殊类型的知识蒸馏,其中教师模型在训练期间受益于额外的数据表示(称为特权信息),从而改进了学生模型,而学生模型看不到额外的表示。然而,在实践中很少能获得特权信息。为此,我们提出了一种文本分类框架,利用文本到图像扩散模型来生成人工特权信息。生成的图像和原始文本样本进一步用于训练基于最先进的基于变压器的架构的多模式教师模型。最后,多模态教师的知识被提炼成基于文本的单模态学生。因此,通过采用生成模型来生成合成数据作为特权信息,我们指导学生模型的训练。 |

| Low-rank Adaptation of Large Language Model Rescoring for Parameter-Efficient Speech Recognition Authors Yu Yu, Chao Han Huck Yang, Jari Kolehmainen, Prashanth G. Shivakumar, Yile Gu, Sungho Ryu, Roger Ren, Qi Luo, Aditya Gourav, I Fan Chen, Yi Chieh Liu, Tuan Dinh, Ankur Gandhe, Denis Filimonov, Shalini Ghosh, Andreas Stolcke, Ariya Rastow, Ivan Bulyko 我们提出了一种基于低秩自适应 LoRA 的神经语言建模系统,用于语音识别输出重新评分。尽管像 BERT 这样的预训练语言模型 LM 在第二遍重新评分中表现出了卓越的性能,但扩大预训练阶段和使预训练模型适应特定领域的高计算成本限制了它们在重新评分中的实际使用。在这里,我们提出了一种基于低秩分解的方法来训练重新评分 BERT 模型,并仅使用预训练参数的 0.08 分之一使其适应新领域。这些插入的矩阵通过判别性训练目标以及基于相关性的正则化损失进行优化。 |

| RAGAS: Automated Evaluation of Retrieval Augmented Generation Authors Shahul Es, Jithin James, Luis Espinosa Anke, Steven Schockaert 我们介绍 RAGAs 检索增强生成评估,这是一个用于检索增强生成 RAG 管道的无参考评估的框架。 RAG系统由检索和基于LLM的生成模块组成,并为LLM提供来自参考文本数据库的知识,这使他们能够充当用户和文本数据库之间的自然语言层,从而降低产生幻觉的风险。然而,评估 RAG 架构具有挑战性,因为有几个维度需要考虑检索系统识别相关和重点上下文段落的能力、法学硕士以忠实的方式利用这些段落的能力,或者生成本身的质量。通过 RAGA,我们提出了一套指标,可用于评估这些不同维度的文本,而无需依赖真实的人类注释。 |

| STANCE-C3: Domain-adaptive Cross-target Stance Detection via Contrastive Learning and Counterfactual Generation Authors Nayoung Kim, David Mosallanezhad, Lu Cheng, Michelle V. Mancenido, Huan Liu 立场检测是推断一个人在特定问题上的立场或观点的过程,以推断出对普遍或有争议的话题的普遍看法,例如 COVID 19 大流行期间的卫生政策。现有的立场检测模型经过训练,可以在单个领域(例如 COVID 19)和特定目标主题(例如屏蔽协议)中表现良好,但由于数据分布变化,在其他领域或目标中通常无效。然而,构建高性能、特定领域的姿态检测模型需要大量与目标领域相关的标记数据,但此类数据集并不容易获得。这带来了挑战,因为注释数据的过程既昂贵又耗时。为了应对这些挑战,我们引入了一种新颖的姿态检测模型,通过对比学习和反事实生成 STANCE C3 创造了域自适应跨目标 STANCE 检测,该模型使用反事实数据增强来增强域自适应训练,方法是在训练过程中丰富目标域数据集,并要求显着来自新域的信息较少。我们还提出了一种修改后的自监督对比学习作为 STANCE C3 的组成部分,以防止对现有域和目标的过度拟合,并实现跨目标姿态检测。 |

| Identifying the Risks of LM Agents with an LM-Emulated Sandbox Authors Yangjun Ruan, Honghua Dong, Andrew Wang, Silviu Pitis, Yongchao Zhou, Jimmy Ba, Yann Dubois, Chris J. Maddison, Tatsunori Hashimoto 语言模型 LM 代理和工具使用的最新进展(以 ChatGPT 插件等应用程序为代表)实现了丰富的功能,但也放大了潜在风险,例如泄露私人数据或造成财务损失。识别这些风险是一项劳动密集型工作,需要实施工具、为每个测试场景手动设置环境并查找风险案例。随着工具和代理变得更加复杂,测试这些代理的高昂成本将使得发现高风险、长尾风险变得越来越困难。为了应对这些挑战,我们引入了 ToolEmu 框架,该框架使用 LM 来模拟工具执行,并支持针对各种工具和场景测试 LM 代理,而无需手动实例化。除了模拟器之外,我们还开发了一个基于 LM 的自动安全评估器,用于检查代理故障并量化相关风险。我们通过人工评估测试了工具模拟器和评估器,发现 ToolEmu 识别的故障中有 68.8 % 是真实世界代理故障。我们使用由 36 个高风险工具和 144 个测试用例组成的精心策划的初始基准,对当前 LM 代理进行定量风险分析,并识别出许多可能产生严重后果的故障。 |

| Learning from Flawed Data: Weakly Supervised Automatic Speech Recognition Authors Dongji Gao, Hainan Xu, Desh Raj, Leibny Paola Garcia Perera, Daniel Povey, Sanjeev Khudanpur 训练自动语音识别 ASR 系统需要大量精心策划的配对数据。然而,人类注释者通常执行非逐字转录,这可能会导致模型训练不佳。在本文中,我们提出了全时态分类 OTC,这是一种新颖的训练标准,它明确地纳入了源自这种弱监督的标签不确定性。这使得模型能够有效地学习语音文本对齐,同时适应训练记录中存在的错误。 OTC 通过利用加权有限状态传感器扩展了针对不完美转录本的传统 CTC 目标。通过在 LibriSpeech 和 LibriVox 数据集上进行的实验,我们证明,使用 OTC 训练 ASR 模型可以避免性能下降,即使转录本包含多达 70 个错误(CTC 模型完全失败的情况)。 |

| Speech collage: code-switched audio generation by collaging monolingual corpora Authors Amir Hussein, Dorsa Zeinali, Ond ej Klejch, Matthew Wiesner, Brian Yan, Shammur Chowdhury, Ahmed Ali, Shinji Watanabe, Sanjeev Khudanpur 为代码转换 CS 设计有效的自动语音识别 ASR 系统通常取决于转录 CS 资源的可用性。为了解决数据稀缺的问题,本文引入了语音拼贴(Speech Collage),这是一种通过拼接音频片段从单语言语料库合成 CS 数据的方法。我们使用重叠添加方法进一步提高了音频生成的平滑质量。我们研究了在域 CS 文本和合成 CS 文本的零样本方法的两种场景中生成的数据对语音识别的影响。实证结果表明,域内和零样本场景的混合错误率和字错误率分别相对降低了 34.4 和 16.2。 |

| MONOVAB : An Annotated Corpus for Bangla Multi-label Emotion Detection Authors Sumit Kumar Banshal, Sajal Das, Shumaiya Akter Shammi, Narayan Ranjan Chakraborty 近年来,情感分析 SA 和情感识别 ER 在孟加拉语中越来越受欢迎,孟加拉语是全世界第七大语言。然而,语言结构复杂,这使得该领域很难准确地提取情感。该研究领域已经实施了几种不同的方法,例如提取积极和消极情绪以及多类别情绪。然而,多种情感的提取是该语言中几乎未触及的领域。这涉及根据一段文本识别多种感受。因此,本研究展示了一种基于 Facebook 废弃数据构建带注释语料库的彻底方法,以弥补该学科领域的差距,克服挑战。为了使该注释更加富有成效,使用了基于上下文的方法。 Transformers 的双向编码器表示 BERT 是一种众所周知的 Transformer 方法,已显示出所有实施方法的最佳结果。 |

| Jointly Training Large Autoregressive Multimodal Models Authors Emanuele Aiello, Lili Yu, Yixin Nie, Armen Aghajanyan, Barlas Oguz 近年来,语言和文本到图像模型的大规模预训练的进展彻底改变了机器学习领域。然而,将这两种模式集成到一个能够生成无缝多模式输出的强大模型中仍然是一个重大挑战。为了解决这一差距,我们提出了联合自回归混合 JAM 框架,这是一种模块化方法,可以系统地融合现有的文本和图像生成模型。我们还引入了一种专门的、数据高效的指令调整策略,专为混合模式生成任务量身定制。 |

| High-Fidelity Speech Synthesis with Minimal Supervision: All Using Diffusion Models Authors Chunyu Qiang, Hao Li, Yixin Tian, Yi Zhao, Ying Zhang, Longbiao Wang, Jianwu Dang 文本到语音 TTS 方法在语音克隆方面显示出了可喜的结果,但它们需要大量标记的文本语音对。最小监督语音合成通过组合两种类型的离散语音表示(语义声学)并使用两个序列到序列任务来解耦 TTS,从而以最少的监督进行训练。然而,现有方法在语义表示中存在信息冗余和维度爆炸,在离散声学表示中存在高频波形失真。自回归框架表现出典型的不稳定和不可控问题。非自回归框架会受到持续时间预测模型引起的韵律平均的影响。为了解决这些问题,我们提出了一种最低限度监督的高保真语音合成方法,其中所有模块都是基于扩散模型构建的。非自回归框架增强了可控性,时长扩散模型实现了多样化的韵律表达。 Contrastive Token Acoustic Pretraining CTAP作为中间语义表示,解决现有语义编码方法中信息冗余和维度爆炸的问题。梅尔频谱图用作声学表示。通过连续变量回归任务来预测语义和声学表示,以解决高频细粒度波形失真问题。实验结果表明,我们提出的方法优于基线方法。 |

| VideoAdviser: Video Knowledge Distillation for Multimodal Transfer Learning Authors Yanan Wang, Donghuo Zeng, Shinya Wada, Satoshi Kurihara 多模态迁移学习旨在将不同模态的预训练表示转换为公共域空间,以实现有效的多模态融合。然而,传统系统通常建立在所有模态都存在的假设之上,而缺乏模态总是会导致推理性能不佳。此外,为所有模态提取预训练的嵌入对于推理而言计算效率低下。在这项工作中,为了实现高效性能的多模态迁移学习,我们提出了VideoAdviser,一种视频知识蒸馏方法,将视频增强提示的多模态知识从多模态基础模型教师转移到特定模态基础模型学生。我们的直觉是最好的学习成绩来自于专业顾问和聪明的学生,我们使用基于 CLIP 的教师模型,通过优化步骤蒸馏目标损失,为基于 RoBERTa 的学生模型提供富有表现力的多模态知识监督信号。从分类 Logit 到回归 Logit 的视频增强提示第二步,从教师到学生的回归 Logit 中提取多模态知识。我们在两个具有挑战性的多模态任务(视频级情感分析 MOSI 和 MOSEI 数据集以及视听检索 VEGAS 数据集)中评估我们的方法。仅需要文本形式作为输入的学生的 MOSI 和 MOSEI 的 MAE 分数提高高达 12.3。我们的方法将 VEGAS 的 mAP 分数进一步提高了 3.4,而无需额外的推理计算。 |

| Evaluating Cognitive Maps and Planning in Large Language Models with CogEval Authors Ida Momennejad, Hosein Hasanbeig, Felipe Vieira, Hiteshi Sharma, Robert Osazuwa Ness, Nebojsa Jojic, Hamid Palangi, Jonathan Larson 最近大量研究声称大型语言模型法学硕士具有新兴的认知能力。然而,大多数依赖于轶事,忽视了训练集的污染,或者缺乏涉及多个任务、控制条件、多次迭代和统计稳健性测试的系统评估。在这里我们做出了两个主要贡献。首先,我们提出 CogEval,这是一种受认知科学启发的协议,用于系统评估大型语言模型中的认知能力。可以遵循CogEval协议来评估各种能力。其次,我们遵循 CogEval 系统地评估八个 LLM OpenAI GPT 4、GPT 3.5 Turbo 175B、davinci 003 175B、Google Bard、Cohere xlarge 52.4B、Anthropic Claude 1 52B、LLaMA 13B 和 Alpaca 7B 的认知图和规划能力。我们的任务提示基于人体实验,这既提供了评估计划的既定结构有效性,又不存在于法学硕士培训集中。我们发现,虽然法学硕士在一些结构较简单的规划任务中表现出明显的能力,但系统评估揭示了规划任务中惊人的失败模式,包括无效轨迹的幻觉和陷入循环。这些发现并不支持法学硕士具有现成的计划能力的想法。这可能是因为法学硕士不理解规划问题背后的潜在关系结构(称为认知图),并且无法根据底层结构展开目标导向的轨迹。 |

| QA-LoRA: Quantization-Aware Low-Rank Adaptation of Large Language Models Authors Yuhui Xu, Lingxi Xie, Xiaotao Gu, Xin Chen, Heng Chang, Hengheng Zhang, Zhensu Chen, Xiaopeng Zhang, Qi Tian 近年来,大型语言模型法学硕士发展迅速。尽管LLM在许多语言理解任务中具有很强的能力,但繁重的计算负担在很大程度上限制了LLM的应用,特别是当需要将它们部署到边缘设备上时。在本文中,我们提出了一种量化感知低秩自适应 QA LoRA 算法。其动机在于量化和自适应的自由度不平衡,解决方案是使用分组算子来增加量化的自由度,同时减少自适应的自由度。 QA LoRA 可以通过几行代码轻松实现,并且它为原始 LoRA 配备了两种能力 i 在微调期间,LLM 的权重被量化,例如量化为 INT4 以减少时间和内存使用 ii 在微调之后,LLM辅助权重自然地集成到量化模型中,而不会损失准确性。我们将 QA LoRA 应用于 LLaMA 和 LLaMA2 模型系列,并验证其在不同微调数据集和下游场景中的有效性。 |

| Chinese Abs From Machine Translation |

Papers from arxiv.org

更多精彩请移步主页

pic from pexels.com

相关文章:

【AI视野·今日NLP 自然语言处理论文速览 第四十三期】Thu, 28 Sep 2023

AI视野今日CS.NLP 自然语言处理论文速览 Thu, 28 Sep 2023 Totally 38 papers 👉上期速览✈更多精彩请移步主页 Daily Computation and Language Papers Cross-Modal Multi-Tasking for Speech-to-Text Translation via Hard Parameter Sharing Authors Brian Yan,…...

Unity 制作登录功能01-创建登录的UI并获取输入内容

1.创建UI面板 导入插件TextMesh Pro 2.编写脚本获取用户输入 这里用的是输入框侦听函数,所有UI都可以使用侦听函数 ,需要注意TMP_InputField 这个类是UI中导入的一个插件TextMesh Pro!在代码中需要引用using TMPro; 命名空间! …...

什么是用户画像?

(1)首先用户画像是个动词逻辑,不是名词,就是给用户绘制肖像。 (2)在互联网这个平台上,绘制肖像就相当千给用户打标签 (3)标签通常是人为规定的高度精炼的特征标识,如年龄、性别、地域、兴趣等…...

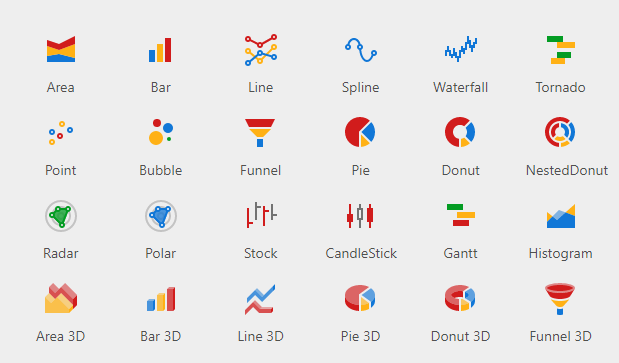

DevExpress WinForms图表组件 - 直观的数据信息呈现方式!(二)

在上文中(点击这里回顾>>),我们为大家介绍了DevExpress WinForms图表控件的互动图表、图标设计器及可定制功能等,本文将继续介绍DevExpress WinForms图表控件的数据分析、大数据功能等,欢迎持续关注我们哦~ Dev…...

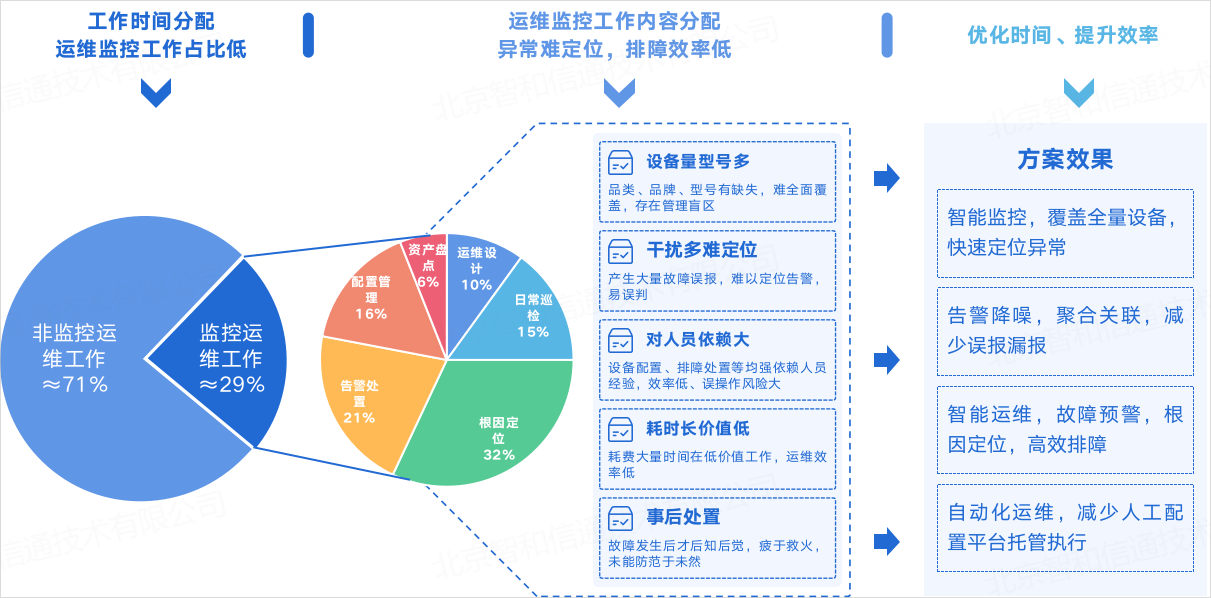

基于AIOps实现智慧园区极简IT运维

随着物联网、云平台、大数据、人工智能等技术的发展,并逐步投入到智慧园区的建设,传统园区数字化转型加快。园区的形式包括产业园区、教育园区、制造业园区、科研园区、社区等等,园区形态不断演进和发展,园区网承载的对象和业务也…...

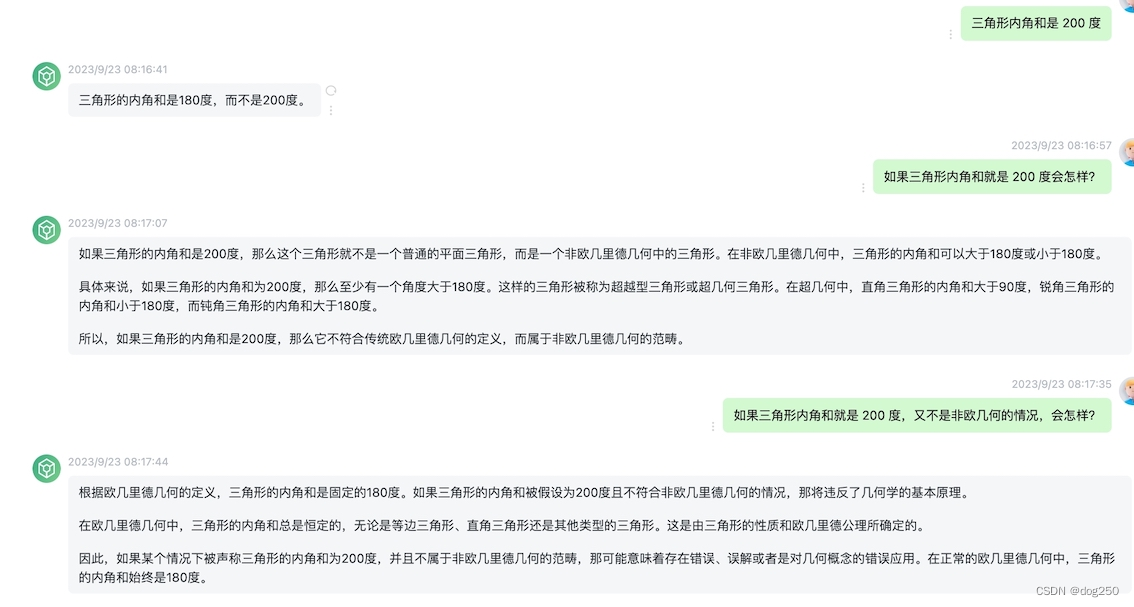

chatgpt 只会死记硬背吗

本周写两篇关于 chatgpt 的随感,我不善于写文档,所以我的文字多是输出直感和观点,而不是知识,没有关于 chatgpt 的原理和应用,甚至术语也不匹配,反正就是想到哪算哪吧。 都说 chatgpt 没有内在逻辑…...

03-Zookeeper客户端使用

上一篇:02-Zookeeper实战 1. 项目构建 zookeeper 官方的客户端没有和服务端代码分离,他们为同一个jar 文件,所以我们直接引入zookeeper的maven即可, 这里版本请保持与服务端版本一致,不然会有很多兼容性的问题 <…...

自然语言处理(NLP)学习之与HanLP的初相识

目录 前言 一、自然语言处理基本知识 1、NLP类别 2、核心任务 二、Hanlp简要介绍 三、Hanlp云服务能力 1、全新云原生2.x 2、Python api调用 3、Go api调用 4、Java api调用 四、Hanlp native服务 1、本地开发 总结 前言 在ChatGPT的滚滚浪潮下,也伴随着人工智…...

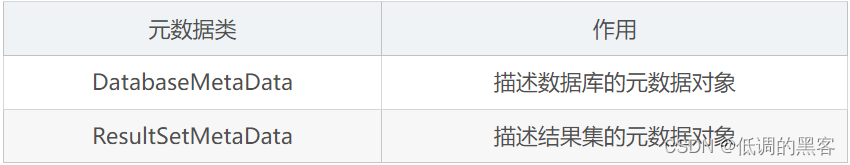

JDBC【DBUtils】

一、 DBUtils工具类🍓 (一)、DBUtils简介🥝 使用JDBC我们发现冗余的代码太多了,为了简化开发 我们选择使用 DbUtils Commons DbUtils是Apache组织提供的一个对JDBC进行简单封装的开源工具类库,使用它能够简化JDBC应用程序的开发,…...

大数据Doris(一):Doris概述篇

文章目录 Doris概述篇 一、前言 二、Doris简介...

vue 基于vue-seamless-scroll无缝滚动的用法和遇到的问题解决

vue 基于vue-seamless-scroll无缝滚动的用法和遇到的问题解决 背景 最近再做一个大屏项目,需要用到表格滚动效果,之前自己写过js实现,最近发现一个组件vue-seamless-scroll可以实现滚动,感觉挺方便的,准备用一下,但是用完之后才发现这个组件有很多坑需要解决.我把用法和一些问…...

SmartX 边缘计算解决方案:简单稳定,支持各类应用负载

在《一文了解近端边缘 IT 基础架构技术需求》文章中,我们为大家分析了边缘应用对 IT 基础架构的技术要求,以及为什么超融合架构是支持边缘场景的最佳选择。值得一提的是,IDC 近日发布的《中国软件定义存储(SDS)及超融合…...

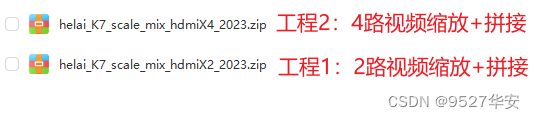

FPGA 多路视频处理:图像缩放+视频拼接显示,HDMI采集,提供2套工程源码和技术支持

目录 1、前言版本更新说明免责声明 2、相关方案推荐FPGA图像缩放方案推荐FPGA视频拼接方案推荐 3、设计思路框架视频源选择IT6802解码芯片配置及采集动态彩条缓冲FIFO图像缩放模块详解设计框图代码框图2种插值算法的整合与选择 视频拼接算法图像缓存视频输出 4、vivado工程1&am…...

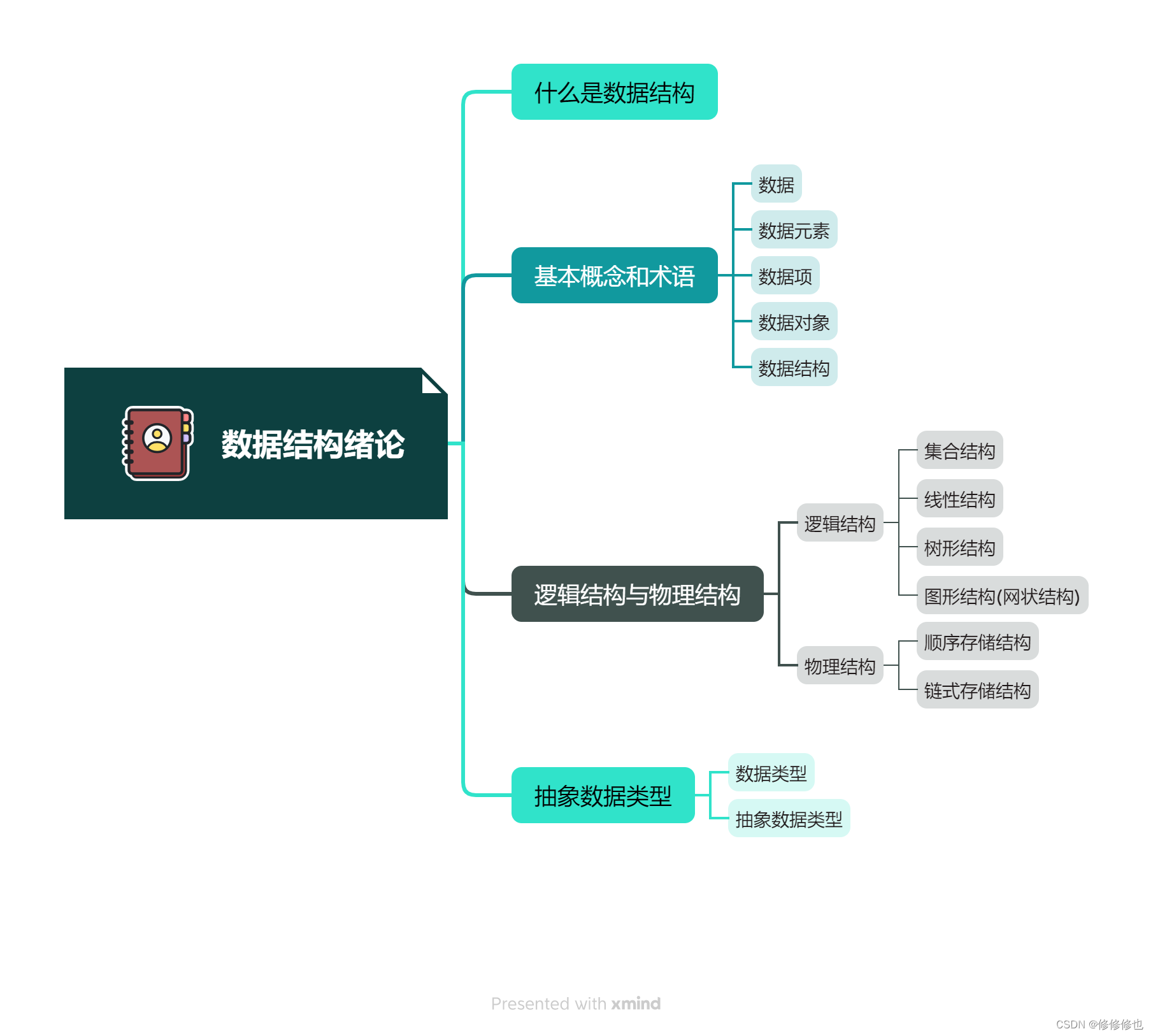

【数据结构】抽象数据类型

🦄个人主页:修修修也 🎏所属专栏:数据结构 ⚙️操作环境:Visual Studio 2022 目录 🎏数据类型 🎏抽象数据类型 结语 🎏数据类型 数据类型:是指一组性质相同的值的集合及定义在此集合上的一些操作的总称. 数据类型(d…...

Android 查看路由表

Android 查看路由表_android 路由表_念雅的博客-CSDN博客...

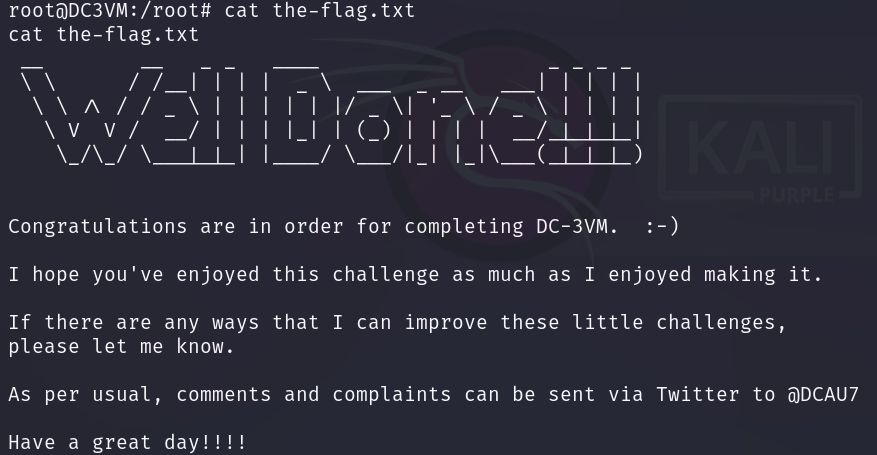

vulnhub靶机-DC系列-DC-3

文章目录 信息收集漏洞查找漏洞利用SQL注入John工具密码爆破反弹shell 提权 信息收集 主机扫描 arp-scan -l可以用netdiscover 它是一个主动/被动的ARP 侦查工具。使用Netdiscover工具可以在网络上扫描IP地址,检查在线主机或搜索为它们发送的ARP请求。 netdiscover -r 192.1…...

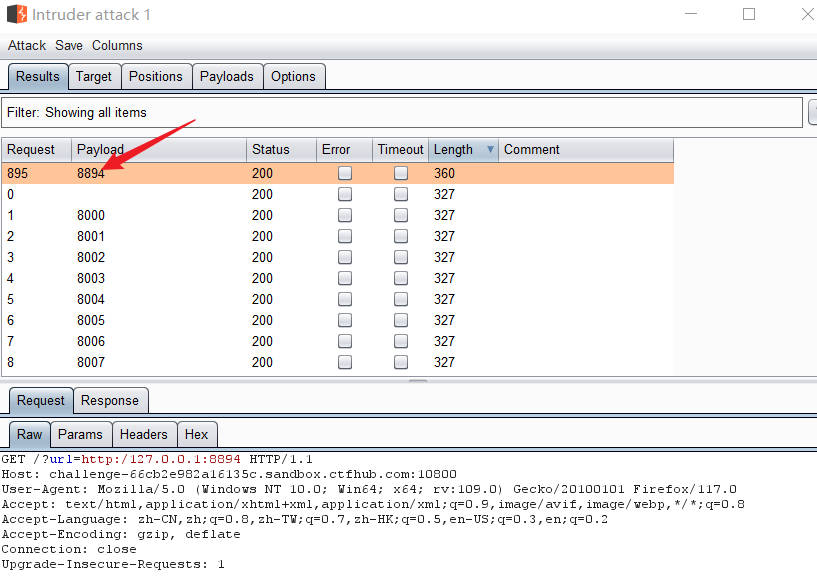

【CTFHUB】SSRF原理之简单运用(一)

一、漏洞原理 SSRF 服务端请求伪造 原理:在某些网站中提供了从其他服务器获取数据的功能,攻击者能通过构造恶意的URL参数,恶意利用后可作为代理攻击远程或本地的服务器。 二、SSRF的利用 1.对目标外网、内网进行端口扫描。 2.攻击内网或本…...

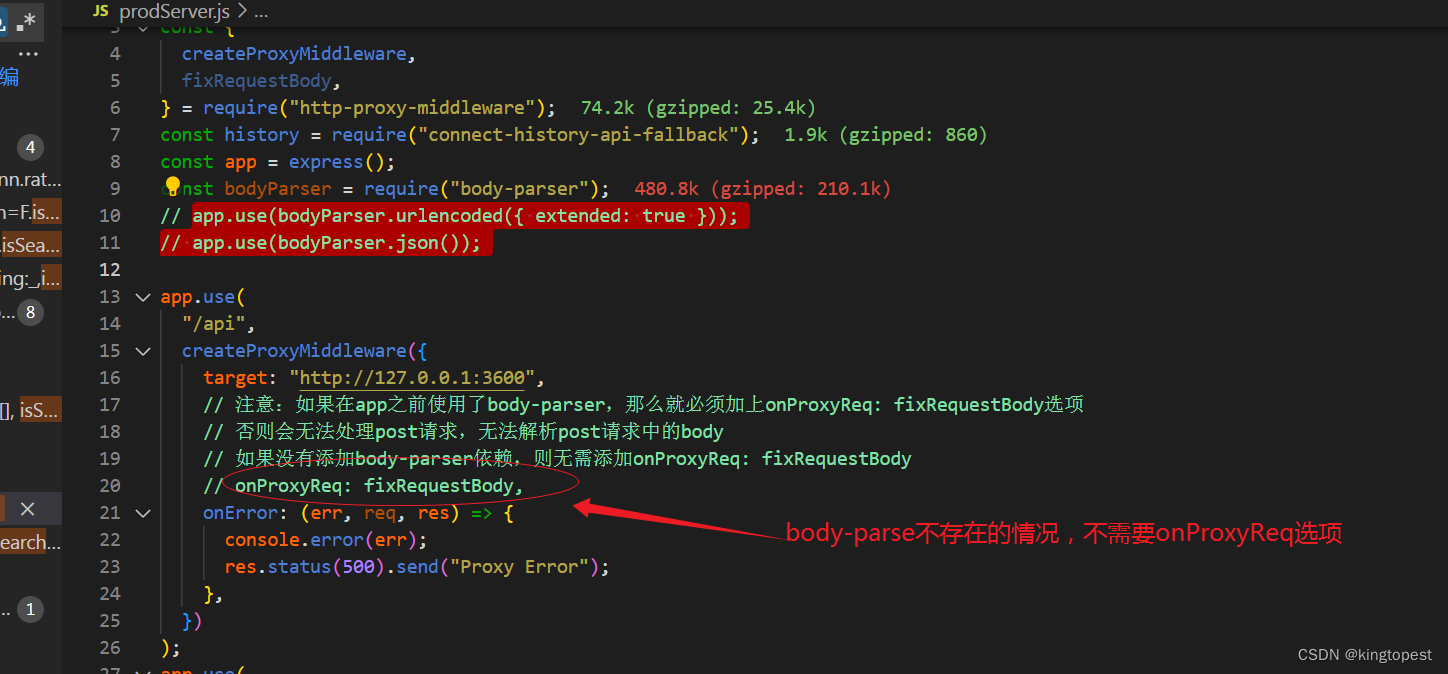

wepack打包生产环境使用http-proxy-middleware做api代理转发的方法

首先安装http-proxy-middleware依赖,这个用npm和yarn安装都可以。 然后在express服务器的代码增加如下内容: const express require("express"); const app express(); const { createProxyMiddleware, fixRequestBody, } require("h…...

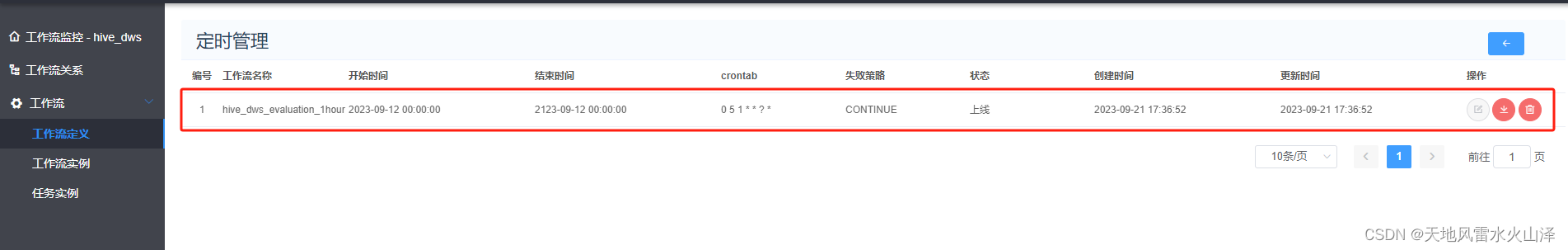

一百八十六、大数据离线数仓完整流程——步骤五、在Hive的DWS层建动态分区表并动态加载数据

一、目的 经过6个月的奋斗,项目的离线数仓部分终于可以上线了,因此整理一下离线数仓的整个流程,既是大家提供一个案例经验,也是对自己近半年的工作进行一个总结。 二、数仓实施步骤 (五)步骤五、在Hive的…...

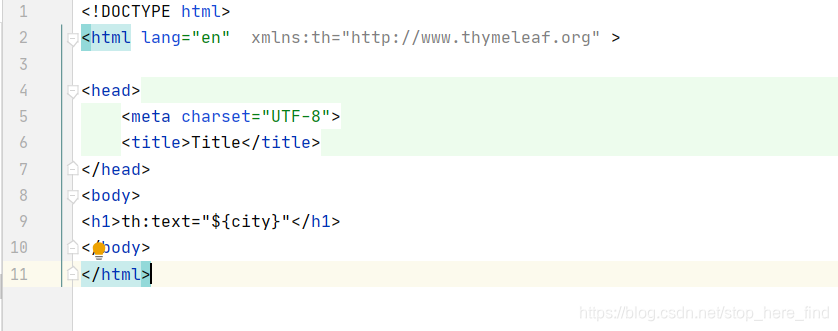

Idea引入thymeleaf失败解决方法

报错 Whitelabel Error Page This application has no explicit mapping for /error, so you are seeing this as a fallback.Fri Sep 29 09:42:00 CST 2023 There was an unexpected error (typeNot Found, status404). 原因:html没有使用thymeleaf 首先要引入…...

第19节 Node.js Express 框架

Express 是一个为Node.js设计的web开发框架,它基于nodejs平台。 Express 简介 Express是一个简洁而灵活的node.js Web应用框架, 提供了一系列强大特性帮助你创建各种Web应用,和丰富的HTTP工具。 使用Express可以快速地搭建一个完整功能的网站。 Expre…...

PHP和Node.js哪个更爽?

先说结论,rust完胜。 php:laravel,swoole,webman,最开始在苏宁的时候写了几年php,当时觉得php真的是世界上最好的语言,因为当初活在舒适圈里,不愿意跳出来,就好比当初活在…...

2025年能源电力系统与流体力学国际会议 (EPSFD 2025)

2025年能源电力系统与流体力学国际会议(EPSFD 2025)将于本年度在美丽的杭州盛大召开。作为全球能源、电力系统以及流体力学领域的顶级盛会,EPSFD 2025旨在为来自世界各地的科学家、工程师和研究人员提供一个展示最新研究成果、分享实践经验及…...

涂鸦T5AI手搓语音、emoji、otto机器人从入门到实战

“🤖手搓TuyaAI语音指令 😍秒变表情包大师,让萌系Otto机器人🔥玩出智能新花样!开整!” 🤖 Otto机器人 → 直接点明主体 手搓TuyaAI语音 → 强调 自主编程/自定义 语音控制(TuyaAI…...

汇编常见指令

汇编常见指令 一、数据传送指令 指令功能示例说明MOV数据传送MOV EAX, 10将立即数 10 送入 EAXMOV [EBX], EAX将 EAX 值存入 EBX 指向的内存LEA加载有效地址LEA EAX, [EBX4]将 EBX4 的地址存入 EAX(不访问内存)XCHG交换数据XCHG EAX, EBX交换 EAX 和 EB…...

多种风格导航菜单 HTML 实现(附源码)

下面我将为您展示 6 种不同风格的导航菜单实现,每种都包含完整 HTML、CSS 和 JavaScript 代码。 1. 简约水平导航栏 <!DOCTYPE html> <html lang"zh-CN"> <head><meta charset"UTF-8"><meta name"viewport&qu…...

【学习笔记】深入理解Java虚拟机学习笔记——第4章 虚拟机性能监控,故障处理工具

第2章 虚拟机性能监控,故障处理工具 4.1 概述 略 4.2 基础故障处理工具 4.2.1 jps:虚拟机进程状况工具 命令:jps [options] [hostid] 功能:本地虚拟机进程显示进程ID(与ps相同),可同时显示主类&#x…...

中的KV缓存压缩与动态稀疏注意力机制设计)

大语言模型(LLM)中的KV缓存压缩与动态稀疏注意力机制设计

随着大语言模型(LLM)参数规模的增长,推理阶段的内存占用和计算复杂度成为核心挑战。传统注意力机制的计算复杂度随序列长度呈二次方增长,而KV缓存的内存消耗可能高达数十GB(例如Llama2-7B处理100K token时需50GB内存&a…...

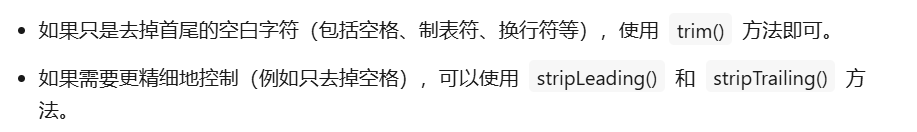

算法笔记2

1.字符串拼接最好用StringBuilder,不用String 2.创建List<>类型的数组并创建内存 List arr[] new ArrayList[26]; Arrays.setAll(arr, i -> new ArrayList<>()); 3.去掉首尾空格...

JAVA后端开发——多租户

数据隔离是多租户系统中的核心概念,确保一个租户(在这个系统中可能是一个公司或一个独立的客户)的数据对其他租户是不可见的。在 RuoYi 框架(您当前项目所使用的基础框架)中,这通常是通过在数据表中增加一个…...