Boosting Crowd Counting via Multifaceted Attention之人群密度估计实践

这周闲来无事,看到一篇前不久刚发表的文章,是做密集人群密度估计的,这块我之前虽然也做过,但是主要是基于检测的方式实现的,这里提出来的方法还是比较有意思的,就拿来实践一下。

论文在这里,感兴趣可以看下。

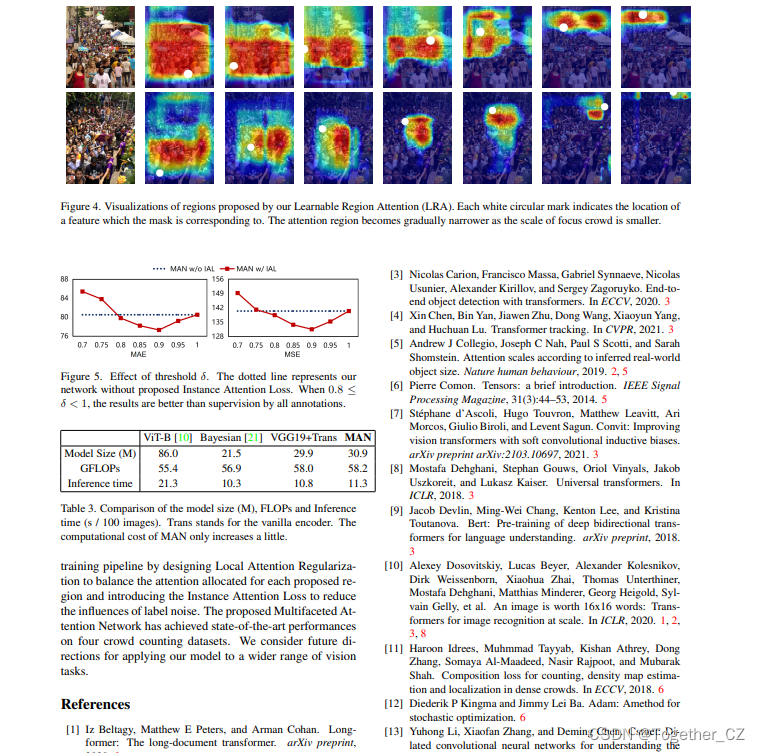

可以看到还是很有意思的。

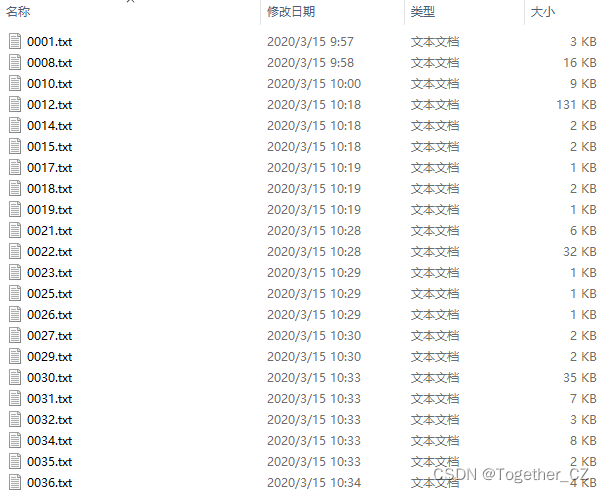

这里使用的是jhu_crowd_v2.0数据集,如下:

以train为例如下所示:

images目录如下所示:

gt目录如下所示:

实例标注数据如下:

166 228 22 27 1 0

414 218 11 15 1 0

541 232 14 14 1 0

353 213 11 15 1 0

629 222 14 14 1 0

497 243 39 43 1 0

468 222 11 15 1 0

448 227 11 15 1 0

737 220 39 43 1 0

188 228 33 30 1 0

72 198 22 27 1 0

371 214 11 15 1 0

362 242 24 32 1 0

606 260 39 43 1 0

74 228 22 27 1 0

597 226 14 14 1 0

576 213 14 14 1 0数据集详情如下:

This file contains information about the JHU-CROWD++ (v2.0) dataset. -----------------------------------------------------------------------------------------------------

INTRODUCTION

-----------------------------------------------------------------------------------------------------JHU-CROWD++ is a comprehensive dataset with 4,372 images and 1.51 million annotations. In comparison

to existing datasets, the proposed dataset is collected under a variety of diverse scenarios and

environmental conditions. In addition, the dataset provides comparatively richer set of annotations

like dots, approximate bounding boxes, blur levels, etc.-----------------------------------------------------------------------------------------------------

DIRECTORY INFO

-----------------------------------------------------------------------------------------------------

1. The dataset directory contains 3 sub-directories: train, val and test.2. Each of these contain 2 sub-directories (images, gt) and a file "image_labels.txt".3. The "images" directory contains images and the "gt" directory contains ground-truth files corresponding to the images in the images directory.4. The number of samples in train, val and test split are 2272, 500, 1600 respectively.-----------------------------------------------------------------------------------------------------

GROUND-TRUTH ANNOTATIONS: "HEAD-LEVEL"

-----------------------------------------------------------------------------------------------------

1. Each ground-truth file in the "gt" directory contains "space" separated values with each row inidacting x,y,w,h,o,b 2. x,y indicate the head location.3. w,h indicate approximate width and height of the head.4. o indicates occlusion-level and it can take 3 possible values: 1,2,3. o=1 indicates "visible"o=2 indicates "partial-occlusion"o=3 indicates "full-occlusion"5. b indicates blur-level and it can take 2 possible values: 0,1. b=0 indicates no-blur b=1 indicates blur-----------------------------------------------------------------------------------------------------

GROUND-TRUTH ANNOTATIONS: "IMAGE-LEVEL"

-----------------------------------------------------------------------------------------------------

1. Each split in the dataset contains a file "image_labels.txt". This file contains image-level labels.2. The values in the file are comma separated and each row indicates: "filename, total-count, scene-type, weather-condition, distractor"3. total-count indicates the total number of people in the image4. scene-type is an image-level label describing the scene5. weather-condition indicates the weather-degradation in the image and can take 4 values: 0,1,2,3weather-condition=0 indicates "no weather degradation"weather-condition=1 indicates "fog/haze"weather-condition=2 indicates "rain"weather-condition=3 indicates "snow"6. distractor indicates if the image is a distractor. It can take 2 values: 0,1distractor=0 indicates "not a distractor"distractor=1 indicates "distractor"-----------------------------------------------------------------------------------------------------

CITATION

----------------------------------------------------------------------------------------------------- If you find this dataset useful, please consider citing the following work:@inproceedings{sindagi2019pushing,

title={Pushing the frontiers of unconstrained crowd counting: New dataset and benchmark method},

author={Sindagi, Vishwanath A and Yasarla, Rajeev and Patel, Vishal M},

booktitle={Proceedings of the IEEE International Conference on Computer Vision},

pages={1221--1231},

year={2019}

}@article{sindagi2020jhu-crowd,

title={JHU-CROWD++: Large-Scale Crowd Counting Dataset and A Benchmark Method},

author={Sindagi, Vishwanath A and Yasarla, Rajeev and Patel, Vishal M},

journal={Tech Report},

year={2020}

}-----------------------------------------------------------------------------------------------------

LICENSE

----------------------------------------------------------------------------------------------------- This dataset is for academic and non-commercial uses (such as academic research, teaching, scientific

publications, or personal experimentation). All images of the JHU-CROWD++ are obtained from the Internet

which are not property of VIU-Lab, The Johns Hopkins University (JHU). please contact us if you find

yourself or your personal belongings in the data, and we (VIU-Lab) will immediately remove the concernedimages from our servers. By downloading and/or using the dataset, you acknowledge that you have read, understand, and agree to be bound by the following terms and conditions.1. All images are obtained from the Internet. We are not responsible for the content/meaning of these images.

2. Specific care has been taken to reduce labeling errors. Nevertheless, we do not accept any responsibility for errors or omissions.

3. You agree not to reproduce, duplicate, copy, sell, trade, resell or exploit for any commercial purposes, any portion of the images and any portion of derived data.

4. You agree not to use the dataset or any derivative work for commercial purposes as, for example, licensing or selling the data, or using the data with a purpose to procure a commercial gain.

5. All rights not expressly granted to you are reserved by us (VIU-Lab, JHU).

6. You acknowledge that the dataset is a valuable scientific resource and agree to appropriately reference the following papers in any publication making use of the Data & Software:Sindagi et al., "Pushing the frontiers of unconstrained crowd counting: New dataset and benchmark method", ICCV 2019.Sindagi et al., "JHU-CROWD++: Large-Scale Crowd Counting Dataset and A Benchmark Method", Arxiv 2020.首先处理原始数据集如下:

处理完成结果如下:

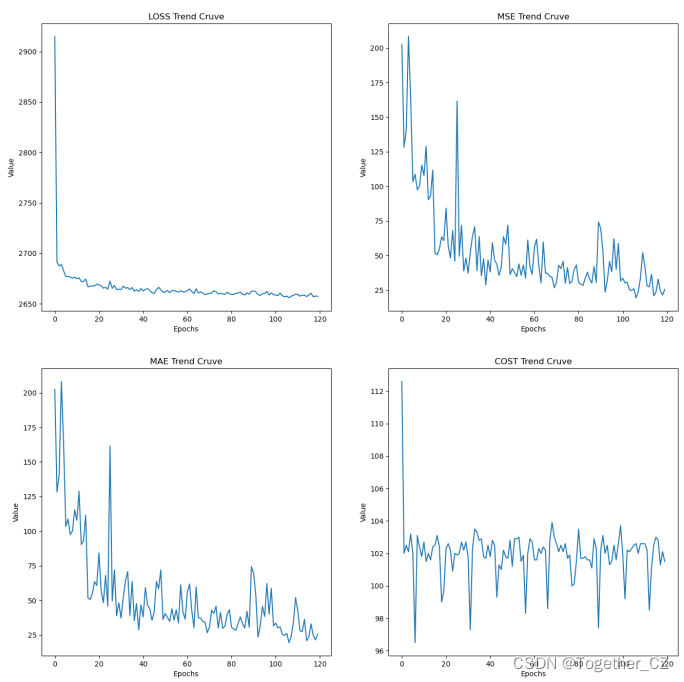

之后就可以启动模型训练了,因为没有开源出来可用的预训练权重,所以这里是只能自己训练,如下:

from utils.regression_trainer_cosine import RegTrainer

import argparse

import os

import torch

args = Nonedef parse_args():parser = argparse.ArgumentParser(description='Train ')parser.add_argument('--model-name', default='vgg19_trans', help='the name of the model')parser.add_argument('--data-dir', default='./JHU-Train-Val-Test',help='training data directory')parser.add_argument('--save-dir', default='./model',help='directory to save models.')parser.add_argument('--save-all', type=bool, default=False,help='whether to save all best model')parser.add_argument('--lr', type=float, default=5*1e-6,help='the initial learning rate')parser.add_argument('--weight-decay', type=float, default=1e-5,help='the weight decay')parser.add_argument('--resume', default='',help='the path of resume training model')parser.add_argument('--max-model-num', type=int, default=1,help='max models num to save ')parser.add_argument('--max-epoch', type=int, default=120,help='max training epoch')parser.add_argument('--val-epoch', type=int, default=5,help='the num of steps to log training information')parser.add_argument('--val-start', type=int, default=60,help='the epoch start to val')parser.add_argument('--batch-size', type=int, default=8,help='train batch size')parser.add_argument('--device', default='0', help='assign device')parser.add_argument('--num-workers', type=int, default=0,help='the num of training process')parser.add_argument('--is-gray', type=bool, default=False,help='whether the input image is gray')parser.add_argument('--crop-size', type=int, default=512,help='the crop size of the train image')parser.add_argument('--downsample-ratio', type=int, default=16,help='downsample ratio')parser.add_argument('--use-background', type=bool, default=True,help='whether to use background modelling')parser.add_argument('--sigma', type=float, default=8.0, help='sigma for likelihood')parser.add_argument('--background-ratio', type=float, default=0.15,help='background ratio')args = parser.parse_args()return argsif __name__ == '__main__':args = parse_args()torch.backends.cudnn.benchmark = Trueos.environ['CUDA_VISIBLE_DEVICES'] = args.device.strip() # set vis gputrainer = RegTrainer(args)trainer.setup()trainer.train()

训练时间还是很长的,这里等待训练结束后,结果文件如下所示:

日志输出如下所示:

02-14 12:25:04 using 1 gpus

02-14 12:25:10 -----Epoch 0/119-----

02-14 12:27:03 Epoch 0 Train, Loss: 2914.89, MSE: 202.49 MAE: 81.49, Cost 112.6 sec

02-14 12:27:03 -----Epoch 1/119-----

02-14 12:28:45 Epoch 1 Train, Loss: 2691.07, MSE: 128.28 MAE: 44.69, Cost 102.0 sec

02-14 12:28:46 -----Epoch 2/119-----

02-14 12:30:28 Epoch 2 Train, Loss: 2687.40, MSE: 140.69 MAE: 43.30, Cost 102.5 sec

02-14 12:30:29 -----Epoch 3/119-----

02-14 12:32:11 Epoch 3 Train, Loss: 2688.95, MSE: 208.25 MAE: 45.59, Cost 102.1 sec

02-14 12:32:12 -----Epoch 4/119-----

02-14 12:33:55 Epoch 4 Train, Loss: 2682.65, MSE: 163.37 MAE: 39.28, Cost 103.2 sec

02-14 12:33:55 -----Epoch 5/119-----

02-14 12:35:37 Epoch 5 Train, Loss: 2677.02, MSE: 103.38 MAE: 33.43, Cost 102.0 sec

02-14 12:35:38 -----Epoch 6/119-----

02-14 12:37:15 Epoch 6 Train, Loss: 2677.04, MSE: 108.78 MAE: 34.17, Cost 96.5 sec

02-14 12:37:15 -----Epoch 7/119-----

02-14 12:38:58 Epoch 7 Train, Loss: 2676.39, MSE: 97.53 MAE: 33.18, Cost 103.1 sec

02-14 12:38:59 -----Epoch 8/119-----

02-14 12:40:41 Epoch 8 Train, Loss: 2675.40, MSE: 100.08 MAE: 31.75, Cost 102.4 sec

02-14 12:40:42 -----Epoch 9/119-----

02-14 12:42:24 Epoch 9 Train, Loss: 2676.26, MSE: 115.38 MAE: 33.94, Cost 101.8 sec

02-14 12:42:24 -----Epoch 10/119-----

02-14 12:44:07 Epoch 10 Train, Loss: 2674.91, MSE: 107.85 MAE: 31.79, Cost 102.7 sec

02-14 12:44:08 -----Epoch 11/119-----

02-14 12:45:49 Epoch 11 Train, Loss: 2675.62, MSE: 128.87 MAE: 31.46, Cost 101.5 sec

02-14 12:45:50 -----Epoch 12/119-----

02-14 12:47:32 Epoch 12 Train, Loss: 2672.00, MSE: 90.30 MAE: 27.87, Cost 102.0 sec

02-14 12:47:32 -----Epoch 13/119-----

02-14 12:49:14 Epoch 13 Train, Loss: 2671.85, MSE: 93.11 MAE: 28.77, Cost 101.6 sec

02-14 12:49:14 -----Epoch 14/119-----

02-14 12:50:57 Epoch 14 Train, Loss: 2674.60, MSE: 111.70 MAE: 31.27, Cost 102.4 sec为了直观可视化分析,这里我对其结果日志进行可视化展示如下所示:

直观来看整体训练还不错。

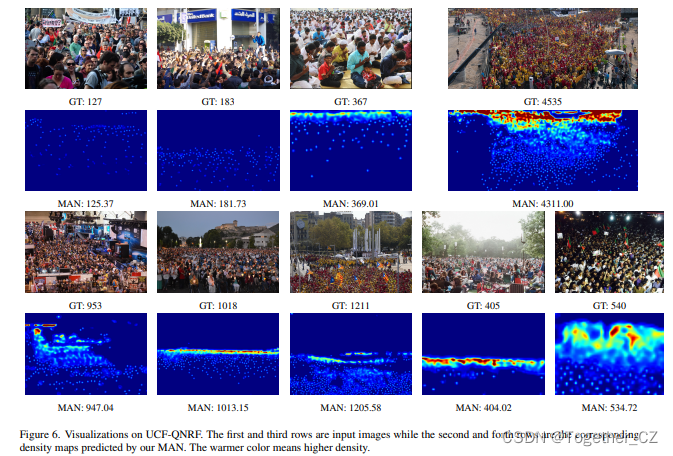

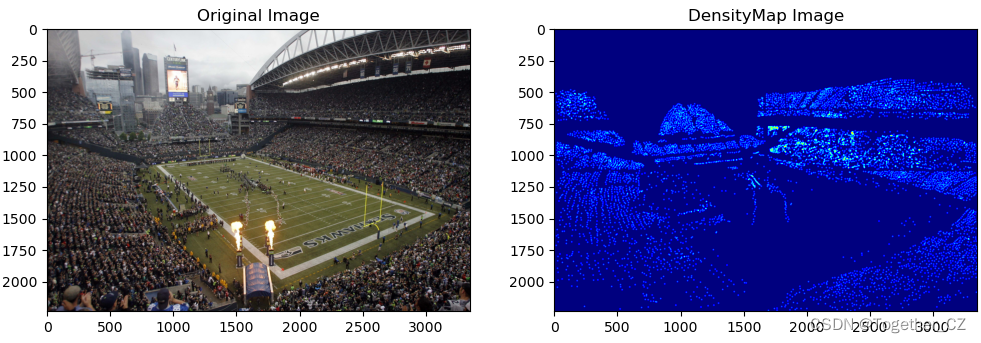

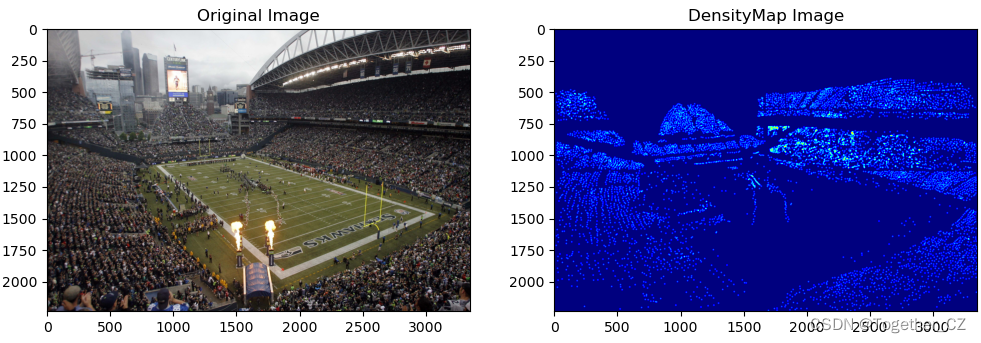

接下来绘制密度热力图如下:

相关文章:

Boosting Crowd Counting via Multifaceted Attention之人群密度估计实践

这周闲来无事,看到一篇前不久刚发表的文章,是做密集人群密度估计的,这块我之前虽然也做过,但是主要是基于检测的方式实现的,这里提出来的方法还是比较有意思的,就拿来实践一下。论文在这里,感兴…...

python之面向对象编程

1、面向对象介绍: 世界万物,皆可分类 世界万物,皆为对象 只要是对象,就肯定属于某种类 只要是对象,就肯定有属性 2、 面向对象的几个特性: class类: 一个类即对一类拥有相同属性的对象的…...

(七))

常见前端基础面试题(HTML,CSS,JS)(七)

同源策略 浏览器有一个重要的安全策略,称之为同源策略 其中,协议、端口号、域名必须一致,,称之为同源,两个源不同,称之为跨源或跨域 同源策略是指,若页面的源和页面运行过程中加载的源不一致…...

产业链金风控基本逻辑

产业链金风控基本逻辑 产业链金融平台作为一个助贷平台,很大程度上是为银行等金融机构进 行引流,贷款的审批本质上还是依赖金融机构的风控。那么,产业链金融 平台是否还有必要建设自己的风控模型呢?笔者给出的答案是肯定的。 一方面&#x…...

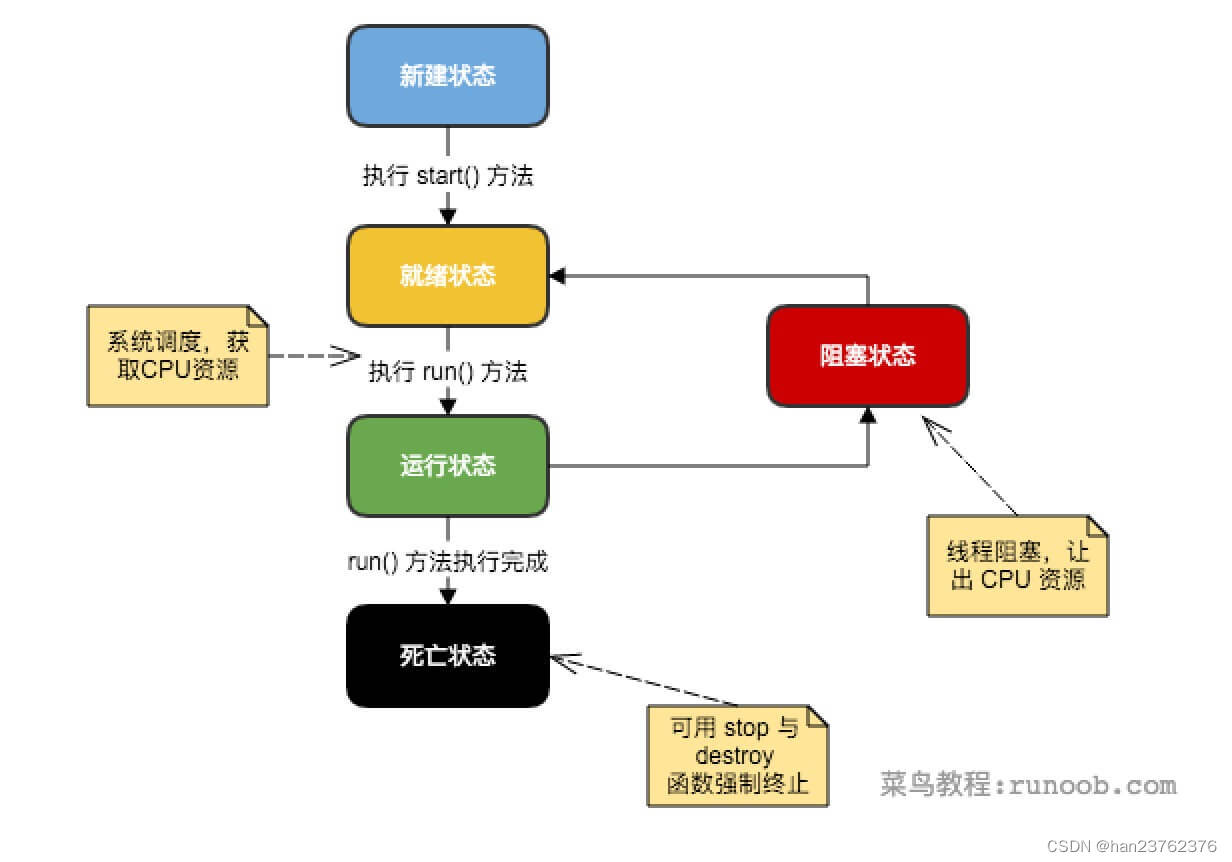

Java高级点的知识

Java 集合框架 该框架必须是高性能的。基本集合(动态数组,链表,树,哈希表)的实现也必须是高效的。 该框架允许不同类型的集合,以类似的方式工作,具有高度的互操作性。 对一个集合的扩展和适应…...

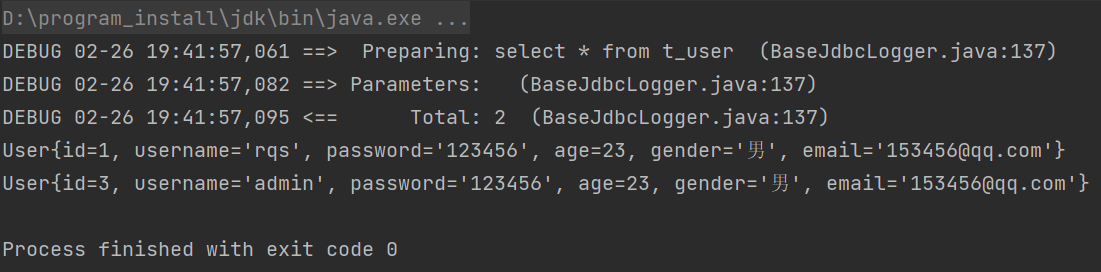

MyBatis - 05 - 封装SqlSessionUtil工具类(用于获取SqlSession对象)并测试功能

文章目录1.新建SqlSessionUtils工具类2.编写静态方法3.项目结构及代码项目结构数据库和表pom.xmlParameterMapper接口:User类:ParameterMapper.xmljdbc.propertieslog4j.xml:mybatis-config.xml:ParameterMapperTest测试类:测试结果1.新建Sql…...

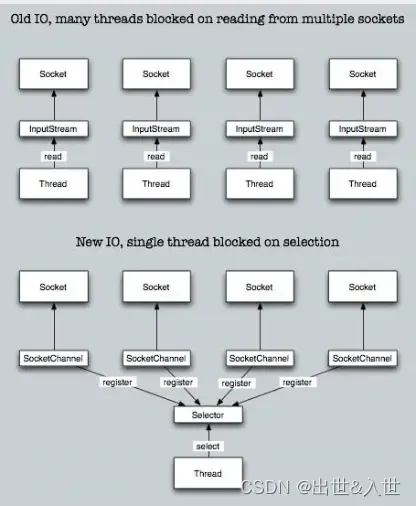

Java中BIO、NIO和AIO的区别和应用场景

IO的方式通常分为几种,同步阻塞的BIO、同步非阻塞的NIO、异步非阻塞的AIO。 一、BIO 在JDK1.4出来之前,我们建立网络连接的时候采用BIO模式,需要先在服务端启动一个ServerSocket,然后在客户端启动Socket来对服务端进行通信&#…...

Python安装教程(附带安装包)

首先,打开python安装包的下载地址,https://www.python.org/downloads/,会有些慢 点击downloads中的windows 左侧是稳定的版本,我这边下的是3.8的,不想去官网下载的可以直接用我下载的这个3.8版本,https://…...

华为OD机试用Python实现 -【信号发射和接收】(2023-Q1 新题)

华为OD机试题 华为OD机试300题大纲信号发射和接收题目描述输入描述输出描述说明示例一输入输出说明示例二输入输出说明Python 代码实现代码运行结果代码编写思路华为OD机试300题大纲 参加华为od机试,一定要注意不要完全背诵代码,需要理解之后模仿写出,通过率才会高。 华为…...

Springboot整合 Thymeleaf增删改查一篇就够了

很早之前写过Thymeleaf的文章,所以重新温习一下,非前后端分离,仅仅只是学习 官网: https://www.thymeleaf.org/ SpringBoot可以快速生成Spring应用,简化配置,自动装配,开箱即用。 JavaConfigur…...

BigScience bloom模型

简介项目叫 BigScience,模型叫 BLOOM,BLOOM 的英文全名代表着大科学、大型、开放科学、开源的多语言语言模型。拥有 1760 亿个参数的模型.BLOOM 是去年由 1000 多名志愿研究人员,学者 在一个名为“大科学 BigScience”的项目中创建的.BLOOM 和今天其他可用大型语言模型存在的一…...

Squid服务的缓存概念

Squid缓存概念 squid是一个缓存服务器的守护进程 之前涉及的缓存服务:redis 2-8原则:80%的访问就是从20%的数据提供的;因此把20%的数据给到缓存–>完美解决等待时间; nginx是没有缓存的服务的;那么专业的事情就…...

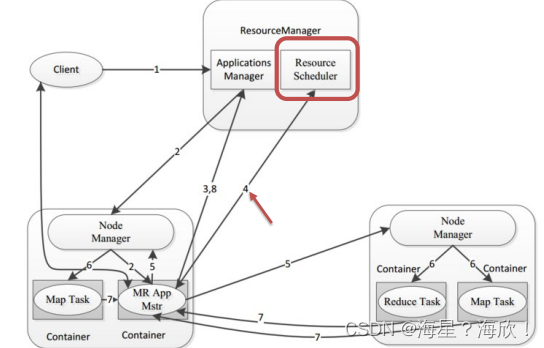

Hadoop YARN

目录Hadoop YARN介绍Hadoop YARN架构、组件程序提交YARN交互流程YARN资源调度器Scheduler调度器策略FIFO SchedulerCapacity SchedulerFair SchedulerHadoop YARN介绍 YARN是一个通用资源管理系统和调度平台,可为上层应用提供统一的资源管理和调度 上图࿱…...

使用 Macrobenchmark 测试 Android 应用性能

etpack Compose 是推荐用于构建原生 Android 界面的新工具包。后续简称Jetpack Compose为Compose。在了解State之前需要先对Compose及申明性编程式有个大概的了解。State初体验好了,在你有一定了解的基础上,我们先来运行几个Demo,初步了解为何…...

【django】django-simpleui配置后,后台显示空白页解决方法

every blog every motto: You can do more than you think. https://blog.csdn.net/weixin_39190382?typeblog 0. 前言 django后台显示空白页解决方法 1. 正文 添加完simpleui以后,后台显示一片空白,一脸问号??? …...

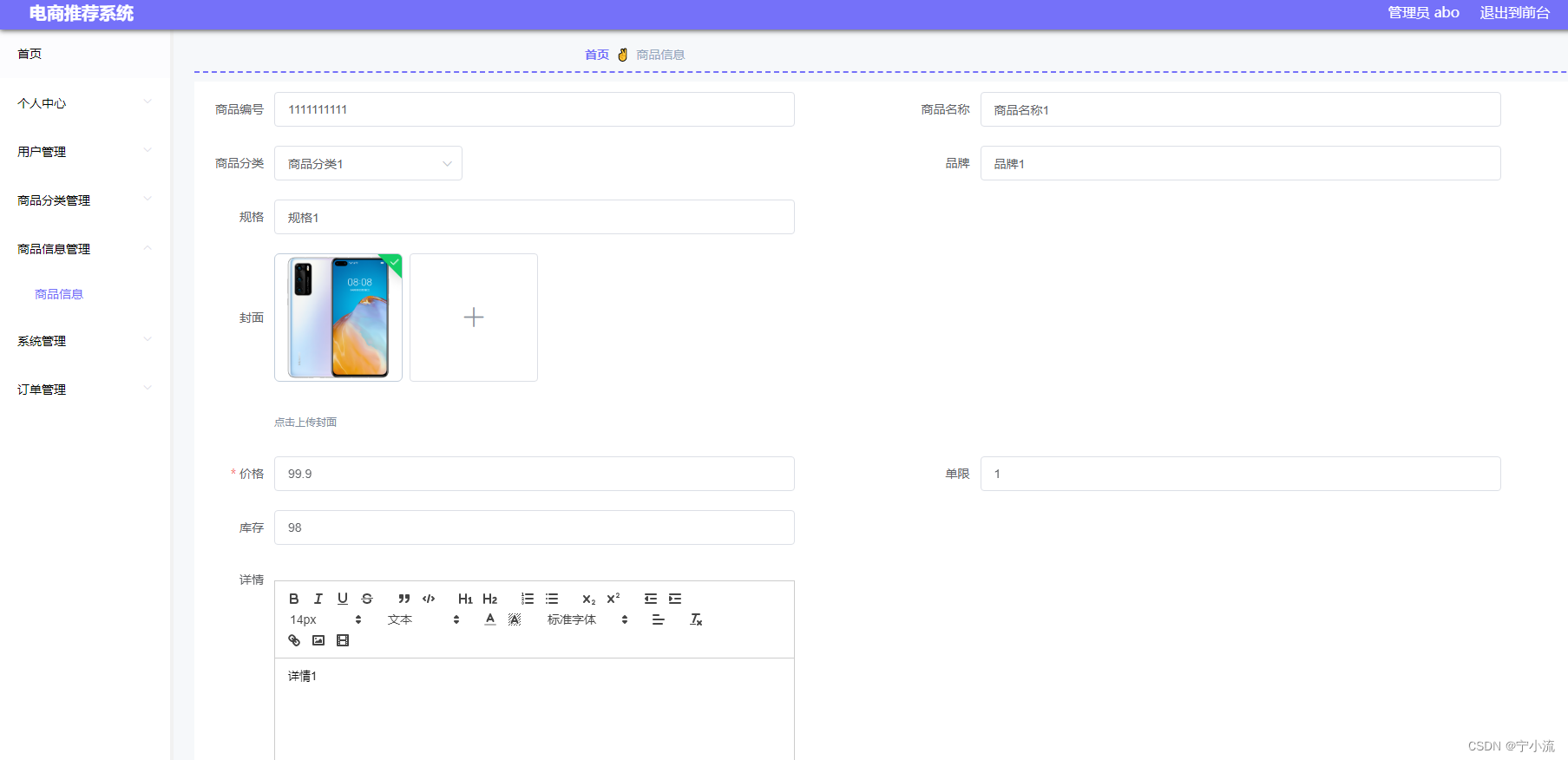

【035】基于Vue的电商推荐管理系统(含源码数据库、超详细论文)

摘 要:基于Vue+Nodejs+mysql的电商推荐管理系统,这个项目论文超详细,er图、接口文档、功能展示、技术栈等说明特别全!!! (文末附源码数据库、课设论文获取方式࿰…...

【c++】模板1—函数模板

文章目录函数模板语法函数模板注意事项案例—数组选择排序普通函数和函数模板的区别普通函数和函数模板调用规则模板的局限性函数模板语法 函数模板作用: 建立一个通用函数,其函数返回值类型和形参类型可以不具体制定,用一个虚拟的类型来代表…...

windows10 wsl子系统固定ip启动分配网卡法

WSL设置添加固定IP 在Win端添加一个固定IP 192.168.50.99 用于X-Server界面显示.在WSL端添加一个固定IP 192.168.50.16 用于和Win端通讯 在win端创建批处理文件 创建一个批处理文件 我的文件位置是D:\powershell\static_ip.bat 向vEthernet (WSL)网卡添加一个IP 192.168.50.…...

ARM+Linux日常开发笔记

ARMLinux开发命令 文章目录ARMLinux开发命令一、虚拟机1.ssh服务项目2.文件相关3.系统相关4. 虚拟机清理内存二、ARM核板1.设备重启三、调试1. 应该调试一、虚拟机 1.ssh服务项目 启动ssh服务 sudo /etc/init.d/ssh restart2.文件相关 查看文件大小显示kb ll -h 查看目录文件…...

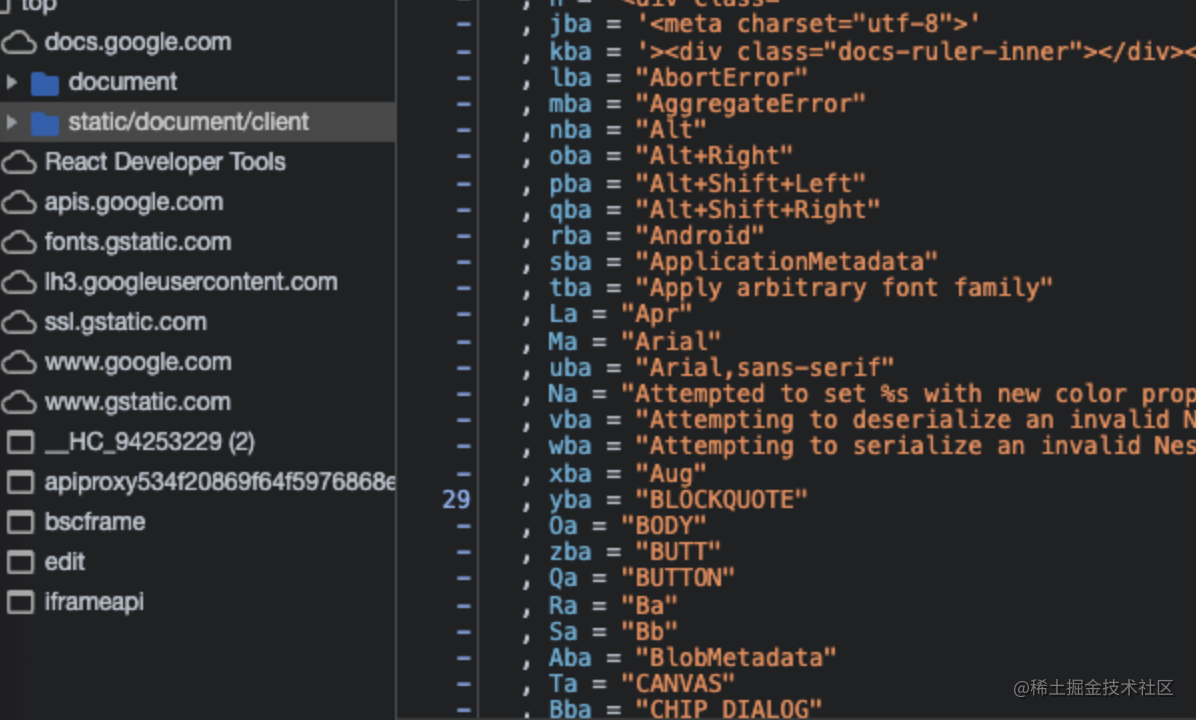

在线文档技术-编辑器篇

这是在线文档技术的第二篇文章,本文将对目前市面上所有的主流编辑器和在线文档进行一次深入的剖析和研究,从而使大家对在线文档技术有更深入的了解,也让更多人能够参与其开发与设计中来。 注意:出于对主流文档产品的尊重…...

阿里小云KWS模型端到端延迟优化:从音频采集到唤醒响应

阿里小云KWS模型端到端延迟优化:从音频采集到唤醒响应 1. 引言 语音唤醒技术如今已经深入到我们生活的方方面面,从智能音箱到车载系统,从手机助手到智能家居。但你是否曾经遇到过这样的场景:对着设备喊了好几声"小云小云&q…...

QWEN-AUDIOAIGC闭环:与Qwen3-Text/Qwen3-VL联动构建语音内容工厂

QWEN-AUDIO AIGC闭环:与Qwen3-Text/Qwen3-VL联动构建语音内容工厂 1. 语音内容创作的新时代 你有没有遇到过这样的场景:需要为视频配音但找不到合适的声音,或者想要制作有声内容却苦于没有专业的录音设备?现在,这些问…...

)

Matlab实战:牛顿下山法解非线性方程,初值选择不再头疼(附完整代码)

Matlab实战:牛顿下山法解非线性方程,初值选择不再头疼(附完整代码) 在工程计算和科研领域,非线性方程求解是一个绕不开的经典问题。无论是物理建模中的参数优化,还是控制系统设计中的稳定性分析,…...

软考高项英文题别怕!5分钟掌握这3个拆句技巧,5分稳稳到手

软考高项英文题拆解实战:3个结构化技巧让长难句秒变送分题 面对软考高项试卷上那些蜿蜒曲折的英文长句,很多考生第一反应是头皮发麻。但你可能没发现,这些看似复杂的句子本质上就像乐高积木——只要找到拼接规律,再长的句子也能拆…...

ANIMATEDIFF PRO性能实测:RTX 3060也能跑?显存不足应急方案

ANIMATEDIFF PRO性能实测:RTX 3060也能跑?显存不足应急方案 1. 当电影级渲染遇到入门级显卡 最近在星图GPU平台上折腾ANIMATEDIFF PRO,说实话,一开始我是抱着“试试看”的心态。毕竟官方推荐配置写着“RTX 4090最佳”࿰…...

Ubuntu 20.04上构建Zabbix 6.0监控平台:从部署到微信告警的完整实践

1. 环境准备与基础配置 在Ubuntu 20.04上部署Zabbix 6.0监控平台前,需要确保系统环境满足基本要求。我建议使用至少4核CPU、8GB内存的服务器,实测下来这个配置可以稳定监控50台以上的主机。操作系统建议选择Ubuntu 20.04 LTS版本,长期支持周期…...

)

Trae使用第三方Key进行AI编程(Claude、Deepseek)

原因 Trae IDE 比 VSCode 好用,顺手,官方比较贵,改第三方Key会便宜很多。 获取Key ▌ 中转平台 X API 旧平台:https://api.xlap.top ,停用 创建令牌 ▌ 基础配置 › 令牌名称:自定义名称(…...

Gemma-3-12B-IT参数详解:Temperature与TopP协同调节创造可控随机性

Gemma-3-12B-IT参数详解:Temperature与TopP协同调节创造可控随机性 1. 引言:为什么我们需要“可控”的随机性? 如果你用过像Gemma-3-12B-IT这样的大语言模型,可能会发现一个有趣的现象:有时候它回答得特别严谨&#…...

个人博客自动化:OpenClaw+Qwen3-32B从草稿到发布的完整流程

个人博客自动化:OpenClawQwen3-32B从草稿到发布的完整流程 1. 为什么需要自动化写作工作流 作为一个技术博主,我经常面临这样的困境:灵感来临时能快速产出内容,但后续的排版、配图、发布等琐碎流程却消耗了大量时间。直到发现Op…...

影墨·今颜GPU算力成本分析:A10单卡月均¥800 vs API调用年省¥12万

影墨今颜GPU算力成本分析:A10单卡月均¥800 vs API调用年省¥12万 在AI影像创作领域,追求极致画质与真实感已成为核心趋势。然而,对于个人创作者、小型工作室乃至企业而言,部署和运行一个像「影墨今颜」这样…...