hadoop 常用命令

hadoop 常用命令

hadoop fs -mkdir /test

hadoop fs -put /opt/frank/tb_test03.txt /test/

hadoop fs -ls /test/

hadoop fs -cat /test/tb_test03.txt

hadoop fs -rm /test/tb_test03.txt

hadoop dfs 也能使用、但不推荐,执行会提示:

DEPRECATED: Use of this script to execute hdfs command is deprecated.

Instead use the hdfs command for it.

常看hdfs系统使用情况

hadoop fs -du -s -h /

Hive LOAD 语法

LOAD DATA [ LOCAL ] INPATH {file_path} [ OVERWRITE ] INTO TABLE { table_name } [ PARTITION(partition_colname1="val1", partition_colname2="val2",)... ];

LOAD 示例:

-- 从本地OS系统目录加载文件到Hive表

LOAD DATA LOCAL INPATH '/opt/frank/tb_test03.txt' INTO TABLE tb_test03;

LOAD DATA LOCAL INPATH '/opt/frank/tb_test03.txt' OVERWRITE INTO TABLE tb_test03;

LOAD DATA LOCAL INPATH '/opt/frank/tb_test04_pt.txt' OVERWRITE INTO TABLE tb_test04_pt PARTITION(pt="20240101");

-- 从HDFS系统目录加载文件到Hive表

hadoop fs -put /opt/frank/tb_test03.txt /test/

LOAD DATA INPATH '/test/tb_test03.txt' INTO TABLE tb_test03;

slave 节点查看 datanode 服务状态:

$ jps -v |grep DataNode

$ hadoop dfsadmin -report

slave 节点重启(停止、启动) datanode 服务:

$ ./sbin/hadoop-daemon.sh stop datanode

$ ./sbin/hadoop-daemon.sh start datanode

查看 HDFS 文件中系统的DFS使用情况:

$ hadoop fs -du -s -h /

垃圾清理(多次执行):

$ hadoop fs -expunge

datanode 使用率占满&配置容量显示为0的问题【DFS Used%: 100.00% & Configured Capacity: 0 (0 B)】

$ hadoop dfsadmin -report

查看到使用率占满,显示:

DEPRECATED: Use of this script to execute hdfs command is deprecated.

Instead use the hdfs command for it.

Configured Capacity: 0 (0 B)

Present Capacity: 0 (0 B)

DFS Remaining: 0 (0 B)

DFS Used: 0 (0 B)

DFS Used%: NaN%

Under replicated blocks: 76125

Blocks with corrupt replicas: 0

Missing blocks: 76125

Missing blocks (with replication factor 1): 21993

-------------------------------------------------

Live datanodes (1):

Name: 192.168.1.188:50010 (hadoop01)

Hostname: hadoop01

Decommission Status : Normal

Configured Capacity: 0 (0 B)

DFS Used: 0 (0 B)

Non DFS Used: 0 (0 B)

DFS Remaining: 0 (0 B)

DFS Used%: 100.00%

DFS Remaining%: 0.00%

Configured Cache Capacity: 0 (0 B)

Cache Used: 0 (0 B)

Cache Remaining: 0 (0 B)

Cache Used%: 100.00%

Cache Remaining%: 0.00%

Xceivers: 0

Last contact: Mon Mar 25 17:02:43 CST 2024

配置容量显示为0了:

Configured Capacity: 0 (0 B)

尝试多种方法、最终原因是 slave 中配置的 datanode 节点 hostname 配置成了 localhost 而导致的问题。

vi salve 把配置的 datanode 主机名配置为 hadoop01 后,重启 datanode 服务,问题就解决了。

$ ./sbin/hadoop-daemon.sh stop datanode

$ ./sbin/hadoop-daemon.sh start datanode

$ hadoop dfsadmin -report

DEPRECATED: Use of this script to execute hdfs command is deprecated.

Instead use the hdfs command for it.

Configured Capacity: 98337751040 (91.58 GB)

Present Capacity: 65340043264 (60.85 GB)

DFS Remaining: 61911707648 (57.66 GB)

DFS Used: 3428335616 (3.19 GB)

DFS Used%: 5.25%

Under replicated blocks: 73720

Blocks with corrupt replicas: 0

Missing blocks: 82

Missing blocks (with replication factor 1): 21993

-------------------------------------------------

Live datanodes (1):

Name: 192.168.1.188:50010 (hadoop01)

Hostname: hadoop01

Decommission Status : Normal

Configured Capacity: 98337751040 (91.58 GB)

DFS Used: 3428335616 (3.19 GB)

Non DFS Used: 32997707776 (30.73 GB)

DFS Remaining: 61911707648 (57.66 GB)

DFS Used%: 3.49%

DFS Remaining%: 62.96%

Configured Cache Capacity: 0 (0 B)

Cache Used: 0 (0 B)

Cache Remaining: 0 (0 B)

Cache Used%: 100.00%

Cache Remaining%: 0.00%

Xceivers: 1

Last contact: Mon Mar 25 17:27:05 CST 2024

Hive建表和LOAD数据:

-- 普通表(TextFile存储格式)

drop table if exists testdb.tb_test03;

create table testdb.tb_test03 (

id int,

info string,

cnt bigint)

-- partitioned by (pt_sheng string)

ROW FORMAT DELIMITED FIELDS TERMINATED BY ',' LINES TERMINATED BY '\n'

STORED AS TextFile

-- STORED AS INPUTFORMAT

-- 'org.apache.hadoop.mapred.TextInputFormat'

-- OUTPUTFORMAT

-- 'org.apache.hadoop.hive.ql.io.HiveIgnoreKeyTextOutputFormat'

LOCATION 'hdfs://192.168.1.188:9000/user/hive/warehouse/testdb.db/tb_test03'

;

-- hadoop fs -ls /user/hive/warehouse/testdb.db/tb_test03.txt

show tables;

show create table testdb.tb_test03;

select * from testdb.tb_test03;

-- 方法1:

$ echo '1,jack,95

2,frank,96

3,lucy,97

4,hack,99' > /opt/frank/tb_test03.txt

-- hiveSQL: load from Local OS dir

LOAD DATA LOCAL INPATH '/opt/frank/tb_test03.txt' OVERWRITE INTO TABLE tb_test03;

-- 方法2:

-- shell_cmd: 先拷贝到 hdfs, 再从 hdfs 路径 load

-- $ hadoop fs -rm /frank/tb_test03.txt

-- $ hadoop fs -put /opt/frank/tb_test03.txt /frank/

-- $ hadoop fs -cat /frank/tb_test03.txt

-- -- hiveSQL: load from HDFS FileSystem dir

-- LOAD DATA INPATH '/frank/tb_test03.txt' OVERWRITE INTO TABLE tb_test03;

select * from tb_test03;

-- load后会在配置文件决定的固定目录下产生一个表名对应的目录,目录下为对应的数据文件

$ hadoop fs -ls /user/hive/warehouse/testdb.db/tb_test03/

drop table if exists testdb.tb_test03;

create table testdb.tb_test03 (

id int,

info string,

cnt bigint)

-- partitioned by (pt_sheng string)

ROW FORMAT DELIMITED FIELDS TERMINATED BY ',' LINES TERMINATED BY '\n'

-- STORED AS TextFile

STORED AS TextFile

'org.apache.hadoop.mapred.TextInputFormat'

OUTPUTFORMAT

'org.apache.hadoop.hive.ql.io.HiveIgnoreKeyTextOutputFormat'

LOCATION 'hdfs://192.168.1.188:9000/user/hive/warehouse/testdb.db/tb_test03'

;

show tables;

show create table testdb.tb_test03;

select * from testdb.tb_test03;

-- 分区表(TextFile存储格式)

drop table if exists testdb.tb_test04_pt;

create table testdb.tb_test04_pt (

id int,

info string,

cnt bigint)

PARTITIONED BY (pt string)

ROW FORMAT DELIMITED FIELDS TERMINATED BY ',' LINES TERMINATED BY '\n'

STORED AS TextFile

LOCATION 'hdfs://192.168.1.188:9000/user/hive/warehouse/testdb.db/tb_test04_pt'

;

show tables;

show create table testdb.tb_test04_pt;

select * from testdb.tb_test04_pt;

echo '1,jack,95

2,frank,96

3,lucy,97

4,hack,99' > /opt/frank/tb_test04_pt.txt

LOAD DATA LOCAL INPATH '/opt/frank/tb_test04_pt.txt' OVERWRITE INTO TABLE tb_test04_pt PARTITION(pt="20240101");

如果创建 PARQUET 存储格式的表则指定 STORED AS PARQUET

相关文章:

hadoop 常用命令

hadoop 常用命令 hadoop fs -mkdir /test hadoop fs -put /opt/frank/tb_test03.txt /test/ hadoop fs -ls /test/ hadoop fs -cat /test/tb_test03.txt hadoop fs -rm /test/tb_test03.txt hadoop dfs 也能使用、但不推荐,执行会提示: DEPRECATED: Us…...

pdf在浏览器上无法正常加载的问题

一、背景 觉得很有意思给大家分享一下。事情是这样的,开发给我反馈说,线上环境接口请求展示pdf异常,此时碰巧我前不久正好在ingress前加了一层nginx,恰逢此时内心五谷杂陈,思路第一时间便放在了改动项。捣鼓了好久无果…...

实时语音识别(Python+HTML实战)

项目下载地址:FunASR 1 安装库文件 项目提示所需要下载的库文件:pip install -U funasr 和 pip install modelscope 运行过程中,我发现还需要下载以下库文件才能正常运行: 下载:pip install websockets,pi…...

x86_64 ubuntu22.04编译MetaRTC

metaRTC5.0 API https://github.com/metartc/metaRTC/wiki/metaRTC5.0-API Sample https://github.com/metartc/metaRTC/wiki/metaRTC5.0-API-Sample MetaRTC7.0编译 https://github.com/metartc/metaRTC/wiki/Here-we-come,-write-a-C-version-of-webRTC-that-runs-everywhere…...

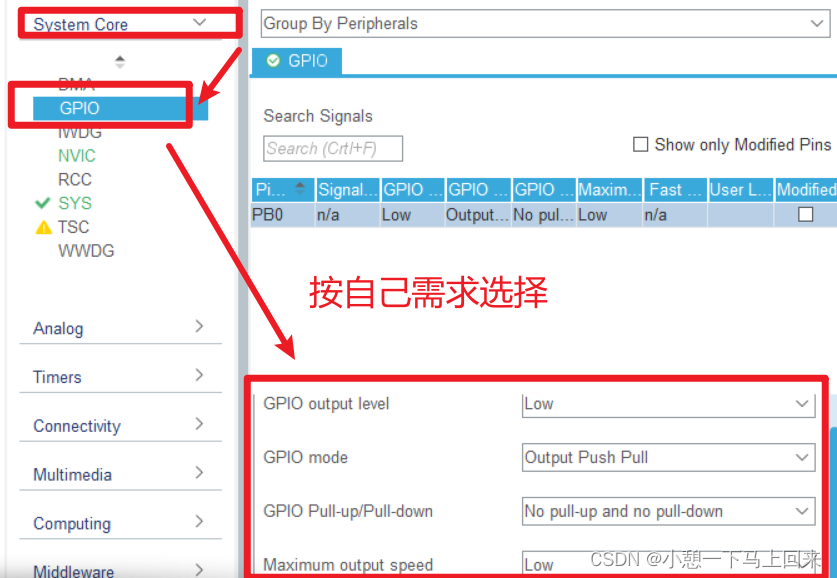

FreeRTOS day1

1.总结keil5下载代码和编译代码需要注意的事项 需要与板子连通 配置完成后才点击下载 2.总结STM32Cubemx的使用方法和需要注意的事项 下载支持包 打开芯片配置界面 3.总结STM32Cubemx配置GPIO的方法...

SqlSugar快速入门

文章目录 配置SqlSugar0、引入SqlSugarCore包1、编写Context类2、配置实体类3、创建Service服务类进行数据库的CRUD4、配置Controller进行路由 配置SqlSugar 0、引入SqlSugarCore包 1、编写Context类 public static SqlSugarClient db new SqlSugarClient(new ConnectionCon…...

基于el-table实现行内增删改

实现效果: 核心代码: <el-table :data"items"style"width: 100%;margin-top: 16px"border:key"randomKey"><el-table-column label"计划名称"property"name"><template slot-scope&q…...

《霍格沃茨之遗》推荐购买吗 《霍格沃茨之遗》不支持Mac电脑怎么办 crossover24软件值得买吗 crossover中文官网

《霍格沃茨之遗》作为一款期待已久的游戏,自发布以来就吸引了无数玩家的目光。它以哈利波特系列为背景,提供了一个沉浸式的魔法世界体验,让玩家能够探索广阔的霍格沃茨魔法学校,体验魔法学习与战斗,解开古老谜团的乐趣…...

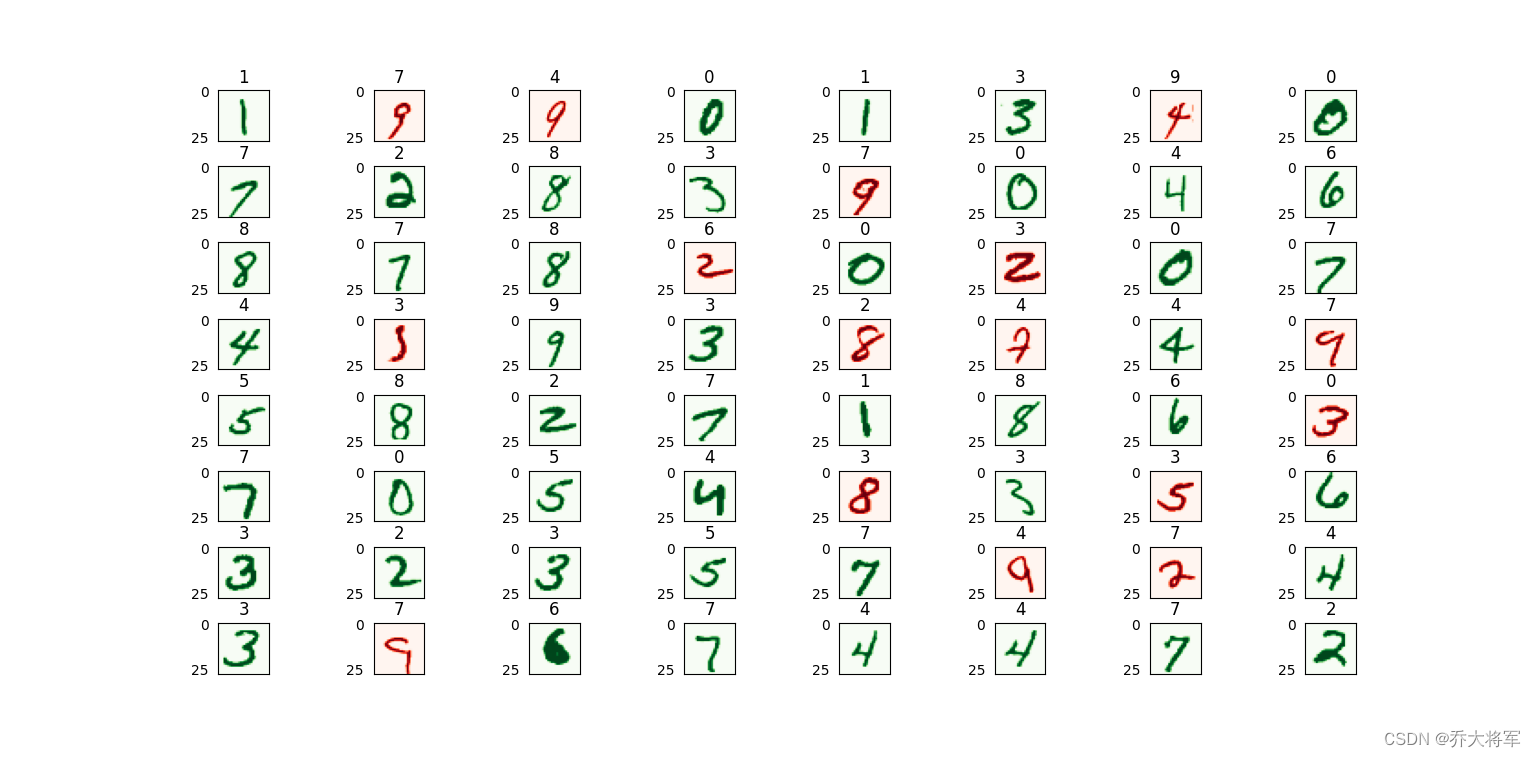

神经网络代码实现(用手写数字识别数据集实验)

目录 一、前言 二、神经网络架构 三、算法实现 1、导入包 2、实现类 3、训练函数 4、权重参数矩阵初始化 5、参数矩阵变换向量 6、向量变换权重参数矩阵 7、进行梯度下降 7.1、损失函数 7.1.1、前向传播 7.2、反向传播 8、预测函数 四、完整代码 五、手写数字识别 一、前言 …...

菜鸟笔记-Python函数-linspace

linspace 是 NumPy 库中的一个函数,用于生成具有指定数量的等间距样本的数组。它的名字来源于“linear space”(线性空间),因为它在指定的范围内均匀地生成数值。 linspace 函数的基本语法如下: numpy.linspace(star…...

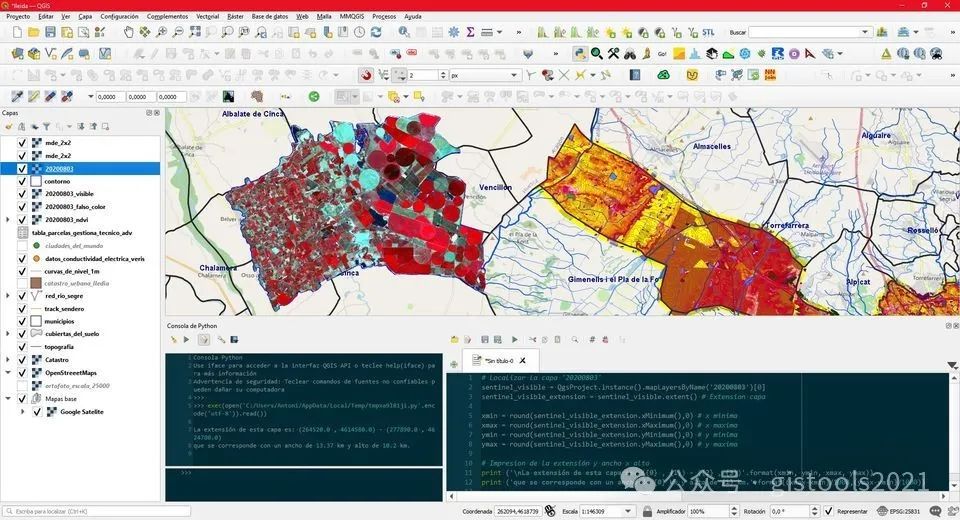

为什么我们应该使用QGIS

QGIS地理信息系统是免费的开源软件,已成为创建地图和分析空间数据的强大工具。在本文中,我们将探讨 QGIS 为地图公司带来的诸多好处,以及为什么使用它可以促进您的业务成功。使用QGIS的好处: 1. 免费开源软件,但从长远…...

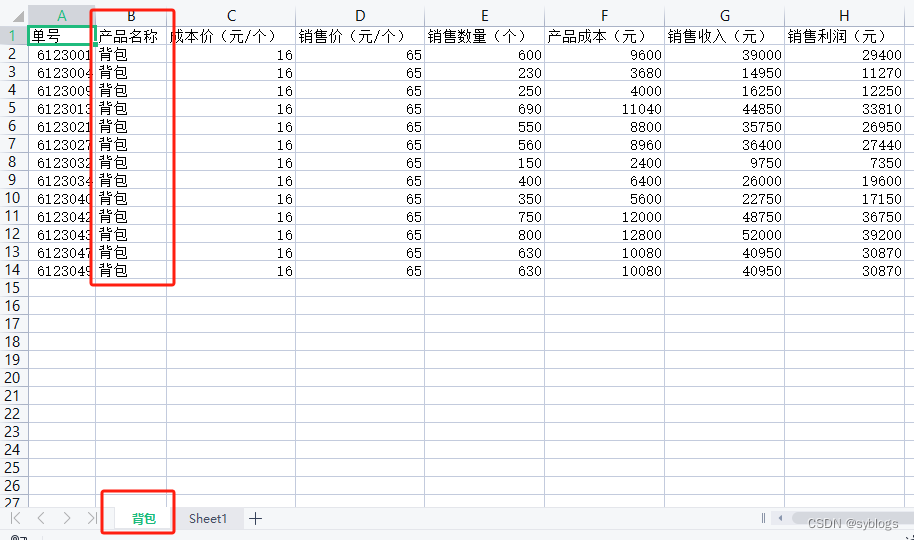

用Python实现办公自动化(自动化处理Excel工作簿)

自动化处理Excel工作簿 (一)批量生产产品出货清单 以“出货统计表”为例, 需求:将出货记录按照出货日期分类整理成多张出货清单 “出货统计表数据案例” “产品出货清单模板” 1.提取出货统计表的数据 “Python程序代码” # 使用…...

BaseDao入门使用

目录 一、什么是BaseDao?BaseDao的优点:BaseDao用来做什么操作? 二、BaseDao封装增删改查 案例演示:1、java与数据库进行连接2、连接后可对其进行操作(增、删、改)返回影响行数3、查询 查询一个字段(返回一…...

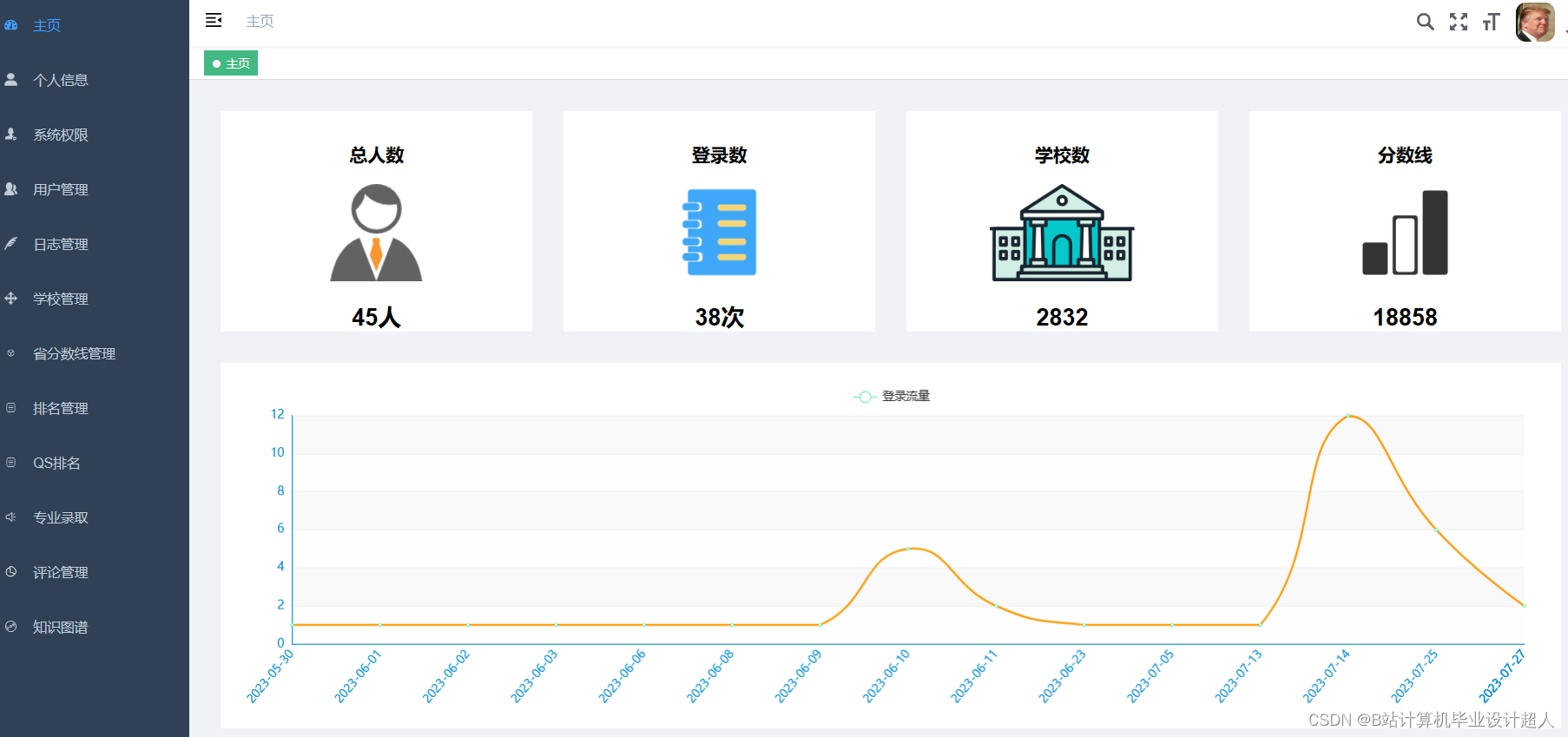

计算机毕业设计Python+Spark知识图谱高考志愿推荐系统 高考数据分析 高考可视化 高考大数据 大数据毕业设计 机器学习 深度学习 人工智能

学院(全称): 专业(全称): 姓名 学号 年级 班级 设计(论文) 题目 基于Spark的高考志愿推荐系统设计与实现 指导教师姓名 职称 拟…...

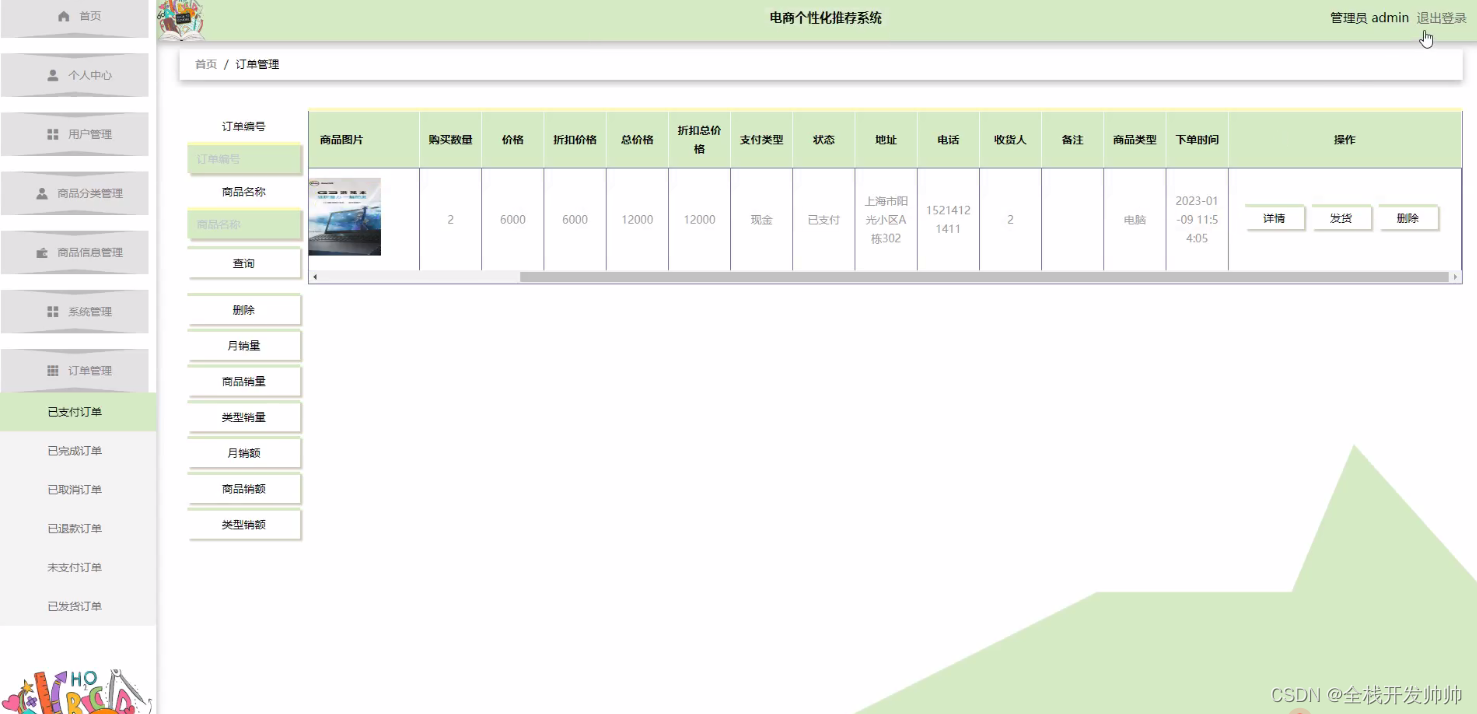

基于java+springboot+vue实现的电商个性化推荐系统(文末源码+Lw+ppt)23-389

摘 要 伴随着我国社会的发展,人民生活质量日益提高。于是对电商个性化推荐进行规范而严格是十分有必要的,所以许许多多的信息管理系统应运而生。此时单靠人力应对这些事务就显得有些力不从心了。所以本论文将设计一套电商个性化推荐系统,帮…...

(1))

论文阅读,The Lattice Boltzmann Method: Principles and Practice(六)(1)

目录 一、流体模拟方法概述 二、传统的Navier-Stokes求解器 2.1 有限差分 2.2 有限体积法 2.3 有限元法 三、基于粒子的求解器 3.1 动力学理论 3.2 分子动力学 3.3 格子气体模型 3.4 耗散粒子动力学 3.5 多粒子碰撞动力学 3.6 直接模拟蒙特卡罗方法 3.7 平滑粒子流…...

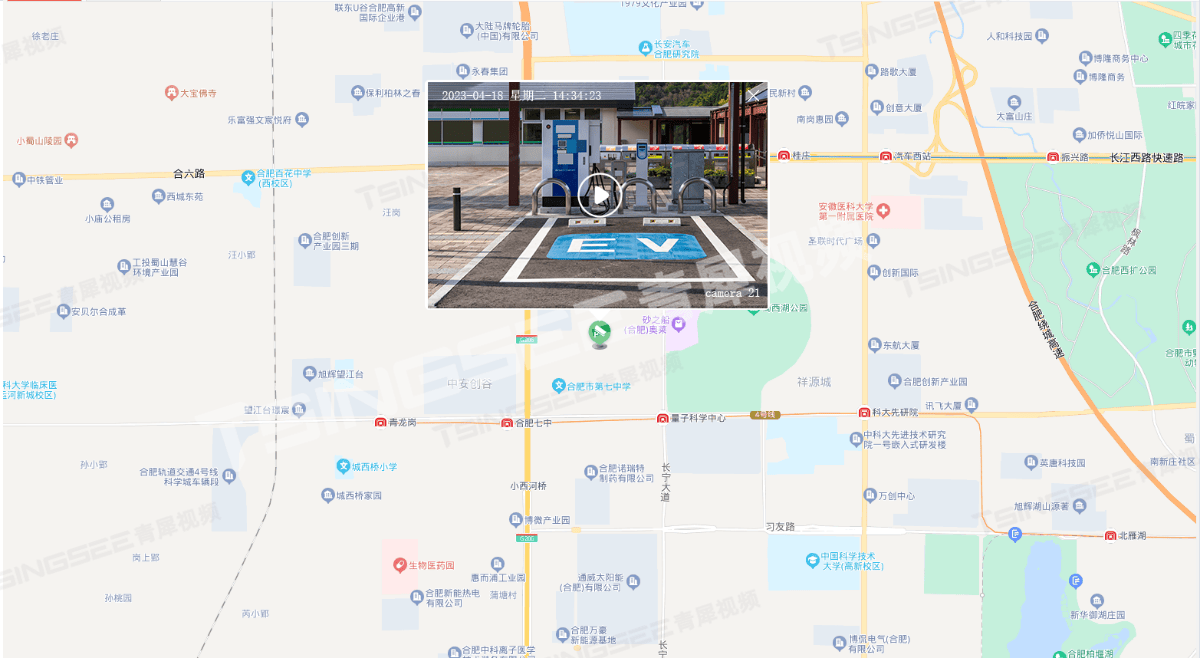

新能源充电桩站场视频汇聚系统建设方案及技术特点分析

随着新能源汽车的普及,充电桩作为新能源汽车的基础设施,其安全性和可靠性越来越受到人们的关注。为了更好地保障充电桩的安全运行与站场管理,TSINGSEE青犀&触角云推出了一套新能源汽车充电桩视频汇聚管理与视频监控方案。 方案采用高清摄…...

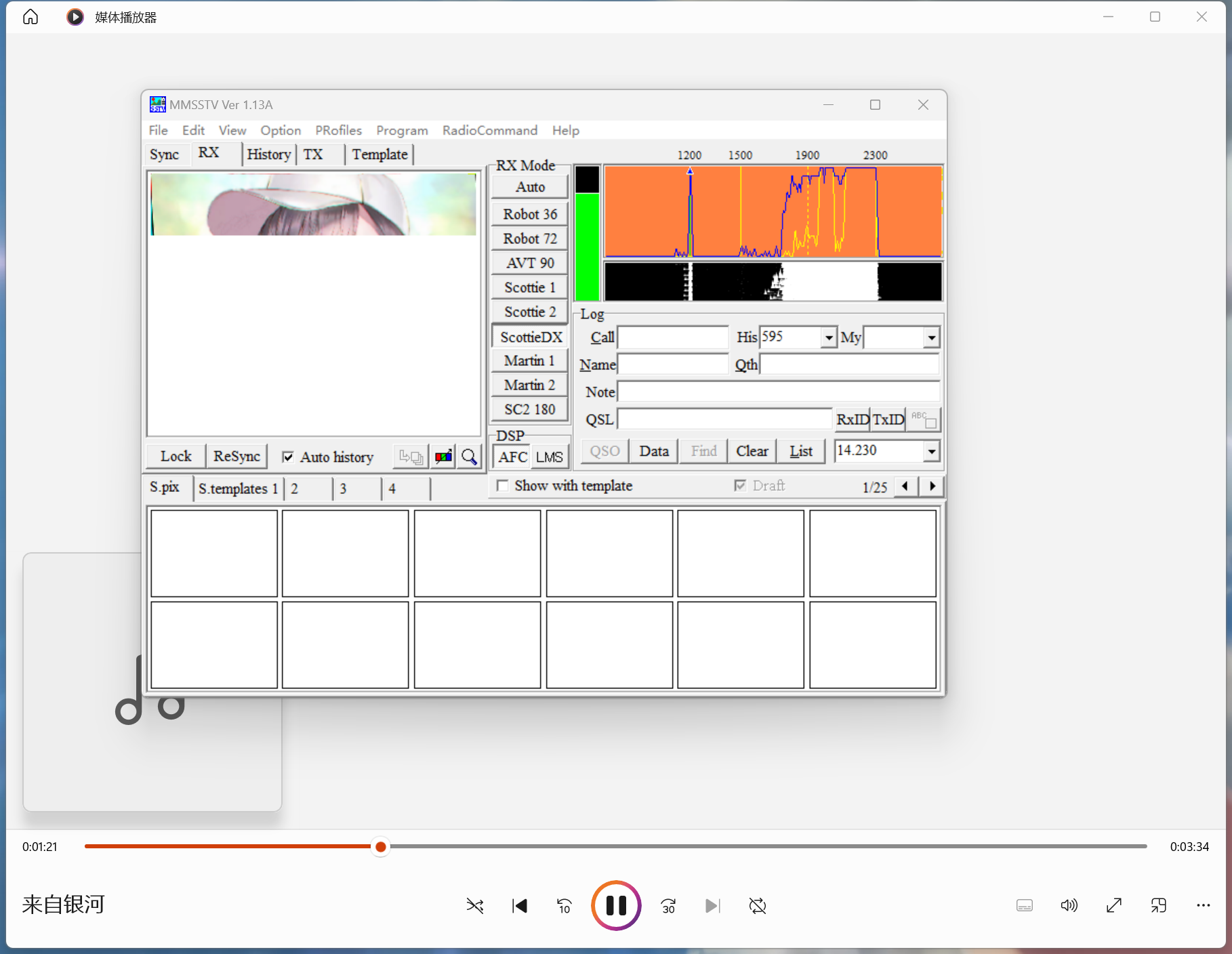

三、音频隐写[Audacity、deepsound、dtmf2num、MMSSTV、虚拟声卡、MP3Stego]

工具 1.Audacity 下载:https://www.audacityteam.org/download/windows/ 使用: 删除:先用左键长按拖着选中内容,然后选择软件最上方菜单栏的编辑,然后选择“删除”,最后点击文件的导出音频就能成功导出…...

二、Web3 学习(区块链)

区块链基础知识 一、基础知识1. 区块链可以做什么?2. 区块链的三个特点 二、区块链的类型概括1. PoW2. PoS3. 私有链和联盟链 三、智能合约1. 什么是智能合约2. 如何使用智能合约 四、困境1. 三难选择的基本要素2. 这真的是一个三难选择吗? 五、比特币1. 什么是比特…...

Linux内网提权

一、SUID提权 前提条件: (1)SUID仅对二进制有效(2)执行者对于该程序需要有x的可执行权限(3)本权限仅在程序的执行过程中有效 1、设置SUID权限:(root权限) …...

Java中的char、String、StringBuilder与StringBuffer 深度详解

Java 中的 char、String、StringBuilder 与 StringBuffer 深度详解 (从底层原理到最佳实践,2026 最新版) 这四个类型是 Java 字符串处理的基石,几乎每天都会用到。掌握它们,能让你写出更高效、更安全的代码。 1. cha…...

值得买商品详情页前端性能优化实战

值得买商品详情页前端性能优化实战一、背景与挑战值得买(SMZDM)作为导购电商平台,商品详情页具有以下特点:内容极其丰富:包含商品标题、价格走势、优惠信息、用户晒单、评测文章、参数对比等多个模块社区属性强&#x…...

UG NX 曲面连续性分析

UG NX 的曲面连续性分析功能用于评估两组曲面之间的连接质量。曲面连续性通常分为四个等级: G0(位置连续):曲面在公共边界处直接接触,无间隙。 G1(相切连续):在G0的基础上࿰…...

UG NX 曲率梳分析精要

UG NX 曲率梳分析精要 曲率梳通过梳状图形直观显示曲线上的曲率变化(方向与半径),是分析曲线连续性的核心工具。用户可单选或多选曲线进行分析。 通过曲率梳可判定曲线的四种连续类型: 1. G0(位置连续) 定义…...

如何突破SIM卡区域限制?Nrfr工具的全方位解决方案

如何突破SIM卡区域限制?Nrfr工具的全方位解决方案 【免费下载链接】Nrfr 🌍 免 Root 的 SIM 卡国家码修改工具 | 解决国际漫游时的兼容性问题,帮助使用海外 SIM 卡获得更好的本地化体验,解锁运营商限制,突破区域限制 …...

突破VK视频下载限制的终极解决方案:VK-Video-Downloader完全指南

突破VK视频下载限制的终极解决方案:VK-Video-Downloader完全指南 【免费下载链接】VK-Video-Downloader Скачивайте видео с сайта ВКонтакте в желаемом качестве 项目地址: https://gitcode.com/gh_mirrors/vk/…...

#第七届立创电赛#【2022暑训营】基于N32G430C8L7的模块化USB电压电流功率表设计与开源分享

基于N32G430C8L7的模块化USB电压电流功率表设计与制作 最近有不少朋友在问,有没有一种简单又强大的工具,能精确测量USB设备的电压、电流和功率,特别是现在USB PD快充这么普及,动不动就几十瓦的功率。正好,我之前为立创…...

遗忘因子调参指南:FFRLS算法在电池SOC估计中的5个关键陷阱

遗忘因子调参实战:FFRLS算法在电池SOC估计中的5个高阶避坑指南 当你在凌晨三点盯着屏幕上飘忽不定的SOC曲线时,是否怀疑过那个看似简单的遗忘因子参数?作为电池管理系统中最关键的"记忆调节器",遗忘因子的选择往往决定了…...

Gemma-3 Pixel Studio惊艳效果:艺术画作风格分析+流派溯源推理展示

Gemma-3 Pixel Studio惊艳效果:艺术画作风格分析流派溯源推理展示 1. 视觉智能的艺术探索 Gemma-3 Pixel Studio作为一款融合多模态理解能力的AI工具,在艺术领域展现出独特价值。它不仅能识别画作内容,更能深入分析艺术风格特征,…...

DirectX修复有什么用?解决游戏闪退dll报错,DirectX修复工具下载安装教程

什么是DirectX修复工具? DirectX修复工具(DirectX Repair)是一款系统级工具软件,主要功能是用来自动修复和安装Windows系统常用的DirectX和C运行库。程序分为标准版、增强版以及在线修复版。所有版本都支持修复DirectX的功能,而增强版则额外…...