NFS存储、API资源对象StorageClass、Ceph存储-搭建ceph集群和Ceph存储-在k8s里使用ceph(2024-07-16)

一、NFS存储

注意:在做本章节示例时,需要拿单独一台机器来部署NFS,具体步骤略。

NFS作为常用的网络文件系统,在多机之间共享文件的场景下用途广泛,毕竟NFS配置方

便,而且稳定可靠。

NFS同样也有一些缺点:① 存在单点故障的风险;② 不方便扩容;③ 性能一般。

NFS比较适合一些简单的、对存储要求不高的场景,比如测试环境、开发环境。

完整示例:

首先部署好NFS服务,并且保证所有Kubernetes节点可以顺利挂载(showmount -e

192.168.100.160 )

[root@aminglinux01 ~]# showmount -e 192.168.100.160

Export list for 192.168.100.160:

/root/nfs *

[root@aminglinux01 ~]#

定义基于NFS的PV

vi nfs-pv.yaml

[root@aminglinux01 ~]# cat nfs-pv.yaml

apiVersion: v1

kind: PersistentVolume

metadata:name: nfs-pv

spec:capacity:storage: 5GiaccessModes:- ReadWriteManypersistentVolumeReclaimPolicy: RetainstorageClassName: nfs-storagenfs:path: /data/nfs2server: 192.168.100.160

[root@aminglinux01 ~]#

定义PVC

vi nfs-pvc.yaml

[root@aminglinux01 ~]# cat nfs-pvc.yaml

apiVersion: v1

kind: PersistentVolumeClaim

metadata:name: nfs-pvc

spec:storageClassName: nfs-storageaccessModes:- ReadWriteManyresources:requests:storage: 5Gi

[root@aminglinux01 ~]#

[root@aminglinux01 ~]# kubectl apply -f nfs-pvc.yaml

persistentvolumeclaim/nfs-pvc created

[root@aminglinux01 ~]# 定义Pod

vi nfs-pod.yaml

[root@aminglinux01 ~]# cat nfs-pod.yaml

apiVersion: v1

kind: Pod

metadata:name: nfs-pod

spec:containers:- name: nfs-containerimage: nginx:latestvolumeMounts:- name: nfs-storagemountPath: /datavolumes:- name: nfs-storagepersistentVolumeClaim:claimName: nfs-pvc

[root@aminglinux01 ~]# kubectl apply -f nfs-pod.yaml

pod/nfs-pod created

[root@aminglinux01 ~]# [root@aminglinux01 ~]# kubectl describe pod nfs-pod

Name: nfs-pod

Namespace: default

Priority: 0

Service Account: default

Node: aminglinux03/192.168.100.153

Start Time: Tue, 16 Jul 2024 17:53:58 +0800

Labels: <none>

Annotations: cni.projectcalico.org/containerID: cae85b956d4a3570429db9b11f96d51b258af363c313885d26a9d12ab0715357

cni.projectcalico.org/podIP: 10.18.68.176/32

cni.projectcalico.org/podIPs: 10.18.68.176/32

Status: Running

IP: 10.18.68.176

IPs:

IP: 10.18.68.176

Containers:

nfs-container:

Container ID: containerd://377477b565ff23b752d278289011af378936831a4c9af9f0e3f5aaf6187fed87

Image: nginx:latest

Image ID: docker.io/library/nginx@sha256:67682bda769fae1ccf5183192b8daf37b64cae99c6c3302650f6f8bf5f0f95df

Port: <none>

Host Port: <none>

State: Running

Started: Tue, 16 Jul 2024 18:18:43 +0800

Ready: True

Restart Count: 0

Environment: <none>

Mounts:

/data from nfs-storage (rw)

/var/run/secrets/kubernetes.io/serviceaccount from kube-api-access-mtjkr (ro)

Conditions:

Type Status

Initialized True

Ready True

ContainersReady True

PodScheduled True

Volumes:

nfs-storage:

Type: PersistentVolumeClaim (a reference to a PersistentVolumeClaim in the same namespace)

ClaimName: nfs-pvc

ReadOnly: false

kube-api-access-mtjkr:

Type: Projected (a volume that contains injected data from multiple sources)

TokenExpirationSeconds: 3607

ConfigMapName: kube-root-ca.crt

ConfigMapOptional: <nil>

DownwardAPI: true

QoS Class: BestEffort

Node-Selectors: <none>

Tolerations: node.kubernetes.io/not-ready:NoExecute op=Exists for 300s

node.kubernetes.io/unreachable:NoExecute op=Exists for 300s

Events:

Type Reason Age From Message

---- ------ ---- ---- -------

Normal Scheduled 32m default-scheduler Successfully assigned default/nfs-pod to aminglinux03

Warning FailedMount 10m (x10 over 30m) kubelet Unable to attach or mount volumes: unmounted volumes=[nfs-storage], unattached volumes=[nfs-storage kube-api-access-mtjkr]: timed out waiting for the condition

Warning FailedMount 9m47s (x19 over 32m) kubelet MountVolume.SetUp failed for volume "nfs-pv" : mount failed: exit status 32

Mounting command: mount

Mounting arguments: -t nfs 192.168.100.160:/data/nfs2 /var/lib/kubelet/pods/d89d3ab9-836c-47a0-8b60-c6c953184756/volumes/kubernetes.io~nfs/nfs-pv

Output: mount.nfs: access denied by server while mounting 192.168.100.160:/data/nfs2

[root@aminglinux01 ~]#

二、API资源对象StorageClass

SC的主要作用在于,自动创建PV,从而实现PVC按需自动绑定PV。下面我们通过创建一个基于NFS的SC来演示SC的作用。要想使用NFS的SC,还需要安装一个NFS provisioner,provisioner里会定义NFS相关的信息(服务器IP、共享目录等)

github地址: https://github.com/kubernetes-sigs/nfs-subdir-external-provisioner

将源码下载下来:

git clone https://github.com/kubernetes-sigs/nfs-subdir-externalprovisioner

cd nfs-subdir-external-provisioner/deploy

sed -i 's/namespace: default/namespace: kube-system/' rbac.yaml ##修改命名空间为kube-system

kubectl apply -f rbac.yaml ##创建rbac授权

[root@aminglinux01 ~]# cd nfs-subdir-external-provisioner/deploy

[root@aminglinux01 deploy]# sed -i 's/namespace: default/namespace: kube-system/' rbac.yaml

[root@aminglinux01 deploy]# kubectl apply -f rbac.yaml

serviceaccount/nfs-client-provisioner unchanged

clusterrole.rbac.authorization.k8s.io/nfs-client-provisioner-runner unchanged

clusterrolebinding.rbac.authorization.k8s.io/run-nfs-client-provisioner unchanged

role.rbac.authorization.k8s.io/leader-locking-nfs-client-provisioner unchanged

rolebinding.rbac.authorization.k8s.io/leader-locking-nfs-client-provisioner unchanged

[root@aminglinux01 deploy]#

修改deployment.yaml

[root@aminglinux01 deploy]# cat deployment.yaml

apiVersion: apps/v1

kind: Deployment

metadata:name: nfs-client-provisionerlabels:app: nfs-client-provisioner# replace with namespace where provisioner is deployednamespace: kube-system

spec:replicas: 1strategy:type: Recreateselector:matchLabels:app: nfs-client-provisionertemplate:metadata:labels:app: nfs-client-provisionerspec:serviceAccountName: nfs-client-provisionercontainers:- name: nfs-client-provisionerimage: registry.cn-hangzhou.aliyuncs.com/*/nfs-subdir-external-provisioner:v4.0.2volumeMounts:- name: nfs-client-rootmountPath: /persistentvolumesenv:- name: PROVISIONER_NAMEvalue: k8s-sigs.io/nfs-subdir-external-provisioner- name: NFS_SERVER value: 192.168.100.160 ###NFS服务器IP- name: NFS_PATH value: /data/nfs ###NFS服务器路径volumes:- name: nfs-client-rootnfs:server: 192.168.100.160 ###NFS服务器IPpath: /data/nfs ###NFS服务器路径

[root@aminglinux01 deploy]# [root@aminglinux01 deploy]# kubectl apply -f deployment.yaml

deployment.apps/nfs-client-provisioner configured

[root@aminglinux01 deploy]# kubectl apply -f class.yaml

storageclass.storage.k8s.io/nfs-client unchanged

SC YAML示例

cat class.yaml

[root@aminglinux01 deploy]# cat class.yaml

apiVersion: storage.k8s.io/v1

kind: StorageClass

metadata:name: nfs-client

provisioner: k8s-sigs.io/nfs-subdir-external-provisioner # or choose another name, must match deployment's env PROVISIONER_NAME'

parameters:archiveOnDelete: "false" ###自动收缩存储空间

[root@aminglinux01 deploy]#

[root@aminglinux01 deploy]# kubectl get StorageClass nfs-client

NAME PROVISIONER RECLAIMPOLICY VOLUMEBINDINGMODE ALLOWVOLUMEEXPANSION AGE

nfs-client k8s-sigs.io/nfs-subdir-external-provisioner Delete Immediate false 7d20h

[root@aminglinux01 deploy]# kubectl describe StorageClass nfs-client

Name: nfs-client

IsDefaultClass: No

Annotations: kubectl.kubernetes.io/last-applied-configuration={"apiVersion":"storage.k8s.io/v1","kind":"StorageClass","metadata":{"annotations":{},"name":"nfs-client"},"parameters":{"archiveOnDelete":"false"},"provisioner":"k8s-sigs.io/nfs-subdir-external-provisioner"}Provisioner: k8s-sigs.io/nfs-subdir-external-provisioner

Parameters: archiveOnDelete=false

AllowVolumeExpansion: <unset>

MountOptions: <none>

ReclaimPolicy: Delete

VolumeBindingMode: Immediate

Events: <none>

[root@aminglinux01 deploy]#

有了SC,还需要一个PVC

vi nfsPvc.yaml

[root@aminglinux01 deploy]# cat nfsPvc.yaml

apiVersion: v1

kind: PersistentVolumeClaim

metadata:name: nfspvc

spec:storageClassName: nfs-clientaccessModes:- ReadWriteManyresources:requests:storage: 500Mi

[root@aminglinux01 deploy]#

[root@aminglinux01 deploy]# kubectl apply -f nfsPvc.yaml

persistentvolumeclaim/nfspvc created

[root@aminglinux01 deploy]# kubectl get PersistentVolumeClaim nfspvc

NAME STATUS VOLUME CAPACITY ACCESS MODES STORAGECLASS AGE

nfspvc Bound pvc-edef8fd1-ab6c-4566-97f7-57627c26101c 500Mi RWX nfs-client 6m5s

[root@aminglinux01 deploy]# kubectl describe PersistentVolumeClaim nfspvc

Name: nfspvc

Namespace: default

StorageClass: nfs-client

Status: Bound

Volume: pvc-edef8fd1-ab6c-4566-97f7-57627c26101c

Labels: <none>

Annotations: pv.kubernetes.io/bind-completed: yespv.kubernetes.io/bound-by-controller: yesvolume.beta.kubernetes.io/storage-provisioner: k8s-sigs.io/nfs-subdir-external-provisionervolume.kubernetes.io/storage-provisioner: k8s-sigs.io/nfs-subdir-external-provisioner

Finalizers: [kubernetes.io/pvc-protection]

Capacity: 500Mi

Access Modes: RWX

VolumeMode: Filesystem

Used By: nfspod

Events:Type Reason Age From Message---- ------ ---- ---- -------Normal ExternalProvisioning 6m15s (x2 over 6m15s) persistentvolume-controller waiting for a volume to be created, either by external provisioner "k8s-sigs.io/nfs-subdir-external-provisioner" or manually created by system administratorNormal Provisioning 6m14s k8s-sigs.io/nfs-subdir-external-provisioner_nfs-client-provisioner-74fcdfd588-5898r_67df3ef1-fefc-4f5e-9032-0c4263a17061 External provisioner is provisioning volume for claim "default/nfspvc"Normal ProvisioningSucceeded 6m14s k8s-sigs.io/nfs-subdir-external-provisioner_nfs-client-provisioner-74fcdfd588-5898r_67df3ef1-fefc-4f5e-9032-0c4263a17061 Successfully provisioned volume pvc-edef8fd1-ab6c-4566-97f7-57627c26101c

[root@aminglinux01 deploy]#

下面创建一个Pod,来使用PVC

vi nfsPod.yaml

[root@aminglinux01 deploy]# cat nfsPod.yaml

apiVersion: v1

kind: Pod

metadata:name: nfspod

spec:containers:- name: nfspodimage: nginx:latestvolumeMounts:- name: nfspvmountPath: "/usr/share/nginx/html"volumes:- name: nfspvpersistentVolumeClaim:claimName: nfspvc

[root@aminglinux01 deploy]#

[root@aminglinux01 deploy]# kubectl apply -f nfsPod.yaml

pod/nfspod created

[root@aminglinux01 deploy]# kubectl describe pod nfspod

Name: nfspod

Namespace: default

Priority: 0

Service Account: default

Node: aminglinux03/192.168.100.153

Start Time: Tue, 16 Jul 2024 23:48:25 +0800

Labels: <none>

Annotations: cni.projectcalico.org/containerID: b81a7c48a39cbcb4acfe42b0c4677b5dd320b63f1735de9ec6a3f11a3ea93a1a

cni.projectcalico.org/podIP: 10.18.68.179/32

cni.projectcalico.org/podIPs: 10.18.68.179/32

Status: Running

IP: 10.18.68.179

IPs:

IP: 10.18.68.179

Containers:

nfspod:

Container ID: containerd://abe29d820c121bac46af4d1341aabeb0d8a30759917389e33ba7ca0619c97e76

Image: nginx:latest

Image ID: docker.io/library/nginx@sha256:67682bda769fae1ccf5183192b8daf37b64cae99c6c3302650f6f8bf5f0f95df

Port: <none>

Host Port: <none>

State: Running

Started: Tue, 16 Jul 2024 23:48:28 +0800

Ready: True

Restart Count: 0

Environment: <none>

Mounts:

/usr/share/nginx/html from nfspv (rw)

/var/run/secrets/kubernetes.io/serviceaccount from kube-api-access-9xt4f (ro)

Conditions:

Type Status

Initialized True

Ready True

ContainersReady True

PodScheduled True

Volumes:

nfspv:

Type: PersistentVolumeClaim (a reference to a PersistentVolumeClaim in the same namespace)

ClaimName: nfspvc

ReadOnly: false

kube-api-access-9xt4f:

总结一下:

pod想使用共享存储 --> PVC (定义具体需求属性) -->SC (定义Provisioner即pv) -->Provisioner(定义具体的访问存储方法) --> NFS-server

三、Ceph存储

Ceph是Ceph使用C++语言开发,是一个开放、自我修复和自我管理的开源分布式存储系统。具有高扩展性、高性能、高可靠性的优点。

Ceph的优点

- 高扩展性:去中心化,支持使用普通X86服务器,支持上千个存储节点的规模,支持TB到EB级扩展。

- 高可靠性:没有单点故障,多数据副本,自动管理,自动修复。

- 高性能:摒弃了传统的集中式存储元数据寻址的方案,采用 CRUSH 算法,数据分布均衡,并行度高。

- 功能强大:Ceph是个大一统的存储系统,集块存储接口(RBD)、文件存储接口(CephFS)、对象存储接口(RadosGW)于一身,因而适用于不同的应用场景。

说明:Kubernetes使用Ceph作为存储,有两种方式,一种是将Ceph部署在Kubernetes里,需要借助一个工具rook;另外一种就是使用外部的Ceph集群,也就是说需要单独部署Ceph集群。下面,我们使用的就是第二种。

搭建Ceph集群

1)准备工作

| 机器编号 | 主机名 | IP |

| 1 | ceph1 | 192.168.100.161 |

| 2 | ceph2 | 192.168.100.162 |

| 3 | ceph3 | 192.168.100.163 |

关闭selinux、firewalld,配置hostname以及/etc/hosts为每一台机器都准备至少一块单独的磁盘(vmware下很方便增加虚拟磁盘),不需要格式化。

[root@bogon ~]# systemctl disable --now firewalld

Removed /etc/systemd/system/multi-user.target.wants/firewalld.service.

Removed /etc/systemd/system/dbus-org.fedoraproject.FirewallD1.service.

[root@bogon ~]# hostnamectl set-hostname Ceph1

[root@Ceph1 ~]# timedatectl set-timezone Asia/Shanghai

所有机器安装时间同步服务chrony

yum install -y chrony

systemctl start chronyd

systemctl enable chronyd

设置yum源(ceph1上)

vi /etc/yum.repos.d/ceph.repo #内容如下

cat /etc/yum.repos.d/ceph.repo

[ceph]

name=ceph

baseurl=http://mirrors.aliyun.com/ceph/rpm-pacific/el8/x86_64/

gpgcheck=0

priority =1

[ceph-noarch]

name=cephnoarch

baseurl=http://mirrors.aliyun.com/ceph/rpm-pacific/el8/noarch/

gpgcheck=0

priority =1

[ceph-source]

name=Ceph source packages

baseurl=http://mirrors.aliyun.com/ceph/rpm-pacific/el8/SRPMS

gpgcheck=0

priority=1

所有机器安装docker-ce(ceph使用docker形式部署)

先安装yum-utils工具

yum install -y yum-utils

配置Docker官方的yum仓库,如果做过,可以跳过

yum-config-manager \

--add-repo \

https://download.docker.com/linux/centos/docker-ce.repo

安装docker-ce

yum install -y docker-ce

启动服务

systemctl start docker

systemctl enable docker

所有机器安装python3、lvm2(三台都做)

yum install -y python3 lvm2

2)安装cephadm(ceph1上执行)

yum install -y cephadm

3)使用cephadm部署ceph(ceph1上)

cephadm bootstrap --mon-ip 192.168.100.161

注意看用户名、密码

Ceph Dashboard is now available at:URL: https://Ceph1:8443/User: adminPassword: cpbyyxt86a

4)访问dashboard

https://192.168.100.161:8443

更改密码后,用新密码登录控制台

5)增加host

首先进入ceph shell(ceph1上)

cephadm shell ##会进入ceph的shell界面下

生成ssh密钥对儿

[ceph: root@ceph1 /]# ceph cephadm get-pub-key > ~/ceph.pub

[root@Ceph1 ~]# cephadm shell

Inferring fsid f501f922-43a9-11ef-b210-000c2990e43b

Using recent ceph image quay.io/ceph/ceph@sha256:f15b41add2c01a65229b0db515d2dd57925636ea39678ccc682a49e2e9713d98

[ceph: root@Ceph1 /]# ceph cephadm get-pub-key > ~/ceph.pub配置到另外两台机器免密登录

[ceph: root@ceph1 /]# ssh-copy-id -f -i ~/ceph.pub root@ceph2

[ceph: root@ceph1 /]# ssh-copy-id -f -i ~/ceph.pub root@ceph3

[ceph: root@Ceph1 /]# ssh-copy-id -f -i ~/ceph.pub root@Ceph2

/usr/bin/ssh-copy-id: INFO: Source of key(s) to be installed: "/root/ceph.pub"

The authenticity of host 'ceph2 (192.168.100.162)' can't be established.

ECDSA key fingerprint is SHA256:QL7GAuP7XtniiwJbCT7NbC1sBsUWR+giTILzhYD8+/E.

Are you sure you want to continue connecting (yes/no/[fingerprint])? yes

root@ceph2's password: Number of key(s) added: 1Now try logging into the machine, with: "ssh 'root@Ceph2'"

and check to make sure that only the key(s) you wanted were added.[ceph: root@Ceph1 /]# ssh-copy-id -f -i ~/ceph.pub root@Ceph3

/usr/bin/ssh-copy-id: INFO: Source of key(s) to be installed: "/root/ceph.pub"

The authenticity of host 'ceph3 (192.168.100.163)' can't be established.

ECDSA key fingerprint is SHA256:QTA1LDrVstoSNuCgZavfi8tWh7X9zMowsSm4QqA9wIk.

Are you sure you want to continue connecting (yes/no/[fingerprint])? yes

root@ceph3's password: Number of key(s) added: 1Now try logging into the machine, with: "ssh 'root@Ceph3'"

and check to make sure that only the key(s) you wanted were added.[ceph: root@Ceph1 /]#

到浏览器里,增加主机

6)创建OSD(ceph shell模式下,在ceph上操作)

假设三台机器上新增的新磁盘为/dev/sda

ceph orch daemon add osd Ceph1:/dev/sda

ceph orch daemon add osd Ceph2:/dev/sda

ceph orch daemon add osd Ceph3:/dev/sda

[ceph: root@Ceph1 /]# ceph orch daemon add osd Ceph1:/dev/sda

Created no osd(s) on host Ceph1; already created?

[ceph: root@Ceph1 /]# ceph orch daemon add osd Ceph2:/dev/sda

Created osd(s) 1 on host 'Ceph2'

[ceph: root@Ceph1 /]# ceph orch daemon add osd Ceph3:/dev/sda

Created osd(s) 2 on host 'Ceph3'

7)创建pool

8)查看集群状态

ceph -s

[ceph: root@Ceph1 /]# ceph -scluster:id: f501f922-43a9-11ef-b210-000c2990e43bhealth: HEALTH_WARNclock skew detected on mon.Ceph2, mon.Ceph3services:mon: 3 daemons, quorum Ceph1,Ceph2,Ceph3 (age 10m)mgr: Ceph2.nhhvbe(active, since 10m), standbys: Ceph1.nqobphosd: 3 osds: 3 up (since 2m), 3 in (since 2m)data:pools: 2 pools, 33 pgsobjects: 0 objects, 0 Busage: 871 MiB used, 14 GiB / 15 GiB availpgs: 33 active+clean[ceph: root@Ceph1 /]#

查案磁盘列表

ceph orch device ls

[ceph: root@Ceph1 /]# ceph orch device ls

HOST PATH TYPE DEVICE ID SIZE AVAILABLE REFRESHED REJECT REASONS

Ceph1 /dev/sda hdd 5120M 6m ago Has a FileSystem, Insufficient space (<10 extents) on vgs, LVM detected

Ceph1 /dev/sr0 hdd VMware_IDE_CDR10_10000000000000000001 2569M 6m ago Has a FileSystem, Insufficient space (<5GB)

Ceph2 /dev/sda hdd 5120M 3m ago Has a FileSystem, Insufficient space (<10 extents) on vgs, LVM detected

Ceph2 /dev/sr0 hdd VMware_IDE_CDR10_10000000000000000001 2569M 3m ago Has a FileSystem, Insufficient space (<5GB)

Ceph3 /dev/sda hdd 5120M 2m ago Has a FileSystem, Insufficient space (<10 extents) on vgs, LVM detected

[ceph: root@Ceph1 /]#

9)针对aminglinux01 pool启用rbd application

ceph osd pool application enable aminglinux01 rbd

[ceph: root@Ceph1 /]# ceph osd pool application enable aminglinux01 rbd

enabled application 'rbd' on pool 'aminglinux01'

[ceph: root@Ceph1 /]#

10)初始化pool

[ceph: root@Ceph1 /]# rbd pool init aminglinux01

[ceph: root@Ceph1 /]#

四、 k8s使用ceph

1)获取ceph集群信息和admin用户的key(ceph那边)

#获取集群信息

[ceph: root@Ceph1 /]# ceph mon dump

epoch 3

fsid f501f922-43a9-11ef-b210-000c2990e43b ##这一串一会儿用

last_changed 2024-07-16T19:48:11.564819+0000

created 2024-07-16T19:32:30.484938+0000

min_mon_release 16 (pacific)

election_strategy: 1

0: [v2:192.168.100.161:3300/0,v1:192.168.100.161:6789/0] mon.Ceph1

1: [v2:192.168.100.162:3300/0,v1:192.168.100.162:6789/0] mon.Ceph2

2: [v2:192.168.100.163:3300/0,v1:192.168.100.163:6789/0] mon.Ceph3

dumped monmap epoch 3

[ceph: root@Ceph1 /]#

#获取admin用户key

[ceph: root@Ceph1 /]# ceph auth get-key client.admin ; echo

AQDNypZmFQmGNhAAbkbd5T9c55nWzJBmpDk9DA== #这串一会用

[ceph: root@Ceph1 /]#

2)下载并导入镜像

将用到的镜像先下载下来,避免启动容器时,镜像下载太慢或者无法下载可以下载到其中某一个节点上,然后将镜像拷贝到其它节点

#下载镜像(其中一个节点)

#下载镜像(其中一个节点)

wget -P /tmp/ https://d.frps.cn/file/tools/ceph-csi/k8s_1.24_cephcsi.

tar

#拷贝

scp /tmp/k8s_1.24_ceph-csi.tar aminglinux02:/tmp/

scp /tmp/k8s_1.24_ceph-csi.tar aminglinux03:/tmp/

#导入镜像(所有k8s节点)

ctr -n k8s.io i import k8s_1.24_ceph-csi.tar

3)建ceph的 provisioner

创建ceph目录,后续将所有yaml文件放到该目录下

mkdir ceph

cd ceph

创建secret.yaml

[root@aminglinux01 ceph]# cat secret.yaml

apiVersion: v1

kind: Secret

metadata:name: csi-rbd-secretnamespace: default

stringData:userID: adminuserKey: AQDNypZmFQmGNhAAbkbd5T9c55nWzJBmpDk9DA== #这串上面已经获取

[root@aminglinux01 ceph]#

创建config-map.yaml

[root@aminglinux01 ceph]# cat csi-config-map.yaml

apiVersion: v1

kind: ConfigMap

metadata:name: "ceph-csi-config"

data:config.json: |-[{"clusterID": "f501f922-43a9-11ef-b210-000c2990e43b","monitors": ["192.168.100.161:6789","192.168.100.162:6789","192.168.100.163:6789"]}]

[root@aminglinux01 ceph]#

创建ceph-conf.yaml

[root@aminglinux01 ceph]# cat ceph-conf.yaml

apiVersion: v1

kind: ConfigMap

data:ceph.conf: |[global]auth_cluster_required = cephxauth_service_required = cephxauth_client_required = cephx# keyring is a required key and its value should be emptykeyring: |

metadata:name: ceph-config

[root@aminglinux01 ceph]#

创建csi-kms-config-map.yaml(该config内容为空)

[root@aminglinux01 ceph]# cat csi-kms-config-map.yaml

---

apiVersion: v1

kind: ConfigMap

data:config.json: |-{}

metadata:name: ceph-csi-encryption-kms-config

[root@aminglinux01 ceph]#下载其余rbac以及provisioner相关yaml

wget https://d.frps.cn/file/tools/ceph-csi/csi-provisioner-rbac.yaml

wget https://d.frps.cn/file/tools/ceph-csi/csi-nodeplugin-rbac.yaml

wget https://d.frps.cn/file/tools/ceph-csi/csi-rbdplugin.yaml

wget https://d.frps.cn/file/tools/ceph-csi/csi-rbdpluginprovisioner.yaml

应用所有yaml(注意,当前目录是在ceph目录下)

for f in `ls *.yaml`; do echo $f; kubectl apply -f $f; done

for f in `ls *.yaml`; do echo $f; kubectl delete -f $f; done

[root@aminglinux01 ceph]# for f in `ls *.yaml`; do echo $f; kubectl apply -f $f; done

ceph-conf.yaml

configmap/ceph-config created

csi-config-map.yaml

configmap/ceph-csi-config created

csi-kms-config-map.yaml

configmap/ceph-csi-encryption-kms-config created

csi-nodeplugin-rbac.yaml

serviceaccount/rbd-csi-nodeplugin created

clusterrole.rbac.authorization.k8s.io/rbd-csi-nodeplugin created

clusterrolebinding.rbac.authorization.k8s.io/rbd-csi-nodeplugin created

csi-provisioner-rbac.yaml

serviceaccount/rbd-csi-provisioner created

clusterrole.rbac.authorization.k8s.io/rbd-external-provisioner-runner created

clusterrolebinding.rbac.authorization.k8s.io/rbd-csi-provisioner-role created

role.rbac.authorization.k8s.io/rbd-external-provisioner-cfg created

rolebinding.rbac.authorization.k8s.io/rbd-csi-provisioner-role-cfg created

csi-rbdplugin-provisioner.yaml

service/csi-rbdplugin-provisioner created

deployment.apps/csi-rbdplugin-provisioner created

csi-rbdplugin.yaml

daemonset.apps/csi-rbdplugin created

service/csi-metrics-rbdplugin created

secret.yaml

secret/csi-rbd-secret created

[root@aminglinux01 ceph]#

检查provisioner的pod,状态为running才对

4)创建storageclass

在k8s上创建ceph-sc.yaml

[root@aminglinux01 ceph]# cat ceph-sc.yaml

apiVersion: storage.k8s.io/v1

kind: StorageClass

metadata:name: csi-rbd-sc #storageclass名称

provisioner: rbd.csi.ceph.com #驱动器

parameters:clusterID: f501f922-43a9-11ef-b210-000c2990e43b #ceph集群idpool: aminglinux01 #pool空间imageFeatures: layering #rbd特性csi.storage.k8s.io/provisioner-secret-name: csi-rbd-secretcsi.storage.k8s.io/provisioner-secret-namespace: defaultcsi.storage.k8s.io/controller-expand-secret-name: csi-rbd-secretcsi.storage.k8s.io/controller-expand-secret-namespace: defaultcsi.storage.k8s.io/node-stage-secret-name: csi-rbd-secretcsi.storage.k8s.io/node-stage-secret-namespace: default

reclaimPolicy: Delete #pvc回收机制

allowVolumeExpansion: true #对扩展卷进行扩展

mountOptions: #StorageClass 动态创建的 PersistentVolume 将使用类中 mountOptions 字段指定的挂载选项- discard

[root@aminglinux01 ceph]#

##应用yaml

kubectl apply -f ceph-sc.yaml

[root@aminglinux01 ceph]# kubectl apply -f ceph-sc.yaml

storageclass.storage.k8s.io/csi-rbd-sc created

[root@aminglinux01 ceph]#

5)创建pvc

在k8s上创建ceph-pvc.yaml

[root@aminglinux01 ceph]# cat ceph-pvc.yaml

apiVersion: v1

kind: PersistentVolumeClaim

metadata:name: ceph-pvc #pvc名称

spec:accessModes:- ReadWriteOnce #访问模式resources:requests:storage: 1Gi #存储空间storageClassName: csi-rbd-sc

[root@aminglinux01 ceph]# #应用yaml

kubectl apply -f ceph-pvc.yaml

[root@aminglinux01 ceph]# kubectl apply -f ceph-pvc.yaml

persistentvolumeclaim/ceph-pvc created

[root@aminglinux01 ceph]#

查看pvc状态,STATUS必须为Bound

[root@aminglinux01 ceph]# kubectl get pvc

NAME STATUS VOLUME CAPACITY ACCESS MODES STORAGECLASS AGE

ceph-pvc Bound pvc-67a82d8a-43c9-4609-95c5-6ae097daedb9 1Gi RWO csi-rbd-sc 54s

local-pvc Bound local-pv 5Gi RWO local-storage 39h

nfs-pvc Bound nfs-pv 5Gi RWX nfs-storage 27h

nfspvc Bound pvc-edef8fd1-ab6c-4566-97f7-57627c26101c 500Mi RWX nfs-client 21h

redis-pvc-redis-sts-0 Bound pvc-402daec2-9527-4a53-a6cb-e1d18c98f3d4 500Mi RWX nfs-client 8d

redis-pvc-redis-sts-1 Bound pvc-bb317d2c-ef72-47a0-a8e2-f7704f60096d 500Mi RWX nfs-client 8d

testpvc Pending test-storage 41h

[root@aminglinux01 ceph]#

6)创建pod使用ceph存储

[root@aminglinux01 ceph]# cat ceph-pod.yaml

apiVersion: v1

kind: Pod

metadata:name: ceph-pod

spec:containers:- name: ceph-ngimage: nginx:latestvolumeMounts:- name: ceph-mntmountPath: /mntreadOnly: falsevolumes:- name: ceph-mntpersistentVolumeClaim:claimName: ceph-pvc

[root@aminglinux01 ceph]#

[root@aminglinux01 ceph]# kubectl apply -f ceph-pod.yaml

pod/ceph-pod created

[root@aminglinux01 ceph]# 查看pv

[root@aminglinux01 ceph]# kubectl get pv

NAME CAPACITY ACCESS MODES RECLAIM POLICY STATUS CLAIM STORAGECLASS REASON AGE

local-pv 5Gi RWO Retain Bound default/local-pvc local-storage 39h

nfs-pv 5Gi RWX Retain Bound default/nfs-pvc nfs-storage 27h

pvc-402daec2-9527-4a53-a6cb-e1d18c98f3d4 500Mi RWX Delete Bound default/redis-pvc-redis-sts-0 nfs-client 8d

pvc-67a82d8a-43c9-4609-95c5-6ae097daedb9 1Gi RWO Delete Bound default/ceph-pvc csi-rbd-sc 4m7s

pvc-bb317d2c-ef72-47a0-a8e2-f7704f60096d 500Mi RWX Delete Bound default/redis-pvc-redis-sts-1 nfs-client 8d

pvc-edef8fd1-ab6c-4566-97f7-57627c26101c 500Mi RWX Delete Bound default/nfspvc nfs-client 21h

testpv 500Mi RWO Retain Released default/testpvc test-storage 41h

[root@aminglinux01 ceph]#

在ceph这边查看rbd

[ceph: root@Ceph1 /]# rbd ls aminglinux01

csi-vol-e8aeb725-1e74-42e3-a61b-8020f76d5b1d

[ceph: root@Ceph1 /]#

在pod里查看挂载情况

[root@aminglinux01 ceph]# kubectl exec -it ceph-pod -- df

Filesystem 1K-blocks Used Available Use% Mounted on

overlay 17811456 9963716 7847740 56% /

tmpfs 65536 0 65536 0% /dev

tmpfs 1860440 0 1860440 0% /sys/fs/cgroup

/dev/rbd0 996780 24 980372 1% /mnt

/dev/mapper/rl-root 17811456 9963716 7847740 56% /etc/hosts

shm 65536 0 65536 0% /dev/shm

tmpfs 3618480 12 3618468 1% /run/secrets/kubernetes.io/serviceaccount

tmpfs 1860440 0 1860440 0% /proc/acpi

tmpfs 1860440 0 1860440 0% /proc/scsi

tmpfs 1860440 0 1860440 0% /sys/firmware

[root@aminglinux01 ceph]#

相关文章:

NFS存储、API资源对象StorageClass、Ceph存储-搭建ceph集群和Ceph存储-在k8s里使用ceph(2024-07-16)

一、NFS存储 注意:在做本章节示例时,需要拿单独一台机器来部署NFS,具体步骤略。NFS作为常用的网络文件系统,在多机之间共享文件的场景下用途广泛,毕竟NFS配置方 便,而且稳定可靠。NFS同样也有一些缺点&…...

「Vue组件化」封装i18n国际化

前言 在Vue应用中实现国际化(i18n),通常需要使用一些专门的库,比如vue-i18n。本文主要介绍自定义封装i18n,支持Vue、uniapp等版本。 设计思路 一、预期效果 二、核心代码 2.1 i18n.xlsx文件准备 2.2 脚本执行 根目录main.js根目录locali18n.xlsxnode main.jsmain.js 文件…...

【Git远程操作】理解分布式管理 | 创建远程仓库

目录 1.理解分布式管理 多人协作开发 2.创建远程仓库 2.1仓库名&路径 2.2初始化仓库&设置模板 1.理解分布式管理 目前我们学习的所有内容都是在本地来完成的。(add /commit /版本撤销回退/分支管理) Git是一个分布式 的版本控制系统。 分支…...

OJ-0718

示例1 input 3 1 1 1 output 0示例2 input 3 3 7 10 output 1示例3 input 4 3 7 10 16 output 3题解1:List {public static void main(String[] args) {Scanner in new Scanner(System.in);int num in.nextInt();List<Integer> list new ArrayList<…...

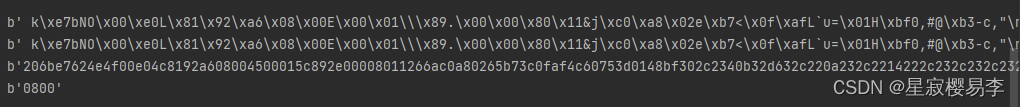

python抓包 -- 用wireshark抓包、解析--scapy、PyShark

一、 安装scapy模块 1、打开DOS命令行 python -m pip install scapy2、sniff()函数 功能:数据嗅探 参数: iface: 指定在哪个网络接口上抓包 count: 表示要捕获数据包的数量。默认为0(不限制数量) filter: 流量的过滤规则。使用的是 BPF 的语法 prn:…...

uni-app开发日志:unicloud使用时遇到的问题解决汇总(不断补充)

插件安装后提示与原数据库表冲突(2024.7.18) 安装uni-admin后再安装uni-cms,在uni-admin中添加好菜单,结果提示该错误 回到hbuilder中uniCloud/database中找到冲突的部分 比较一下,选中老的删除 opendb-news-articl…...

插入排序算法详解

快速排序(Quick Sort)是计算机科学与技术领域中非常经典的一种排序算法,由C. A. R. Hoare在1960年提出。它应用分治思想进行排序,通过对数据进行分区操作,并递归地对分区后的子序列进行排序,从而达到整个序…...

parallel 详细解析 Java 8 Stream API 中的 parallel 方法

详解Java Stream的并行处理(Parallel) Java 8 引入了Stream API,提供了一种便捷而高效的方式来处理集合数据。Stream API使得对数据集合的操作变得更为简洁和易读。 其中,并行流(parallelStream)是Stream …...

不同业务场景下通过mars3d实现绕点旋转效果

1.鼠标单击地图某一处就对该点进行绕点旋转效果 相关代码: 1.相关绕点旋转的初始化代码: const rotatePoint new mars3d.thing.RotatePoint({direction: false, // 方向 true逆时针,false顺时针time: 50 // 给定飞行一周所需时间(单位 秒)&…...

重塑水利未来:智慧水利解决方案的探索与实践,从物联网、大数据到人工智能,科技如何赋能水利行业,实现智慧化管理与决策

本文关键词:智慧水利、智慧水利工程、智慧水利发展前景、智慧水利技术、智慧水利信息化系统、智慧水利解决方案、数字水利和智慧水利、数字水利工程、数字水利建设、数字水利概念、人水和协、智慧水库、智慧水库管理平台、智慧水库建设方案、智慧水库解决方案、智慧…...

IO、进程、线程03

第一题:预习 opendir 和 readdir函数 opendir 和 readdir 是两个在C语言(特别是使用POSIX标准的系统,如Linux和UNIX)中用于目录遍历的函数。这两个函数属于标准的C库中的目录操作部分,通常与<dirent.h>头文件一…...

算法力扣刷题记录 五十二【617.合并二叉树】

前言 二叉树篇,继续。 记录 五十二【617.合并二叉树】 一、题目阅读 给你两棵二叉树: root1 和 root2 。 想象一下,当你将其中一棵覆盖到另一棵之上时,两棵树上的一些节点将会重叠(而另一些不会)。你需要…...

Java中的ArrayList和LinkedList有什么区别?

Java中的ArrayList和LinkedList是两种常用的集合实现类,它们都属于Java集合框架的一部分,但它们在内部实现、性能特点、使用场景等方面存在明显的区别。以下是对这两种集合的详细比较: 1. 数据结构差异 ArrayList:ArrayList是动…...

Linux C++ 058-设计模式之解释器模式

Linux C 058-设计模式之解释器模式 本节关键字:Linux、C、设计模式、解释器模式 相关库函数: 概念 解释器模式(Interpreter Pattern)提供了评估语言的语法或表达式的方式,它属于行为型模式。 解释器模式用于构建一…...

MDK5没有DeviceName

遇到的问题是Jlink驱动问题 不是引脚接反 使用国产GD单片机不同的工程,有的有Device Name,有的没有Device Name(下图是弄好的情况,有Device Name) 硬件链接,和设备都没有问题:无法仿真,无法下…...

在LabVIEW中实现图像矫正

在LabVIEW中实现图像矫正,特别是将倾斜的笔记本图像(如左图)校正为正视图像(如右图),通常需要以下几个步骤: 1. 获取图像 使用图像采集设备或加载图像文件来获取图像数据。 2. 图像预处理 对…...

)

Apache httpd-vhosts.conf 配置详解(附Demo)

目录 前言1. 基本配置2. http和https3. 重定向和代理配置4. 实战前言 Nginx的相关配置推荐阅读:Nginx将https重定向为http进行访问的配置(附Demo) 1. 基本配置 httpd-vhosts.conf 是 Apache HTTP Server 配置虚拟主机(Virtual Hosts)的文件 虚拟主机允许在一台服务器上…...

活动回顾 | AutoMQ 联合 GreptimeDB 共同探讨新能源汽车数据基础设施

7 月 13 日,AutoMQ 携手 GreptimeDB“新能源汽车数据基础设施” 主题 meetup 在上海圆满落幕。本次论坛多角度探讨如何通过创新的数据管理和存储架构,提升汽车系统的性能、安全性和可靠性,从而驱动行业的持续发展和创新,涵盖 Auto…...

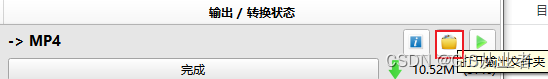

格式工厂转换视频分辨率

1、下载和安装 http://www.pcfreetime.com/formatfactory/CN/index.html 2、打开视频 3、设置分辨率等参数 也可以选择保持原分辨率 4、执行导出 5、打开输出所在位置...

ReAct 大模型提示框架

你可能不熟悉 ReAct,这是一个旨在增强语言模型 (LLM) 决策能力的尖端框架。 通过使用新的观察结果更新 LLM 的上下文窗口并提示其重新评估信息,ReAct 促进了类似于人类思维过程的推理水平,超越了诸如思维链提示之类的旧技术。 在本文中&…...

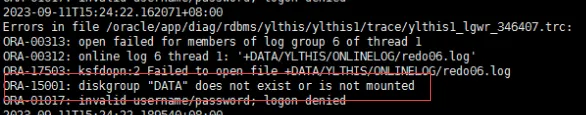

19c补丁后oracle属主变化,导致不能识别磁盘组

补丁后服务器重启,数据库再次无法启动 ORA01017: invalid username/password; logon denied Oracle 19c 在打上 19.23 或以上补丁版本后,存在与用户组权限相关的问题。具体表现为,Oracle 实例的运行用户(oracle)和集…...

)

论文解读:交大港大上海AI Lab开源论文 | 宇树机器人多姿态起立控制强化学习框架(二)

HoST框架核心实现方法详解 - 论文深度解读(第二部分) 《Learning Humanoid Standing-up Control across Diverse Postures》 系列文章: 论文深度解读 + 算法与代码分析(二) 作者机构: 上海AI Lab, 上海交通大学, 香港大学, 浙江大学, 香港中文大学 论文主题: 人形机器人…...

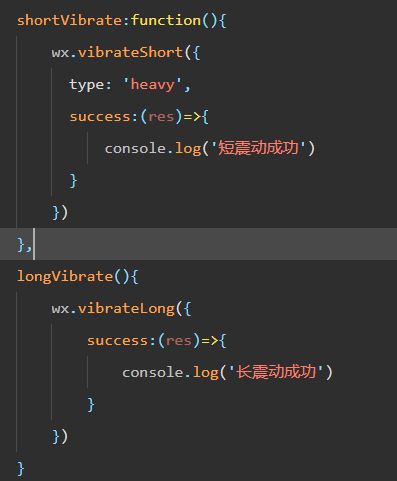

微信小程序 - 手机震动

一、界面 <button type"primary" bindtap"shortVibrate">短震动</button> <button type"primary" bindtap"longVibrate">长震动</button> 二、js逻辑代码 注:文档 https://developers.weixin.qq…...

Rust 异步编程

Rust 异步编程 引言 Rust 是一种系统编程语言,以其高性能、安全性以及零成本抽象而著称。在多核处理器成为主流的今天,异步编程成为了一种提高应用性能、优化资源利用的有效手段。本文将深入探讨 Rust 异步编程的核心概念、常用库以及最佳实践。 异步编程基础 什么是异步…...

Rapidio门铃消息FIFO溢出机制

关于RapidIO门铃消息FIFO的溢出机制及其与中断抖动的关系,以下是深入解析: 门铃FIFO溢出的本质 在RapidIO系统中,门铃消息FIFO是硬件控制器内部的缓冲区,用于临时存储接收到的门铃消息(Doorbell Message)。…...

Python 包管理器 uv 介绍

Python 包管理器 uv 全面介绍 uv 是由 Astral(热门工具 Ruff 的开发者)推出的下一代高性能 Python 包管理器和构建工具,用 Rust 编写。它旨在解决传统工具(如 pip、virtualenv、pip-tools)的性能瓶颈,同时…...

Spring是如何解决Bean的循环依赖:三级缓存机制

1、什么是 Bean 的循环依赖 在 Spring框架中,Bean 的循环依赖是指多个 Bean 之间互相持有对方引用,形成闭环依赖关系的现象。 多个 Bean 的依赖关系构成环形链路,例如: 双向依赖:Bean A 依赖 Bean B,同时 Bean B 也依赖 Bean A(A↔B)。链条循环: Bean A → Bean…...

)

C#学习第29天:表达式树(Expression Trees)

目录 什么是表达式树? 核心概念 1.表达式树的构建 2. 表达式树与Lambda表达式 3.解析和访问表达式树 4.动态条件查询 表达式树的优势 1.动态构建查询 2.LINQ 提供程序支持: 3.性能优化 4.元数据处理 5.代码转换和重写 适用场景 代码复杂性…...

libfmt: 现代C++的格式化工具库介绍与酷炫功能

libfmt: 现代C的格式化工具库介绍与酷炫功能 libfmt 是一个开源的C格式化库,提供了高效、安全的文本格式化功能,是C20中引入的std::format的基础实现。它比传统的printf和iostream更安全、更灵活、性能更好。 基本介绍 主要特点 类型安全:…...

Oracle11g安装包

Oracle 11g安装包 适用于windows系统,64位 下载路径 oracle 11g 安装包...