K8S:Pod容器中的存储方式及PV、PVC

文章目录

- Pod容器中的存储方式

- 一.emptyDir存储卷

- 1.emptyDir存储卷概念

- 2.emptyDir存储卷示例

- 二.hostPath存储卷

- 1.hostPath存储卷概念

- 2.hostPath存储卷示例

- 三.nfs共享存储卷

- 1.nfs共享存储卷示例

- 四.PV和PVC

- 1.PV、PVC概念

- 2.PVC 的使用逻辑及数据流向

- 3.storageclass插件

- (1)storageclass插件概念

- (2)StorageClass插件数据流向

- 4.PV和PVC之间的相互作用及PV 的状态

- (1)生命周期

- (2)PV 的状态

- (3)pv创建到销毁的整个流程

- 5.PV和PVC基础操作

- (1)查看pv的定义方式

- (2)查看pv定义的规格

- (3)查看PVC的定义方式

- 6.k8s支持的存储插件的访问方式

- 7.NFS使用PV、PVC静态示例

- (1)NFS使用PV、PVC图示

- (2)NFS使用PV、PVC配置

- ①配置nfs存储

- ②定义PV

- ③定义PVC

- ④测试访问

- 8.搭建 StorageClass + NES实现 NES 的动态 PV 创建

- (1)外部存储卷插件

- (2)卷插件概念

- (3)配置 StorageClass + NES实现 NES 的动态 PV 创建

- ①在stor01节点上安装nfs,并配置nfs服务

- ②创建 Service Account,用来管理 NFS Provisioner 在 k8s 集群中运行的权限,设置 nfs-client 对 PV,PVC,StorageClass 等的规则

- ③使用 Deployment 来创建 NFS Provisioner

- ④创建 StorageClass,负责建立 PVC 并调用 NFS provisioner 进行预定的工作,并让 PV 与 PVC 建立关联

- ⑤创建 PVC 和 Pod 测试

- 总:

- 1.三个存储卷

- 2.PV和PVC

- 3.storageClass

- 4.静态PV的使用及创建PV、PVC和Pod的过程

Pod容器中的存储方式

需要存储方式前提:容器磁盘上的文件的生命周期是短暂的,这就使得在容器中运行重要应用时会出现一些问题。

首先,当容器崩溃时,kubelet 会重启它,但是容器中的文件将丢失——容器以干净的状态(镜像最初的状态)重新启动。其次,在Pod中同时运行多个容器时,这些容器之间通常需要共享文件。Kubernetes 中的Volume抽象就很好的解决了这些问题。Pod中的容器通过Pause容器共享Volume。

一.emptyDir存储卷

1.emptyDir存储卷概念

当Pod被分配给节点时,首先创建emptyDir卷,并且只要该Pod在该节点上运行,该卷就会存在。正如卷的名字所述,它最初是空的。Pod 中的容器可以读取和写入emptyDir卷中的相同文件,尽管该卷可以挂载到每个容器中的相同或不同路径上。当出于任何原因从节点中删除 Pod 时,emptyDir中的数据将被永久删除。

2.emptyDir存储卷示例

#为了更方便查看将之前的pod删除

kubectl delete pod --all

#查看节点是否有污点,有则清除

kubectl describe nodes node01

kubectl describe nodes node02

mkdir /opt/volumes

cd /opt/volumes

vim pod-emptydir.yaml apiVersion: v1

kind: Pod

metadata:name: pod-emptydirnamespace: defaultlabels:app: myapptier: frontend

spec:containers:- name: myappimage: ikubernetes/myapp:v1imagePullPolicy: IfNotPresentports:- name: httpcontainerPort: 80#定义容器挂载内容volumeMounts:#使用的存储卷名称,如果跟下面volume字段name值相同,则表示使用volume的这个存储卷- name: blue#挂载至容器中哪个目录mountPath: /usr/share/nginx/html/- name: busyboximage: busybox:latestimagePullPolicy: IfNotPresentvolumeMounts:- name: blue#在容器内定义挂载存储名称和挂载路径mountPath: /data/command: ['/bin/sh','-c','while true;do echo $(date) >> /data/index.html;sleep 2;done']#定义存储卷volumes:#定义存储卷名称 - name: blue#定义存储卷类型emptyDir: {}

kubectl apply -f pod-emptydir.yaml

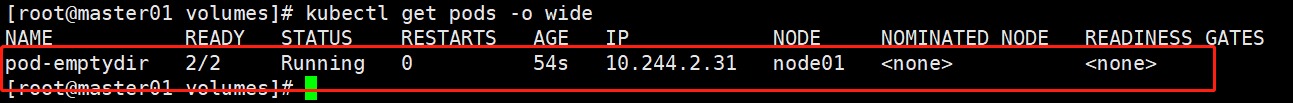

kubectl get pods -o wideNAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

pod-emptydir 2/2 Running 0 54s 10.244.2.31 node01 <none> <none>

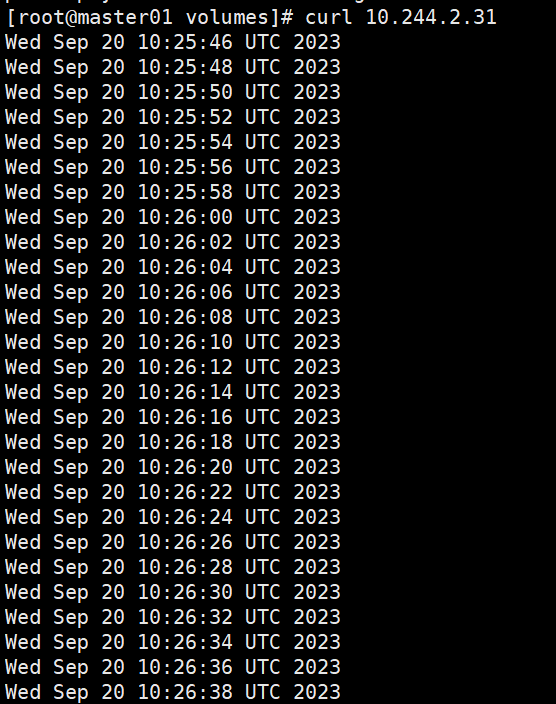

#在上面定义了2个容器,其中一个容器是输入日期到index.html中,然后验证访问nginx的html是否可以获取日期。以验证两个容器之间挂载的emptyDir实现共享。

curl 10.244.2.31

#进入容器查看

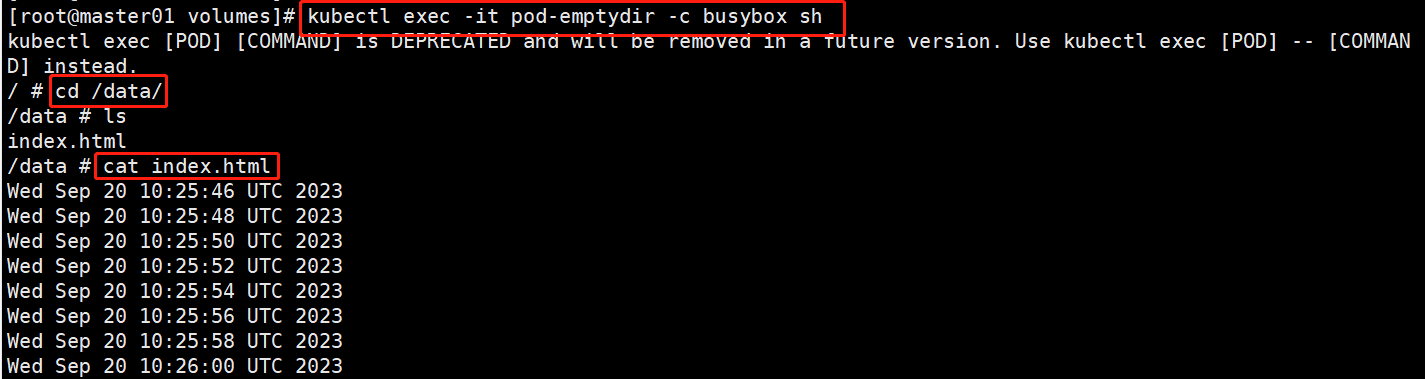

kubectl exec -it pod-emptydir -c busybox sh

cd /data/

cat index.html

exit

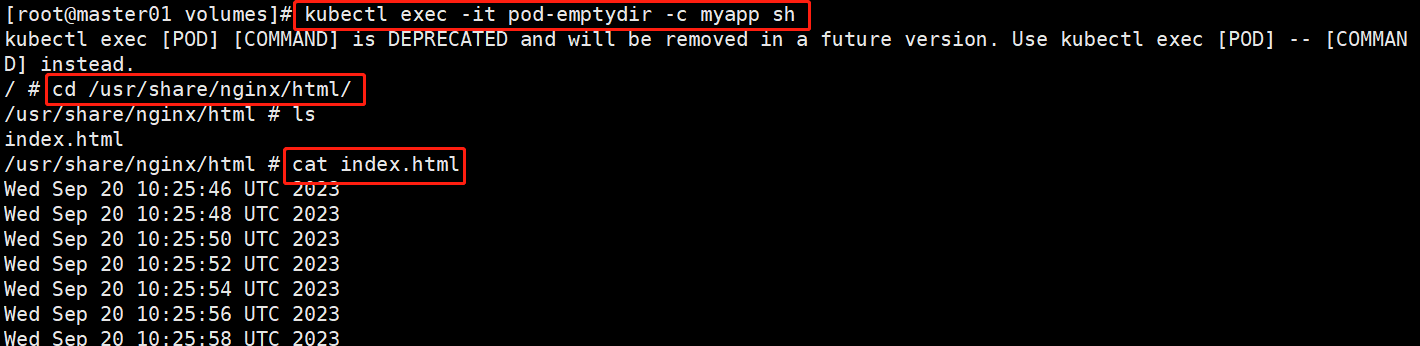

kubectl exec -1t pod-emptydir ic myapp sh

cd /usr/share/nginx/html/

cat index.html

exit

总:容器和容器之间共用了一个emptyDir卷,一旦容器挂掉,存储卷也不会存在

二.hostPath存储卷

1.hostPath存储卷概念

hostPath卷将 node 节点的文件系统中的文件或目录挂载到集群中。

hostPath可以实现持久存储,但是在node节点故障时,也会导致数据的丢失。

2.hostPath存储卷示例

可以使用此命令查看相关标签配置:kubectl explain pod.spec.volumes .hostpath

node01 节点操作

#在 node01 节点上创建挂载目录

mkdir -p /data/pod/volume1

echo 'node01.blue.com' > /data/pod/volumel/index.html

node02 节点操作

#在 node02 节点上创建挂载目录

mkdir -p /data/pod/volumel

echo 'node02.blue.com' > /data/pod/volumel/index.html

master 节点操作

#创建 Pod 资源

vim pod-hostpath.yamlapiVersion: v1

kind: Pod

metadata:name: pod-hostpathnamespace: default

spec:containers:- name: myappimage: ikubernetes/myapp:v1#定义容器挂载内容volumeMounts:#使用的存储卷名称,如果跟下面volume字段name值相同,则表示使用volume的这个存储卷- name: html#挂载至容器中哪个目录mountPath: /usr/share/nginx/html#读写挂载方式,默认为读写模式falsereadOnly: false#volumes字段定义了paues容器关联的宿主机或分布式文件系统存储卷volumes:#存储卷名称- name: html#路径,为宿主机存储路径hostPath:#在宿主机上目录的路径path: /data/pod/volume1#定义类型,这表示如果宿主机没有此目录则会自动创建type: DirectoryOrCreate

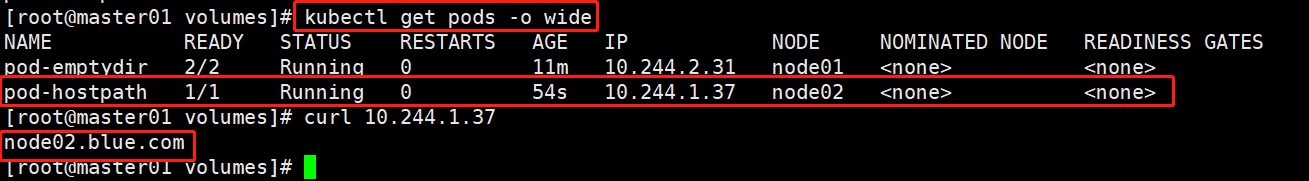

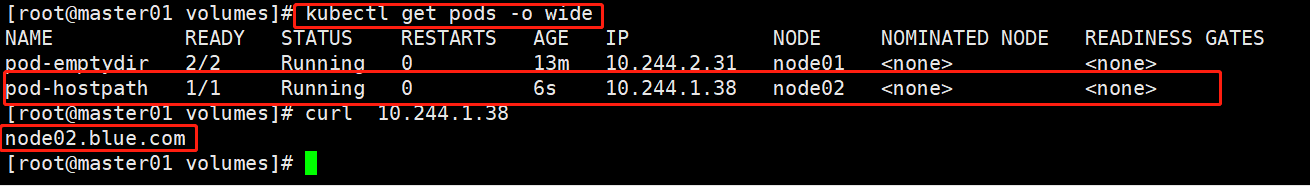

kubectl apply -f pod-hostpath.yaml

#访问测试

kubectl get pods -o wide

curl 10.244.2.35node02.blue.com

#删除pod,再重建,验证是否依旧可以访问原来的内容

kubectl delete -f pod-hostpath.yaml

kubectl apply -f pod-hostpath.yaml

kubectl get pods -o wide

#访问测试

curl 10.244.2.37

node02.blue.com

总:pod漂到哪一个节点上,哪一个节点共享数据,如果node节点挂了,数据会丢失

三.nfs共享存储卷

1.nfs共享存储卷示例

stor01节点操作

#查看是否安装nfs

rpm -q rpcbind nfs-utils

hostnamectl set-hostname stor01

#在stor01节点上安装nfs,并配置nfs服务

mkdir /data/volumes -p

chmod 777 /data/volumes

vim /etc/exports

/data/volumes 192.168.198.0/24(rw,no_root_squash)

systemctl start rpcbind

systemctl start nfs

showmount -e

Export list for stor01:

/data/volumes 192.168.198.0/24

node02节点操作

vim /etc/hosts

192.168.198.14 stor01

node01节点操作

vim /etc/hosts

192.168.198.14 stor01

master节点操作

vim pod-nfs-vol.yamlapiVersion: v1

kind: Pod

metadata:name: myapp01-nfsnamespace: default

spec:containers:- name: myappimage: ikubernetes/myapp:v1imagePullPolicy: IfNotPresentvolumeMounts:- name: nfsmountPath: /usr/share/nginx/htmlreadOnly: falserestartPolicy: AlwaysnodeSelector:kubernetes.io/hostname: node02volumes:- name: nfsnfs:path: /data/volumesserver: stor01

---

apiVersion: v1

kind: Pod

metadata:name: myapp02-nfsnamespace: default

spec:containers:- name: myappimage: ikubernetes/myapp:v1imagePullPolicy: IfNotPresentvolumeMounts:- name: nfsmountPath: /usr/share/nginx/htmlreadOnly: falserestartPolicy: AlwaysnodeSelector:kubernetes.io/hostname: node01volumes:- name: nfsnfs:path: /data/volumesserver: 192.168.198.14

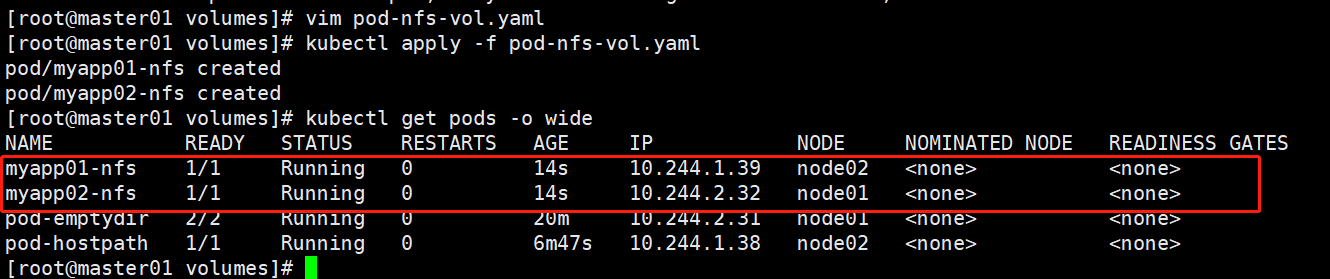

kubectl apply -f pod-nfs-vol.yaml

kubectl get pods -o wide

stor01节点操作

#在nfs服务器上创建index.html

cd /data/volumes

vim index.html

<h1> nfs stor01</h1>

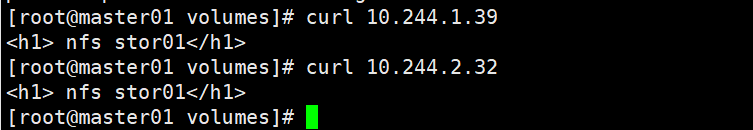

master节点操作

#master节点操作

curl 10.244.1.39<h1> nfs stor01</h1>curl 10.244.2.32<h1> nfs stor01</h1>

#删除nfs相关pod,再重新创建,可以得到数据的持久化存储

kubectl delete -f pod-nfs-vol.yaml

kubectl apply -f pod-nfs-vol.yaml

kubectl exec -it myapp01-nfs sh

cd /usr/share/nginx/html/

echo "this is node2" >> index.html

cat index.html

exit

总:共享存储挂载,nfs只要不挂,则数据就不会丢失

四.PV和PVC

1.PV、PVC概念

(1)PV 个称叫做 Persistent volume使持久化存储卷。它是用来描述或者说用来定义一个存储卷的,这个通常都是由运维工程师来定义。

(2)PVC 的全称是 Persistent Volume claim,是持久化存储的请求。它是用来描述希望使用什么样的或者说是满足什么条件的 PV 存储。

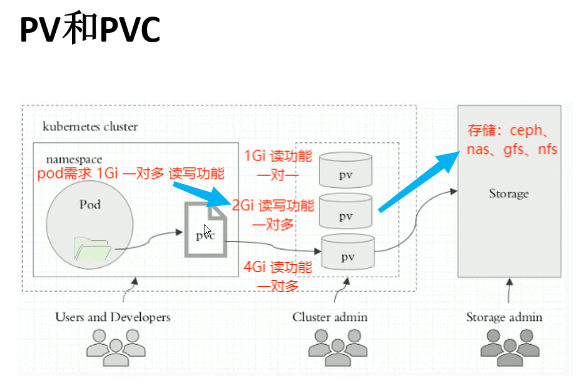

2.PVC 的使用逻辑及数据流向

(1)定义:在 Pod 中定义一个存储卷 (该存储卷类型为 PVC),定义的时候直接指定大小,PVC 必须与对应的PV 建立关系,PVC 会根据配置的定义去 PV 申请,而P V 是由存储空间创建出来的。PV 和 PVC 是 Kubernetes抽象出来的一种存储资源。

(2)数据流向

3.storageclass插件

(1)storageclass插件概念

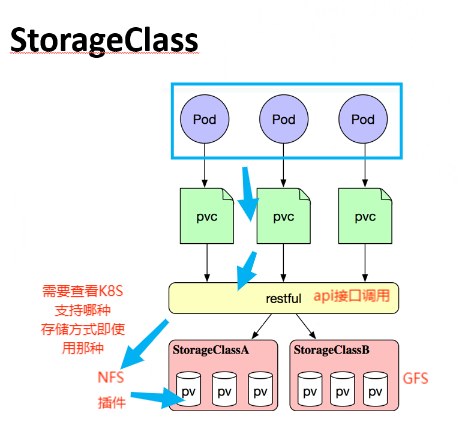

Pv和Pc模式是需要运维人员先创建好PV,然后开发人员定义好PVC进行一对一的绑定,但是如果PVC请求成千上万,那么就需要创建成千上万的PV,对于运维人员来说维护成本很高,Kubernetes提供一种自动创建PV的机制,叫storageclass,它的作用就是创建PV的模板。

创建 storageclass 需要定义 PV 的属性,比如存储类型、大小等;另外创建这种 PV 需要用到的存储插件,比如Ceph 等。 有了这两部分信息,Kubernetes 就能够根据用户提交的 PVC,找到对应的 storaqeclass,然后Kubernetes 就会调用 storageclass 声明的存储插件,自动创建需要的 PV 并进行绑定。

(2)StorageClass插件数据流向

pod需求到pvc,通过api接口调用,通过存储插件调用storageclass插件到达PVC进行创建。

PV是集群中的资源。PVC是对这些资源的请求,也是对资源的索引检查。

4.PV和PVC之间的相互作用及PV 的状态

(1)生命周期

Provisioning (配置)——Binding (绑定)——Using(使用)——Releasing (释放)——Recycling (回收)

注解:

-

Provisioning:即PV的创建,可以直接创建 PV (静态方式),也可以使用 storageclass 动态创建——(管理员)

-

Binding (绑定):将PV 分配给 PVC——使用者

-

Using:Pod 通过 PVC 使用该 Volume,并可以通过准入控制storageProtection(1.9及以前版本为PvcProtection)阻止删除正在使用的 PVC

-

Releasing:Pod 释放 Volume 并删除 PVC

-

Reclaiming:回收 PV,可以保留 PV 以便下次使用,也可以直接从云存储中删除

(2)PV 的状态

根据这 5 个阶段,PV 的状态有以下 4 种:

- Available (可用):表示可用状态,还未被任何 PVC 绑定

- Bound (已绑定):表示 PV 已经绑定到 PVC

- Released (已释放):表示 PVC 被删掉,但是资源尚未被集群回收

- Eailed (失败):表示该 PV 的自动回收失败

(3)pv创建到销毁的整个流程

一个PV从创建到销毁的具体流程如下:

- 一个PV创建完后状态会变成Available,等待被PVC绑定

- 一旦被PVC绑定,PV的状态会变成Bound,就可以被定义了相应PVC的Pod使用

- Pod使用完后会释放PV,PV的状态变成Released

- 变成Released的PV会根据定义的回收策略做相应的回收工作。有三种回收策略,Retain、Delete和Recycle。Retain就是保留现场,K8S集群什么也不做,等待用户手动去处理PV里的数据,处理完后,再手动删除PV。Delete策略,K8S会自动删除该PV及里面的数据。Recycle方式,K8S会将PV里的数据删除,然后把PV的状态变成Available,又可以被新的PVC绑定使用。

5.PV和PVC基础操作

(1)查看pv的定义方式

kubectl explain pvFIELDS:apiVersion: v1kind: PersistentVolumemetadata: #由于 PV 是集群级别的资源,即 PV 可以跨 namespace 使用,所以 PV 的 metadata 中不用配置 namespacename: spec

(2)查看pv定义的规格

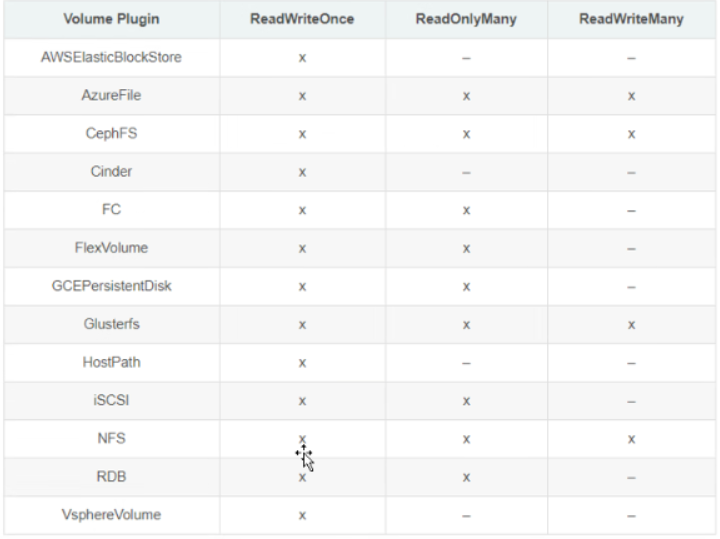

kubectl explain pv.specspec:nfs:(定义存储类型)path:(定义挂载卷路径)server:(定义服务器名称)accessModes:(定义访问模型,有以下三种访问模型,以列表的方式存在,也就是说可以定义多个访问模式)- ReadWriteOnce #(RWO)存储可读可写,但只支持被单个 Pod 挂载- ReadOnlyMany #(ROX)存储可以以只读的方式被多个 Pod 挂载- ReadWriteMany #(RWX)存储可以以读写的方式被多个 Pod 共享 注:官网

#nfs 支持全部三种;iSCSI 不支持 ReadWriteMany(iSCSI 就是在 IP 网络上运行 SCSI 协议的一种网络存储技术);HostPath 不支持 ReadOnlyMany 和 ReadWriteMany。capacity:(定义存储能力,一般用于设置存储空间)storage: 2Gi (指定大小)storageClassName: (自定义存储类名称,此配置用于绑定具有相同类别的PVC和PV)persistentVolumeReclaimPolicy: Retain #回收策略(Retain/Delete/Recycle)

#Retain(保留):当删除与之绑定的PVC时候,这个PV被标记为released(PVC与PV解绑但还没有执行回收策略)且之前的数据依然保存在该PV上,但是该PV不可用,需要手动来处理这些数据并删除该PV。

#Delete(删除):删除与PV相连的后端存储资源(只有 AWS EBS, GCE PD, Azure Disk 和 Cinder 支持)

#Recycle(回收):删除数据,效果相当于执行了 rm -rf /thevolume/* (只有 NFS 和 HostPath 支持)

(3)查看PVC的定义方式

kubectl explain pvcKIND: PersistentVolumeClaim

VERSION: v1

FIELDS:apiVersion <string>kind <string> metadata <Object>spec <Object>#PV和PVC中的spec关键字段要匹配,比如存储(storage)大小、访问模式(accessModes)、存储类名称(storageClassName)

kubectl explain pvc.spec

spec:accessModes: (定义访问模式,必须是PV的访问模式的子集)resources:requests:storage: (定义申请资源的大小)storageClassName: (定义存储类名称,此配置用于绑定具有相同类别的PVC和PV)

6.k8s支持的存储插件的访问方式

7.NFS使用PV、PVC静态示例

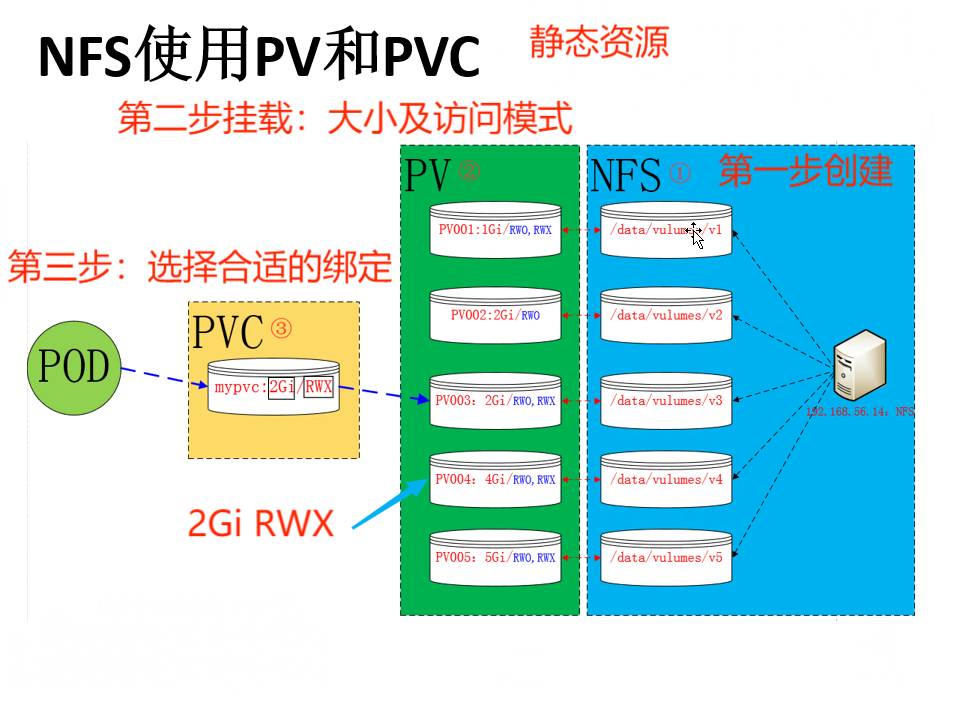

(1)NFS使用PV、PVC图示

pvc绑定PV的条件:大小和访问模式

(2)NFS使用PV、PVC配置

①配置nfs存储

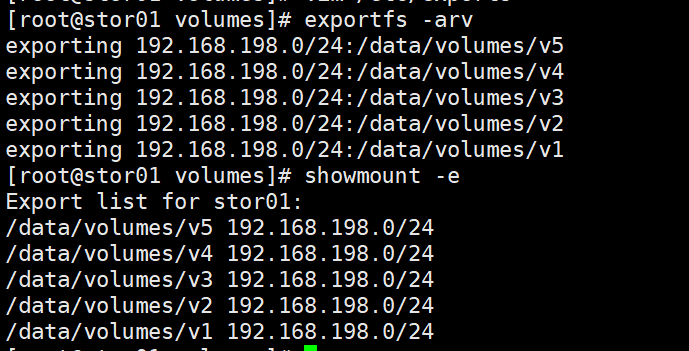

stor01节点操作

mkdir /data/volumes -p

cd /data/volumes/

mkdir v{1,2,3,4,5}

vim /etc/exports

/data/volumes/v1 192.168.10.0/24(rw,no_root_squash)

/data/volumes/v2 192.168.10.0/24(rw,no_root_squash)

/data/volumes/v3 192.168.10.0/24(rw,no_root_squash)

/data/volumes/v4 192.168.10.0/24(rw,no_root_squash)

/data/volumes/v5 192.168.10.0/24(rw,no_root_squash)

exportfs -arv

showmount -e

官方文档:https://kubernetes.io/zh-cn/docs/tasks/configure-pod-container/configure-persistent-volume-storage/#create-a-persistentvolume

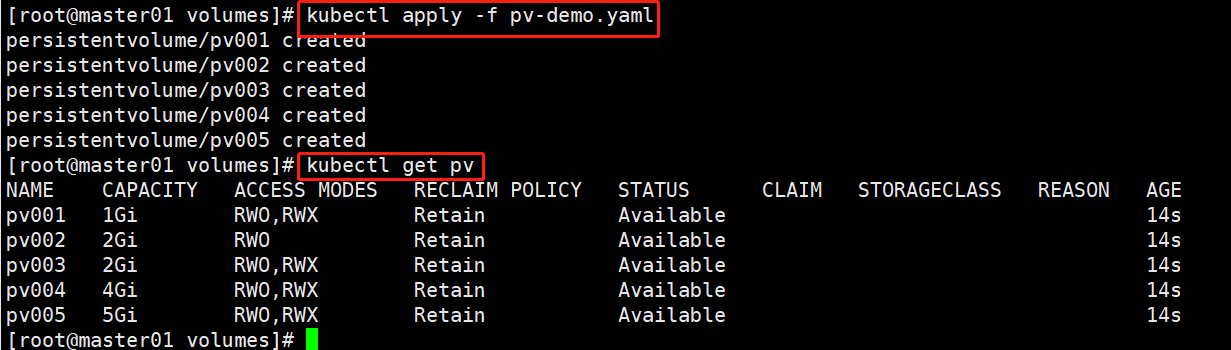

②定义PV

master节点操作

#这里定义5个PV,并且定义挂载的路径以及访问模式,还有PV划分的大小。

vim pv-demo.yamlapiVersion: v1

kind: PersistentVolume

metadata:name: pv001labels:name: pv001

spec:nfs:path: /data/volumes/v1server: stor01accessModes: ["ReadWriteMany","ReadWriteOnce"]capacity:storage: 1Gi

---apiVersion: v1

kind: PersistentVolume

metadata:name: pv002labels:name: pv002

spec:nfs:path: /data/volumes/v2server: stor01accessModes: ["ReadWriteOnce"]capacity:storage: 2Gi

---apiVersion: v1

kind: PersistentVolume

metadata:name: pv003labels:name: pv003

spec:nfs:path: /data/volumes/v3server: stor01accessModes: ["ReadWriteMany","ReadWriteOnce"]capacity:storage: 2Gi

---apiVersion: v1

kind: PersistentVolume

metadata:name: pv004labels:name: pv004

spec:nfs:path: /data/volumes/v4server: stor01accessModes: ["ReadWriteMany","ReadWriteOnce"]capacity:storage: 4Gi

---apiVersion: v1

kind: PersistentVolume

metadata:name: pv005labels:name: pv005

spec:nfs:path: /data/volumes/v5server: stor01accessModes: ["ReadWriteMany","ReadWriteOnce"]capacity:storage: 5Gi

kubectl apply -f pv-demo.yaml

kubectl get pv

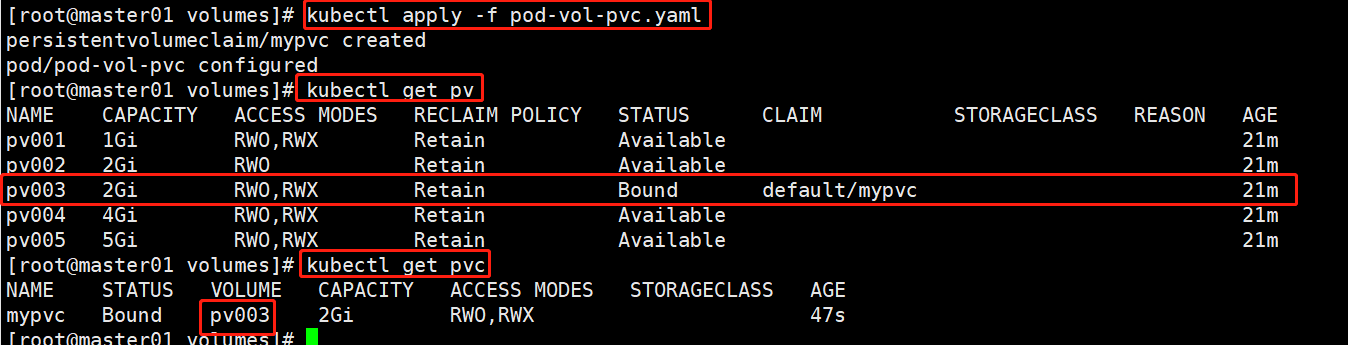

③定义PVC

master节点操作

这里定义了pvc的访问模式为多路读写,该访问模式必须在前面pv定义的访问模式之中。定义PVC申请的大小为2Gi,此时PVC会自动去匹配多路读写且大小为2Gi的PV,匹配成功获取PVC的状态即为Bound

vim pod-vol-pvc.yamlapiVersion: v1

kind: PersistentVolumeClaim

metadata:name: mypvcnamespace: default

spec:accessModes: ["ReadWriteMany"]resources:requests:storage: 2Gi

---

apiVersion: v1

kind: Pod

metadata:name: pod-vol-pvcnamespace: default

spec:containers:- name: myappimage: ikubernetes/myapp:v1volumeMounts:- name: htmlmountPath: /usr/share/nginx/htmlvolumes:- name: htmlpersistentVolumeClaim:claimName: mypvc

kubectl apply -f pod-vol-pvc.yaml

kubectl get pv

kubectl get pvc

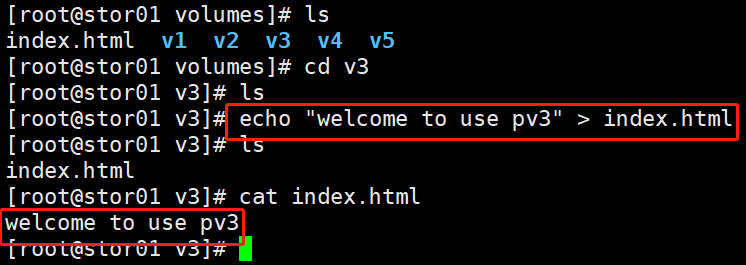

④测试访问

stor01节点操作

在存储服务器上创建index.html,并写入数据,通过访问Pod进行查看,可以获取到相应的页面。

cd /data/volumes/v3/

echo "welcome to use pv3" > index.html

master节点操作

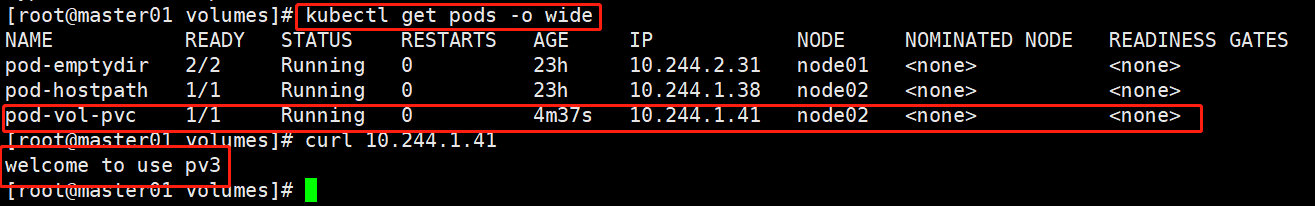

kubectl get pods -o wide

curl 10.244.1.41welcome to use pv3

8.搭建 StorageClass + NES实现 NES 的动态 PV 创建

(1)外部存储卷插件

Kubernetes 本身支持的动态 PV 创建不包括 NFS,所以需要使用外部存储卷插件分配PV。详见:https://kubernetes.io/zh/docs/concepts/storage/storage-classes/

(2)卷插件概念

卷插件称为 Provisioner(存储分配器),NFS 使用的是 nfs-client,这个外部卷插件会使用已经配置好的 NFS 服务器自动创建 PV。

Provisioner:用于指定 Volume 插件的类型,包括内置插件(如 kubernetes.io/aws-ebs)和外部插件(如 external-storage 提供的 ceph.com/cephfs)。

(3)配置 StorageClass + NES实现 NES 的动态 PV 创建

①在stor01节点上安装nfs,并配置nfs服务

mkdir /opt/k8s

chmod 777 /opt/k8s/

vim /etc/exports

/opt/k8s 192.168.198.0/24(rw,no_root_squash,sync)

systemctl restart nfs

②创建 Service Account,用来管理 NFS Provisioner 在 k8s 集群中运行的权限,设置 nfs-client 对 PV,PVC,StorageClass 等的规则

在master节点操作

如果复制需要提前进入配置时:set paste再复制粘贴脚本即可正常

vim nfs-client-rbac.yaml

#创建 Service Account 账户,用来管理 NFS Provisioner 在 k8s 集群中运行的权限

apiVersion: v1

kind: ServiceAccount

metadata:name: nfs-client-provisioner

---

#创建集群角色

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRole

metadata:name: nfs-client-provisioner-clusterrole

rules:- apiGroups: [""]resources: ["persistentvolumes"]verbs: ["get", "list", "watch", "create", "delete"]- apiGroups: [""]resources: ["persistentvolumeclaims"]verbs: ["get", "list", "watch", "update"]- apiGroups: ["storage.k8s.io"]resources: ["storageclasses"]verbs: ["get", "list", "watch"]- apiGroups: [""]resources: ["events"]verbs: ["list", "watch", "create", "update", "patch"]- apiGroups: [""]resources: ["endpoints"]verbs: ["create", "delete", "get", "list", "watch", "patch", "update"]

---

#集群角色绑定

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRoleBinding

metadata:name: nfs-client-provisioner-clusterrolebinding

subjects:

- kind: ServiceAccountname: nfs-client-provisionernamespace: default

roleRef:kind: ClusterRolename: nfs-client-provisioner-clusterroleapiGroup: rbac.authorization.k8s.io

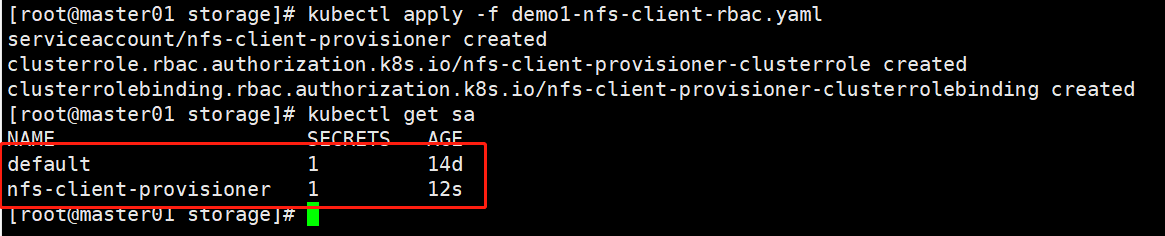

kubectl apply -f nfs-client-rbac.yaml

kubectl get sa

③使用 Deployment 来创建 NFS Provisioner

在master节点操作

NFS Provisione(即 nfs-client),有两个功能:一个是在 NFS 共享目录下创建挂载点(volume),另一个则是将 PV 与 NFS 的挂载点建立关联。

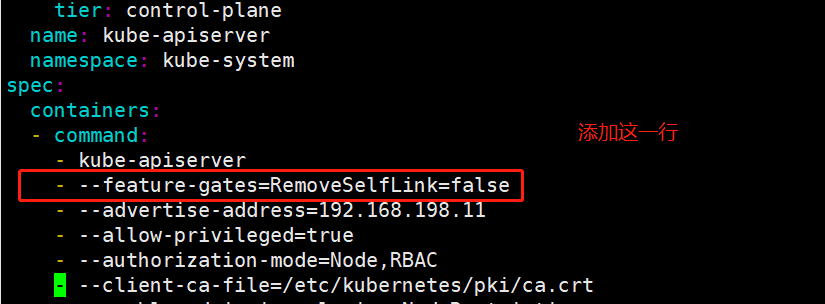

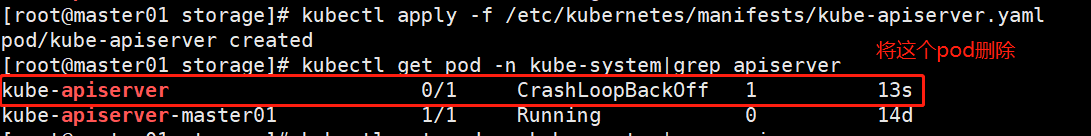

#由于 1.20 版本启用了 selfLink,所以 k8s 1.20+ 版本通过 nfs provisioner 动态生成pv会报错,解决方法如下:

vim /etc/kubernetes/manifests/kube-apiserver.yaml

spec:containers:- command:- kube-apiserver- --feature-gates=RemoveSelfLink=false #添加这一行- --advertise-address=192.168.198.11

......

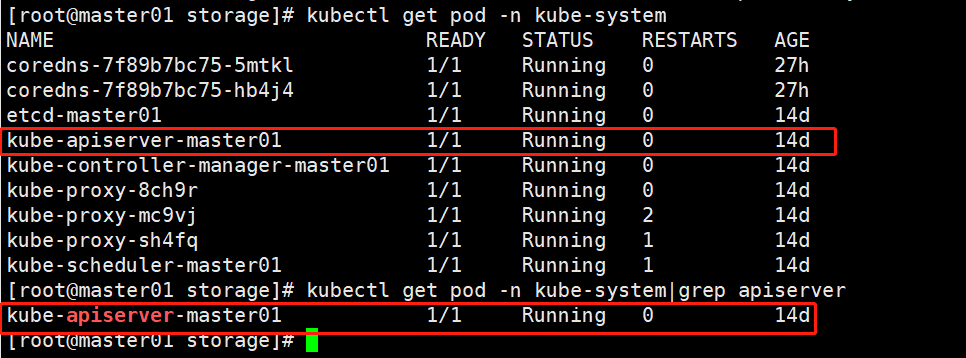

kubectl get pod -n kube-system

或

kubectl get pod -n kube-system|grep apiserver

kubectl apply -f /etc/kubernetes/manifests/kube-apiserver.yaml

kubectl get pod -n kube-system|grep apiserver

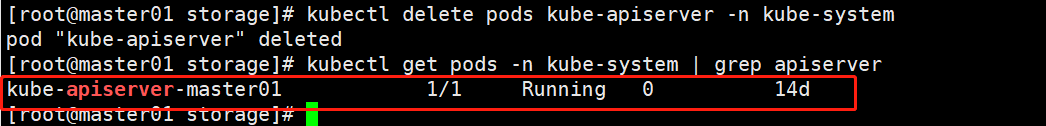

kubectl delete pods kube-apiserver -n kube-system

kubectl get pods -n kube-system | grep apiserver

#创建 NFS Provisioner

vim nfs-client-provisioner.yamlvim nfs-client-provisioner.yaml

kind: Deployment

apiVersion: apps/v1

metadata:name: nfs-client-provisioner

spec:replicas: 1selector:matchLabels:app: nfs-client-provisionerstrategy:type: Recreatetemplate:metadata:labels:app: nfs-client-provisionerspec:serviceAccountName: nfs-client-provisioner #指定Service Account账户containers:- name: nfs-client-provisionerimage: quay.io/external_storage/nfs-client-provisioner:latestimagePullPolicy: IfNotPresentvolumeMounts:- name: nfs-client-rootmountPath: /persistentvolumesenv:- name: PROVISIONER_NAMEvalue: nfs-storage #配置provisioner的Name,确保该名称与StorageClass资源中的provisioner名称保持一致- name: NFS_SERVERvalue: stor01 #配置绑定的nfs服务器- name: NFS_PATHvalue: /opt/k8s #配置绑定的nfs服务器目录volumes: #申明nfs数据卷- name: nfs-client-rootnfs:server: stor01path: /opt/k8s

#查看node节点是否有stor01的地址映射

vim /etc/hosts

192.168.198.14 stor01

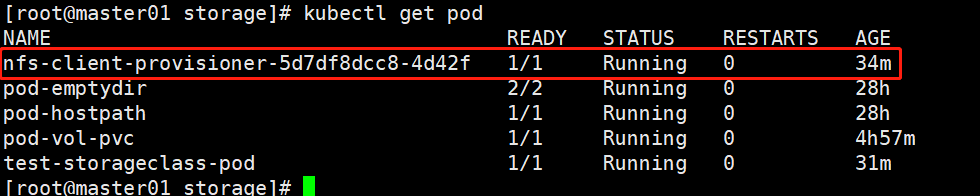

kubectl apply -f nfs-client-provisioner.yaml

kubectl get pod

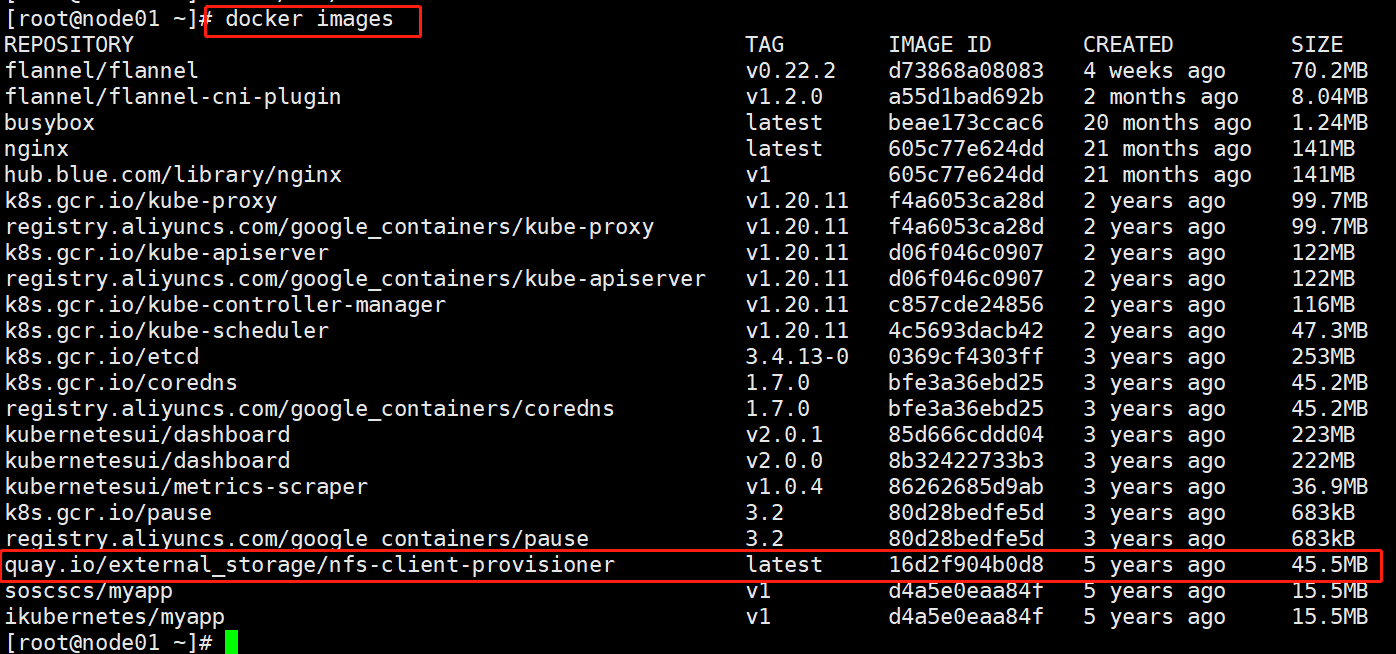

#在node节点可以查看到容器

docker images

#查看拉下来的容器镜像

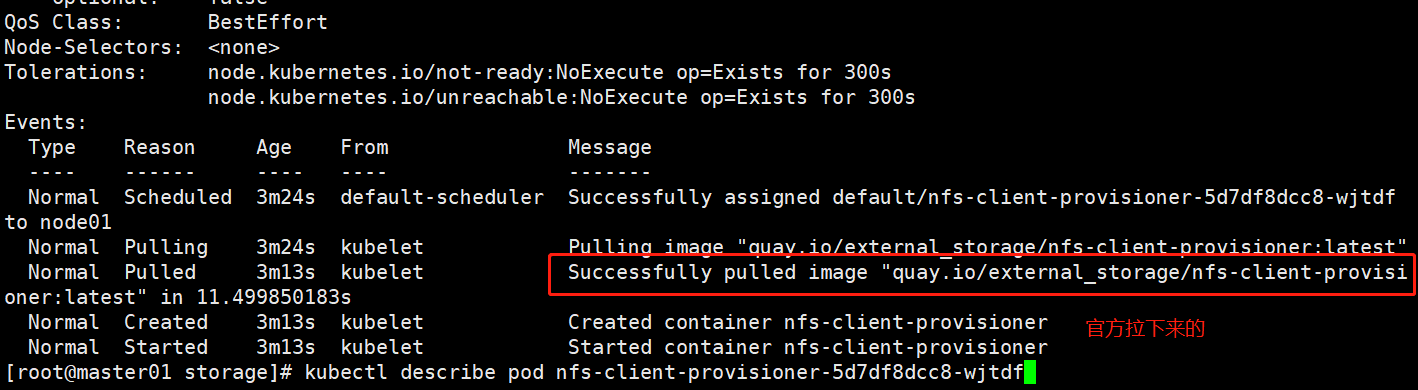

kubectl describe pod nfs-client-provisioner-5d7df8dcc8-wjtdf

#如果拉不下来可以使用镜像安装包导入

docker load -i nfs-client-provisioner

④创建 StorageClass,负责建立 PVC 并调用 NFS provisioner 进行预定的工作,并让 PV 与 PVC 建立关联

vim nfs-client-storageclass.yamlapiVersion: storage.k8s.io/v1

kind: StorageClass

metadata:name: nfs-client-storageclass

provisioner: nfs-storage #这里的名称要和provisioner配置文件中的环境变量PROVISIONER_NAME保持一致

parameters:archiveOnDelete: "false" #false表示在删除PVC时不会对数据进行存档,即删除数据

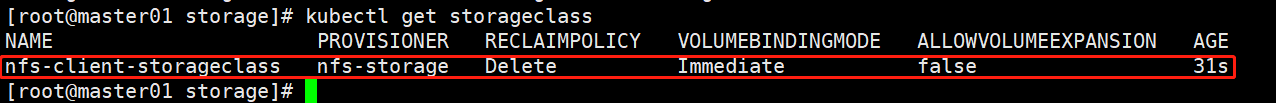

kubectl apply -f nfs-client-storageclass.yaml

kubectl get storageclass

⑤创建 PVC 和 Pod 测试

vim test-pvc-pod.yamlapiVersion: v1

kind: PersistentVolumeClaim

metadata:name: test-nfs-pvc

spec:accessModes:- ReadWriteManystorageClassName: nfs-client-storageclass #关联StorageClass对象resources:requests:storage: 1Gi

---

apiVersion: v1

kind: Pod

metadata:name: test-storageclass-pod

spec:containers:- name: busyboximage: busybox:latestimagePullPolicy: IfNotPresentcommand:- "/bin/sh"- "-c"args:- "sleep 3600"volumeMounts:- name: nfs-pvcmountPath: /mntrestartPolicy: Nevervolumes:- name: nfs-pvcpersistentVolumeClaim:claimName: test-nfs-pvc #与PVC名称保持一致

kubectl apply -f test-pvc-pod.yaml

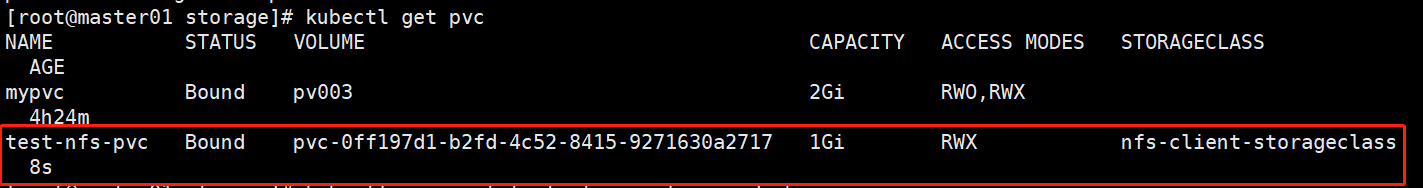

#PVC 通过 StorageClass 自动申请到空间

kubectl get pvc

NAME STATUS VOLUME CAPACITY ACCESS MODES STORAGECLASS AGE

mypvc Bound pv003 2Gi RWO,RWX 4h24m

test-nfs-pvc Bound pvc-0ff197d1-b2fd-4c52-8415-9271630a2717 1Gi RWX nfs-client-storageclass

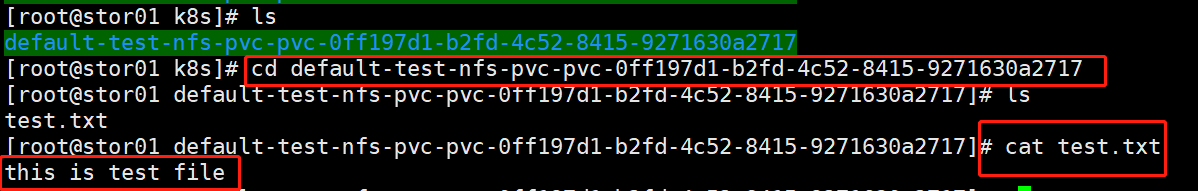

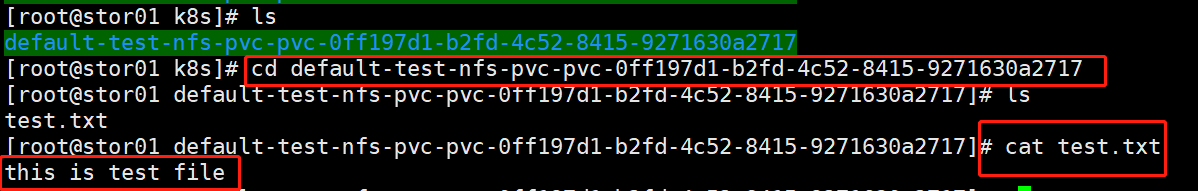

stor01节点操作

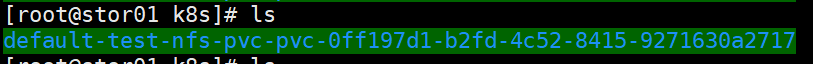

#查看 NFS 服务器上是否生成对应的目录,自动创建的 PV 会以 ${namespace}-${pvcName}-${pvName} 的目录格式放到 NFS 服务器上

ls /opt/k8s/default-test-nfs-pvc-pvc-0ff197d1-b2fd-4c52-8415-9271630a2717

master节点操作**

进入 Pod 在挂载目录 /mnt 下写一个文件,然后查看 NFS 服务器上是否存在该文件

kubectl exec -it test-storageclass-pod sh

/ # cd /mnt/

/mnt # echo 'this is test file' > test.txt

stor01节点操作

#发现 NFS 服务器上存在,说明验证成功

cd default-test-nfs-pvc-pvc-0ff197d1-b2fd-4c52-8415-9271630a2717

总:

1.三个存储卷

(1)emptyDir: 可以实现pod 中的容器之间共享数据,但是存储卷不能持久化数据,且会随着pod生命周结束而一起删除

(2)hostpath:可以实现持久化存储,使用node节点的目录或文件挂载到容器,但是存储空会收到node节点单机限制,node节点故险数据就会丢失,pod跨node节点不能共享数据

(3)nfs:可以实现持久化存储,使用nfs存储设备空间挂载到容器,pod可以跨node节点共享数据

2.PV和PVC

(1)pv是K8S在指定的存储设备空间创建的可持久化的存储资源

(2)PVC是对PV存储资源的请求和绑定

3.storageClass

storageClass简称:SC(存储类)是联动存储卷插件,根据PVC请求动态创建OV资源

4.静态PV的使用及创建PV、PVC和Pod的过程

(1)提前准备存储设备和共享目录

(2)创建PV资源:配置存储卷类型、访问模式、存储能力的大小

(3)创建PVC资源:配置请求PV、资源的访问模式和存储大小、绑定PV,PVC和PV是一对一的绑定关系

(4)PV访问模式必须支持PVC,请求访问模式,请求的存储空间会优先选择存储大小的PV资源;如果没有会选择大于请求的存储大小的PV资源

(5)创建pod资源:存储卷的类型需要设置成为PVC,在容器配置中一定要配置存储卷的挂载

相关文章:

K8S:Pod容器中的存储方式及PV、PVC

文章目录 Pod容器中的存储方式一.emptyDir存储卷1.emptyDir存储卷概念2.emptyDir存储卷示例 二.hostPath存储卷1.hostPath存储卷概念2.hostPath存储卷示例 三.nfs共享存储卷1.nfs共享存储卷示例 四.PV和PVC1.PV、PVC概念2.PVC 的使用逻辑及数据流向3.storageclass插…...

uni-app跳转到另一个app

第一步: 首先要知道 app的包名 获取方式如下 第二步: 在第一个 demo1 app 一个页面中需要一个按钮去跳转 方法如下 <template><view class"content"><button click"tz">跳转</button></view> </…...

如何通过一键导出导入数据实现批量重命名文件名称

在日常办公中,我们经常需要对大量的文件进行重命名,以便更好地管理和查找文件。而且,有时候我们还需要将文件名称翻译成其他语言,以适应不同的工作需求。如何高效地完成这项任务呢?接下来,我将介绍一种方法…...

CTF —— 网络安全大赛(这不比王者好玩吗?)

前言 随着大数据、人工智能的发展,人们步入了新的时代,逐渐走上科技的巅峰。 \ ⚔科技是一把双刃剑,网络安全不容忽视,人们的隐私在大数据面前暴露无遗,账户被盗、资金损失、网络诈骗、隐私泄露,种种迹象…...

3D模型转换工具HOOPS Exchange如何实现OBJ格式轻量化?

什么是OBJ模型轻量化? OBJ格式是一种常用的三维模型文件格式,通常包含模型的顶点、法线、纹理坐标等信息,但有时候这些信息可能会使模型文件变得较大,不利于网络传输、加载和运行。 OBJ(Object)模型轻量化…...

命令模式-

定义:又叫动作模式或事务模式。指的是将一个请求封装成一个对象,使发出请求的责任和执行请求的责任分割开,然后可以使用不同的请求把客户端参数化,这样可以使得两者之间通过命令对象进行沟通,从而方便将命令对象进行储…...

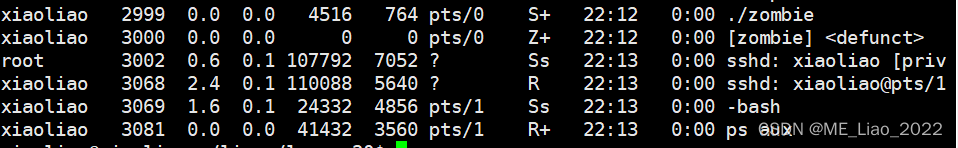

进程的管理

#include <unistd.h> void _exit(int status); #include <stdlib.h> void _Exit(int status); status参数:是进程退出时的状态信息,父进程在回收子进程资源的时候可以获取到 #include<stdio.h> #include<stdlib.h> #includ…...

绿色科技:可持续发展的创新解决方案

标题绿色科技:可持续发展的创新解决方案 摘要引言绿色能源创新1. 太阳能和风能2. 储能技术 可再生资源管理3. 智能农业4. 循环经济 智能城市的未来5. 智能交通6. 城市感知 可持续生活方式7. 可持续建筑8. 智能家居 总结参考资料 博主 默语带您 Go to New World. ✍ …...

安防视频/视频汇聚平台EasyCVR使用onvif探测添加设备通道详细步骤来啦!

视频云存储/安防监控EasyCVR视频汇聚平台基于云边端智能协同,支持海量视频的轻量化接入与汇聚、转码与处理、全网智能分发、视频集中存储等。音视频流媒体视频平台EasyCVR拓展性强,视频能力丰富,具体可实现视频监控直播、视频轮播、视频录像、…...

)

Python单例模式(3种常用方式)

Python单例模式 1、使用模块(推荐)2、使用装饰器3、使用new()方法 单例模式是最常见的一种设计模式,该模式确保系统中一个类仅有一个实例 常用的三种实现方式如下: 1、使用模块(推荐) 模块是天然单例的&a…...

uni-app实现web-view图片长按下载

<template><view><web-view :webview-styles"webviewStyles" :src"webUrl"></web-view></view> </template> uniapp的web-view中图片无法长按保存,IOS下是正常的,但是Android下长按无反应 解…...

深入理解Linux网络笔记(一):内核是如何接收网络包的

本文为《深入理解Linux网络》学习笔记,使用的Linux源码版本是3.10,网卡驱动是Intel的igb网卡驱动 Linux源码在线阅读:https://elixir.bootlin.com/linux/v3.10/source 1、内核是如何接收网络包的 1)、Linux网络收包总览 在TCP/I…...

android系统目录结构

文章目录 android系统目录结构问答偏好设置保存在哪里在应用设置中点击清除数据,清除的是什么在应用设置中点击清除缓存,清除的是什么 参考 android系统目录结构 /- system (一般只有root权限才能访问)- data- app (存放应用程序的 APK 文件…...

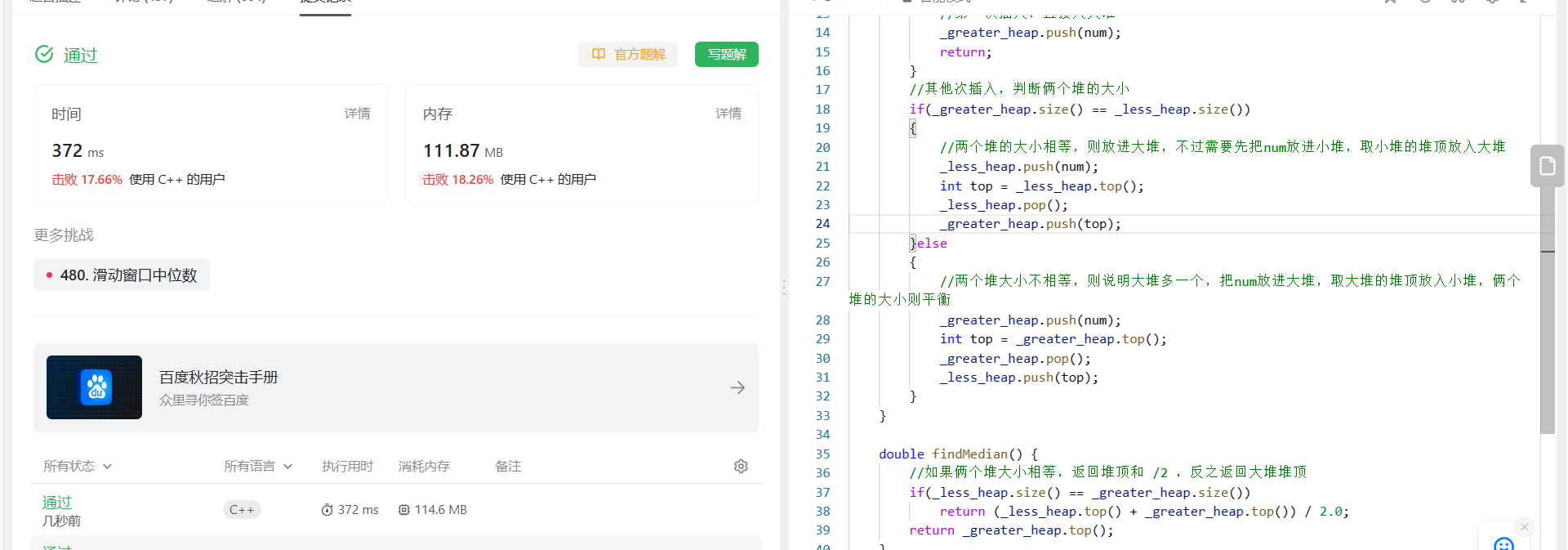

怒刷LeetCode的第11天(Java版)

目录 第一题 题目来源 题目内容 解决方法 方法一:迭代 方法二:递归 方法三:指针转向 第二题 题目来源 题目内容 解决方法 方法一:快慢指针 方法二:Arrays类的sort方法 方法三:计数器 方法四…...

CentOS LVM缩容与扩容步骤

为VM打快照;备份home数据;# yum install xfsdump -y [root@testCentos7 home]# xfsdump -f /dev/home.dump /home xfsdump: using file dump (drive_simple) strategy xfsdump: version 3.1.7 (dump format 3.0) - type ^C for status and control ===================…...

开发者福利!李彦宏将在百度世界大会手把手教你做AI原生应用

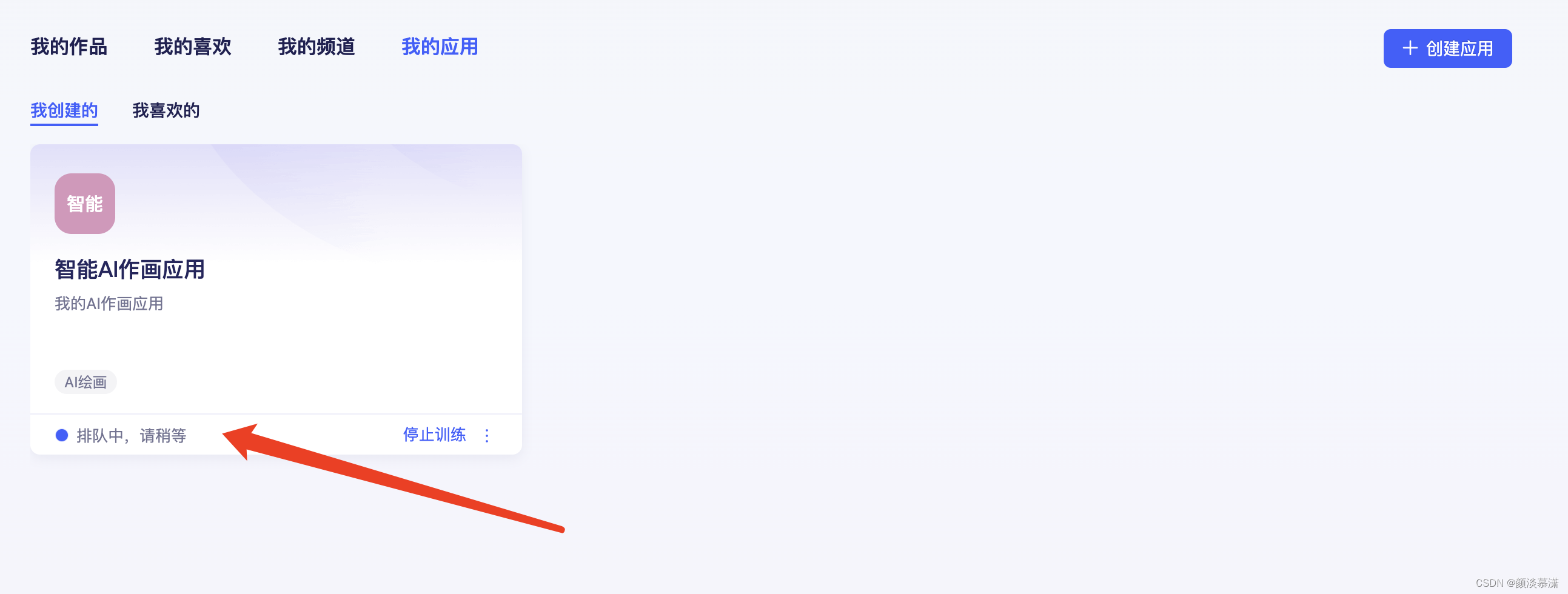

目录 一、写在前面 二、大模型社区 2.1 加入频道 2.2 创建应用 一、写在前面 1. “把最先进的技术用到极致,把最先进的应用做到极致。” 2. “每个产品都在热火朝天地重构,不断加深对AI原生应用的理解。” 3. “这就是真正的AI原生应用,这…...

堆的OJ题

🔥🔥 欢迎来到小林的博客!! 🛰️博客主页:✈️林 子 🛰️博客专栏:✈️ 小林的算法笔记 🛰️社区 :✈️ 进步学堂 &am…...

物联网网关:连接设备与云端的桥梁

物联网网关作为连接设备与云端的桥梁,承担着采集数据、设备远程控制、协议转换、数据传输等重要任务。物联网网关是一种网络设备,它可以连接多个物联网设备,实现设备之间的数据传输和通信。物联网网关通常具有较高的网络带宽和处理能力&#…...

ChatGPT企业版来了,速度翻倍,无使用限制

美国时间8月28日,OpenAI宣布了自ChatGPT推出以来最重大的新闻:将推出ChatGPT企业版,企业版ChatGPT将直接对接GPT-4,提供无限制访问、高级数据分析功能、定制服务等服务,并支持处理更长文本输入的长上下文窗口。 OpenAI…...

opencv图像像素类型转换与归一化

文章目录 opencv图像像素类型转换与归一化1、为什么对图像像素类型转换与归一化2、在OpenCV中,convertTo() 和 normalize() 是两个常用的图像处理函数,用于图像像素类型转换和归一化;(1)convertTo() 函数用于将一个 cv…...

linux之kylin系统nginx的安装

一、nginx的作用 1.可做高性能的web服务器 直接处理静态资源(HTML/CSS/图片等),响应速度远超传统服务器类似apache支持高并发连接 2.反向代理服务器 隐藏后端服务器IP地址,提高安全性 3.负载均衡服务器 支持多种策略分发流量…...

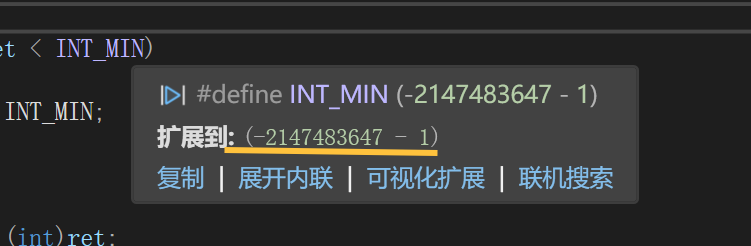

练习(含atoi的模拟实现,自定义类型等练习)

一、结构体大小的计算及位段 (结构体大小计算及位段 详解请看:自定义类型:结构体进阶-CSDN博客) 1.在32位系统环境,编译选项为4字节对齐,那么sizeof(A)和sizeof(B)是多少? #pragma pack(4)st…...

无法与IP建立连接,未能下载VSCode服务器

如题,在远程连接服务器的时候突然遇到了这个提示。 查阅了一圈,发现是VSCode版本自动更新惹的祸!!! 在VSCode的帮助->关于这里发现前几天VSCode自动更新了,我的版本号变成了1.100.3 才导致了远程连接出…...

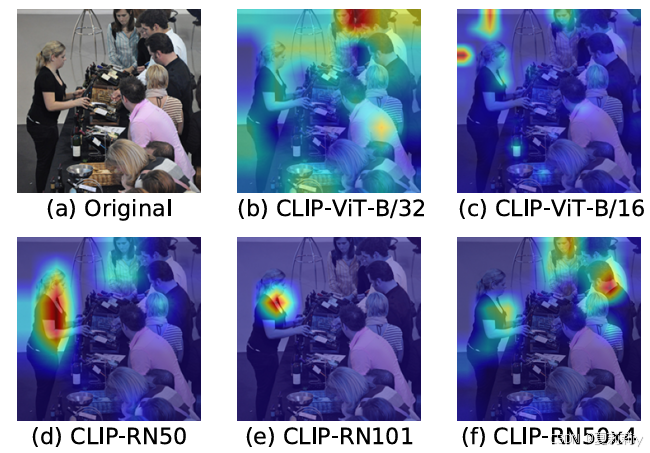

[ICLR 2022]How Much Can CLIP Benefit Vision-and-Language Tasks?

论文网址:pdf 英文是纯手打的!论文原文的summarizing and paraphrasing。可能会出现难以避免的拼写错误和语法错误,若有发现欢迎评论指正!文章偏向于笔记,谨慎食用 目录 1. 心得 2. 论文逐段精读 2.1. Abstract 2…...

el-switch文字内置

el-switch文字内置 效果 vue <div style"color:#ffffff;font-size:14px;float:left;margin-bottom:5px;margin-right:5px;">自动加载</div> <el-switch v-model"value" active-color"#3E99FB" inactive-color"#DCDFE6"…...

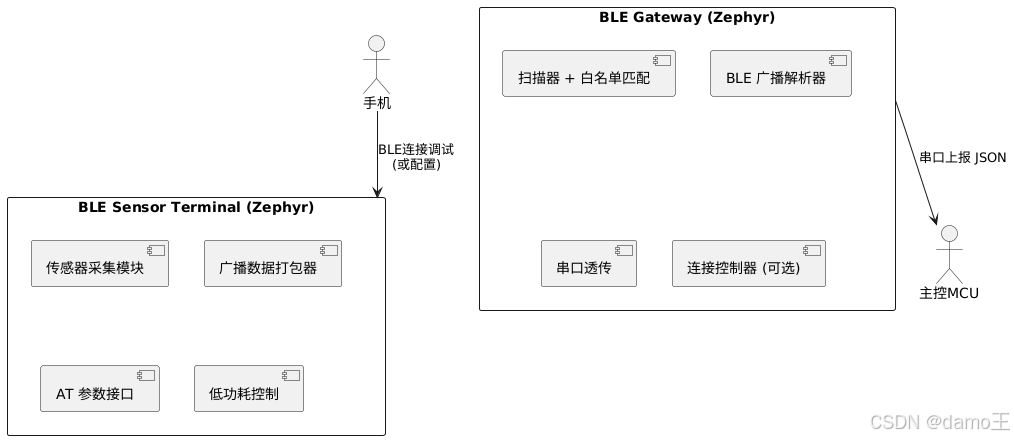

【Zephyr 系列 10】实战项目:打造一个蓝牙传感器终端 + 网关系统(完整架构与全栈实现)

🧠关键词:Zephyr、BLE、终端、网关、广播、连接、传感器、数据采集、低功耗、系统集成 📌目标读者:希望基于 Zephyr 构建 BLE 系统架构、实现终端与网关协作、具备产品交付能力的开发者 📊篇幅字数:约 5200 字 ✨ 项目总览 在物联网实际项目中,**“终端 + 网关”**是…...

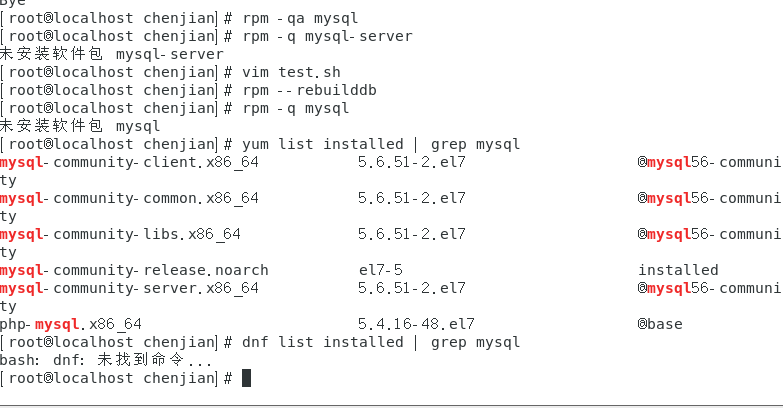

mysql已经安装,但是通过rpm -q 没有找mysql相关的已安装包

文章目录 现象:mysql已经安装,但是通过rpm -q 没有找mysql相关的已安装包遇到 rpm 命令找不到已经安装的 MySQL 包时,可能是因为以下几个原因:1.MySQL 不是通过 RPM 包安装的2.RPM 数据库损坏3.使用了不同的包名或路径4.使用其他包…...

Python 高效图像帧提取与视频编码:实战指南

Python 高效图像帧提取与视频编码:实战指南 在音视频处理领域,图像帧提取与视频编码是基础但极具挑战性的任务。Python 结合强大的第三方库(如 OpenCV、FFmpeg、PyAV),可以高效处理视频流,实现快速帧提取、压缩编码等关键功能。本文将深入介绍如何优化这些流程,提高处理…...

从物理机到云原生:全面解析计算虚拟化技术的演进与应用

前言:我的虚拟化技术探索之旅 我最早接触"虚拟机"的概念是从Java开始的——JVM(Java Virtual Machine)让"一次编写,到处运行"成为可能。这个软件层面的虚拟化让我着迷,但直到后来接触VMware和Doc…...

[特殊字符] Spring Boot底层原理深度解析与高级面试题精析

一、Spring Boot底层原理详解 Spring Boot的核心设计哲学是约定优于配置和自动装配,通过简化传统Spring应用的初始化和配置流程,显著提升开发效率。其底层原理可拆解为以下核心机制: 自动装配(Auto-Configuration) 核…...