Kubernetes二进制部署 单节点

目录

1.环境准备

1.关闭防火墙和selinux

2.关闭swap

3.设置主机名

4.在master添加hosts

5.桥接的IPv4流量传递到iptables的链

6.时间同步

2.部署etcd集群

1.master节点部署

2.在node1与node2节点修改

3.在master1节点上进行启动

4.部署docker引擎

3.部署 Master 组件

1.在 master01 节点上操作

4.部署node组件

5.flannel网络配置

1.K8S中Pod网络通信

2.Flannel工作原理

3.在所有node01 节点上操作

4.在 master01 节点上操作

1.环境准备

| k8s集群master01 | 192.168.156.10 | kube-apiserver kube-controller-manager kube-scheduler etcd | 2核2G |

| k8s集群node1 | 192.168.156.140 | kubelet kube-proxy docker flannel | 2核2G |

| k8s集群node2 | 192.168.156.150 | kubelet kube-proxy docker flannel | 2核2G |

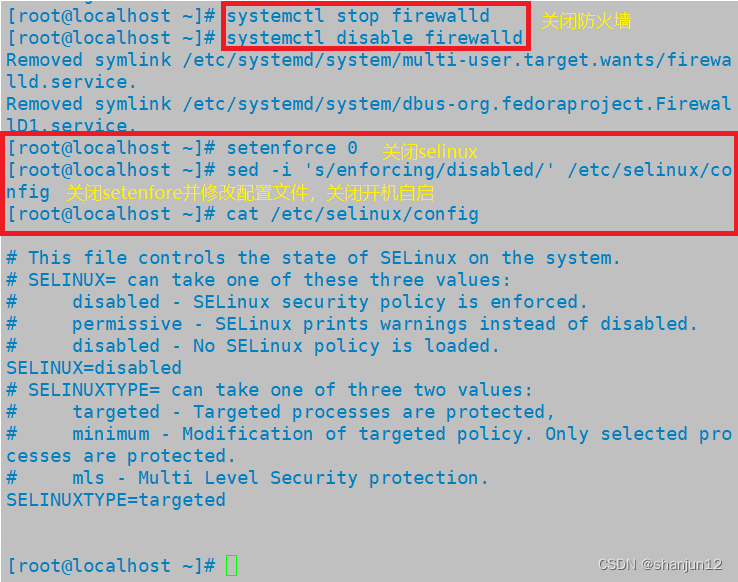

1.关闭防火墙和selinux

systemctl stop firewalld

systemctl disable firewalldsetenforce 0 #临时关闭

sed -i 's/enforcing/disabled/' /etc/selinux/config #永久关闭

2.关闭swap

swapoff -a

sed -ri 's/.*swap.*/#&/' /etc/fstab

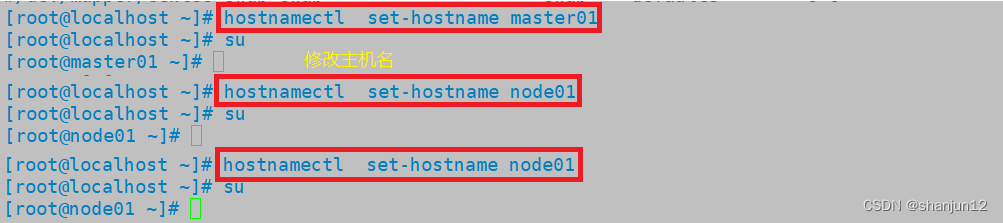

3.设置主机名

hostnamectl set-hostname master01

hostnamectl set-hostname node01

hostnamectl set-hostname node02

4.在master添加hosts

cat >> /etc/hosts <<EOF

192.168.156.10 master01

192.168.156.140 node01

192.168.156.150 node02

EOF

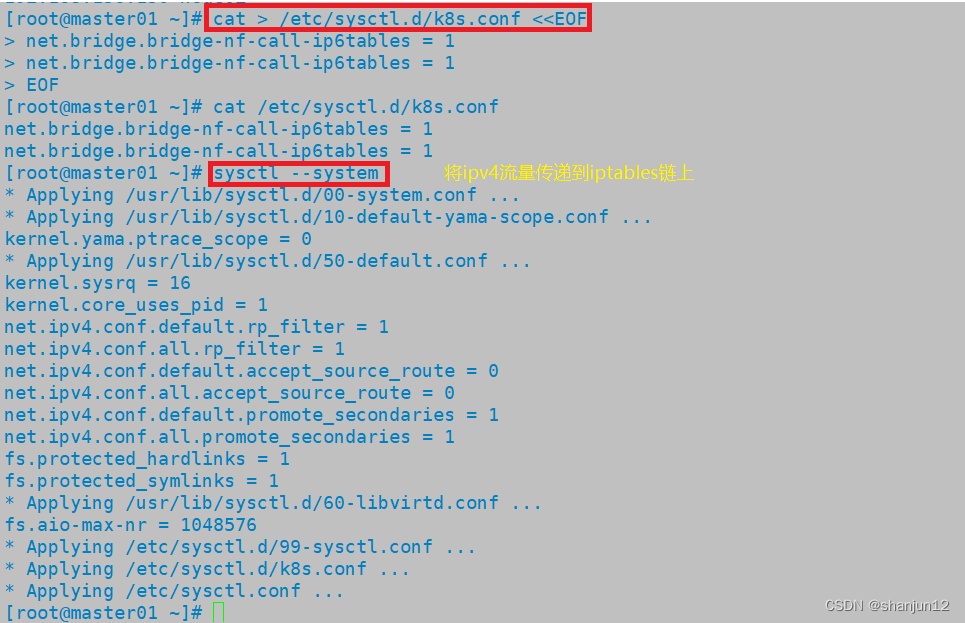

5.将桥接的IPv4流量传递到iptables的链

cat > /etc/sysctl.d/k8s.conf <<EOF

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-ip6tables = 1

EOF<br><br>sysctl --system

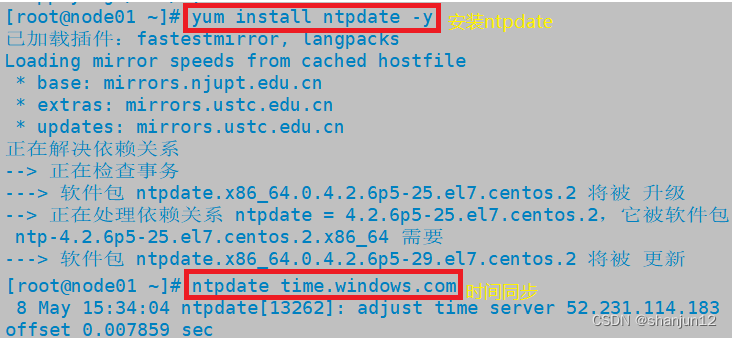

6.时间同步

yum -y install ntpdate

ntpdate time.windows.com

2.部署etcd集群

tcd作为服务发现系统,有以下的特点:

(1) 简单、安装配置简单,而且提供了HTTP API进行交互,使用也很简单;

(2)安全: 支持SSL证书验证;

(3)快速: 单实例支持每秒2k+读操作;

(4)可靠: 采用raft算法实现分布式系统数据的可用性和一致性。

准备签发证书环境:

CFSSL是CloudFlare 公司开源的一款PKI/TLS工具。CESSL 包含一个命令行工具和一个用于签名、验证和捆绑TLS证书的HTTP API服务。使用Go语言编写。

CFSSL使用配置文件生成证书,因此自签之前,需要生成它识别的json 格式的配置文件,CFSSL 提供了方便的命令行生成配置文件。

CFSSL用来为etcd提供TLS证书,它支持签三种类型的证书:

1、client证书,服务端连接客户端时携带的证书,用于客户端验证服务端身份,如kube-apiserver 访问etcd;

2、server证书,客户端连接服务端时携带的证书,用于服务端验证客户端身份,如etcd对外提供服务:

3、peer证书,相互之间连接时使用的证书,如etcd节点之间进行验证和通信。

这里全部都使用同一套证书认证。

注:etcd这里就不做集群了,直接部署在master节点上

1.master节点部署

(1)下载证书制作工具

curl -L https://pkg.cfssl.org/R1.2/cfssl_linux-amd64 -o /usr/local/bin/cfssl

curl -L https://pkg.cfssl.org/R1.2/cfssljson_linux-amd64 -o /usr/local/bin/cfssljson

curl -L https://pkg.cfssl.org/R1.2/cfssl-certinfo_linux-amd64 -o /usr/local/bin/cfssl-certinfo<br>或者wget https://pkg.cfssl.org/R1.2/cfssl_linux-amd64 -O /usr/local/bin/cfssl

wget https://pkg.cfssl.org/R1.2/cfssljson_linux-amd64 -O /usr/local/bin/cfssljson

wget https://pkg.cfssl.org/R1.2/cfssl-certinfo_linux-amd64 -O /usr/local/bin/cfssl-certinfochmod +x /usr/local/bin/cfssl /usr/local/bin/cfssljson /usr/local/bin/cfssl-certinfo chmod +x /usr/local/bin/cfssl cfssl: 证书签发的工具命令

cfssljson: 将cfssl 生成的证书( json格式)变为文件承载式证书

cfssl-certinfo:验证证书的信息

cfssl-certinfo -cert <证书名称>

(2)查看证书的信息

(3)创建k8s工作目录

mkdir /opt/k8s

cd /opt/k8s/

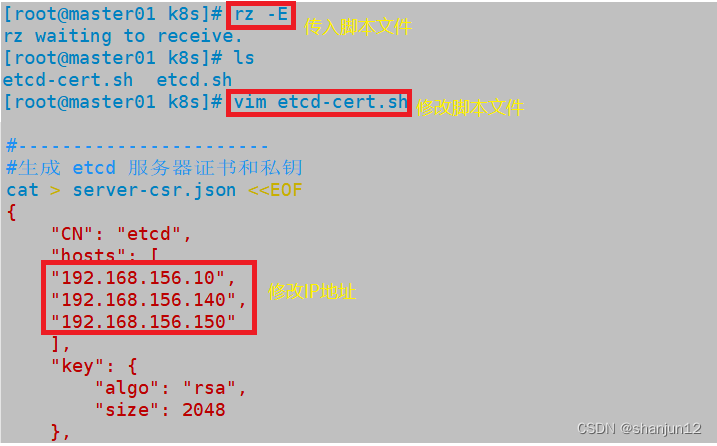

(4)上传etcd-cert.sh 和etcd.sh 到/opt/k8s/ 目录中

文件下载:etcd-cert.sh etcd.sh

chmod +x etcd-cert.sh etcd. sh

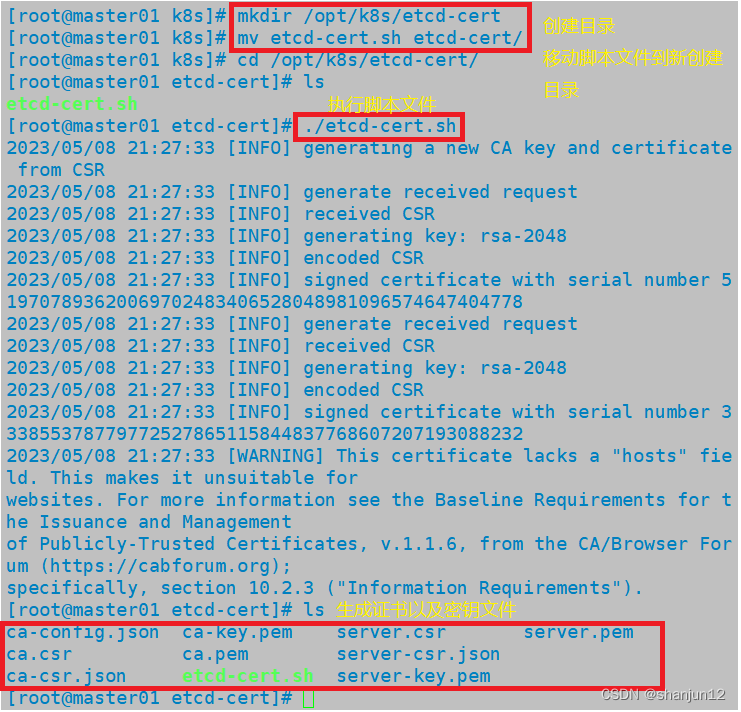

(5)创建用于生成CA证书、etcd服务器证书以及私钥的目录

mkdir /opt/k8s/etcd-certmv etcd-cert.sh etcd-cert/

cd /opt/k8s/etcd-cert/

./etcd-cert.sh 生成CA证书、etcd服务器证书以及私钥

etcd二进制包地址: https://github.com/etcd-io/etcd/releases

(6)上传etcd-v3.3.10-1inux-amd64.tar.gz 到/opt/k8s/ 目录中,解压etcd 压缩包

cd /opt/k8s/

tar zxvf etcd-v3.3.10-linux-amd64.tar.gz

1s etcd-v3.3.10-linux-amd64

Documentation etcd etcdctl README-etcdctl.md README.md

READMEv2-etcdctl.md etcd就是etcd服务的启动命令,后面可跟各种启动参数

etcdct1主要为etcd服务提供了命令行操作

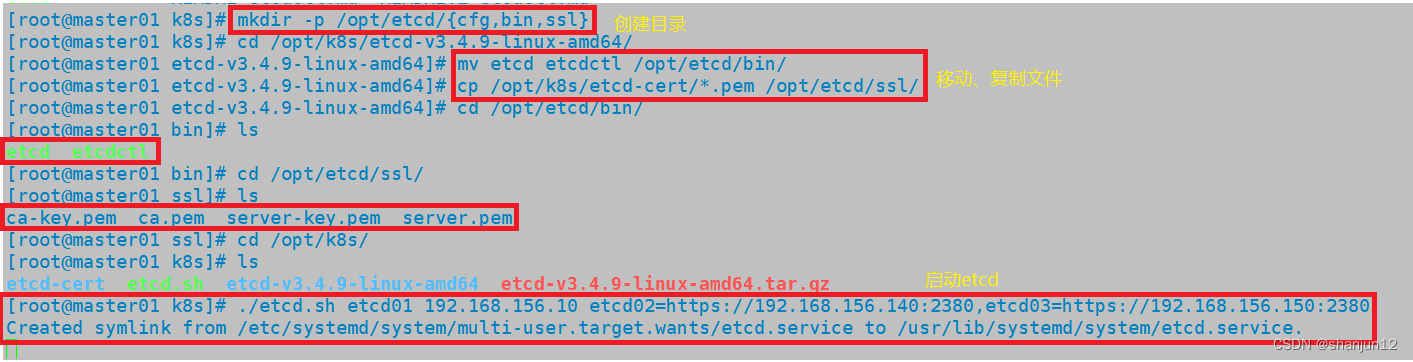

(7)创建用于存放etcd配置文件,命令文件,证书的目录

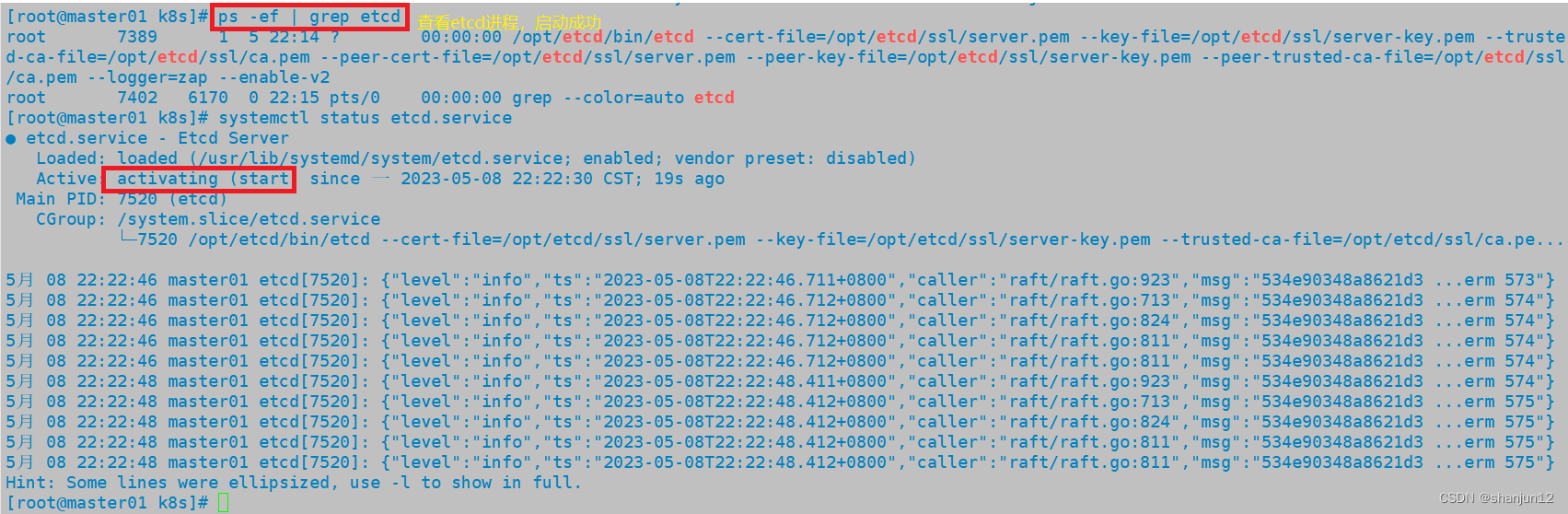

进入卡住状态等待其他节点加入,这里需要三台etcd服务同时启动,如果只启动其中一台后,服务会卡在那里,直到集群中所有etcd节点都已启动,可忽略这个情况

mkdir -p /opt/etcd/{cfg,bin,ssl}

mv /opt/k8s/etcd-v3.4.9-linux- amd64/etcd /opt/k8s/etcd-v3.4.9-1inux-amd64/etcdct1 /opt/etcd/bin/

cp /opt/k8s/etcd-cert/*.pem /opt/etcd/ssl/

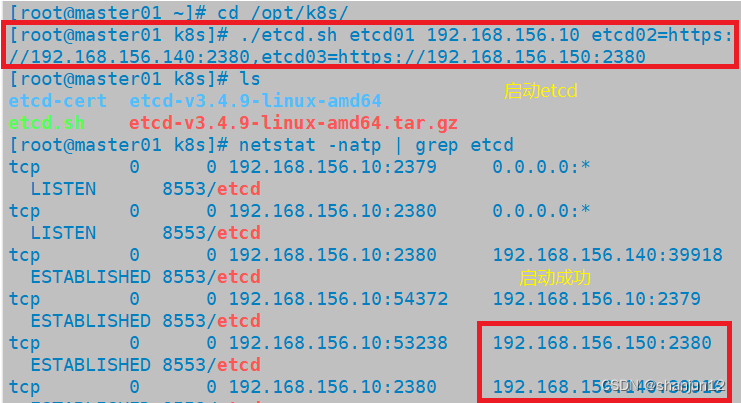

./etcd.sh etcd01 192.168.156.10 etcd02=https://192.168.156.140:2380,etcd03=https://192.168.156.150:2380

可另外打开一个窗口查看etcd进程是否正常

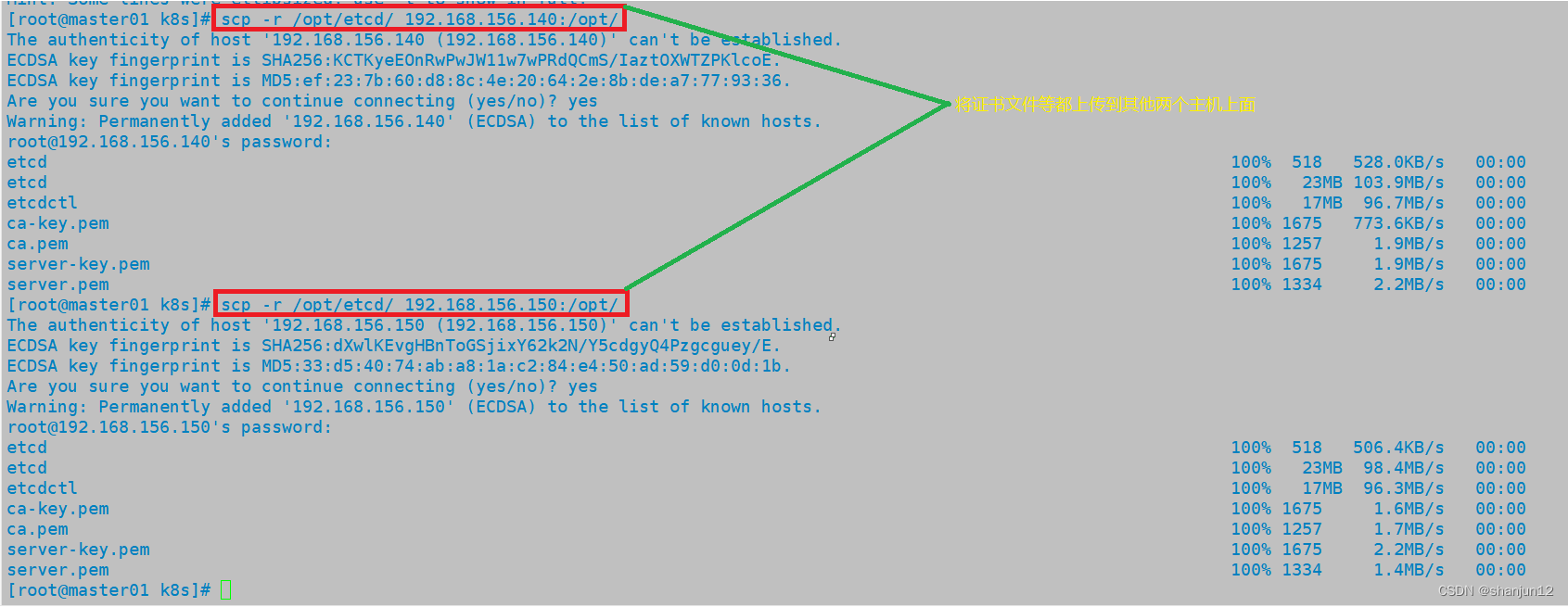

(8)把etcd相关证书文件和命令文件全部拷贝到另外两个etcd集群节点

scp -r /opt/etcd/ root@192.168.156.140:/opt/

scp -r /opt/etcd/ root@192.168.156.150:/opt/

(9)把etcd服务管理文件拷贝到另外两个etcd集群节点

scp /usr/lib/systemd/system/etcd.service root@192.168.156.140:/usr/lib/systemd/system/

scp /usr/lib/systemd/system/etcd.service root@192.168.156.150:/usr/lib/systemd/system/

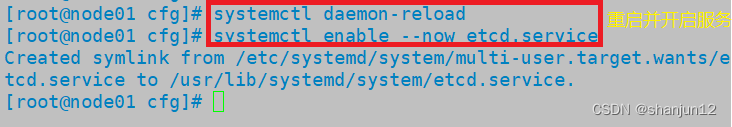

2.在node1与node2节点修改

(1)在node1节点修改

cd /opt/etcd/cfg/

vim etcd

#[Member]

ETCD_NAME="etcd02"

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://192.168.156.140:2380"

ETCD_LISTEN_CLIENT_URLS="https://192.168.156.140:2379"#[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://192.168.156.140:2380"

ETCD_ADVERTISE_CLIENT_URLS="https://192.168.156.140:2379"

ETCD_INITIAL_CLUSTER="etcd01=https://192.168.156.10:2380,etcd02=https://192.168.156.140:2380,etcd03=https://192.168.156.150:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

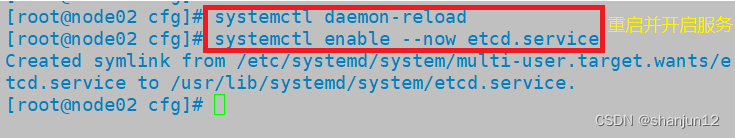

ETCD_INITIAL_CLUSTER_STATE="new"systemctl daemon-reload

systemctl enable --now etcd.service

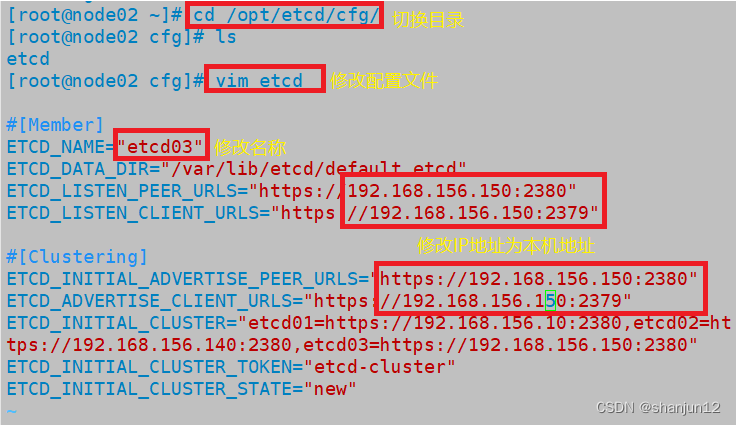

(2)在node2节点修改

cd /opt/etcd/cfg/

vim etcd

#[Member]

ETCD_NAME="etcd03"

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://192.168.156.150:2380"

ETCD_LISTEN_CLIENT_URLS="https://192.168.156.150:2379"#[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://192.168.156.150:2380"

ETCD_ADVERTISE_CLIENT_URLS="https://192.168.156.150:2379"

ETCD_INITIAL_CLUSTER="etcd01=https://192.168.156.10:2380,etcd02=https://192.168.156.140:2380,etcd03=https://192.168.156.150:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

ETCD_INITIAL_CLUSTER_STATE="new"systemctl daemon-reload

systemctl enable --now etcd.service

3.在master1节点上进行启动

(1)首先在master1节点上进行启动

cd /root/k8s/

./etcd.sh etcd01 192.168.156.10 etcd02=https://192.168.156.140:2380,etcd03=https://192.168.156.150:2380

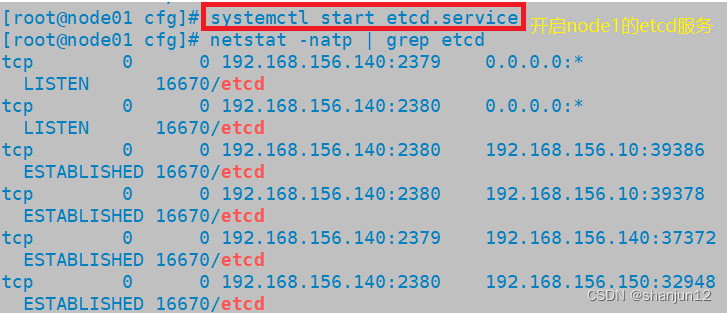

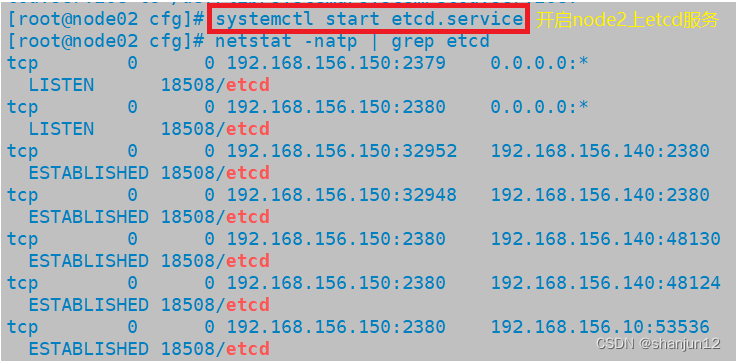

(2)在node1和node2节点分别进行启动

systemctl start etcd.service

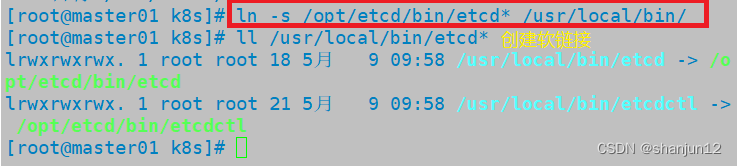

(3)在master1 节点上操作

1n -s /opt/etcd/bin/etcd* /usr/1oca1/bin

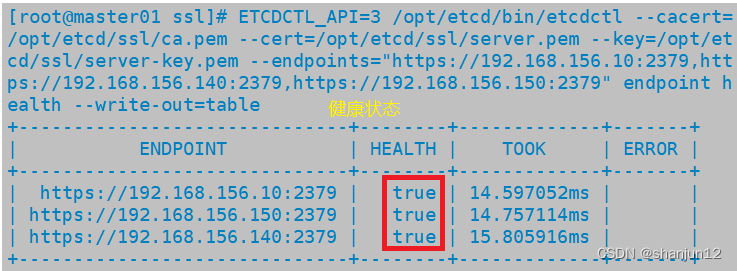

(4)检查etcd群集状态

ETCDCTL_API=3 /opt/etcd/bin/etcdctl --cacert=/opt/etcd/ssl/ca.pem --cert=/opt/etcd/ssl/server.pem --key=/opt/etcd/ssl/server-key.pem --endpoints="https://192.168.156.10:2379,https://192.168.156.140:2379,https://192.168.156.150:2379" endpoint health --write-out=table

(5)查看etcd集群成员列表

ETCDCTL_API=3 /opt/etcd/bin/etcdctl --cacert=/opt/etcd/ssl/ca.pem --cert=/opt/etcd/ssl/server.pem --key=/opt/etcd/ssl/server-key.pem --endpoints="https://192.168.156.10:2379,https://192.168.156.140:2379,https://192.168.156.150:2379" --write-out=table member list

4.部署docker引擎

所有node节点部署docker引擎

yum install -y yum-utils device-mapper-persistent-data 1vm2

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

yum install -y docker-ce dqsker-ce-cli containerd.iosystemctl start docker.service

systemct1 enable docker.service

3.部署 Master 组件

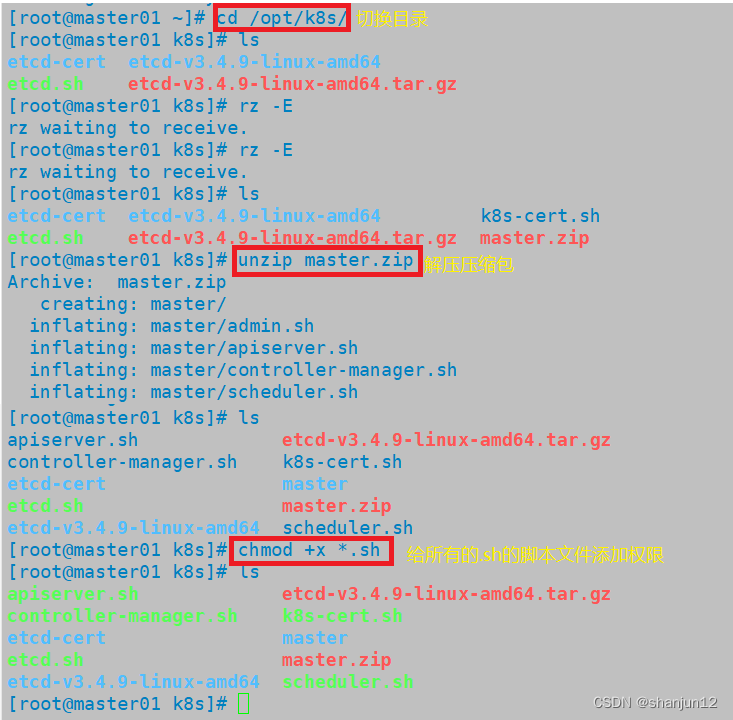

1.在 master01 节点上操作

(1)上传 master.zip 和 k8s-cert.sh 到 /opt/k8s 目录中,解压 master.zip 压缩包

cd /opt/k8s/

unzip master.zip

chmod +x *.sh

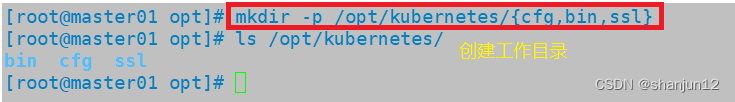

(2)创建kubernetes工作目录

mkdir -p /opt/kubernetes/{cfg,bin,ssl}

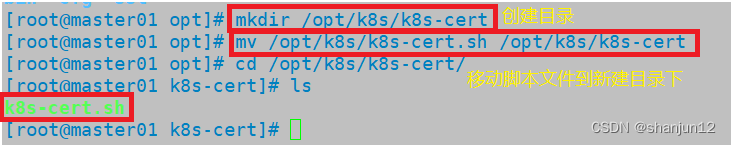

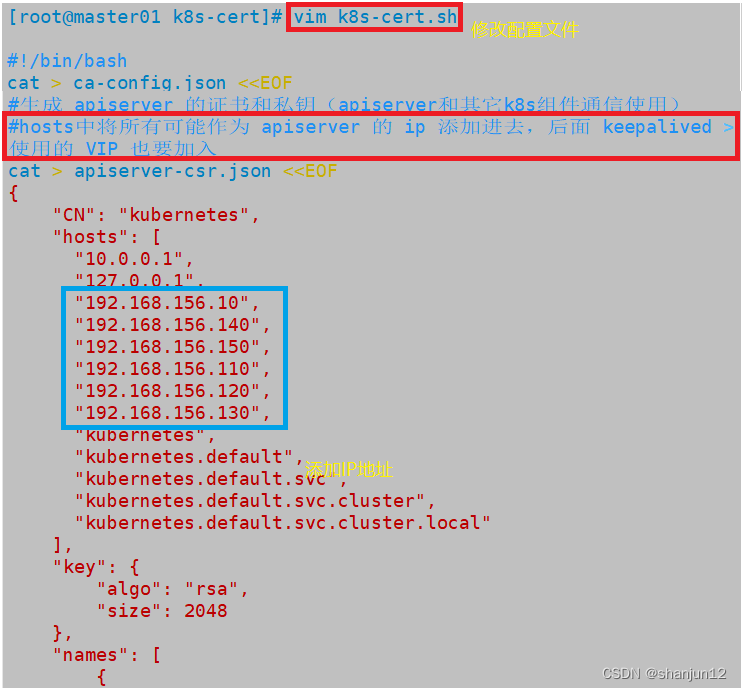

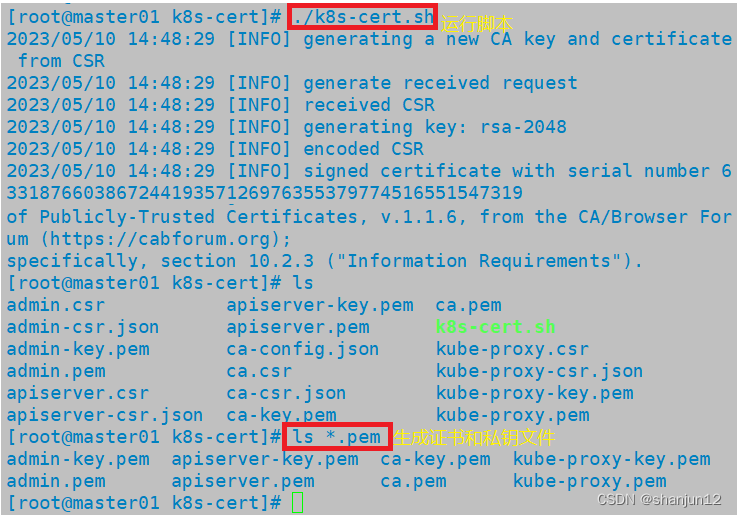

(3)创建用于生成CA证书、相关组件的证书和私钥的目录

mkdir /opt/k8s/k8s-cert

mv /opt/k8s/k8s-cert.sh /opt/k8s/k8s-cert

cd /opt/k8s/k8s-cert/

./k8s-cert.sh

controller-manager和kube-scheduler设置为只调用当前机器的apiserver, 使用127.0.0.1:8080 通信,因此不需要签发证书

(4)复制CA证书、apiserver 相关证书和私钥到kubernetes. 工作目录的ssl子目录中

cp ca*pem apiserver*pem /opt/kubernetes/ssl/

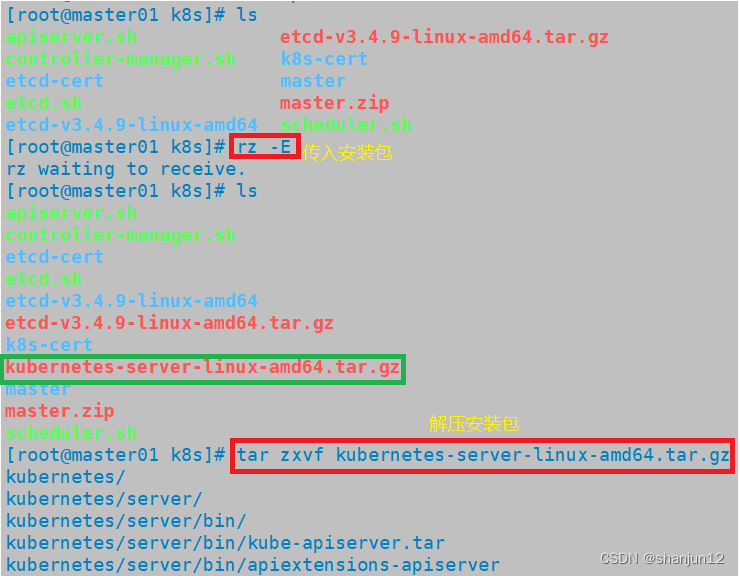

(5)上传kubernetes-server-linux-amd64.tar.gz 到/opt/k8s/ 目录中,解压kubernetes 压缩包

cd /opt/k8s/

tar zxvf kubernetes-server-linux-amd64.tar.gz

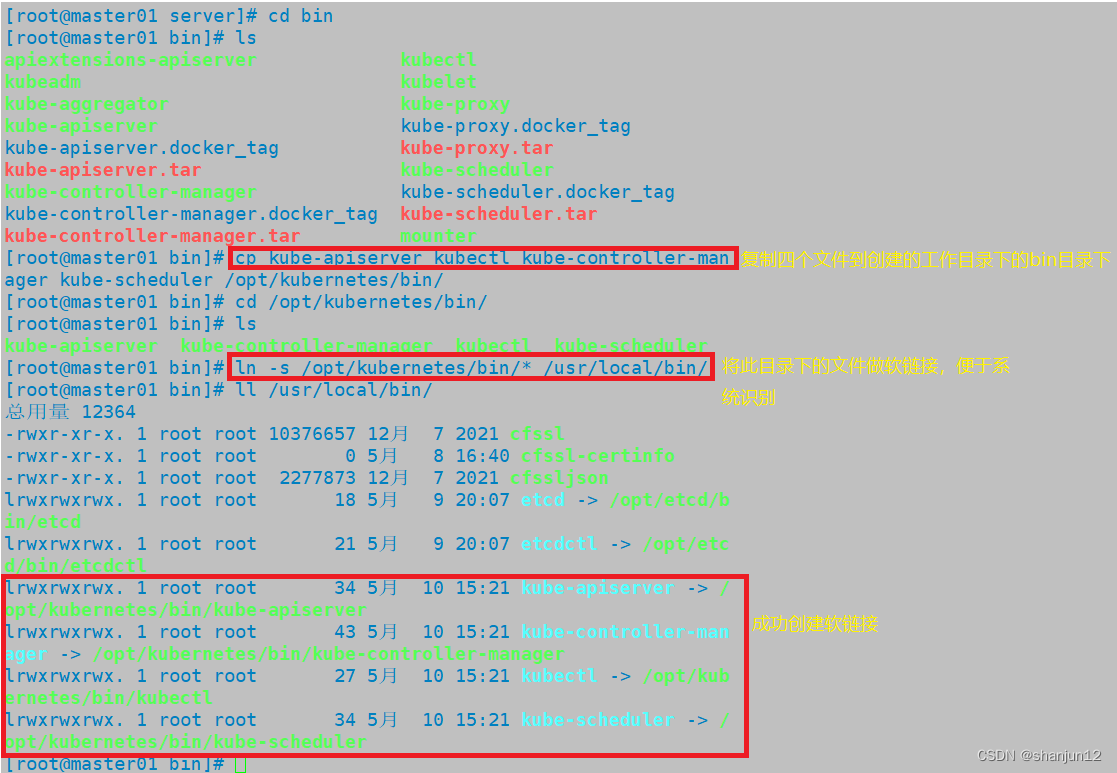

(6)复制master组件的关键命令文件到kubernetes. 工作目录的bin子目录中

cd /opt/k8s/kubernetes/server/bin

cp kube-apiserver kubectl kube-controller-manager kube-scheduler /opt/kubernetes/bin/

ln -s /opt/kubernetes/bin/* /usr/local/bin/

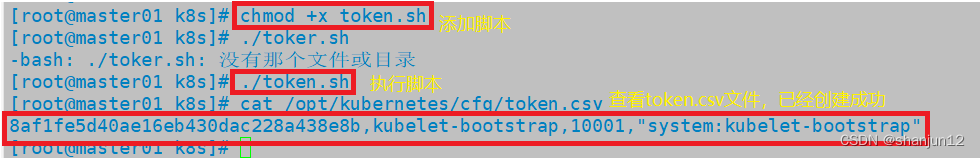

(7)创建bootstrap token 认证文件,apiserver 启动时会调用,然后就相当于在集群内创建了一个这个用户,接下来就可以用RBAC给他授权

cd /opt/k8s/

vim token.sh

#!/bin/bash

#获取随机数前16个字节内容,以十六进制格式输出,并删除其中空格

BOOTSTRAP_TOKEN=$(head -c 16 /dev/urandom | od -An -t x | tr -d ' ')

#生成 token.csv 文件,按照 Token序列号,用户名,UID,用户组 的格式生成

cat > /opt/kubernetes/cfg/token.csv <<EOF

${BOOTSTRAP_TOKEN},kubelet-bootstrap,10001,"system:kubelet-bootstrap"

EOFchmod +x token.sh

./token.shcat /opt/kubernetes/cfg/token.csv

(8) 二进制文件,token,证书都准备好,开启apiserver并检查进程是否启动成功

./apiserver.sh 192.168.156.10 https://192.168.156.10:2379,https://192.168.156.140:2379,https://192.168.156.150:2379ps aux | grep kube-apiserver

k8s通过kube- apiserver这 个进程提供服务,该进程运行在单个master节点上。默认有两个端口6443和8080

安全端口6443用于接收HTTPS请求,用于基于Token文件或客户端证书等认证

本地端口8080用于接收HTTP请求,非认证或授权的HTTP请求通过该端口访问APIServer

netstat -natp | grep 6443

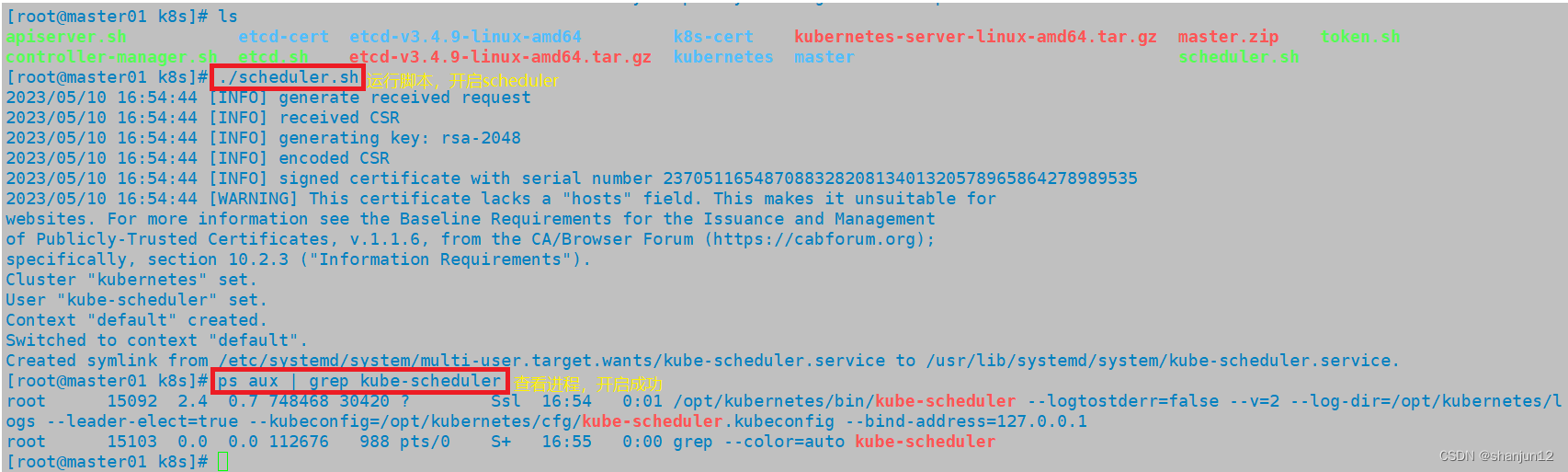

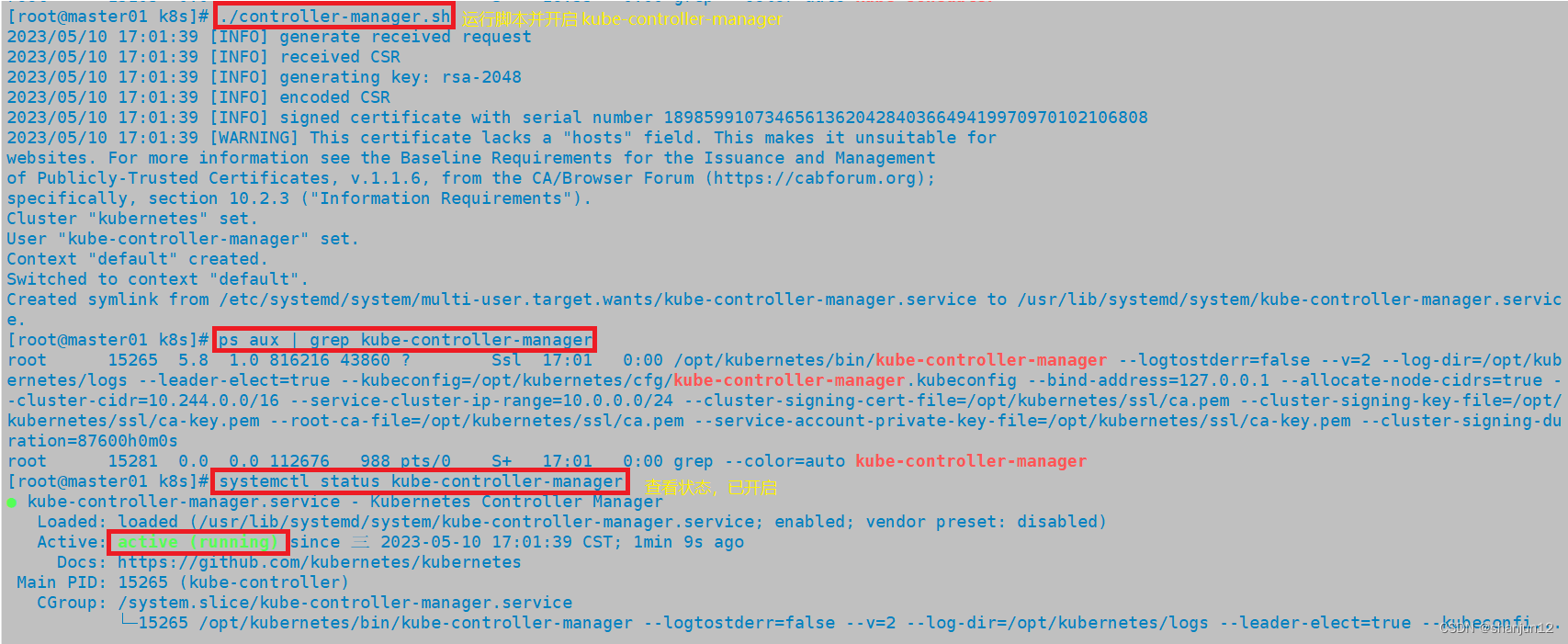

(9)启动 scheduler 服务和启动 controller-manager 服务

cd /opt/k8s/

./scheduler.sh

ps aux | grep kube-scheduler./controller-manager.sh

ps aux | grep kube-controller-manager

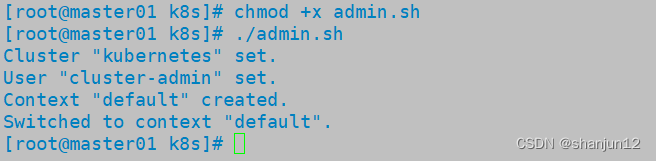

(10)生成kubectl连接集群的kubeconfig文件和通过kubectl工具查看当前集群组件状态

./admin.shkubectl get cs

4.部署node组件

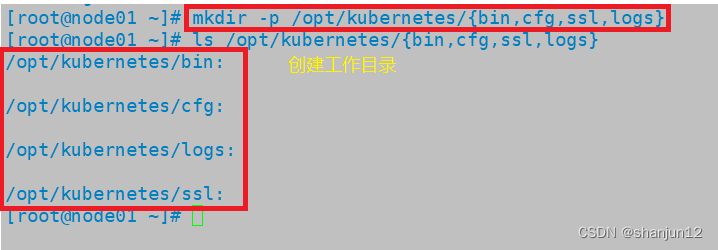

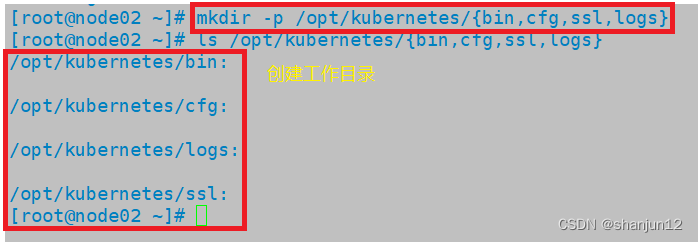

1.在所有 node 节点上操作,创建kubernetes工作目录。

mkdir -p /opt/kubernetes/{bin,cfg,ssl,logs}

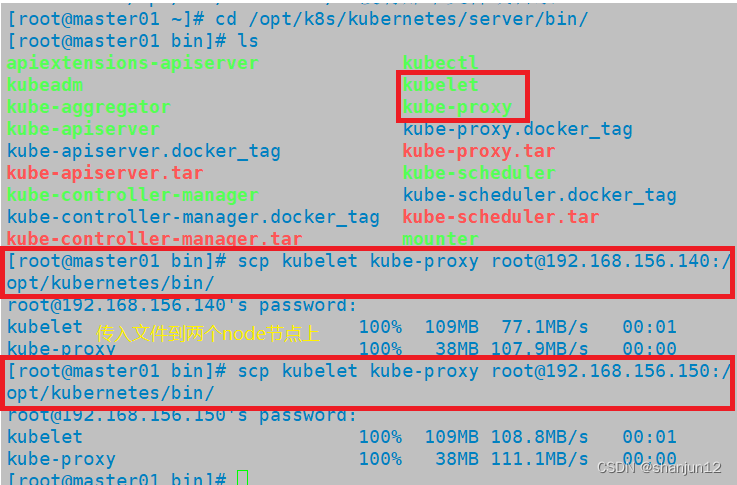

2.在 master01 节点上操作,把 kubelet、kube-proxy 拷贝到 node 节点

cd /opt/k8s/kubernetes/server/bin

scp kubelet kube-proxy root@192.168.156.140:/opt/kubernetes/bin/

scp kubelet kube-proxy root@192.168.156.150:/opt/kubernetes/bin/

3.在node1 节点上操作,上传node.zip 到/opt 目录中,解压node.zip 压缩包,获得kubelet.sh、 proxy.sh

cd /opt/

unzip node.zip

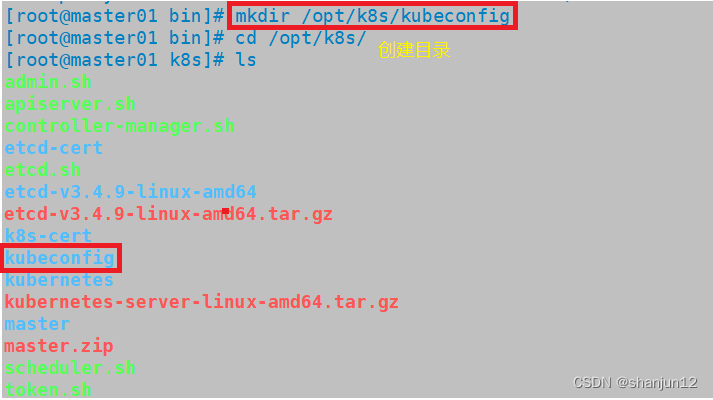

4.在master1节点上操作,创建用于生成kubelet的配置文件的目录

mkdir /opt/k8s/kubeconfig

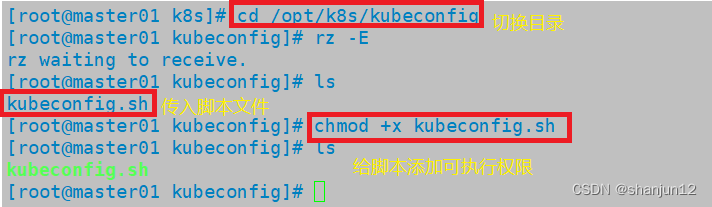

5.上传kubeconfig.sh 文件到/opt/k8s/kubeconfig 目录中

#kubeconfig.sh文件包含集群参数(CA 证书、API Server 地址),客户端参数(上面生成的证书和私钥),集群context

上下文参数(集群名称、用户名)。Kubenetes 组件(如kubelet、 kube-proxy) 通过启动时指定不同的kubeconfig文件可以切换到不同的集群,连接到apiserver

cd /opt/k8s/kubeconfig

chmod +x kubeconfig.sh

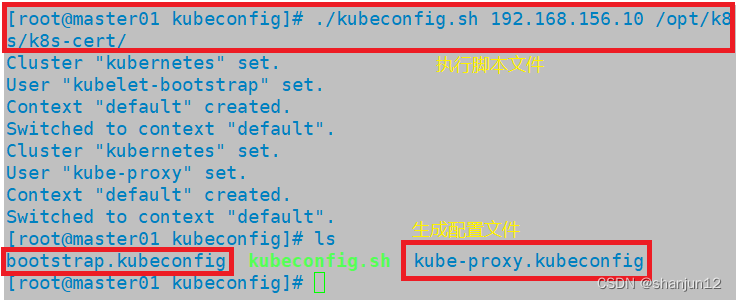

6.生成kubelet的配置文件

cd /opt/k8a/kubeconfig

./kubecontig.sh 192.168.156.10 /opt/k8s/k8s-cert/1s

bootstrap.kubeconfig kubeconfig.sh kube-proxy.kubeconfig

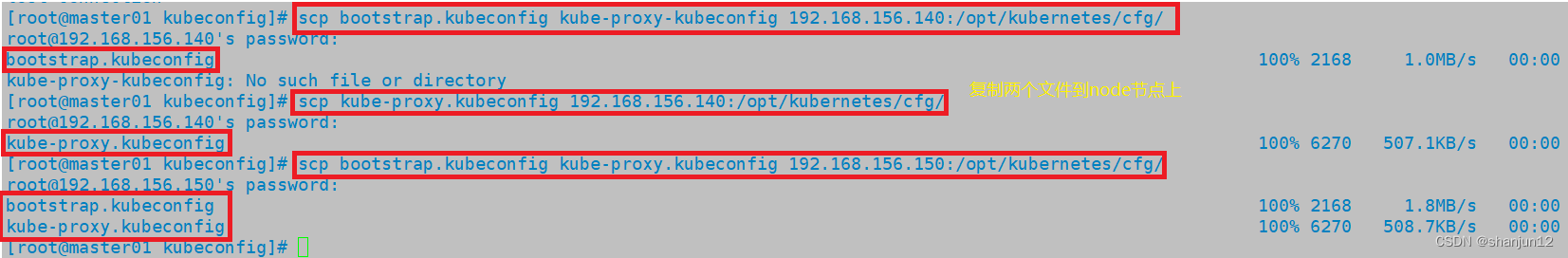

7.把配置文件bootstrap.kubeconfig、kube-proxy.kubeconfig拷贝到node节点

cd /opt/k8s/kubeconfig

scp bootstrap.kubeconfig kube-proxy-kubeconfig root@192.168.156.140:/opt/kubernetes/cfg/

scp bootstrap.kubeconfig kube-proxy.kubeconfig root@192.168.156.150:/opt/kubernetes/cfg/

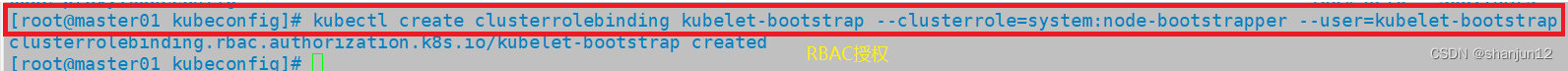

8.RBAC授权,将预设用户kubelet-bootatrap 与内置的ClusterRole system:node-bootatrapper 绑定到一起,使其能够发起CSR请求。

kubectl create clusterrolebinding kubelet-bootstrap --clusterrole=system:node-bootstrapper --user=kubelet-bootstrap

kubelet采用TLS Bootstrapping 机制,自动完成到kube -apiserver的注册,在node节点量较大或者后期自动扩容时非常有用。

Master apiserver 启用TLS 认证后,node 节点kubelet 组件想要加入集群,必须使用CA签发的有效证书才能与apiserver 通信,当node节点很多时,签署证书是一件很繁琐的事情。因此Kubernetes 引入了TLS bootstraping 机制来自动颁发客户端证书,kubelet会以一个低权限用户自动向apiserver 申请证书,kubelet 的证书由apiserver 动态签署。

kubelet首次启动通过加载bootstrap.kubeconfig中的用户Token 和apiserver CA证书发起首次CSR请求,这个Token被预先内置在apiserver 节点的token.csv 中,其身份为kubelet-bootstrap 用户和system: kubelet- bootstrap用户组:想要首次CSR请求能成功(即不会被apiserver 401拒绝),则需要先创建一个ClusterRoleBinding, 将kubelet-bootstrap 用户和system:node - bootstrapper内置ClusterRole 绑定(通过kubectl get clusterroles 可查询),使其能够发起CSR认证请求。

TLS bootstrapping 时的证书实际是由kube-controller-manager组件来签署的,也就是说证书有效期是kube-controller-manager组件控制的; kube-controller-manager 组件提供了一个--experimental-cluster-signing-duration

参数来设置签署的证书有效时间:默认为8760h0m0s, 将其改为87600h0m0s, 即10年后再进行TLS bootstrapping 签署证书即可。

也就是说kubelet 首次访问API Server 时,是使用token 做认证,通过后,Controller Manager 会为kubelet生成一个证书,以后的访问都是用证书做认证了。

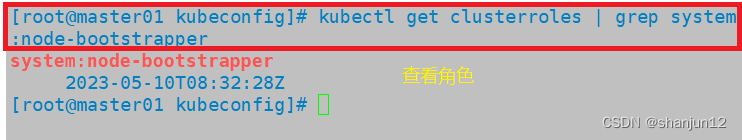

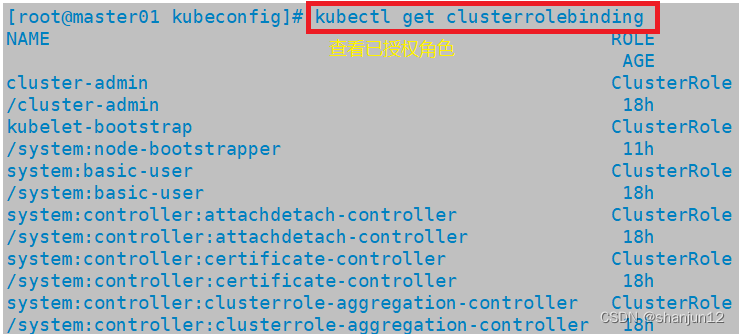

9.查看角色

kubectl get clusterroles | grep system:node-bootstrapper10.查看已授权的角色

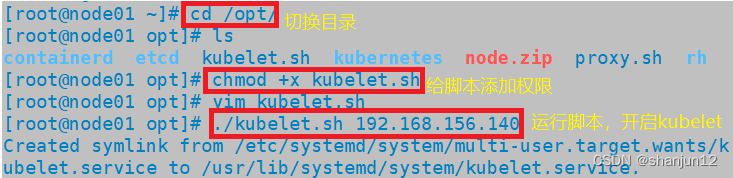

kubectl get clusterrolebinding11.在node1节点上操作,使用kubelet.sh脚本启动kubelet服务

cd /opt/

chmod +x kubelet.sh

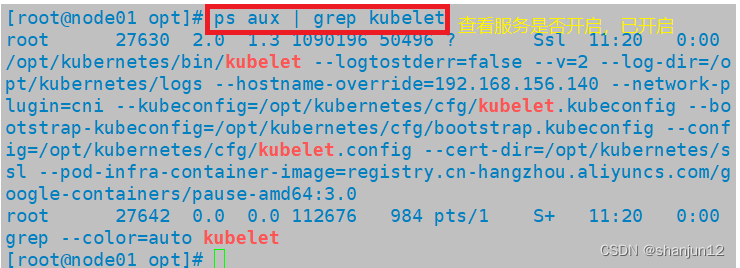

./kubelet.sh 192.168.156.14012.检查kubelet服务启动

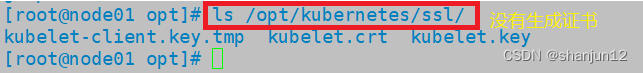

ps aux | grep kubelet13. 此时还没有生成证书

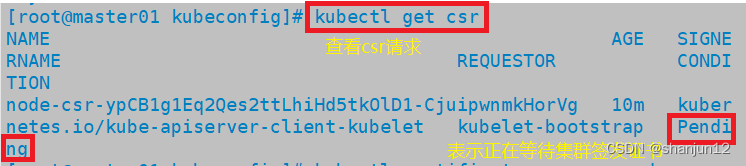

ls /opt/kubernetes/ssl/14.在master1 节点上操作,检查到node1 节点的kubelet 发起的CSR请求,Pending 表示等待集群给该节点签发证书.

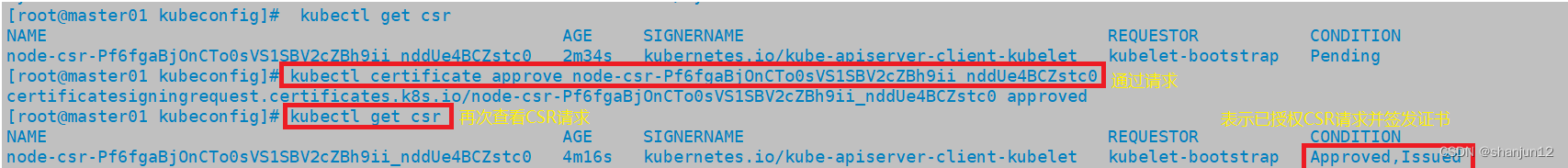

kubectl get csr15.通过CSR请求,再次查看CSR请求状态,Approved, Issued表示已授权CSR请求并签发证书

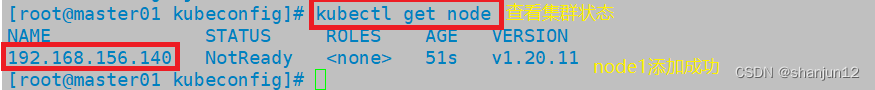

kubectl certificate approve node-csr-ypCB1g1Eq2Qes2ttLhiHd5tkOlD1-CjuipwnmkHorVgkubectl get csr16.查看群集节点状态,成功加入node1节点

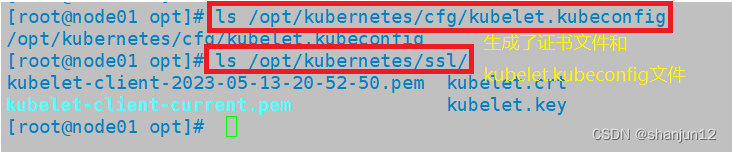

kubectl get nodes17.自动生成了证书和kubelet.kubeconfig 文件

ls /opt/kubernetes/cfg/kubelet.kubeconfig

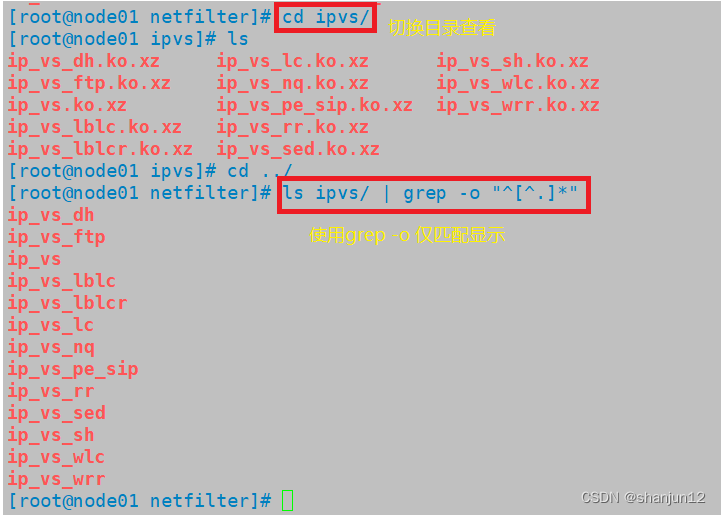

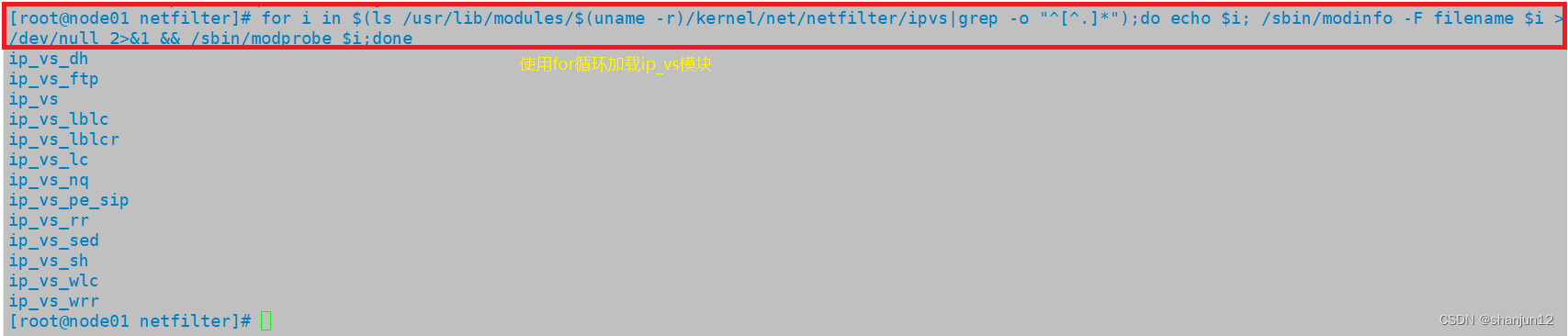

ls /opt/kubernetes/ssl/18.加载ip_vs模块

for i in $(ls /usr/lib/modules/$(uname -r)/kernel/net/netfilter/ipvs|grep -o "^[^.]*");do echo $i; /sbin/modinfo -F

filename $i >/dev/null 2>&1 && /sbin/modprobe $i;done

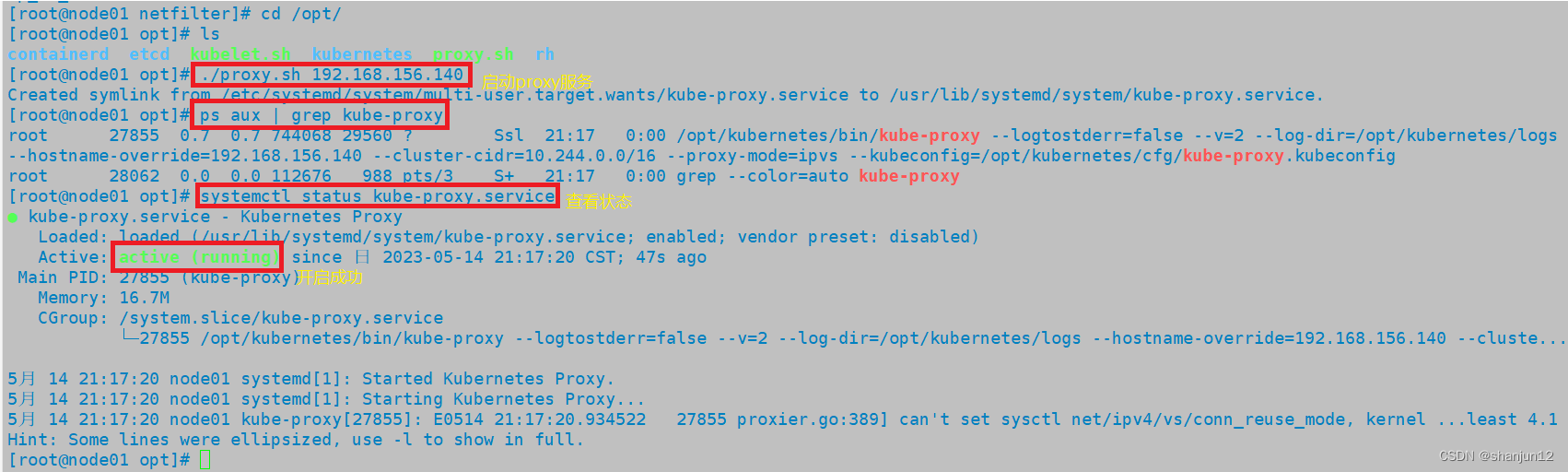

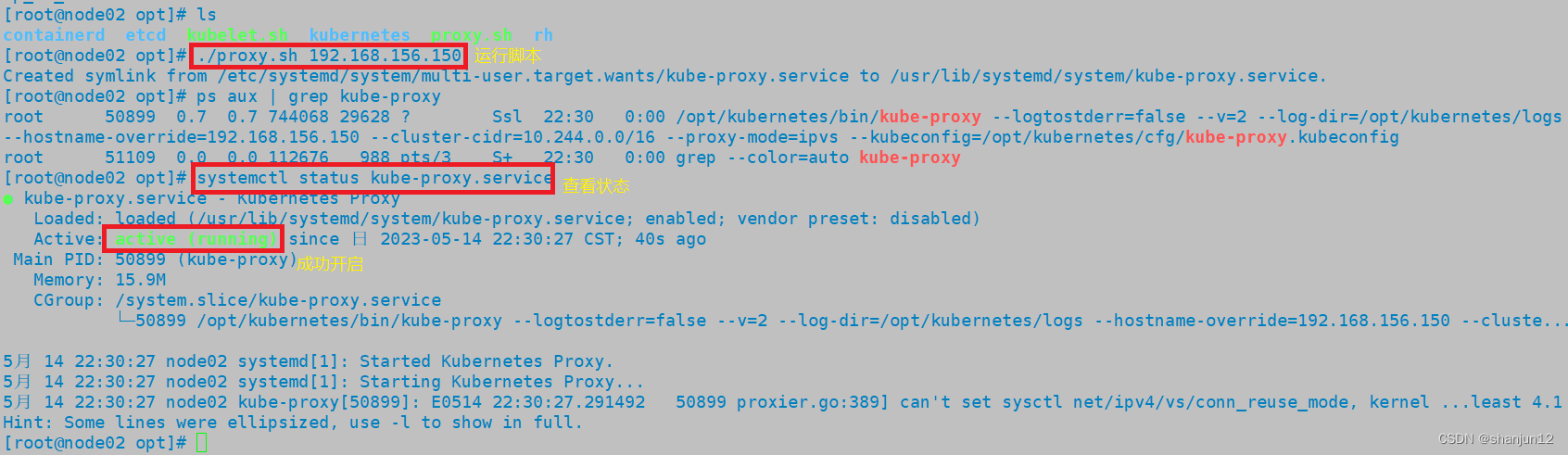

19.使用proxy.sh脚本启动proxy服务

cd /opt/

chmod +x proxy.sh

./proxy.sh 192.168.156.140systemctl status kube-proxy.service

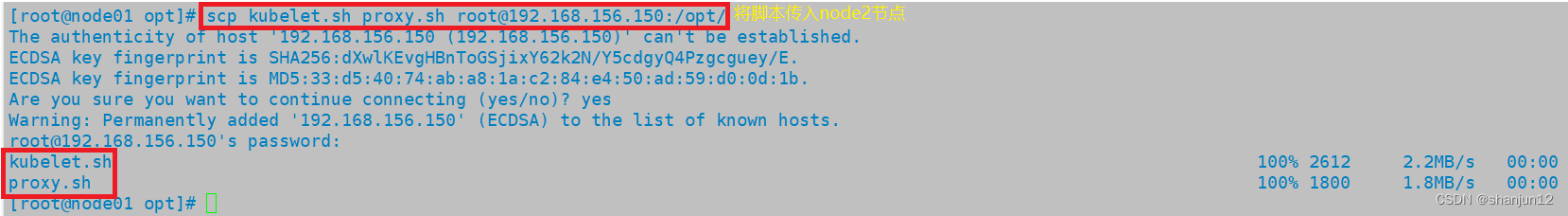

20.node2 节点部署,在node1 节点上将kubelet.sh、 proxy.sh 文件拷贝到node2 节点

cd /opt/

scp kubelet.sh proxy.sh root@192.168.156.150:/opt/

21.使用kubelet.sh脚本启动kubelet服务

cd /opt/

chmod +x kubelet.sh

./kubelet.sh 192.168.156.150

22.在master1 节点上操作,检查到node2 节点的kubelet 发起的CSR请求,Pending 表示等待集群给该节点签发证书

kubectl get csr

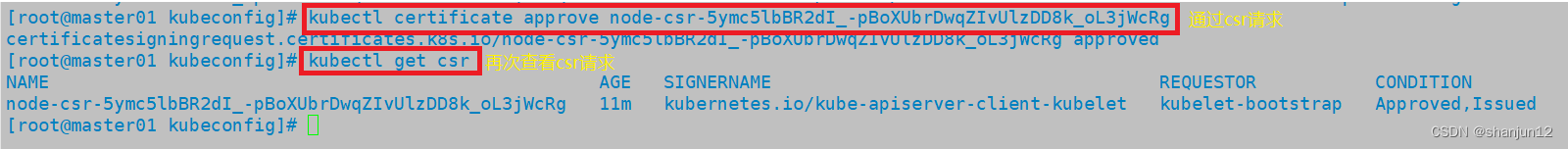

23.通过CSR请求,再次查看CSR请求状态,Approved, Issued表示已授权CSR请求并签发证书

kubectl certificate approve node-csr-5ymc5lbBR2dI_-pBoXUbrDwqZIvUlzDD8k_oL3jWcRgkubectl get csr

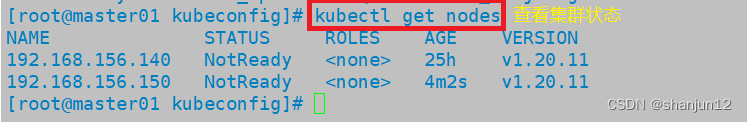

24.查看群集节点状态,成功加入node1节点

kubectl get nodes

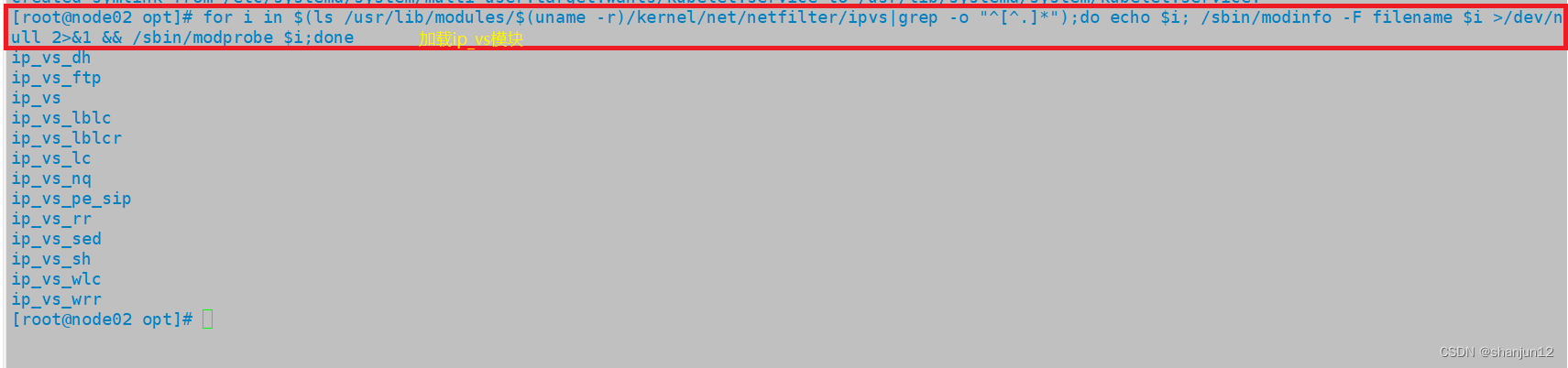

25.在node2 节点 加载ip_vs模块

for i in $(ls /usr/lib/modules/$(uname -r)/kernel/net/netfilter/ipvs|grep -o "^[^.]*");do echo $i; /sbin/modinfo -F filename $i >/dev/null 2>&1 && /sbin/modprobe $i;done

26.使用proxy.sh脚本启动proxy服务

cd /opt/

chmod +x proxy.sh

./proxy.sh 192.168.156.150systemctl status kube-proxy.service

5.flannel网络配置

1.K8S中Pod网络通信

(1)Pod内容器与容器之间的通信

在同一个Pod内的容器(Pod内的容器是不会跨宿主机的)共享同一个网络命令空间,相当于它们在网一台机器上一样,可以用localhost地址访间彼此的端口。

(2)同一个Node内Pod之间的通信

每个Pod 都有一个真实的全局IP地址,同一个Node 内的不同Pod之间可以直接采用对方Pod的IP 地址进行通信,Pod1 与Pod2都是通过veth连接到同一个docker0 网桥,网段相同,所以它们之间可以直接通信。

(3)不同Node上Pod之间的通信

Pod地址与docker0 在同一网段,dockor0 网段与宿主机网卡是两个不同的网段,且不同Nodo之间的通信贝能通过宿主机的物理网卡进行,要想实现不同Node 上Pod之间的通信,就必须想办法通过主机的物理网卡IP地址进行寻址和通信。

因此要满足两个条件:

Pod 的IP不能冲突:

将Pod的IP和所在的Node的IP关联起来,通过这个关联让不同Node上Pod之间直接通过内网IP地址通信。

===Overlay Network:===

叠加网络,在二层或者三层基础网络上叠加的一种虚拟网络技术模式,该网络中的主机通过虚拟链路隧道连接起来(类似于VPN)

===VXLAN:===

将源数据包封装到UDP中,并使用基础网络的IP/MAC作为外层报文头进行封装,然后在以太网上传输,到达目的地后由隧道端点解封装并将数据发送给目标地址

===Flannel:===

Flannel的功能是让集群中的不同节点主机创建的Docker容器都具有全集群唯一的虚拟IP地址

Flannel是Overlay 网络的一种,也是将TCP 源数据包封装在另一种网络 包里而进行路由转发和通信,目前己经支持UDP、VXLAN、AwS VPC等数据转发方式

===ETCD之Flannel 提供说明:===

存储管理Flanne1可分配的IP地址段资源

监控ETCD中每个Pod 的实际地址,并在内存中建立维护Pod 节点路由表

2.Flannel工作原理

node1上的pod1 要和node2上的pod1进行通信

1.数据从node1上的Pod1源容器中发出,经由所在主机的docker0 虚拟网卡转发到flannel0虚拟网卡;

2.再由flanneld把pod ip封装到udp中(里面封装的是源pod IP和目的pod IP);

3.根据在etcd保存的路由表信息,通过物理网卡发送给目的node2的flanneld,来进行解封装暴露出udp里的pod IP;

4.最后根据目的pod IP经flannel0虚拟网卡和docker0虚拟网卡转发到目的pod中,最后完成通信。

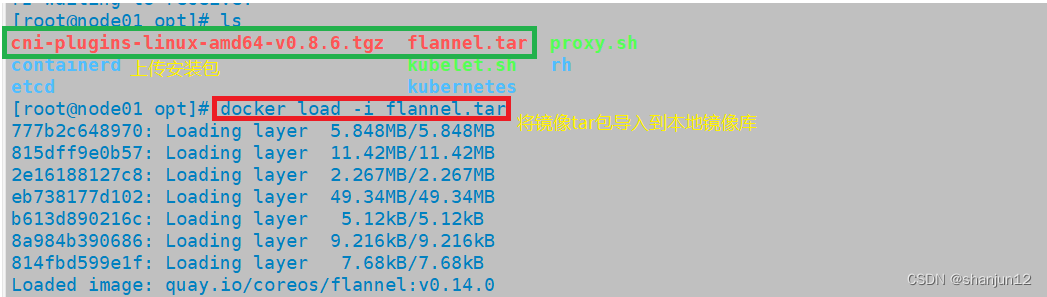

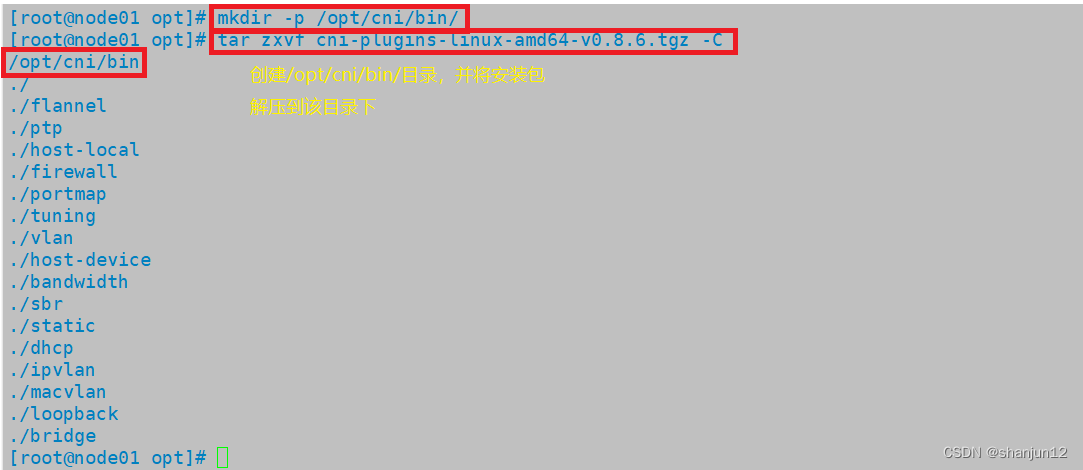

3.在所有node01 节点上操作

(1)上传flannel.sh 和flanne1-v0.10.0-1inux-amd64.tar.gz 到/opt 目录中,解压flannel 压缩包

cd /opt/

docker load -i flannel.tarmkdir /opt/cni/bin

tar zxvf cni-plugins-linux-amd64-v0.8.6.tgz -C /opt/cni/bin

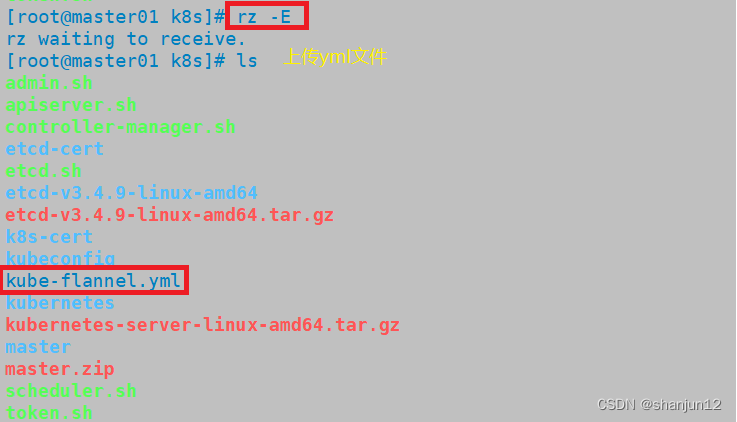

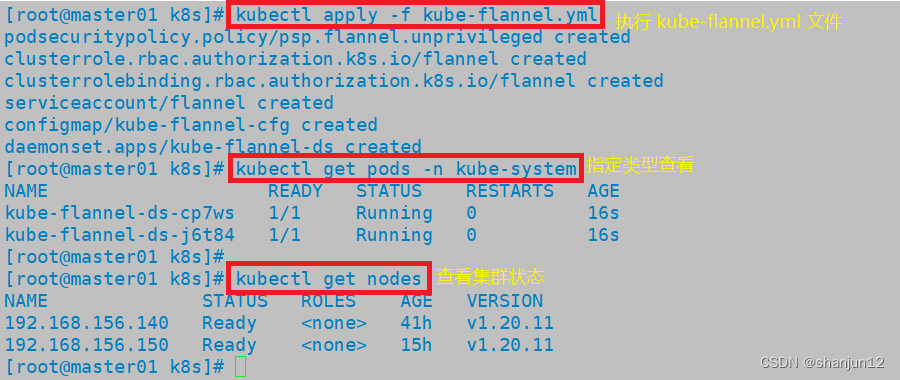

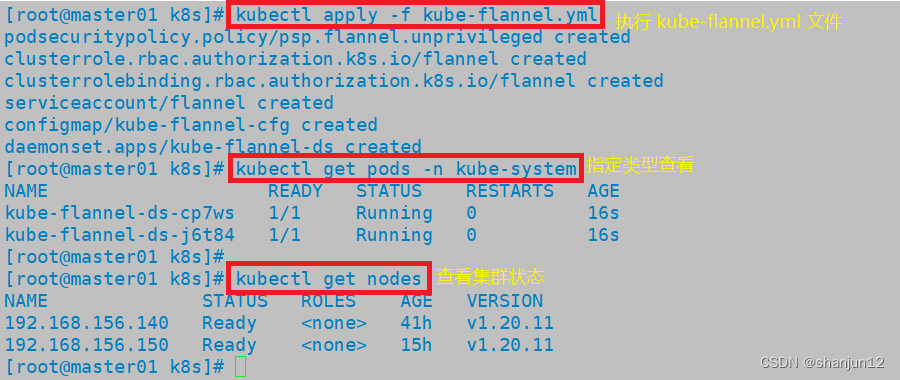

4.在 master01 节点上操作

(1)上传 kube-flannel.yml 文件到 /opt/k8s 目录中,部署 CNI 网络

cd /opt/k8s

kubectl apply -f kube-flannel.yml

kubectl get pods -n kube-system

kubectl get nodes

相关文章:

Kubernetes二进制部署 单节点

目录 1.环境准备 1.关闭防火墙和selinux 2.关闭swap 3.设置主机名 4.在master添加hosts 5.桥接的IPv4流量传递到iptables的链 6.时间同步 2.部署etcd集群 1.master节点部署 2.在node1与node2节点修改 3.在master1节点上进行启动 4.部署docker引擎 3.部署 Master 组…...

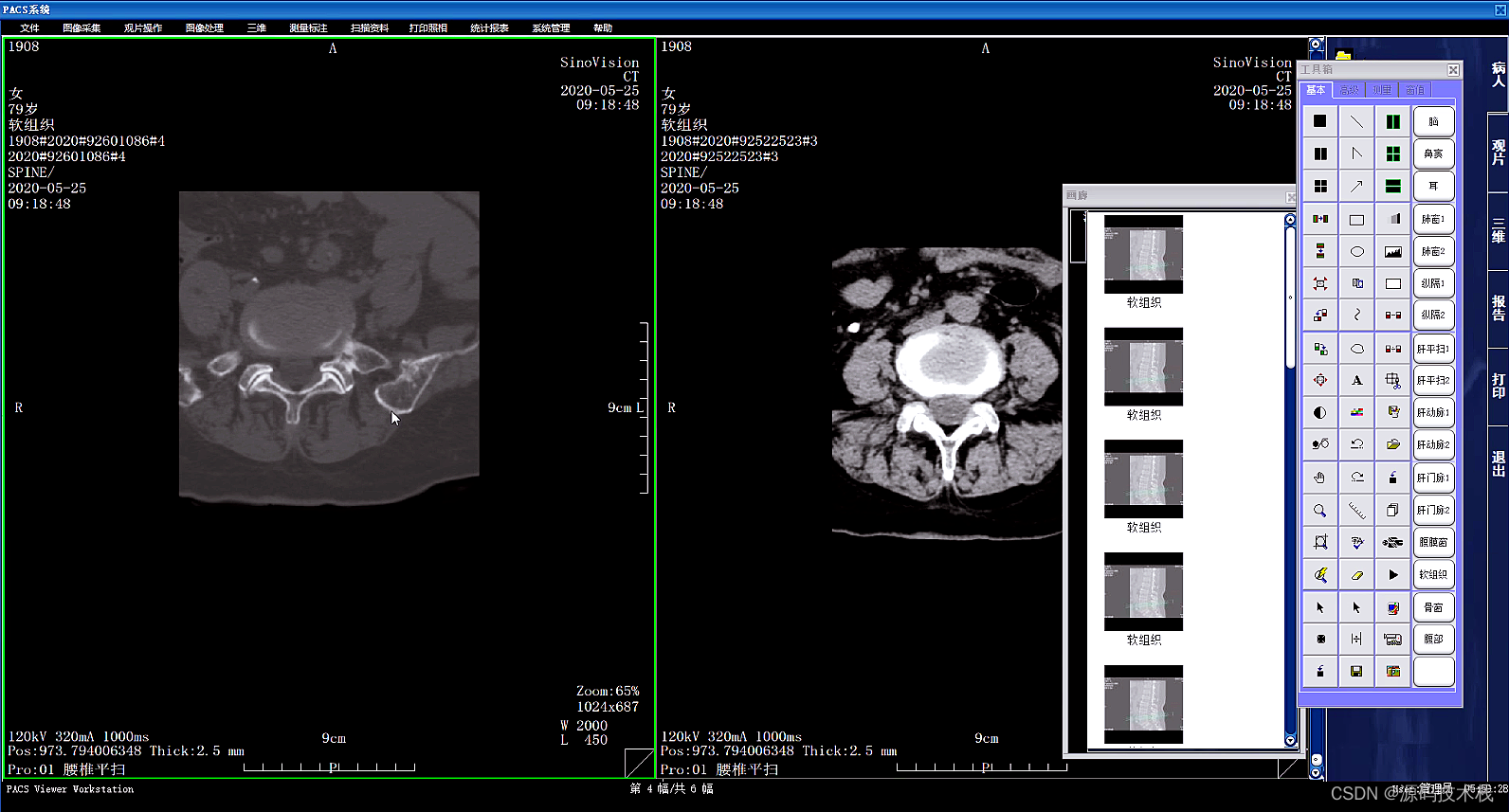

基于VC + MSSQL实现的县级医院医学影像PACS

一、概述: 基于VC MSSQL实现的一套三甲医院医学影像PACS源码,集成3D后处理功能,包括三维多平面重建、三维容积重建、三维表面重建、三维虚拟内窥镜、最大/小密度投影、心脏动脉钙化分析等功能。 二、医学影像PACS实现功能: 1、…...

Jmeter 压测 QPS

文章目录 1、准备工作1.1 Jmeter的基本概念1.2 Jmeter的作用1.3.Windows下Jmeter下载安装1.4 Jmeter的目录结构1.5 启动1.6 设置中文1.6.1 设置调整1.6.2 配置文件调整(一劳永逸) 2、Jmeter线程组基本操作2.1 线程组是什么2.2 线程组2.2.1 创建线程组2.2…...

如何在云上部署java项目

最近博主接了一波私活,由于上云的概念已经深入人心,客户要求博主也上云,本文将介绍上云的教程。 1.如何选择服务器 这里博主推荐阿里云服务器,阿里云云服务器ECS是一种安全可靠、弹性可伸缩的云计算服务,助您降低 IT…...

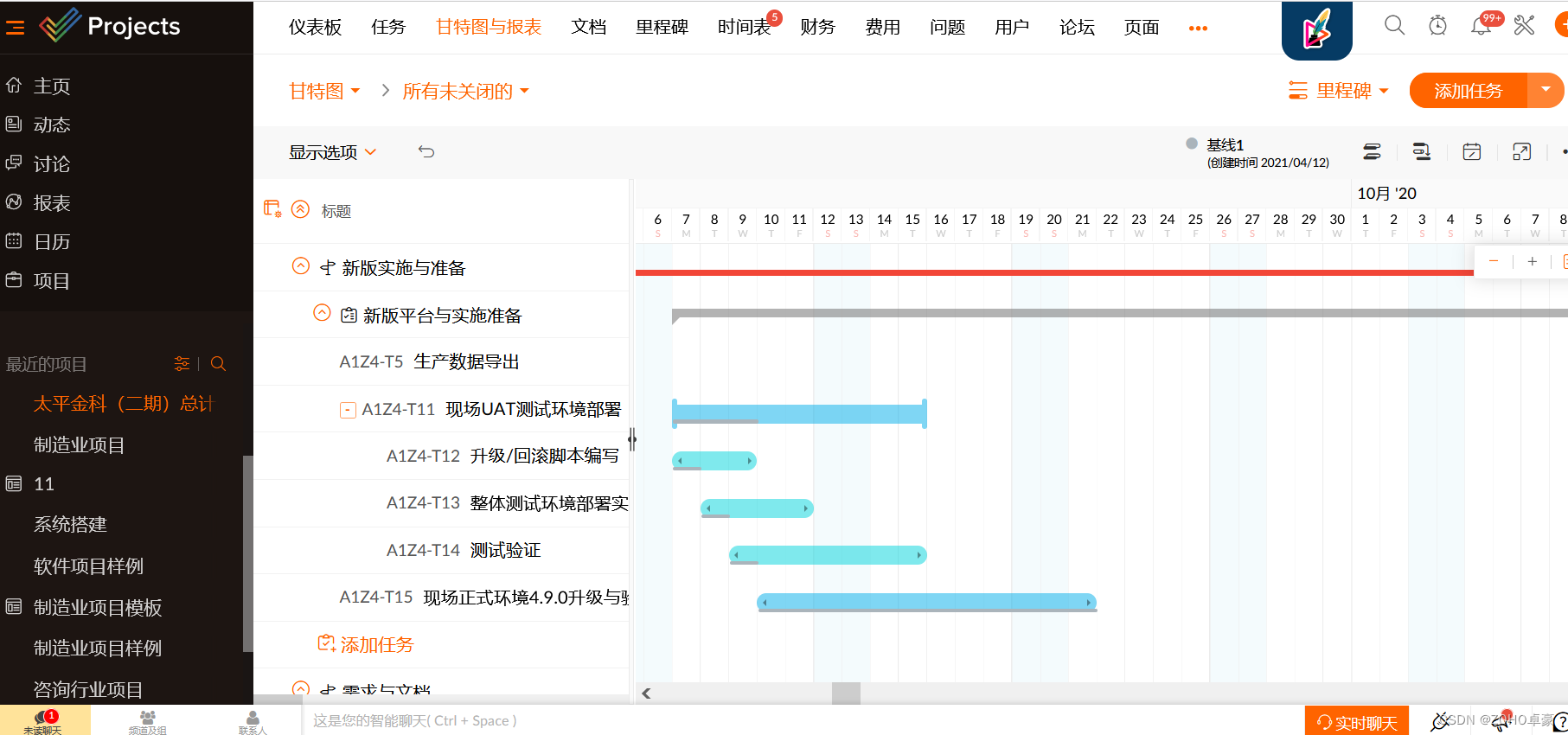

IT行业项目管理软件,你知道多少?

IT行业项目管理软件,主要得看用来管理的是软件研发还是做IT运维。如果是做软件研发,那还得看项目经理是用什么思路,是传统的瀑布式方法还是敏捷的方法或者是混合的方法。 如果用来管理的是IT运维工作,那么很多通用型的项目管理软件…...

小爱同学接入chatGPT

大致流程 最近入手了一款小爱音响,想着把小爱音响接入 chatGPT, 在 github 上找了一个非常优秀的开源项目,整个过程还是比较简单的,一次就完成了。 其中最难的技术点是 如何获取与小爱的对话记录?如何让小爱播放文本?…...

java运算符

1.运算符和表达式 运算符: 就是对常量或者变量进行操作的符号。 比如: - * / 表达式: 用运算符把常量或者变量连接起来的,符合Java语法的式子就是表达式。 比如:a b 这个整体就是表达式。 而其…...

StrongSORT_文献翻译

StrongSORT 【摘要】 现有的MOT方法可以被分为tracking-by-detection和joint-detection-association。后者引起了更多的关注,但对于跟踪精度而言,前者仍是最优的解决方案。StrongSORT在DeepSORT的基础之上,更新了它的检测、嵌入和关联等多个…...

Python每日一练(20230512) 跳跃游戏 V\VI\VII

目录 1. 跳跃游戏 V 2. 跳跃游戏 VI 3. 跳跃游戏 VII 🌟 每日一练刷题专栏 🌟 Golang每日一练 专栏 Python每日一练 专栏 C/C每日一练 专栏 Java每日一练 专栏 1. 跳跃游戏 V 给你一个整数数组 arr 和一个整数 d 。每一步你可以从下标 i 跳到&a…...

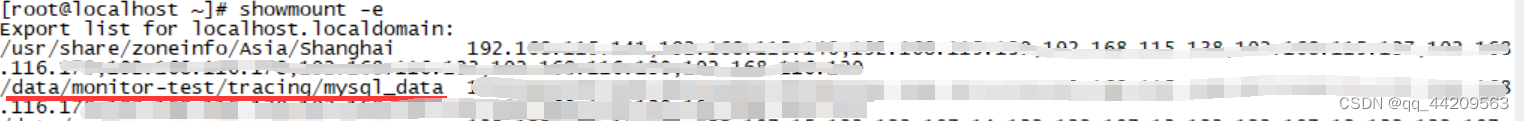

k8s部署mysql并使用nfs持久化数据

k8s部署mysql并使用nfs持久化数据 一、配置nfs服务器1.1 修改配置文件1.2. 载入配置1.3. 检查服务配置 二、创建K8S资源文件2.1 mysql-deployment.yml2.2 mysql-svc.yml 一、配置nfs服务器 参考文章: pod使用示例https://cloud.tencent.com/developer/article/1914388nfs配置…...

AI时代的赚钱思路:23岁女网红如何利用AI技术年入4亿?

一、AI技术为网红赚钱创造新途径 23岁美国网红Caryn Marjorie(卡琳玛乔丽)正同时交往1000多个男朋友。 作为一个在Snapchat上坐拥180万粉丝的美女,她利用人工智能(AI)技术,打造了一个AI版本的自己&#x…...

如何修复d3dcompiler_47.dll缺失?多种解决方法分享

在使用Windows操作系统的过程中,有时候会遇到d3dcompiler_47.dll缺失的情况。这个问题可能会导致某些应用程序无法正常运行,因此需要及时解决。本文将介绍如何修复d3dcompiler_47.dll缺失的问题。 一.什么是d3dcompiler_47.dll D3dcompiler_47.dll是Di…...

【项目实训】ATM自助取款系统

文章目录 1. 课程设计目的2. 课程设计任务与要求3. 课程设计说明书3.1 需求分析3.1.1 功能分析3.1.2 性能要求分析 3.2 概要设计3.2.1 功能模块图 3.3 详细设计3.3.1 实体类的设计3.3.2 实现数据库处理 3.4 主要程序功能流程图 4. 课程设计成果4.1 完整代码4.2 运行结果4.2.1 精…...

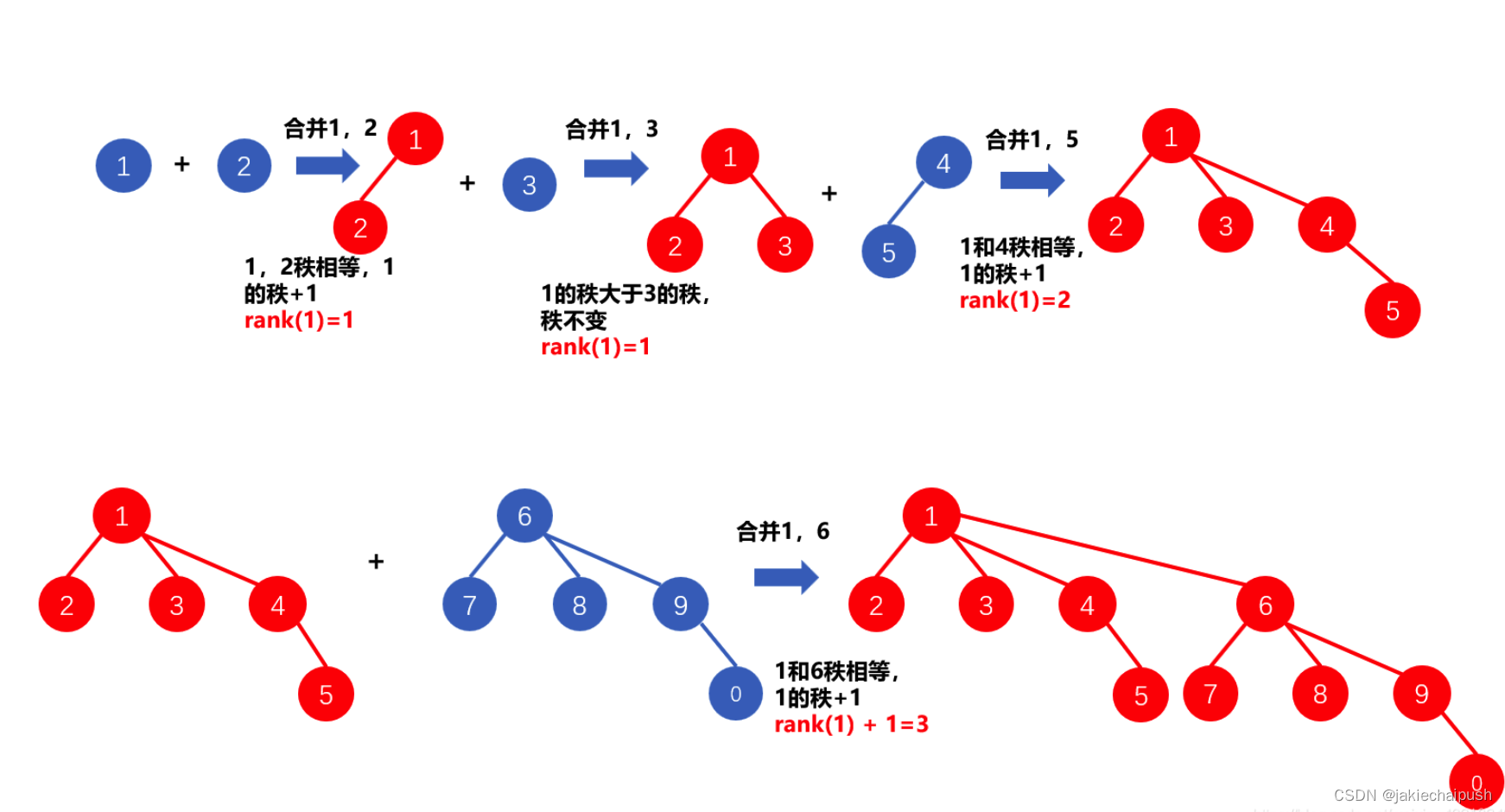

并查集算法

文章目录 1. 原理介绍2. 并查集的应用3. find()函数的定义与实现4. 并查集的join函数5. 路径压缩优化算法-优化find6. 路径压缩优化算法按秩合并算法 1. 原理介绍 并查集是一种用于维护集合关系的数据结构,它支持合并集合和查询元素所在的集合。它的基本思想是将元…...

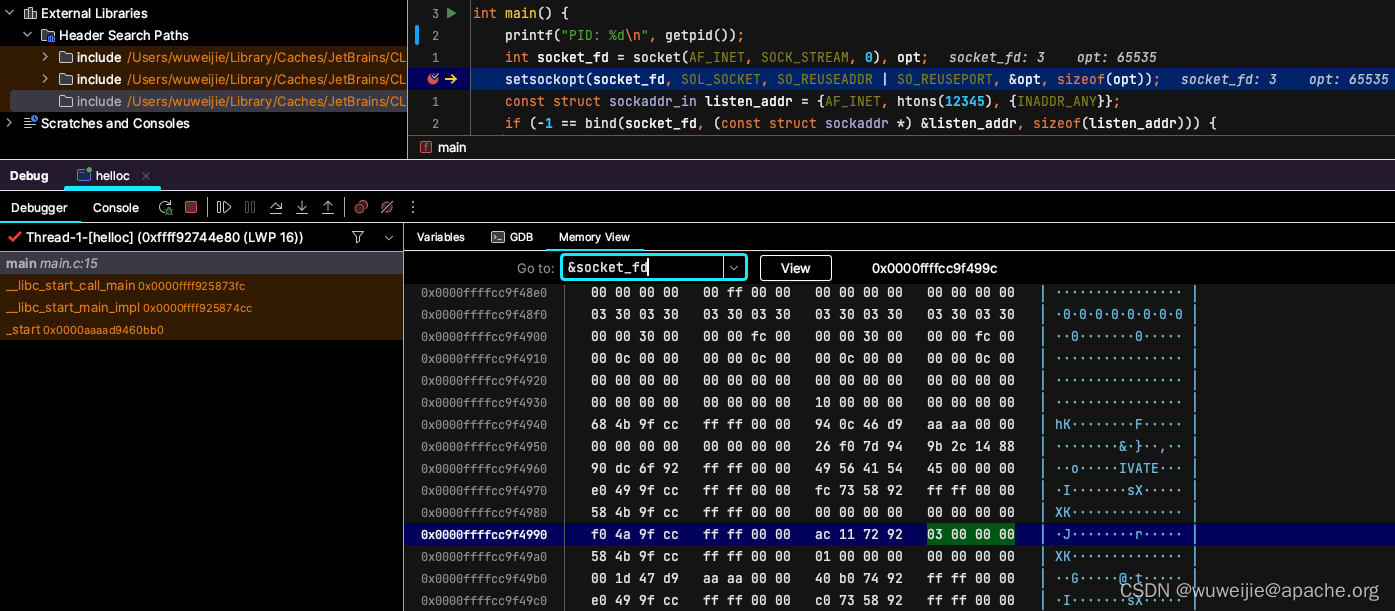

十分钟在 macOS 快速搭建 Linux C/C++ 开发环境

有一个使用了 Epoll 的 C 项目,笔者平时用的 Linux 主力开发机不在身边,想在 macOS 上开发调试,但是没有 Linux 虚拟机。恰好,JetBrains CLion 的 Toolchains 配置除了使用本地环境,还支持 SSH、Docker。 笔者使用 CL…...

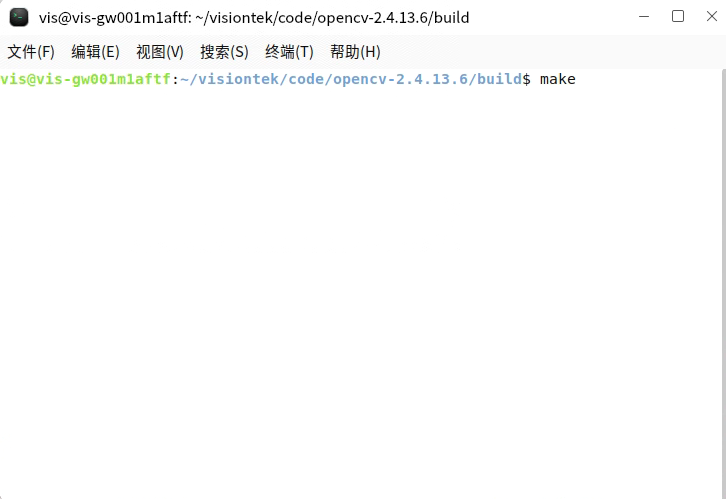

银河麒麟系统Arm64编译opencv指南

进入opencv官网下载版本;我这边下载的是2.4.13.6 ;根据需要下载最新的 Releases - OpenCV 拷贝进麒麟系统我这边是麒麟V10 sp1 2204;并解 cmake 在麒麟应用商城中安装; 打开cmake 设置opencv路径;builder文件夹可以自…...

蒙层禁止下方页面滚动防抖动完美方案

学习链接 js如何禁止滚动条滚动,但不消失! - 这个是完美解决方案(在线demo示例) 解决窗口滚动条消失而导致的页面内容抖动的问题 完美解决js 禁止滚动条滚动,并且滚动条不消失,页面大小不闪动 蒙层禁止…...

微积分python基础

微积分基础(python) 文章目录 微积分基础(python)1 函数与极限2 求导与微分3 不定积分4 定积分 1 函数与极限 # 导入sympy库 from sympy import * # 将x符号化 x Symbol("x") xx \displaystyle x x # 利用sympy中solve函数求解方程 X solve(x**2-10*x21,x) X pri…...

)

Redis缓存数据库(一)

目录 一、概述 1、Redis 2、Redis的安装 Redis Windows环境设置 3、String: 字符串 3.1、字符串 3.2、数值 3.3、bitmap 4、Hash: 散列 5、List: 列表 6、Set: 集合 7、Sorted Set: 有序集合 一、概述 常识: 磁盘:1.寻址:ms&…...

物联网|uart串口相关寄存器|波特率设置及计算|发送处理代码|串口接收中断处理函数|物联网之蓝牙4.0 BLE基础-学习笔记(7)

文章目录 13 uart串口基础开发基本电路图:实验相关寄存器波特率设置及计算计算过程:设置中断发送处理代码串口接收中断处理函数main.c 13 uart串口基础开发 基本电路图: 实验相关寄存器 相关寄存器UxCSR、UxCSR、UxGCR、UxBUF、UxBAUD、CLK…...

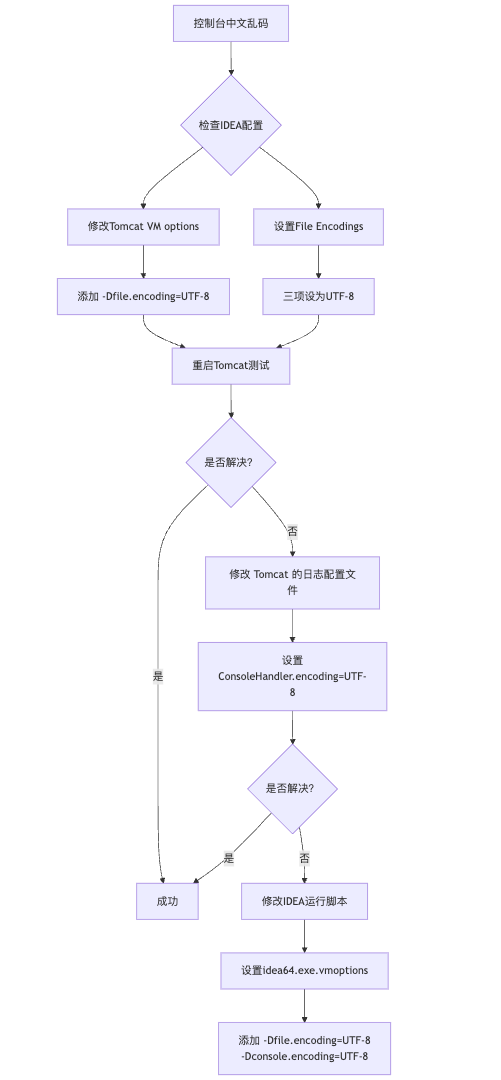

IDEA运行Tomcat出现乱码问题解决汇总

最近正值期末周,有很多同学在写期末Java web作业时,运行tomcat出现乱码问题,经过多次解决与研究,我做了如下整理: 原因: IDEA本身编码与tomcat的编码与Windows编码不同导致,Windows 系统控制台…...

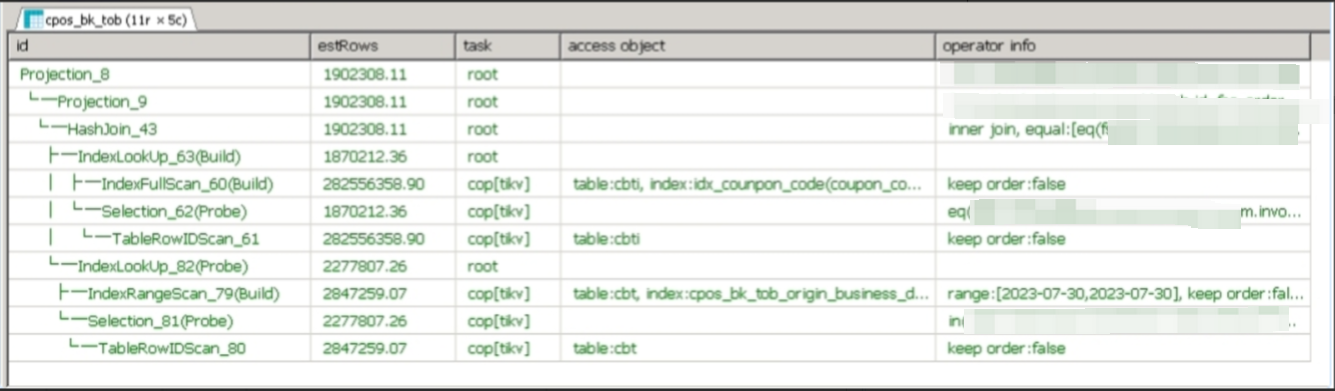

【入坑系列】TiDB 强制索引在不同库下不生效问题

文章目录 背景SQL 优化情况线上SQL运行情况分析怀疑1:执行计划绑定问题?尝试:SHOW WARNINGS 查看警告探索 TiDB 的 USE_INDEX 写法Hint 不生效问题排查解决参考背景 项目中使用 TiDB 数据库,并对 SQL 进行优化了,添加了强制索引。 UAT 环境已经生效,但 PROD 环境强制索…...

【ROS】Nav2源码之nav2_behavior_tree-行为树节点列表

1、行为树节点分类 在 Nav2(Navigation2)的行为树框架中,行为树节点插件按照功能分为 Action(动作节点)、Condition(条件节点)、Control(控制节点) 和 Decorator(装饰节点) 四类。 1.1 动作节点 Action 执行具体的机器人操作或任务,直接与硬件、传感器或外部系统…...

Qwen3-Embedding-0.6B深度解析:多语言语义检索的轻量级利器

第一章 引言:语义表示的新时代挑战与Qwen3的破局之路 1.1 文本嵌入的核心价值与技术演进 在人工智能领域,文本嵌入技术如同连接自然语言与机器理解的“神经突触”——它将人类语言转化为计算机可计算的语义向量,支撑着搜索引擎、推荐系统、…...

土地利用/土地覆盖遥感解译与基于CLUE模型未来变化情景预测;从基础到高级,涵盖ArcGIS数据处理、ENVI遥感解译与CLUE模型情景模拟等

🔍 土地利用/土地覆盖数据是生态、环境和气象等诸多领域模型的关键输入参数。通过遥感影像解译技术,可以精准获取历史或当前任何一个区域的土地利用/土地覆盖情况。这些数据不仅能够用于评估区域生态环境的变化趋势,还能有效评价重大生态工程…...

React---day11

14.4 react-redux第三方库 提供connect、thunk之类的函数 以获取一个banner数据为例子 store: 我们在使用异步的时候理应是要使用中间件的,但是configureStore 已经自动集成了 redux-thunk,注意action里面要返回函数 import { configureS…...

A2A JS SDK 完整教程:快速入门指南

目录 什么是 A2A JS SDK?A2A JS 安装与设置A2A JS 核心概念创建你的第一个 A2A JS 代理A2A JS 服务端开发A2A JS 客户端使用A2A JS 高级特性A2A JS 最佳实践A2A JS 故障排除 什么是 A2A JS SDK? A2A JS SDK 是一个专为 JavaScript/TypeScript 开发者设计的强大库ÿ…...

作为测试我们应该关注redis哪些方面

1、功能测试 数据结构操作:验证字符串、列表、哈希、集合和有序的基本操作是否正确 持久化:测试aof和aof持久化机制,确保数据在开启后正确恢复。 事务:检查事务的原子性和回滚机制。 发布订阅:确保消息正确传递。 2、性…...

加密通信 + 行为分析:运营商行业安全防御体系重构

在数字经济蓬勃发展的时代,运营商作为信息通信网络的核心枢纽,承载着海量用户数据与关键业务传输,其安全防御体系的可靠性直接关乎国家安全、社会稳定与企业发展。随着网络攻击手段的不断升级,传统安全防护体系逐渐暴露出局限性&a…...

ThreadLocal 源码

ThreadLocal 源码 此类提供线程局部变量。这些变量不同于它们的普通对应物,因为每个访问一个线程局部变量的线程(通过其 get 或 set 方法)都有自己独立初始化的变量副本。ThreadLocal 实例通常是类中的私有静态字段,这些类希望将…...